Clear Sky Science · it

Audit della privacy più stringente per lo stochastic gradient descent differenzialmente privato nel modello di minaccia a stato nascosto

Perché questo conta per la tecnologia di tutti i giorni

Le app moderne apprendono costantemente dai nostri dati, dalle foto e dai messaggi alle cartelle cliniche. Uno dei metodi principali per mantenere sicuro questo addestramento è la privacy differenziale, che introduce rumore calibrato in modo che i dati di una singola persona non risaltino. Ma come possiamo sapere che queste protezioni funzionino davvero nella pratica, specialmente per le reti neurali profonde usate oggi? Questo articolo indaga la questione e mostra quando nascondere il “film dell’addestramento” di un modello aiuta veramente la privacy — e quando invece non lo fa.

Come dovrebbe funzionare l’apprendimento privato

Il stochastic gradient descent differenzialmente privato (DP-SGD) è l’algoritmo di riferimento per il machine learning che preserva la privacy. Allena i modelli passo dopo passo su piccoli batch di dati, ritagliando il gradiente di ciascun passo (la direzione di miglioramento) e aggiungendo rumore casuale prima di aggiornare il modello. La teoria fornisce limiti superiori su quanto i dati di una persona possano influenzare il modello finale, riassunti in un numero di privacy spesso chiamato epsilon. Parallelamente, l’“audit della privacy” tenta di attaccare il modello addestrato per vedere quante informazioni possono essere effettivamente estratte nella pratica. Se teoria e audit coincidono, possiamo fidarci della contabilità della privacy; se non coincidono, significa che qualcosa di importante è stato trascurato.

Cosa cambia quando viene rivelato solo il modello finale

La maggior parte degli audit precedenti assumeva un avversario potente in grado di vedere ogni checkpoint intermedio del modello durante l’addestramento. In realtà, molte organizzazioni rilasciano solo il modello finale, non la storia completa dell’addestramento. Questo scenario più realistico è chiamato modello di minaccia a stato nascosto. Lavori teorici recenti suggerivano che, almeno per problemi convessi semplici, nascondere i modelli intermedi potrebbe amplificare la privacy nel tempo: i dati usati all’inizio dell’addestramento vengono “diluiti” dagli aggiornamenti rumorosi successivi. Tuttavia, il deep learning moderno si basa su modelli altamente non convessi, dove la superficie di perdita è irta e complessa. Non era chiaro se la stessa amplificazione si verificasse anche lì — o se gli attacchi esistenti fossero semplicemente troppo deboli per esporre la perdita di privacy completa.

Un nuovo modo per gli avversari di spingere il modello

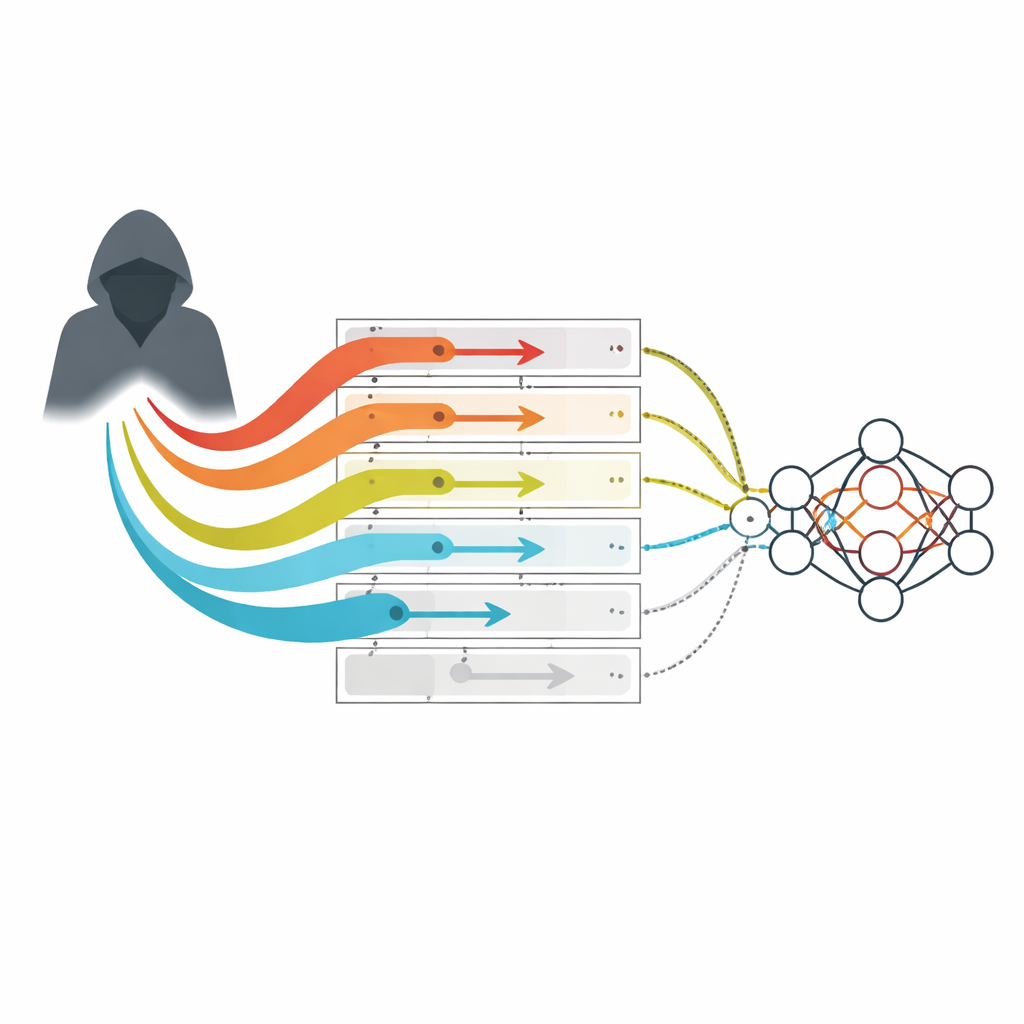

L’autore introduce una nuova famiglia di avversari di “manipolazione dei gradienti” pensata per il modello a stato nascosto. Invece di cercare di progettare un punto dati speciale e poi osservare come cambia la sua perdita durante l’addestramento (come negli attacchi tradizionali basati sulla perdita), questi avversari prescrivono direttamente la sequenza di gradienti che verrebbero applicati se fosse presente un dato peggiore del caso. Scelgono gradienti che colpiscono sempre la soglia di clipping e si allineano con direzioni di parametri raramente aggiornate, rendendo la loro influenza più facile da rilevare anche senza vedere i modelli intermedi. Sono studiate due varianti semplici: una che sceglie casualmente una direzione di parametro e un’altra che simula il processo di addestramento per trovare la direzione meno aggiornata prima di iniettare gradienti forti e ripetuti lungo di essa.

Cosa rivelano gli esperimenti sul rischio reale per la privacy

Usando questo quadro, l’articolo sottopone a audit DP-SGD su dataset di immagini e tabulari con architetture comuni come reti convoluzionali e residuali, oltre a un piccolo modello fully connected. Quando il gradiente costruito viene usato a ogni passo di addestramento, i nuovi avversari raggiungono i rigidi limiti teorici della privacy — nonostante vedano solo il modello finale. Questo significa che, in questo caso estremo, nascondere i checkpoint intermedi non fornisce alcuna privacy aggiuntiva. Quando il gradiente costruito viene inserito meno frequentemente, il quadro cambia: per batch grandi rispetto al livello di rumore, gli audit restano vicini alla teoria (suggerendo ancora poca amplificazione reale), ma per batch più piccoli e rumore più elevato emerge un divario che indica un’amplificazione della privacy genuina, seppur modesta, in contesti non convessi.

Uno sguardo al limite del caso peggiore

Per comprendere i limiti assoluti della privacy nel modello a stato nascosto, l’articolo studia anche un avversario teorico più estremo che non solo costruisce gradienti ma progetta un intero paesaggio di perdita per mantenere viva l’influenza di un dato speciale attraverso le iterazioni. In questo contesto controllato, i risultati separano in modo netto due regimi: con batch di grandi dimensioni, la contabilità della privacy basata sulla teoria standard è essenzialmente stretta, mentre con batch piccoli e rumore sostanziale, l’informazione iniziale su un punto dati viene in parte dimenticata nel tempo. Crucialmente, questa amplificazione è più debole rispetto a quanto noto per problemi convessi semplici e non annulla mai completamente il rischio per la privacy.

Cosa significa per utenti e professionisti

Per i non esperti, la conclusione è che nascondere semplicemente la cronologia di addestramento di un modello deep learning non garantisce magicamente una privacy molto più forte. Quando i dati di una persona sono usati molto frequentemente durante l’addestramento, il loro rischio è vicino a quanto predetto dalla teoria conservativa odierna. Una protezione aggiuntiva emerge in regimi più favorevoli — batch piccoli con rumore significativo — ma è modesta e non porta il rischio a zero. Questi risultati convalidano in parte la contabilità della privacy esistente e ne evidenziano i limiti, offrendo un quadro più chiaro e realistico di quanta protezione DP-SGD possa effettivamente fornire quando viene condiviso solo il modello finale.

Citazione: Bhuekar, A. Tighter privacy auditing of differentially private stochastic gradient descent in the hidden state threat model. Sci Rep 16, 8365 (2026). https://doi.org/10.1038/s41598-026-38537-0

Parole chiave: privacy differenziale, DP-SGD, audit della privacy, sicurezza del machine learning, modello a stato nascosto