Clear Sky Science · it

Una rete YOLOv11 migliorata per il rilevamento dei rifiuti marini in ambiente subacqueo

Perché individuare i rifiuti subacquei è importante

Ben al di sotto della superficie oceanica, sacchetti di plastica, bottiglie, lenze e altri detriti si accumulano silenziosamente. Questi rifiuti danneggiano la fauna marina, ostruiscono habitat sensibili e possono perfino interferire con i robot subacquei che gli scienziati usano per studiare e proteggere il mare. L’articolo riassunto qui descrive un sistema di visione artificiale più intelligente che aiuta telecamere e robot a trovare e etichettare automaticamente i rifiuti subacquei in tempo reale, anche in acque torbide e affollate.

La sfida di vedere chiaramente sotto il mare

A differenza delle foto alla luce del giorno sulla terraferma, le immagini subacquee sono spesso scure, nebbiose e tendenti al blu o al verde. La luce si attenua rapidamente con la profondità, sabbia e plancton rendono l’acqua torbida, e i rifiuti sono spesso piccoli, parzialmente nascosti o simili a rocce e piante. I metodi tradizionali di elaborazione delle immagini faticano in queste condizioni, e anche i moderni rilevatori basati sul deep learning possono perdere oggetti piccolissimi o confondere texture di sfondo con detriti. Tuttavia un rilevamento accurato e veloce è cruciale per mappare l’inquinamento, guidare i robot per la bonifica e monitorare come cambiano i rifiuti marini nel tempo.

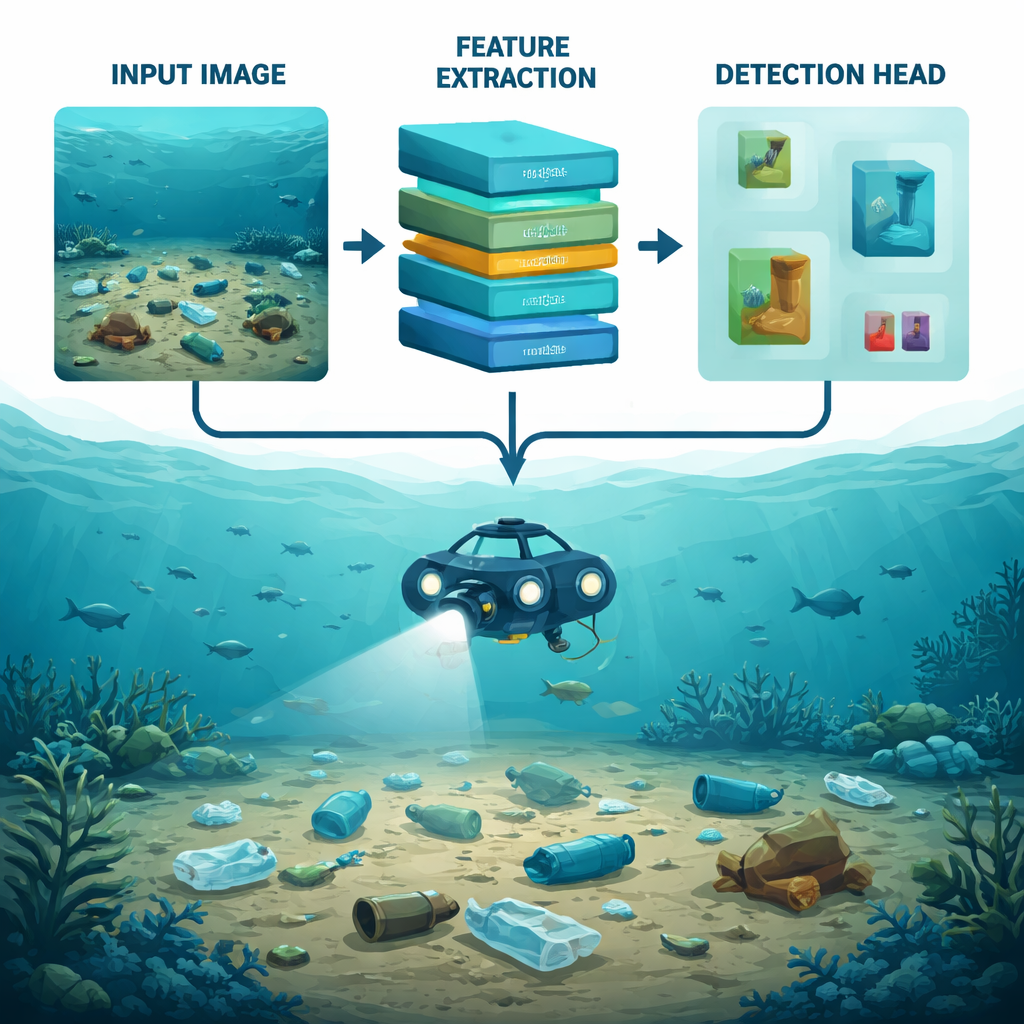

Sviluppare partendo da un cavallo di battaglia della visione

Gli autori si basano su YOLOv11, un recente membro della famiglia “You Only Look Once” di rilevatori di oggetti. I modelli YOLO sono popolari perché esaminano un’immagine una sola volta e predicono in tempo reale le posizioni e le classi di molti oggetti. Tuttavia il design standard di YOLOv11 è stato creato per scene più tipiche, come strade o ambienti interni, non per il mondo visivamente ostile del sott’acqua. Per colmare questa lacuna, i ricercatori ridisegnano due parti chiave della rete: come essa estrae inizialmente i pattern visivi dall’immagine e come successivamente decide quali parti sono oggetti di interesse e quali sono semplicemente rumore di sfondo.

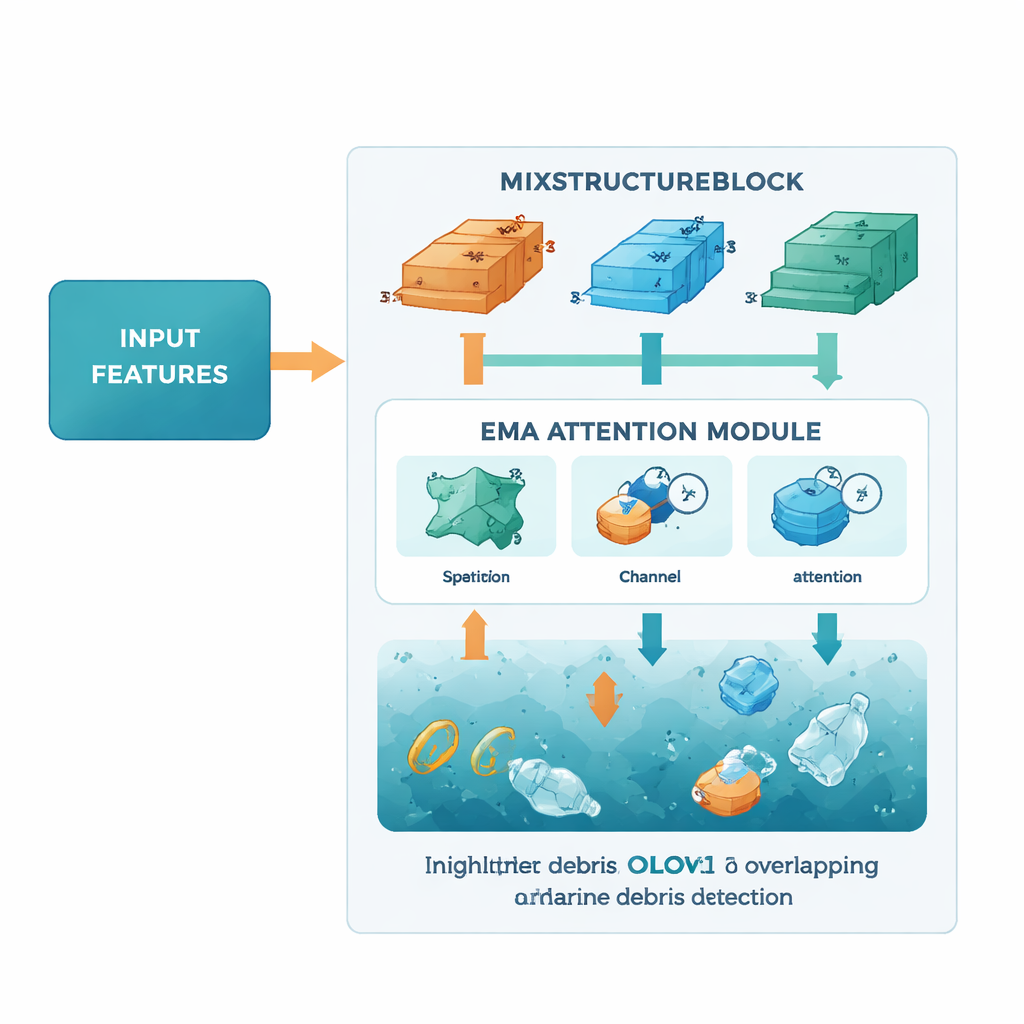

Un nuovo modo di cogliere dettagli a scale diverse

Il primo miglioramento è un modulo chiamato MixStructureBlock, che sostituisce un blocco standard nel backbone di YOLOv11. Invece di usare un unico schema fisso di filtri, il MixStructureBlock esegue diversi rami in parallelo che osservano la scena con diverse “finestre” e spaziature. Questo aiuta la rete a notare sia dettagli minuti, come il bordo di un tappo, sia forme più ampie, come una borsa che galleggia. Inoltre, il blocco include semplici meccanismi di attenzione che imparano a enfatizzare colori e posizioni informative riducendo l’importanza di porzioni di sfondo non utili. Il risultato è un insieme di caratteristiche più ricco e pulito che rende più facile individuare piccoli e sfocati frammenti di detriti.

Insegnare alla rete dove concentrarsi

Il secondo aggiornamento è un modulo Efficient Multi-scale Attention (EMA), aggiunto nelle fasi finali della rete dove si effettuano le rilevazioni. EMA osserva le mappe di feature sia nello spazio sia lungo i canali, ponendo di fatto due domande contemporaneamente: “Dove nell’immagine sta succedendo qualcosa di importante?” e “Quali tipi di pattern sono più rilevanti in questo momento?”. Mettendo in comune informazioni a più scale e usando operazioni matematiche leggere, EMA affina l’attenzione della rete sulle regioni più probabili contenenti rifiuti—come oggetti sovrapposti o elementi poco illuminati lontani dalla camera—mantenendo al contempo il modello compatto e abbastanza veloce per l’uso in tempo reale su hardware embedded.

Mettere il sistema alla prova

Per valutare il progetto, il team ha addestrato e testato il modello su TrashCan, una grande raccolta pubblica di immagini in profondità assemblata in Giappone. Una versione del dataset etichetta i detriti per tipo di oggetto (come bicchiere, busta o tubo di metallo), mentre un’altra raggruppa gli elementi per materiale (come plastica o tessuto). In entrambe le versioni, la rete migliorata supera diversi solidi metodi di riferimento, incluso l’YOLOv11 originale, sistemi precedenti per rifiuti marini e altre varianti YOLO focalizzate sul subacqueo. Non solo rileva più detriti correttamente, soprattutto oggetti piccoli e affollati, ma lo fa con un modello sorprendentemente piccolo di circa 5 megabyte, ben adatto a veicoli subacquei con risorse energetiche limitate.

Cosa significa per oceani più puliti

In termini pratici, lo studio mostra che ripensare con cura il modo in cui un’IA “guarda” le immagini subacquee può fare una differenza reale nel trovare i rifiuti sotto le onde. Combinando l’estrazione di pattern multi-scala con un’attenzione intelligente alle regioni importanti, il sistema proposto individua più detriti restando abbastanza efficiente per l’uso in tempo reale. Installata su sistemi con telecamera e robot subacquei, questa tecnologia potrebbe aiutare scienziati e agenzie ambientali a mappare i punti caldi dell’inquinamento, guidare gli sforzi di pulizia e monitorare l’efficacia delle politiche per ridurre i rifiuti marini—portandoci un passo più vicino a oceani più sani.

Citazione: Yuanwei, J., Yijiang, D., Xuemei, W. et al. An improved YOLOv11 network for marine debris detection in underwater environment. Sci Rep 16, 7074 (2026). https://doi.org/10.1038/s41598-026-38305-0

Parole chiave: rilevamento rifiuti marini, robotica subacquea, rilevamento oggetti, apprendimento profondo, inquinamento oceanico