Clear Sky Science · it

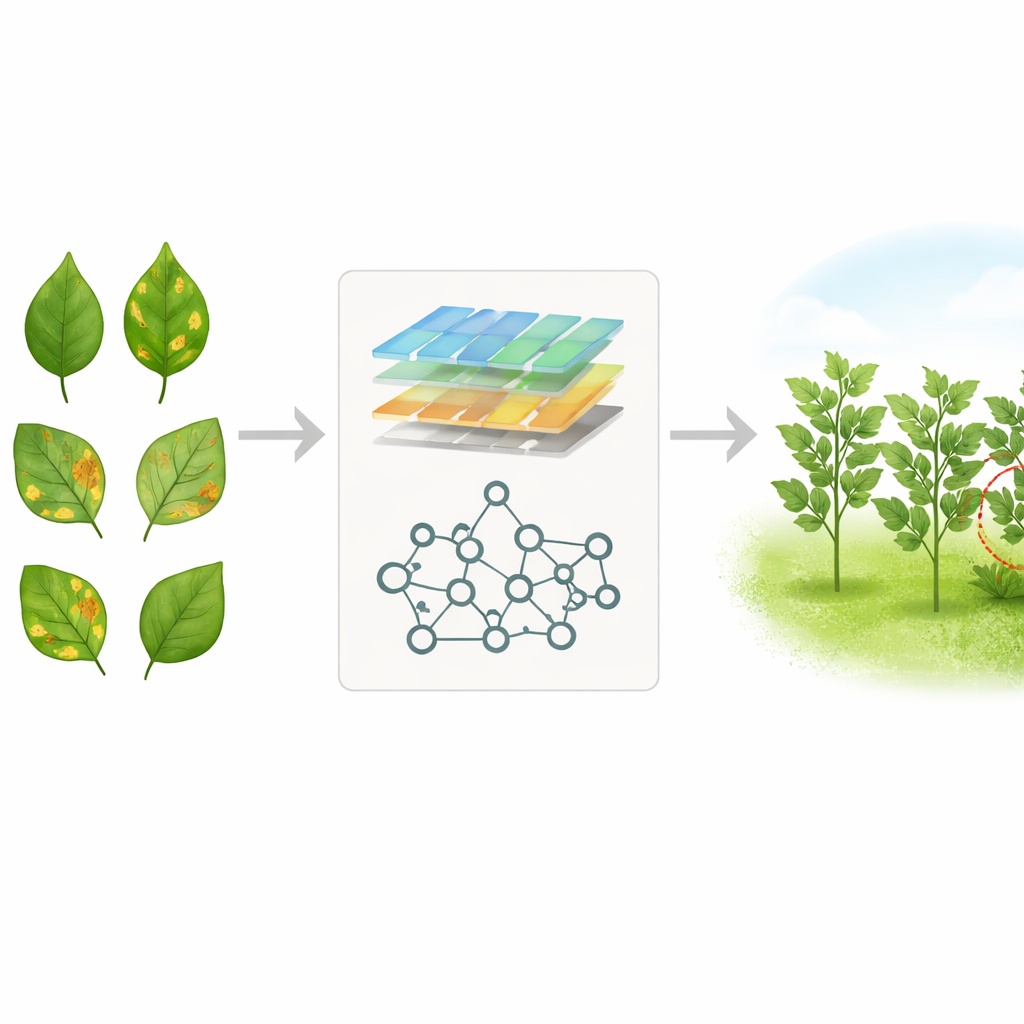

Un framework ibrido di deep learning che utilizza modelli convoluzionali e transformer per una classificazione robusta delle malattie delle piante

Perché individuare le piante malate è importante

Le malattie delle piante distruggono in silenzio una grande parte del cibo prodotto nel mondo ogni anno, riducendo le rese, danneggiando i redditi degli agricoltori e minacciando la sicurezza alimentare. Individuarle precocemente è difficile: i campi sono vasti, gli esperti fitopatologi scarseggiano e molti sintomi sono sottili. Questo articolo esplora come un nuovo tipo di intelligenza artificiale possa imparare a riconoscere dozzine di malattie fogliari da semplici fotografie, offrendo una strada verso strumenti basati su smartphone o fotocamere da campo che aiutino gli agricoltori ad intervenire prima che i problemi si diffondano.

Dalla valutazione umana agli occhi digitali

La diagnosi tradizionale si basa sull’ispezione visiva delle foglie da parte di persone e talvolta sull’invio di campioni a un laboratorio. Questo processo è lento, soggettivo e spesso non disponibile nelle aree rurali. Nell’ultimo decennio i ricercatori hanno addestrato programmi informatici a interpretare immagini di foglie. I sistemi precedenti richiedevano agli ingegneri di progettare a mano indizi visivi, oppure impiegavano modelli di deep learning detti reti neurali convoluzionali, eccellenti nell’analizzare texture, colori e contorni. Questi metodi hanno migliorato l’accuratezza ma hanno ancora difficoltà quando i segni della malattia sono deboli, distribuiti sulla foglia o simili tra patologie diverse. Il nuovo studio indaga se la combinazione di due approcci moderni di IA possa fornire risposte più affidabili in questi casi difficili.

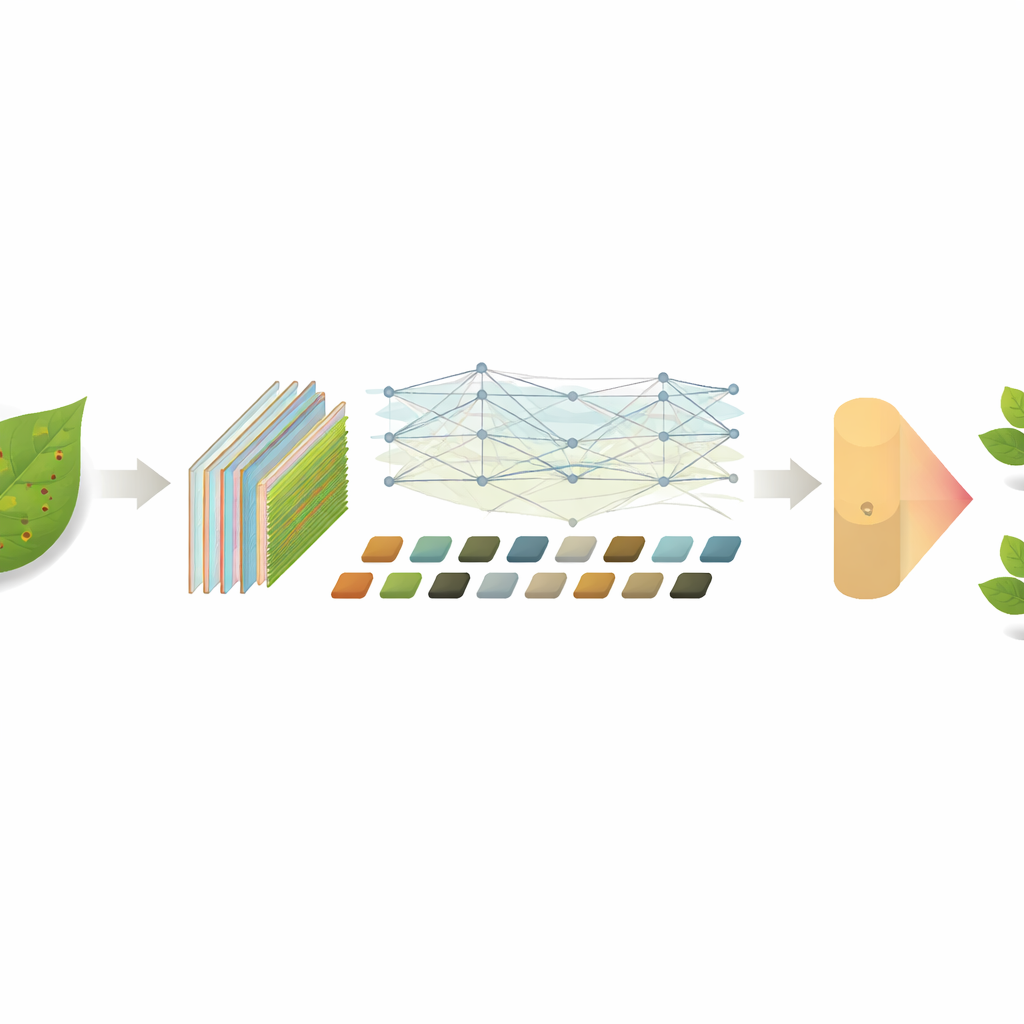

Fondere due modalità di visione

Gli autori costruiscono un sistema ibrido che fonde una rete convoluzionale con un modello di immagini più recente noto come vision transformer. La prima parte, EfficientNet-B7, agisce come una lente d’ingrandimento, scansionando le foto delle foglie per cogliere dettagli fini come piccole macchie, nervature e variazioni di colore. Il suo output viene poi rimodellato e passato a un transformer (ViT-B16), progettato per notare come diverse regioni dell’immagine si relazionano tra loro su lunghe distanze. Trasformando le caratteristiche dettagliate in una serie di piccoli patch e consentendo al transformer di pesare come ogni patch interagisce con le altre, il sistema può comprendere sia le imperfezioni locali sia il motivo complessivo sulla superficie della foglia. Questa combinazione mira a imitare il modo in cui un agronomo esperto osserva da vicino una lesione considerando anche la sua posizione e il contesto circostante.

Addestrare il sistema con migliaia di foglie

Per addestrare e testare il modello, i ricercatori hanno utilizzato una grande raccolta pubblica di 21.534 immagini che rappresentano 38 condizioni differenti, incluse molte malattie e foglie sane provenienti da colture come melo, pomodoro, vite e mais. Hanno standardizzato le foto a una dimensione comune e applicato trucchi digitali — come rotazioni, ribaltamenti e zoom — per simulare le condizioni disordinate dei campi reali. Il modello apprende prima pattern visivi generali da dati di immagini esistenti, quindi viene messo a punto su questa collezione di piante. Durante l’addestramento, il team monitora non solo l’accuratezza complessiva ma anche quanto spesso il sistema identifica correttamente ciascuna malattia e quanto bene evita falsi allarmi, assicurando che le prestazioni reggano sia sulle classi comuni sia su quelle più rare.

Quanto bene funziona l’approccio ibrido

Valutato su immagini mai viste prima, il modello ibrido classifica correttamente lo stato di salute e le malattie delle piante nel 98,13 percento dei casi, mantenendo punteggi elevati su misure rigorose di precisione, richiamo ed equilibrio tra le due. Gestisce sia foglie sane sia patologie difficili, sebbene i sintomi molto precoci restino più impegnativi. Gli autori confrontano il loro sistema con una serie di alternative popolari, incluse reti convolutional standalone, modelli transformer puri, reti leggere per dispositivi mobili, rilevatori veloci come YOLO e strumenti classici come macchine a vettori di supporto e foreste casuali. In questi test testa a testa, l’ibrido si posiziona costantemente al vertice, superando anche forti concorrenti che usano solo EfficientNet o ensemble di più reti.

Cosa significa per le aziende agricole e il cibo

In termini pratici, lo studio dimostra che combinare due «punti di vista» complementari di un’immagine — dettagli locali nitidi e contesto più ampio — può migliorare significativamente il rilevamento automatico delle malattie delle piante. Pur richiedendo al momento foto relativamente chiare e funzionando al meglio su macchine con processori grafici, gli stessi principi di progettazione potrebbero essere adattati in versioni più leggere per smartphone, droni o dispositivi da campo a basso costo. Con il progresso di questi strumenti, gli agricoltori potrebbero ottenere indicazioni rapide e sul posto su cosa attacca le colture e dove, favorendo interventi più precoci, riducendo l’uso di prodotti chimici e rendendo le raccolte più stabili. Per il lettore comune, il messaggio chiave è che fotocamere e algoritmi più intelligenti stanno diventando alleati potenti nella protezione dell’approvvigionamento alimentare mondiale.

Citazione: Jawed, M.M., Tufail, F.A., Ahmed, M.Z. et al. A hybrid deep learning framework using convolutional and transformer models for robust plant disease classification. Sci Rep 16, 9704 (2026). https://doi.org/10.1038/s41598-026-38209-z

Parole chiave: rilevamento delle malattie delle piante, deep learning, vision transformer, agricoltura di precisione, classificazione delle immagini