Clear Sky Science · it

Reti neurali quantistiche ricorrenti diagonali con approccio stabile per l’identificazione di sistemi non lineari

Insegnare alle macchine a comprendere sistemi disordinati

Molti dei sistemi che influenzano la nostra vita — dai motori elettrici negli elettrodomestici al flusso d’aria turbolento e persino alcuni processi medici — si comportano in modi complessi e non lineari. Ciò significa che piccole variazioni negli ingressi possono produrre risposte sorprendentemente grandi o caotiche. Predire e controllare tali sistemi è difficile, ma vitale per efficienza, sicurezza e risparmio energetico. Questo articolo introduce un nuovo tipo di macchina di apprendimento che fonde idee dal calcolo quantistico, dalle reti neurali e dalla teoria della stabilità per modellare questi comportamenti difficili in modo più accurato e affidabile.

Perché i modelli ordinari non bastano

Gli strumenti di modellazione tradizionali spesso presuppongono che causa ed effetto siano ordinati e proporzionali, ipotesi che funzionano bene per sistemi semplici o quasi lineari. Ma molti sistemi reali hanno memoria, retroazione e soglie che rendono il loro comportamento altamente non lineare. Le reti neurali classiche hanno aiutato, tuttavia presentano problemi propri. Le reti feed-forward, in cui l’informazione viaggia in una sola direzione, sono efficaci per compiti statici ma faticano quando i segnali passati contano. Le reti ricorrenti, che rimandano l’informazione su se stesse per creare memoria, possono catturare comportamenti variabili nel tempo ma tendono a essere difficili da addestrare, soggette a instabilità e computazionalmente onerose quando ogni neurone comunica con tutti gli altri.

Fondere idee quantistiche con loop semplici

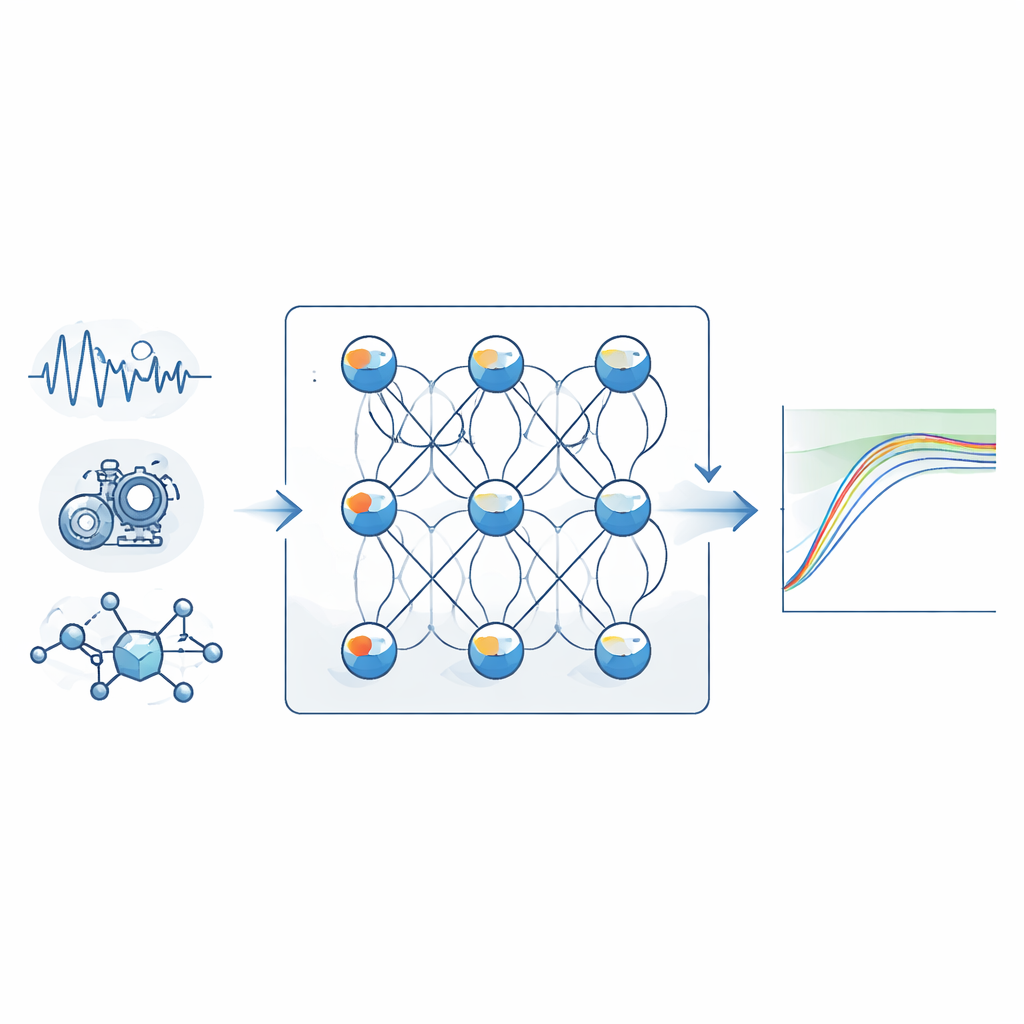

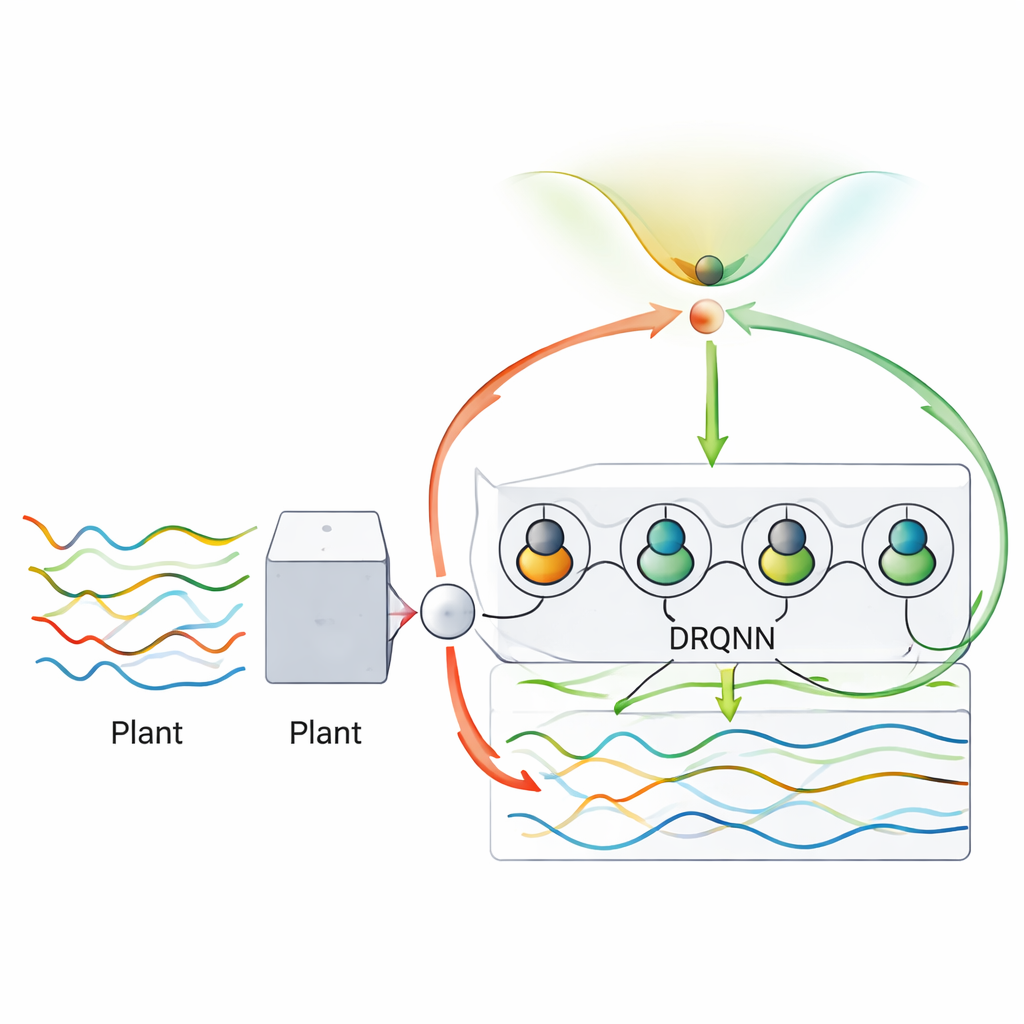

Gli autori propongono una rete neurale quantistica ricorrente diagonale con stabilità di Lyapunov, abbreviata DRQNN-LS. Nella sua essenza, questa rete conserva l’aspetto familiare di una rete a tre strati: ingressi, uno strato nascosto e un’uscita. Ma due accorgimenti la rendono speciale. Primo, le unità nascoste si comportano come bit quantistici semplificati, i cui stati interni sono descritti usando quantità di tipo fase piuttosto che numeri semplici. Questa rappresentazione ispirata alla meccanica quantistica permette a ogni unità di codificare informazioni più ricche in modo compatto, migliorando la capacità della rete di approssimare relazioni complesse. Secondo, invece di una matassa di collegamenti di retroazione, ogni neurone nascosto retroagisce solo su se stesso. Questa ricorrenza “diagonale” conserva la memoria necessaria per seguire schemi variabili nel tempo riducendo drasticamente il numero di connessioni da ottimizzare.

Mantenere l’apprendimento stabile e sotto controllo

Una sfida principale nell’addestramento di qualsiasi rete ricorrente è mantenere stabile l’apprendimento: se i pesi cambiano troppo aggressivamente, l’output del modello può esplodere o oscillare; se cambiano troppo lentamente, l’addestramento richiede tempi lunghi e può bloccarsi. Qui gli autori fanno affidamento sulla teoria della stabilità di Lyapunov, un quadro matematico sviluppato originariamente per analizzare la sicurezza dei sistemi fisici. Costruiscono una particolare funzione simile all’energia che combina l’errore di modellazione e l’entità dei parametri della rete. Derivando con cura come questa funzione evolve nel tempo, ottengono regole automatiche per aggiornare i pesi e i parametri interni in modo che l’“energia” complessiva possa solo diminuire. Questo produce tassi di apprendimento adattivi che accelerano o rallentano da soli, garantendo la convergenza senza aggiustamenti manuali.

Mettere alla prova la nuova rete

Per dimostrare che DRQNN-LS è più di una bella idea teorica, gli autori la testano su tre compiti molto diversi. Primo, modellano un sistema non lineare matematico con comportamento noto, verificando quanto la rete riesca a seguire il suo output. Secondo, si confrontano con la mappa caotica di Henon, un benchmark classico dove piccole variazioni nelle condizioni iniziali possono produrre traiettorie estremamente diverse. Terzo, applicano il metodo a dati reali provenienti da un piccolo motore a corrente continua, un dispositivo pratico e rumoroso i cui funzionamenti interni non sono completamente noti. In ogni caso confrontano il nuovo approccio con diversi modelli neurali esistenti, incluse reti ricorrenti diagonali classiche e versioni precedenti ispirate alla quantistica addestrate con regole di gradiente più semplici.

Maggiore accuratezza, robustezza e tolleranza al rumore

In tutti e tre gli esempi, la DRQNN-LS produce costantemente errori di previsione più bassi e un migliore adattamento ai segnali veri rispetto ai metodi concorrenti, anche quando i dati sono deliberatamente corrotti da rumore significativo. Sebbene il nuovo modello richieda un po’ più di calcolo per passo — perché segue stati ricorrenti ispirati alla quantistica e valuta l’aggiornamento basato su Lyapunov — i tempi di esecuzione restano abbastanza contenuti per l’uso in tempo reale su processori moderni. I risultati suggeriscono che combinare una struttura ricorrente snella, stati neurali in stile quantistico e un apprendimento stabilmente garantito matematicamente fornisce uno strumento potente e pratico per comprendere e prevedere dinamiche non lineari nel mondo reale.

Cosa significa questo per il futuro

Per i non specialisti, il messaggio è che stiamo imparando a costruire doppi digitali più intelligenti e affidabili di sistemi fisici disordinati. DRQNN-LS offre un modo per permettere a una macchina di apprendere il comportamento di un processo complesso direttamente dai dati, assicurando che il suo apprendimento non “esploda” o si discosti in modo imprevedibile. Questa combinazione di flessibilità e stabilità potrebbe rivelarsi preziosa in campi che vanno dal controllo industriale e dalla robotica ai sistemi energetici e forse anche alla modellazione biologica o medica, dove il comportamento non lineare e le misure rumorose sono la norma.

Citazione: Khalil, H., Elshazly, O. & Shaheen, O. Stable approach based diagonal recurrent quantum neural networks for identification of nonlinear systems. Sci Rep 16, 8274 (2026). https://doi.org/10.1038/s41598-026-37973-2

Parole chiave: identificazione di sistemi non lineari, rete neurale quantistica, rete neurale ricorrente, stabilità di Lyapunov, modellazione di dinamiche caotiche