Clear Sky Science · it

Un framework di deep learning per la diagnosi del cancro al seno usando Swin Transformer e Dual‑Attention Multi‑scale Fusion Network

Perché è importante per pazienti e medici

Il cancro al seno è uno dei tumori più diffusi tra le donne e la mammografia è lo strumento principale per individuarlo precocemente. Tuttavia l’interpretazione di queste immagini a raggi X è difficile, anche per gli esperti, e i piccoli segnali d’allarme possono sfuggire. Questo studio presenta un nuovo sistema di intelligenza artificiale (IA) progettato per aiutare i radiologi a individuare il cancro al seno in modo più affidabile, combinando due modi potenti di “guardare” le mammografie: uno che coglie il quadro d’insieme e uno che ingrandisce i dettagli più minuti.

La sfida di vedere insieme la foresta e gli alberi

I sistemi di IA moderni già supportano la lettura delle immagini mediche, ma la maggior parte si basa su un unico tipo di modello. Le reti neurali convoluzionali sono abili nel riconoscere pattern locali, come bordi netti o piccole macchie luminose. I vision transformer, una famiglia di modelli più recente, eccellono nel comprendere le relazioni su tutta l’immagine. Le mammografie, però, richiedono entrambe le capacità: il cancro può manifestarsi come minuscole calcificazioni o sottili distorsioni, il cui significato dipende da come questi segni si inseriscono nella struttura complessiva del seno. Allo stesso tempo, i dataset di mammografia reali sono relativamente piccoli e spesso sbilanciati, con molti meno casi di tumore rispetto agli esami normali, il che rende facile per i modelli sovra‑adattarsi o sviluppare bias.

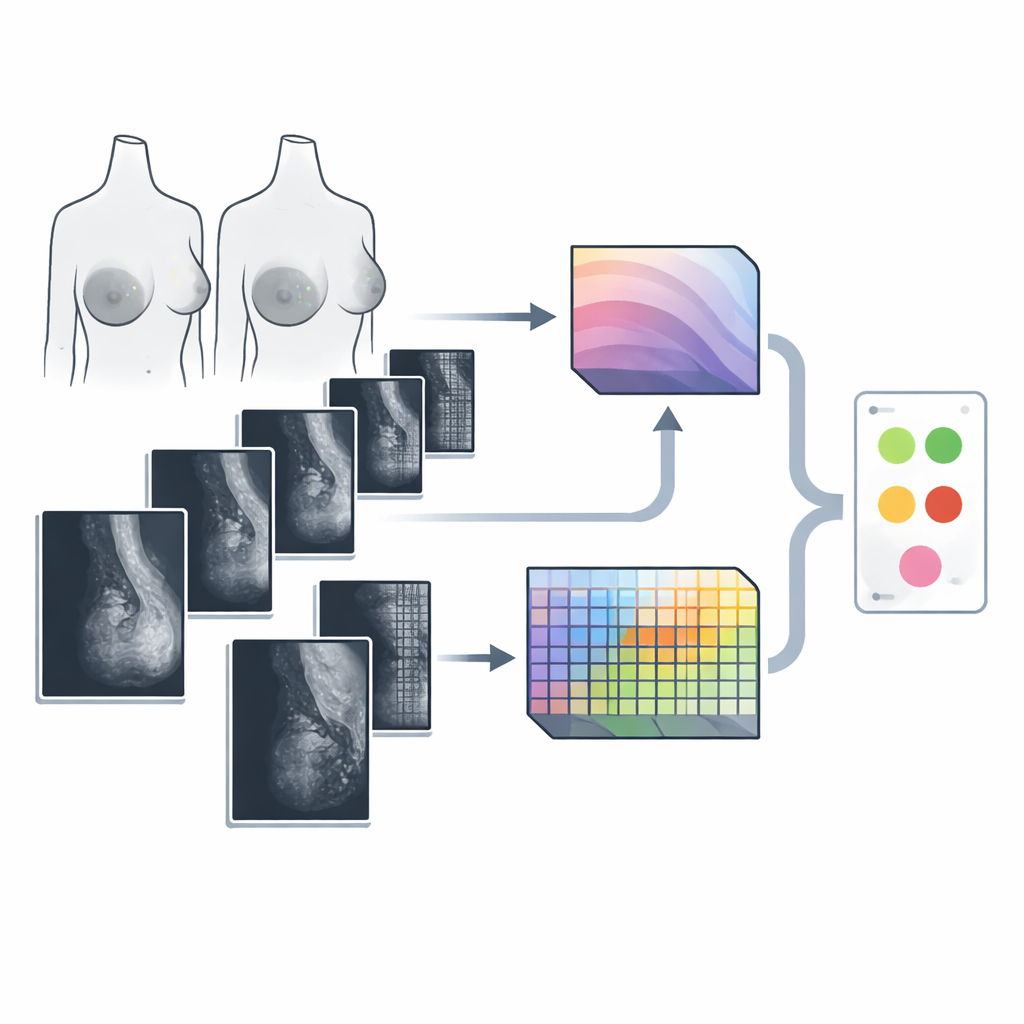

Un’IA a doppio binario che guarda in ampiezza e in profondità

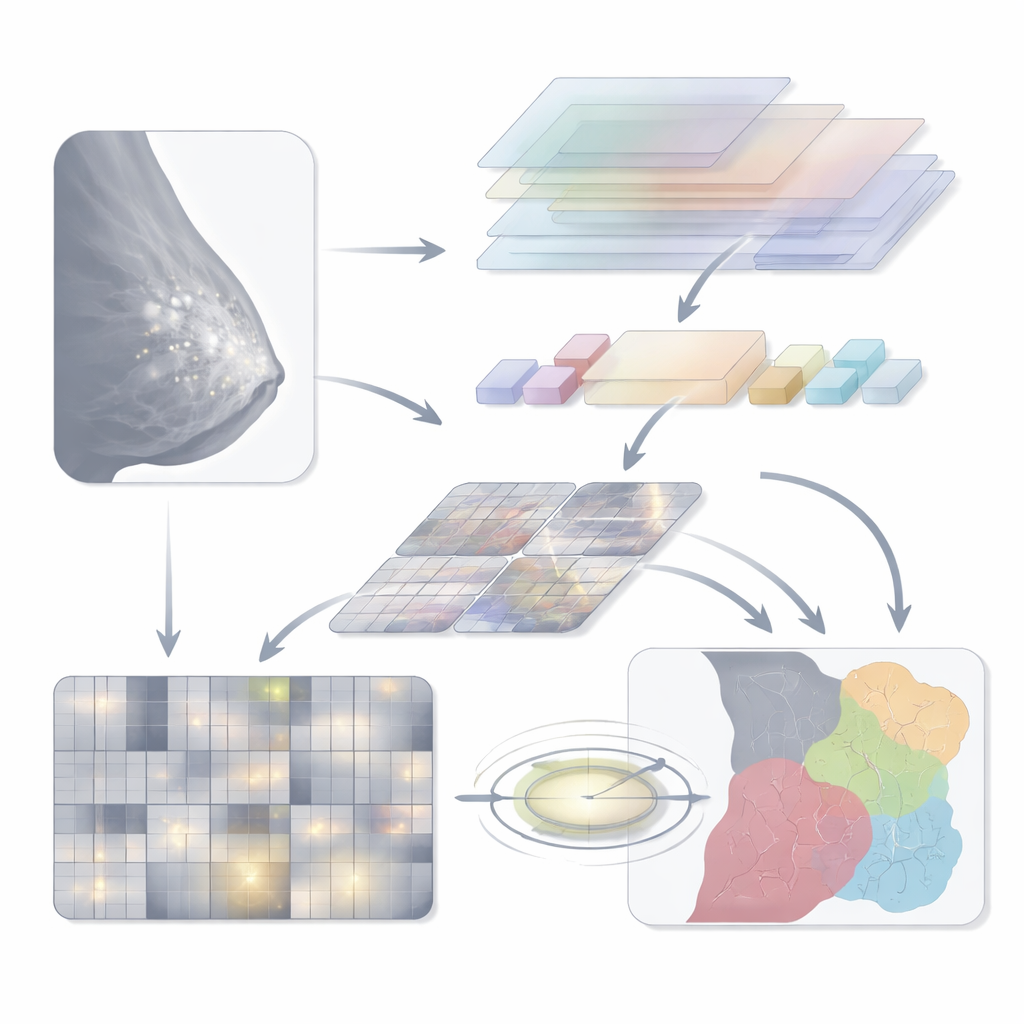

Gli autori introducono un modello ibrido chiamato Swin‑DAMFN, costruito esplicitamente per fondere visione globale e locale. Un ramo si basa sul Swin Transformer, che divide la mammografia in finestre e utilizza un meccanismo di attenzione per catturare il contesto a lungo raggio—come le diverse parti del seno si relazionano tra loro. Il secondo ramo è una rete convoluzionale personalizzata, la Dual‑Attention Multi‑scale Fusion Network (DAMFN). Questo ramo è ottimizzato per cogliere dettagli estremamente fini come le microcalcificazioni e lievi distorsioni del tessuto. Al suo interno, blocchi specializzati analizzano l’immagine a più scale e direzioni, quindi moduli di attenzione enfatizzano le regioni clinicamente più informative attenuando il tessuto di sfondo.

Insegnare al sistema con più immagini e più ricche

Poiché i dataset di mammografia reali sono limitati e sbilanciati verso i casi non maligni, i ricercatori hanno rafforzato i dati di addestramento in due modi complementari. Innanzitutto hanno usato un tipo di modello generativo chiamato GAN condizionale per sintetizzare patch mammografiche realistiche, in particolare per le categorie maligne sottorappresentate. Queste immagini generate aiutano a bilanciare le classi ed espongono il modello a maggiori variazioni dell’aspetto della malattia. In secondo luogo, hanno applicato variazioni fotometriche—piccole regolazioni casuali di luminosità, contrasto e nitidezza—a immagini reali e sintetiche. Questo costringe l’IA a concentrarsi sui veri pattern anatomici piuttosto che su illuminazione superficiale o rumore, migliorando la sua capacità di generalizzare a nuove scansioni.

Come i componenti cooperano durante la diagnosi

Durante l’analisi, una mammografia preprocessata viene immessa simultaneamente in entrambi i rami. Il Swin Transformer produce un riassunto compatto della struttura globale, mentre DAMFN restituisce una mappa ricca di feature locali. Queste vengono quindi allineate nelle dimensioni e fuse in una singola rappresentazione. Un blocco leggero di “triplet attention” affina ulteriormente questa fusione controllando incroci tra canali e dimensioni spaziali, orientando l’attenzione del modello verso le aree più probabilmente affette da patologia. Infine, una semplice testa di classificazione media l’informazione e produce una previsione su più classi, come tessuto normale, reperti benigni o diversi tipi di lesioni maligne.

Cosa significano i risultati nella pratica

Il team ha testato Swin‑DAMFN su due dataset pubblici largamente usati, CBIS‑DDSM e MIAS, e lo ha confrontato con molti popolari modelli di deep learning. Il sistema ha raggiunto circa il 99% di accuratezza su CBIS‑DDSM e quasi il 99% su MIAS, con sensibilità (capacità di rilevare i tumori) e specificità (evitare falsi allarmi) altrettanto elevate. Studi di ablazione accurati hanno dimostrato che ogni componente—i due rami, la fusione basata su attenzione e la strategia di data augmentation—ha contribuito a questi miglioramenti. Pur riconoscendo che sono necessari test più ampi su dati ospedalieri diversi, i risultati suggeriscono che sistemi ibridi come Swin‑DAMFN potrebbero diventare assistenti preziosi nello screening del cancro al seno, aiutando i radiologi a rilevare lesioni pericolose prima e in modo più coerente, riducendo carico di lavoro e incertezza.

Citazione: Aldawsari, M.A., Aldosari, S.J., Ismail, A. et al. A deep learning framework for breast cancer diagnosis using Swin Transformer and Dual-Attention Multi-scale Fusion Network. Sci Rep 16, 8941 (2026). https://doi.org/10.1038/s41598-026-37969-y

Parole chiave: cancro al seno, mammografia, deep learning, modelli transformer, IA per imaging medico