Clear Sky Science · it

Rilevamento di oggetti in tempo reale per veicoli aerei senza pilota basato su vision transformer e edge computing

Occhi più intelligenti nel cielo

I veicoli aerei senza pilota — i droni — stanno rapidamente diventando strumenti di uso quotidiano per attività come l'ispezione dei ponti, il monitoraggio del traffico e la ricerca di persone scomparse. Ma perché un drone sia davvero utile in compiti a tempo critico, deve fare più che filmare: deve riconoscere oggetti piccoli in tempo reale mentre vola con una batteria limitata e un piccolo computer di bordo. Questo articolo presenta un nuovo approccio per fornire ai droni “occhi” più acuti e più veloci combinando una tecnica avanzata di intelligenza artificiale chiamata vision transformer con l'uso intelligente di computer edge vicini, in modo che piccoli oggetti come pedoni, biciclette e automobili possano essere individuati rapidamente e in modo affidabile dall'alto.

Perché i droni faticano a vedere i dettagli piccoli

Dall'alto, persone e veicoli possono ridursi a poche decine di pixel in un fotogramma video. I tradizionali sistemi a reti neurali usati sui droni sono progettati per girare velocemente su chip a basso consumo, ma spesso non riescono a individuare questi oggetti minuscoli o falliscono quando cambiano illuminazione o angolazione. I più recenti modelli vision transformer, presi in prestito dal mondo dell'elaborazione del linguaggio, sono molto migliori nel comprendere l'intera scena contemporaneamente e nel estrarre dettagli minuti da sfondi affollati. Il problema è che di solito richiedono una potenza di calcolo enorme, ben oltre ciò che una piattaforma volante può trasportare. Gli autori mirano a colmare questo divario: conservare la visione acuta del transformer, ma snellirla quanto basta per funzionare in tempo reale su un drone, e scaricare lavoro extra a un server edge vicino solo quando le condizioni lo permettono.

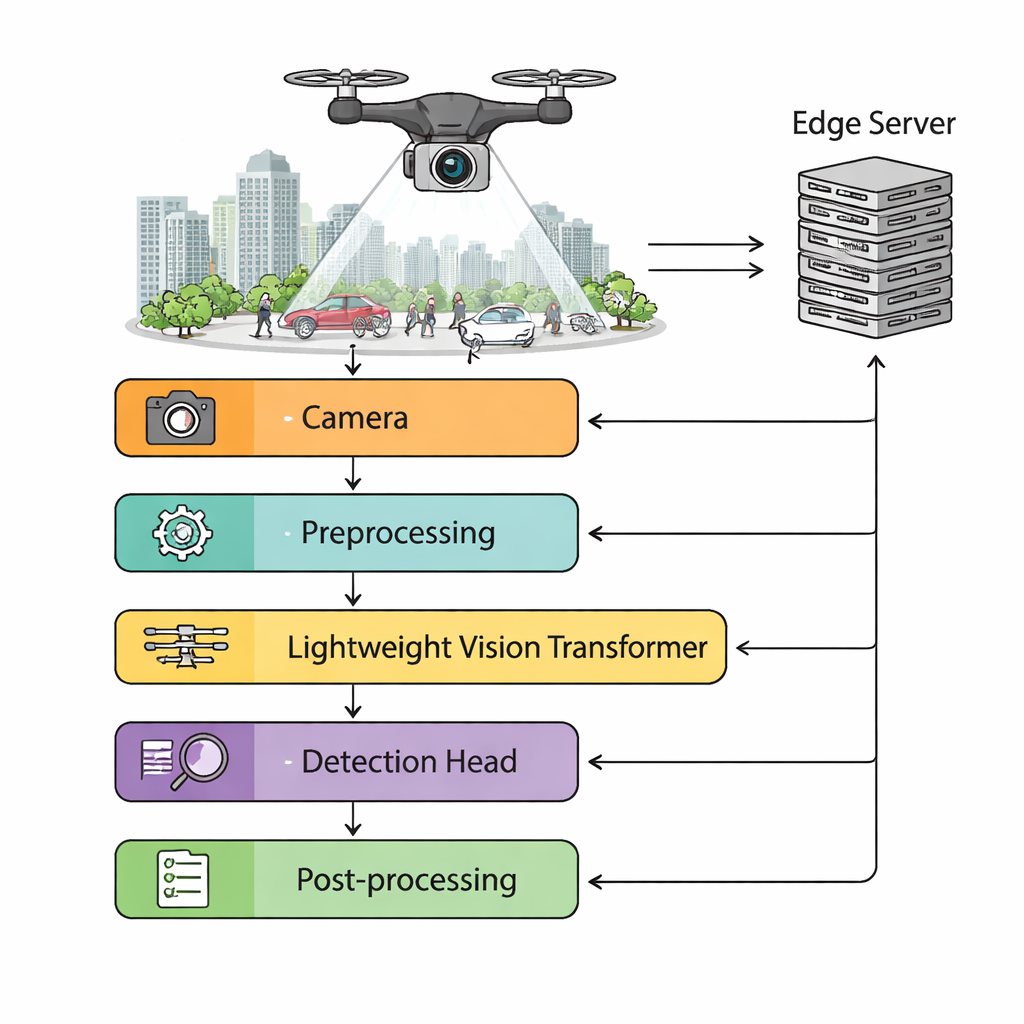

Un cervello diviso: drone ed edge che lavorano insieme

Il framework proposto divide il lavoro tra il drone e un computer edge a terra. La videocamera del drone trasmette video ad alta definizione a un modulo di pre‑elaborazione di bordo che stabilizza le riprese mosse, regola la luminosità e ridimensiona dinamicamente le immagini a seconda della potenza di calcolo disponibile. Un vision transformer leggero estrae quindi caratteristiche ricche da ogni fotogramma, alimentando una testa di rilevamento che predice dove sono gli oggetti e cosa sono. Un scheduler monitora il ritardo della rete wireless, il livello della batteria e il carico di elaborazione. Quando il collegamento con il terreno è veloce e stabile, compiti più pesanti — come l'elaborazione a batch dei fotogrammi o l'esecuzione di modelli aggiuntivi per migliorare l'accuratezza — possono essere spostati al server edge. Quando la connessione degrada, il sistema passa automaticamente alla elaborazione completamente autonoma a bordo in modo che il drone non debba mai “volare alla cieca”.

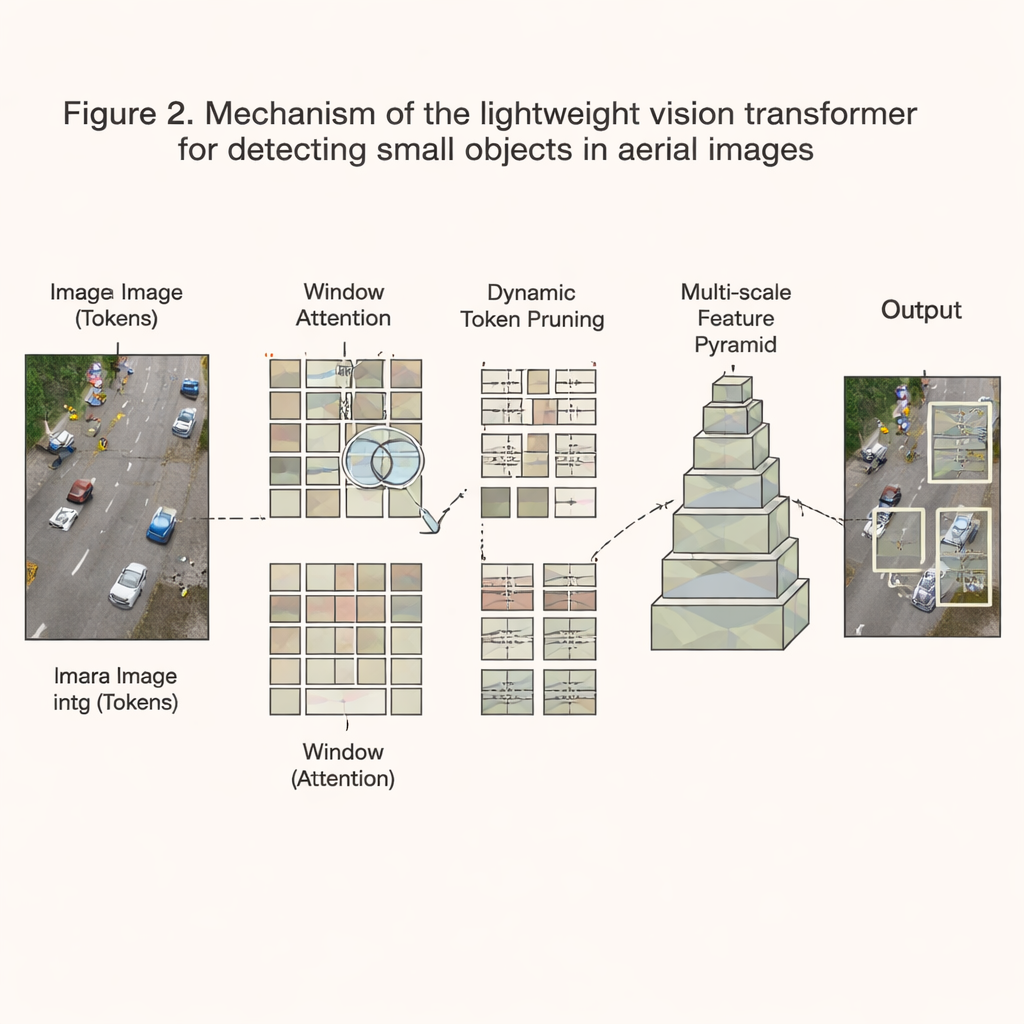

Snellire il modello senza perdere la vista

Per rendere il transformer abbastanza piccolo e veloce, gli autori rivedono il suo funzionamento interno. Invece di permettere a ogni parte dell'immagine di confrontarsi con ogni altra — un processo che cresce in modo esplosivo con la risoluzione — limitano l'attenzione a finestre locali che scorrono sull'immagine, portando il costo computazionale a livelli più gestibili. Inoltre, uno schema di potatura dinamica valuta costantemente quali regioni dell'immagine contengono informazioni utili e quali sono per lo più sfondo vuoto. I token giudicati poco informativi vengono scartati precocemente, risparmiando tempo e memoria, mentre scene complesse e affollate mantengono più dettagli. Il modello costruisce anche una piramide multiscala di caratteristiche in modo che sia i pedoni minuscoli sia i veicoli più grandi possano essere rilevati nello stesso fotogramma. Unitamente a una quantizzazione attenta (usando meno bit per numero), alla potatura dei canali e a ottimizzazioni software di basso livello, questi cambiamenti riducono i calcoli richiesti di circa due terzi pur preservando oltre il 94% dell'accuratezza originale.

Mettere il sistema alla prova

Il team valuta il loro progetto su un ampio dataset aereo assemblato da benchmark pubblici per droni e da migliaia di immagini recentemente raccolte su città, sobborghi e aree rurali in diverse stagioni e condizioni di illuminazione. Su un popolare computer embedded usato nei droni, la NVIDIA Jetson Xavier NX, il loro sistema gira a circa 39 fotogrammi al secondo — abbastanza veloce per l'operazione in tempo reale — ottenendo al contempo un'accuratezza superiore rispetto a diffusori leggeri ampiamente utilizzati come le varianti di YOLO. In particolare, è significativamente migliore nell'individuare oggetti piccoli, con un guadagno di circa sette punti percentuali nella precisione media rispetto alle tradizionali reti convoluzionali. Prove sul campo della durata di una settimana su una piattaforma commerciale per droni mostrano che il sistema mantiene le prestazioni nonostante vibrazioni della camera, variazioni di illuminazione e fluttuazioni della connettività wireless, e che può passare agevolmente tra modalità assistita dall'edge e completamente a bordo durante i voli reali.

Cosa significa questo per le missioni reali dei droni

In termini pratici, questo lavoro dimostra che è possibile fornire ai droni una visione più nitida e affidabile senza dover montare su di essi un computer di livello data center. Ridisegnando il vision transformer per renderlo snello, concentrandosi selettivamente sulle parti più informative di ogni immagine e affiancando il drone a un server edge vicino quando possibile, gli autori forniscono un rilevatore che vede di più, sbaglia di meno e funziona comunque in tempo reale entro vincoli stretti di potenza e memoria. Ciò rende attività come ricerca e soccorso, valutazione dei disastri e ispezione delle infrastrutture più sicure ed efficaci, perché i droni possono individuare meglio dettagli piccoli e critici — come una persona in difficoltà o un cavo danneggiato — proprio quando ogni secondo conta.

Citazione: Zhu, W., Chen, K. Real-time object detection for unmanned aerial vehicles based on vision transformer and edge computing. Sci Rep 16, 6814 (2026). https://doi.org/10.1038/s41598-026-37938-5

Parole chiave: droni, rilevamento oggetti, edge computing, vision transformer, immagine in tempo reale