Clear Sky Science · it

Quadro di apprendimento per rinforzo adattivo per l'ottimizzazione di microreti sostenibili in ambienti urbani aridi

Mantenere le luci accese in una città del deserto

Immaginate di gestire una città moderna dove nelle giornate estive le temperature superano regolarmente i 40 °C, i condizionatori funzionano ininterrottamente e le linee elettriche sono sollecitate oltre misura. Questa è la vita quotidiana in luoghi come Riad, Arabia Saudita. Questo articolo esplora come un nuovo tipo di sistema di controllo intelligente, ispirato al modo in cui i computer imparano a giocare a videogiochi complessi, possa coordinare pannelli solari, turbine eoliche, batterie, gruppi elettrogeni diesel e la rete principale per alimentare una città di questo tipo a costi inferiori e con meno inquinamento.

Perché le piccole reti elettriche sono importanti

Invece di fare affidamento solo su grandi centrali lontane, molte città si stanno orientando verso le “microreti”: piccole reti locali che combinano diverse fonti energetiche e possono persino scambiare energia con i vicini. Nelle regioni calde e aride questo è particolarmente importante: la domanda per il raffrescamento fluttua fortemente con il clima, l’energia solare arriva a raffiche durante il giorno e il vento può essere debole o imprevedibile. I sistemi di controllo tradizionali tendono a seguire regole o programmi fissi. Non sono molto bravi a reagire a cambiamenti improvvisi, come un picco nell’uso dei condizionatori o una giornata di polvere che oscura il sole. Il risultato è energia pulita sprecata, più combustibile bruciato nei generatori diesel e bollette più alte.

Un cervello che impara per il sistema elettrico

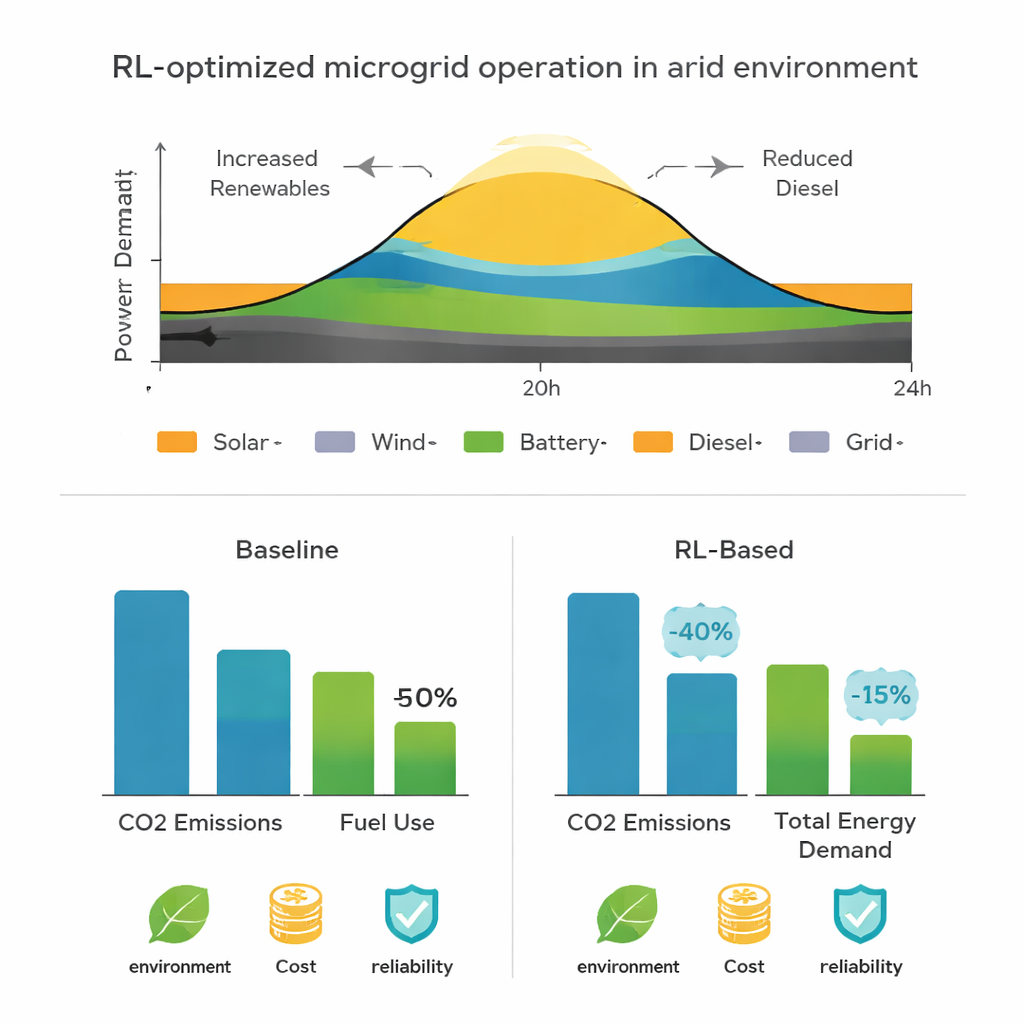

I ricercatori hanno costruito un modello informatico dettagliato di cinque microreti interconnesse che rappresentano edifici e quartieri tipici di Riad—case grandi e piccole, isolati a uso misto e aree commerciali. Ogni microrete aveva la propria combinazione di pannelli solari, piccole turbine eoliche, gruppo diesel di riserva e accumulo a batteria, oltre a un collegamento alla rete elettrica più ampia. Utilizzando software per l’energia negli edifici (EnergyPlus), hanno generato dati ora per ora per un intero anno: quanta energia usavano le persone, quanto faceva caldo, quanto era intenso il sole e quanto soffiava il vento. Su questa base hanno aggiunto un “agente” di apprendimento per rinforzo—un cervello software che osserva lo stato del sistema (domanda, carica delle batterie, disponibilità di sole e vento, stato dei generatori) e decide cosa fare: caricare o scaricare le batterie, accendere o spegnere i diesel, importare o esportare energia e condividere energia tra le microreti.

Come il sistema impara a fare scelte migliori

L’apprendimento per rinforzo funziona per tentativi ed errori. Nella simulazione, l’agente prova diverse azioni di controllo ora per ora e riceve una ricompensa o una penalità in base a quello che succede. La ricompensa combina tre idee semplici: mantenere bassi i costi, tenere accese le luci ed evitare di sprecare o ignorare l’energia rinnovabile. Se le sue decisioni portano a un uso costoso del diesel, a carenze di energia o a energia solare inutilizzata, l’agente viene penalizzato. Se riesce a soddisfare la domanda con più sole e vento, meno emissioni e funzionamento stabile, viene ricompensato. In decine di migliaia di cicli di addestramento, l’agente scopre gradualmente strategie che bilanciano questi obiettivi. Una volta addestrato, può prendere decisioni in tempo reale in pochi millesimi di secondo.

Cosa succede quando il deserto contrattacca

Per verificare se questo approccio potesse davvero aiutare in un clima severo, il team lo ha testato in condizioni realistiche e stressanti. Il modello ha riprodotto le oscillazioni stagionali di Riad, con un forte raffrescamento in estate e carichi più miti in inverno. Il controllore basato sull’apprendimento ha seguito accuratamente sia i consumi orari sia quelli annuali (spiegando circa il 90–94% della variazione), cosa cruciale per prevedere i picchi. Ha ridotto le perdite energetiche su una giornata tipica e ha spostato una parte maggiore dell’offerta verso solare ed eolico, usando le batterie per livellare i gap. Quando i ricercatori hanno simulato eventi come una tempesta di polvere che taglia improvvisamente il solare o un’ondata di calore che aumenta bruscamente la domanda, il sistema ha risposto scaricando le batterie, coordinando l’uso dei diesel e condividendo l’energia in eccesso tra le microreti—tutto senza interrompere gli utenti.

Aria più pulita e bollette più basse

Oltre a mantenere il flusso di energia, lo studio ha esaminato l’impatto ambientale usando una valutazione del ciclo di vita focalizzata sull’operazione giorno per giorno. Rispetto a una configurazione tradizionale basata su regole, il sistema adattivo ha ridotto le emissioni di anidride carbonica di circa il 14%, ha diminuito l’inquinamento formatore di acidità di circa il 14% e ha abbassato il consumo energetico totale di circa il 10%. Questi miglioramenti derivano principalmente dal minor funzionamento dei generatori diesel e da un migliore sfruttamento delle energie rinnovabili locali e dell’accumulo. In termini semplici, dotare la microrete di un cervello che apprende le ha permesso di ottenere più lavoro utile da ogni unità di energia pulita, dipendere meno dai combustibili e restare affidabile anche quando il clima desertico si comporta in modo imprevedibile.

Citazione: Mohamed, M.A.S., Almazam, K., Alzahrani, M. et al. Adaptive reinforcement learning framework for sustainable microgrid optimization in arid urban environments. Sci Rep 16, 7356 (2026). https://doi.org/10.1038/s41598-026-37752-z

Parole chiave: microreti, apprendimento per rinforzo, energie rinnovabili, gestione dell'energia, città aride