Clear Sky Science · it

Pianificazione autonoma del percorso per imaging ecografico intercostale robotico mediante apprendimento per rinforzo

I robot che aiutano i medici a vedere attraverso le costole

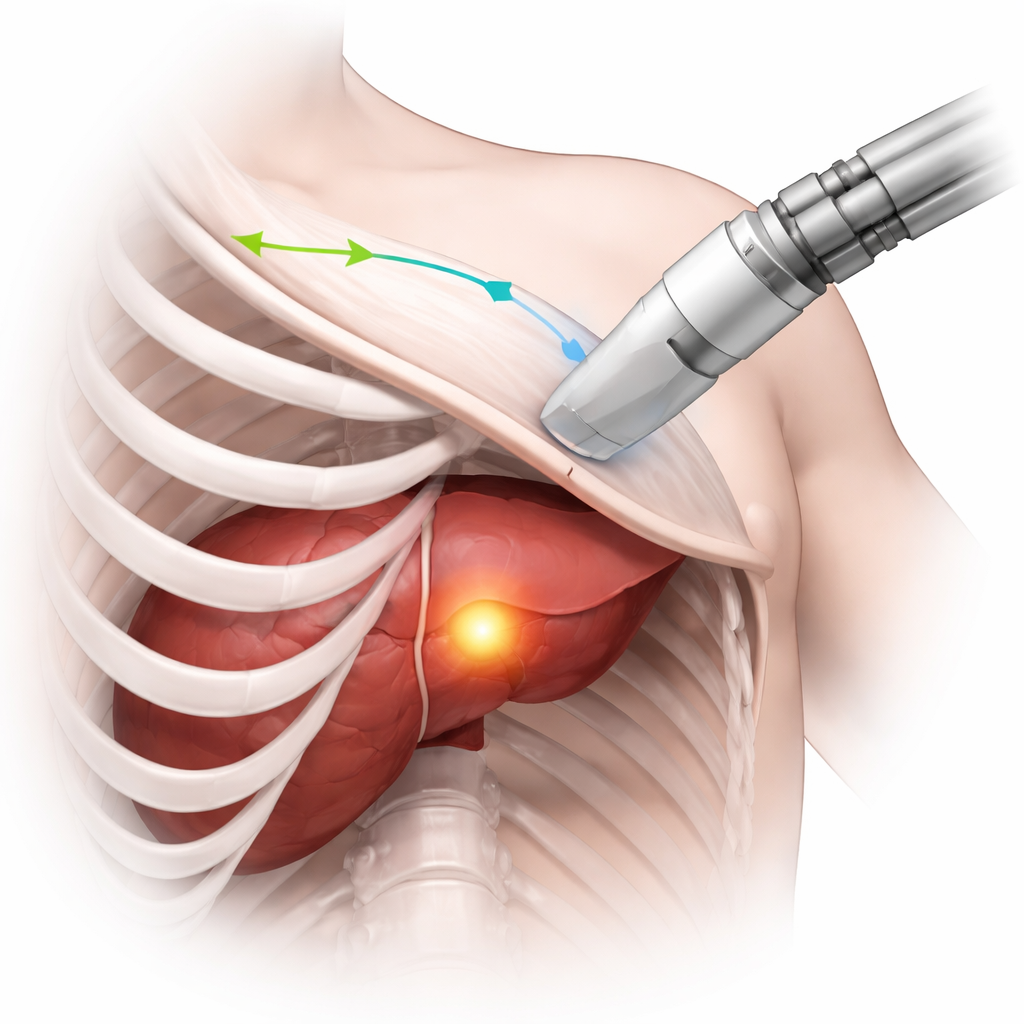

Quando i medici usano l’ecografia per monitorare organi come il fegato o il cuore, le costole spesso ostacolano la vista, proiettando ombre che nascondono dettagli critici. Ottenere un’immagine nitida dipende molto dall’abilità e dall’esperienza di chi tiene la sonda. Questo studio esplora come un robot, guidato dall’intelligenza artificiale, possa pianificare automaticamente un percorso di scansione ecografica tra le costole in modo che i tumori e altri bersagli siano visibili in modo chiaro e coerente, indipendentemente dall’operatore.

Perché è così difficile vedere tra le costole

L’ecografia è popolare perché è sicura, economica e fornisce immagini in tempo reale. Ma per visualizzare organi nascosti dietro la gabbia toracica, la sonda deve essere guidata con cura attraverso gli stretti spazi tra le costole. Se le onde sonore colpiscono l’osso, vengono bloccate, creando ampie regioni nere nell’immagine dove non si vede nulla. Gli operatori umani imparano, con addestramento ed esperienza, come angolare e muovere la sonda per evitare queste ombre mantenendo in vista l’area d’interesse. Questo è particolarmente importante in procedure come l’ablazione di tumori epatici, dove i chirurghi devono controllare ripetutamente che l’intero tumore sia stato trattato. La sfida è trasformare questa abilità delicata e tridimensionale in qualcosa che un robot possa eseguire autonomamente.

Insegnare a un robot con pazienti virtuali

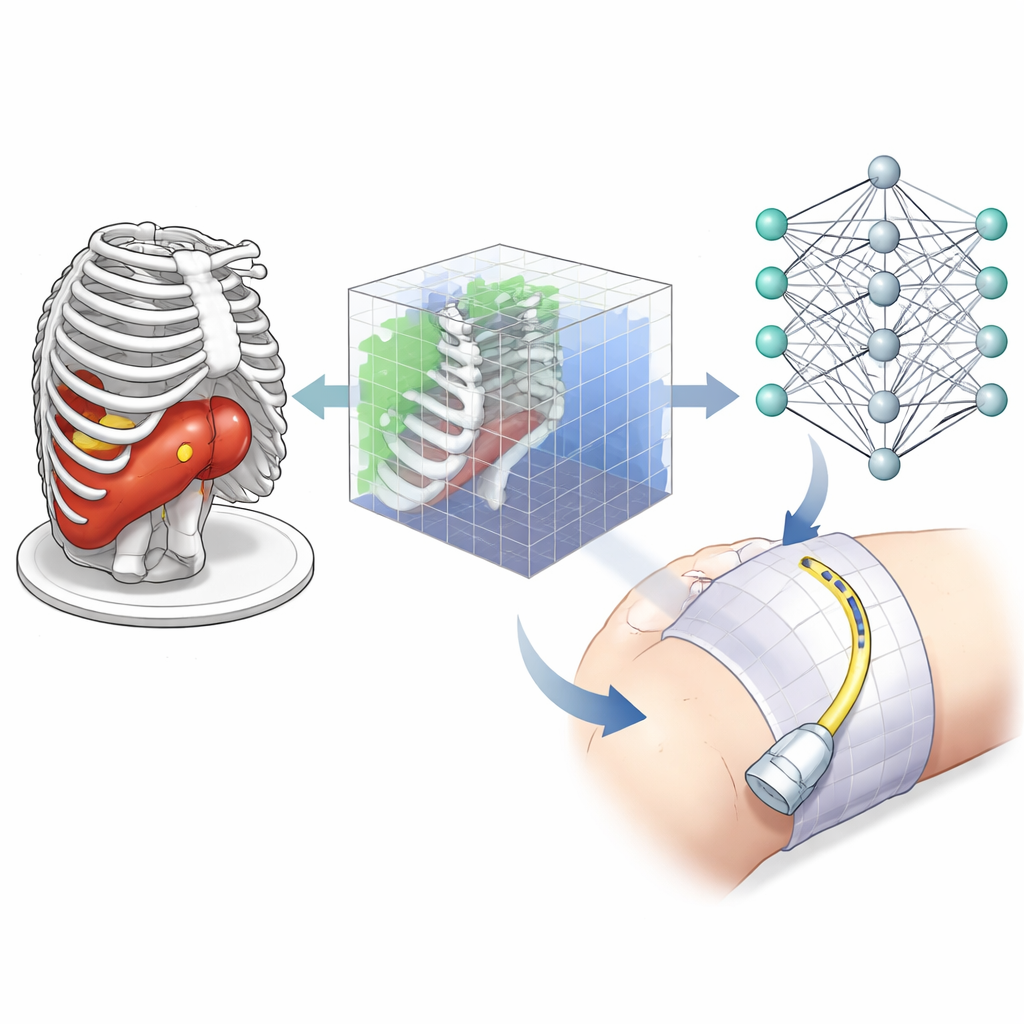

Invece di apprendere direttamente da immagini ecografiche rumorose e variabili, i ricercatori hanno costruito un campo di addestramento virtuale usando scansioni di tomografia computerizzata (TC). La TC offre una mappa tridimensionale nitida di ossa, pelle e fegato, e i tumori possono essere aggiunti con forme e posizioni diverse per creare molti scenari realistici. In questo simulatore, una sonda ecografica virtuale si muove sulla superficie cutanea sopra le costole, e i percorsi dei fasci ultrasonori sono modellati come raggi che attraversano il tessuto molle ma vengono bloccati dall’osso. Questo modello semplice ma realistico informa il sistema su quali parti di un tumore sono visibili, quanto il segnale si indebolisce durante il tragitto e dove compaiono le ombre.

Come il sistema di apprendimento decide dove scansionare

Il team ha usato una forma di intelligenza artificiale chiamata apprendimento per rinforzo, in cui un “agente” impara per tentativi ed errori a scegliere azioni che portano a ricompense maggiori. A ogni passo, l’agente vede una rappresentazione 3D compatta della scena intorno al tumore: quali piccoli elementi di volume contengono tumore, quali contengono osso e quali sono attraversati dai raggi ultrasonici simulati. Può quindi spostare o inclinare la sonda virtuale in piccoli incrementi, oppure passare da una modalità “esplora” a una modalità “registrazione” usata per costruire la vista 3D finale. La ricompensa che riceve combina tre obiettivi: coprire quanta più parte possibile del volume bersaglio, mantenere la sonda abbastanza vicino per ridurre la perdita di segnale e evitare regioni dove i raggi sono bloccati dall’osso, che genererebbero immagini inutili con ombra.

Mettere il metodo alla prova

Per verificare se la strategia appresa si generalizza oltre gli esempi di addestramento, i ricercatori l’hanno testata su nuove scansioni TC e nuove forme di tumore che l’agente non aveva mai incontrato. In queste prove, un piano di scansione era considerato riuscito se almeno il 95% del volume bersaglio era stato immaginato entro un numero limitato di passi. Per bersagli piccoli, medi e grandi, il sistema ha raggiunto tassi di successo fino al 95%, mantenendo una percentuale elevata di viste prive di ombre e distanze ragionevoli tra sonda e tumore. Il metodo ha funzionato anche quando c’erano più bersagli da coprire, come residui tumorali disseminati nel fegato, sebbene le prestazioni siano leggermente calate man mano che il compito diventava più complesso.

Dalla simulazione alla sala operatoria

Per ora, il lavoro si concentra sulla pianificazione del percorso più che sul movimento fisico di un robot reale. I percorsi vengono generati su scansioni TC specifiche per il paziente o su “atlanti” TC generici che possono poi essere adattati all’anatomia individuale usando tecniche di registrazione esistenti. In futuro, questo modulo di pianificazione è pensato per essere combinato con il controllo robotico, la compensazione del movimento per la respirazione e una simulazione dell’immagine ecografica più realistica. Per un non addetto ai lavori, la conclusione principale è che questo approccio potrebbe rendere il monitoraggio ecografico durante procedure come il trattamento dei tumori epatici più affidabile e meno dipendente dall’esperienza dell’operatore, permettendo a un robot di trovare percorsi intelligenti e privi di ombre tra le costole per mantenere l’intero bersaglio in vista.

Citazione: Bi, Y., Qian, C., Zhang, Z. et al. Autonomous path planning for intercostal robotic ultrasound imaging using reinforcement learning. Sci Rep 16, 6356 (2026). https://doi.org/10.1038/s41598-026-37702-9

Parole chiave: ecografia robotica, apprendimento per rinforzo, imaging di tumori epatici, scansione intercostale, robotica medica