Clear Sky Science · it

Algoritmo di fusione di immagini a infrarossi e visibili basato su NSCT e rilevamento della salienza FT migliorato

Vedere al buio e attraverso il disordine

Le fotocamere moderne ci offrono viste nitide e colorate del mondo, ma faticano nella nebbia, nell’oscurità o nell’abbagliamento—esattamente quando abbiamo più bisogno di una visione affidabile per la guida, la sorveglianza, le operazioni di ricerca e soccorso o i droni. I sensori a infrarossi, che catturano il calore invece del colore, eccellono in queste condizioni difficili ma producono immagini sfocate e con pochi dettagli. Questo articolo presenta un modo per combinare intelligentemente immagini a infrarossi e in luce visibile in modo che l’immagine finale mostri sia dettagli nitidi sia persone o oggetti evidenziati con chiarezza, anche in scene difficili.

Perché due occhi valgono più di uno

Le fotocamere in luce visibile registrano trame fini e sfondi ricchi, ma le loro prestazioni crollano di notte o in ombra intensa, e i bersagli possono confondersi con sfondi di colore simile. Le camere a infrarossi fanno il contrario: rilevano corpi caldi e oggetti che emettono calore su sfondi scuri, giorno e notte, ma perdono gran parte della struttura sottile di edifici, alberi e strade. Fondere questi due tipi di immagine in una sola può, in linea di principio, offrire il meglio di entrambi i mondi. Tuttavia, molti metodi di fusione esistenti o attenuano il contrasto, oppure sfocano i bordi degli oggetti, oppure permettono che motivi rumorosi degli infrarossi sovrastino i dettagli utili dell’immagine in luce visibile.

L’idea centrale: lasciare che le parti importanti risaltino

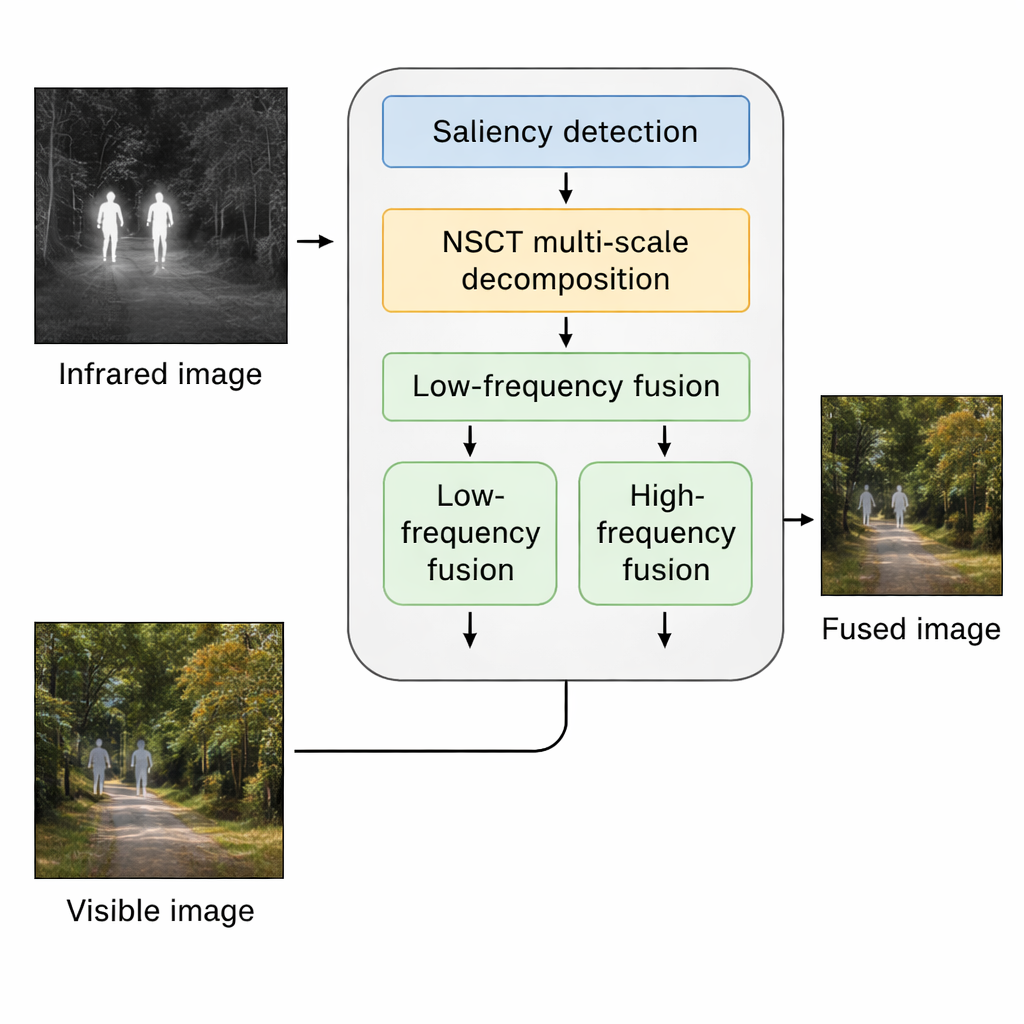

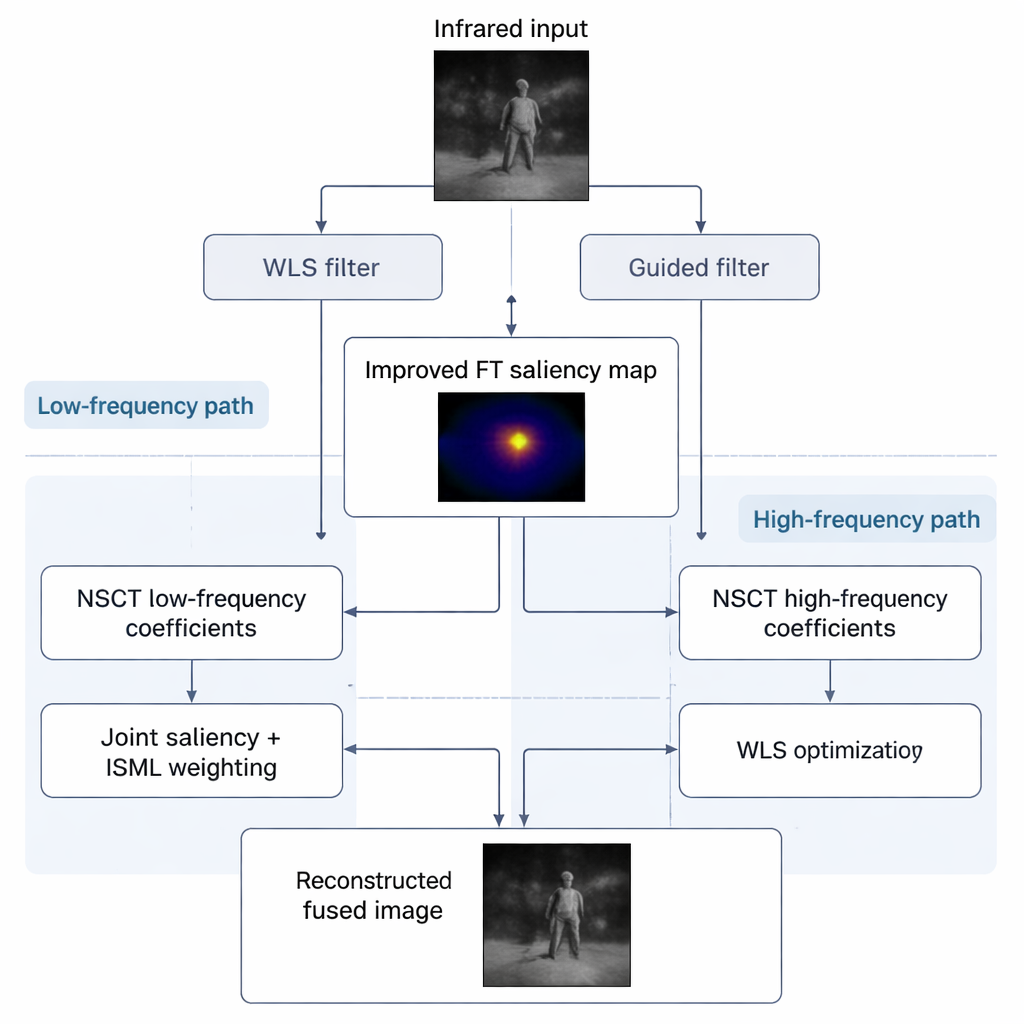

Gli autori affrontano la fusione come un problema di risoluzione dei conflitti tra i due tipi di immagine. Si concentrano su tre problemi ricorrenti: individuare quali regioni sono veramente importanti ("salienti"), bilanciare la luminosità complessiva tra bersagli caldi negli infrarossi e sfondi luminosi in visibile, e preservare texture delicate sopprimendo il rumore infrarosso. Per affrontare questi aspetti migliorano una tecnica popolare chiamata rilevamento della salienza sintonizzato in frequenza (frequency-tuned), che tenta di imitare il sistema visivo umano evidenziando regioni che attirano naturalmente la nostra attenzione. Invece di affidarsi a una semplice sfocatura, usano una coppia di filtri più intelligenti—uno che leviga mantenendo i bordi e un altro che aumenta il contrasto—per ricavare una mappa più pulita e più nitida di dove si trovano gli interessanti bersagli infrarossi.

Scomporre forme grossolane e dettagli fini

Una volta che l’algoritmo individua dove si trovano i principali bersagli infrarossi, divide sia le immagini infrarosse sia quelle visibili in strati che separano strutture grossolane dai dettagli minuti usando uno strumento matematico chiamato Trasformata Contourlet Non-Sottocampionata (Non-Subsampled Contourlet Transform). Gli strati a bassa frequenza contengono modelli di luminosità ampi, come il cielo, le strade o i muri, mentre gli strati ad alta frequenza catturano bordi, texture e piccole caratteristiche. Per gli strati grossolani, il metodo miscela le informazioni usando sia la mappa di salienza infrarossa migliorata sia una misura basata sul Laplaciano della nitidezza delle strutture locali. Questo aiuta a evitare immagini slavate in cui o gli oggetti caldi dominano la scena o lo sfondo visibile annebbia i bersagli importanti.

Mantenere le texture nitide, controllare il rumore

Gli strati ad alta frequenza richiedono una strategia diversa, perché sono il luogo in cui convivono sia texture utili sia rumore distraente. Qui il metodo prima seleziona, regione per regione, il sensore che offre maggior dettaglio locale. Poi affina questa scelta iniziale con una procedura di minimi quadrati pesati che tende verso le texture in luce visibile più pulite e informative pur consentendo il passaggio di pattern infrarossi significativi. Il risultato è un’immagine fusa in cui rami, bordi degli edifici e segnali stradali appaiono nitidi, mentre gli artefatti puntiformi degli infrarossi sono ridotti.

Immagini migliori, decisioni automatiche migliori

Il gruppo ha testato il proprio approccio su diversi dataset pubblici e sulle proprie immagini in condizioni di scarsa illuminazione, confrontandolo con tecniche tradizionali e metodi moderni di deep learning. L’ispezione umana ha mostrato che le immagini fuse presentavano sfondi più chiari, contrasto più elevato e bersagli più evidenti, specialmente in corridoi poco illuminati, strade notturne e scene esterne affollate. Misure oggettive di contenuto informativo, nitidezza e contrasto in gran parte hanno favorito il nuovo metodo o ne hanno mostrato un bilanciamento equilibrato tra le metriche. Crucialmente, quando queste immagini fuse sono state alimentate a un popolare sistema di rilevamento di oggetti (YOLOv5s), accuratezza, precisione e richiamo di rilevamento sono migliorati in modo significativo. In termini semplici, l’algoritmo non si limita a produrre immagini più gradevoli: aiuta anche i sistemi automatici a trovare persone e oggetti in modo più affidabile. Questo suggerisce che una fusione più intelligente di immagini infrarosse e visibili potrebbe svolgere un ruolo chiave in una guida autonoma più sicura, in una sorveglianza più efficace e in robot più affidabili che operano al buio o in ambienti visivamente complessi.

Citazione: Fan, X., Kong, F., Shi, H. et al. Infrared and visible image fusion algorithm based on NSCT and improved FT saliency detection. Sci Rep 16, 7144 (2026). https://doi.org/10.1038/s41598-026-37670-0

Parole chiave: fusione infrarosso-visibile, salienza delle immagini, imaging multi-sensore, visione notturna, visione artificiale