Clear Sky Science · it

Un nuovo approccio basato sul reinforcement learning per la previsione a breve termine di carico e prezzi nei mercati energetici

Perché è importante prevedere il consumo di energia di domani

Ogni volta che accendi una luce, una vasta rete di centrali, mercati e computer lavora dietro le quinte per mantenere l'elettricità disponibile e a costi sostenibili. Se gli operatori di rete possono prevedere con precisione quanta energia verrà consumata e come si muoveranno i prezzi nelle ore successive, possono evitare blackout, ridurre gli sprechi e far risparmiare tutti. Questo articolo esplora un nuovo modo di fare queste previsioni a breve termine usando tecniche sviluppate originariamente per imparare a giocare e controllare robot.

Previsioni più intelligenti per un mondo energetico in evoluzione

La domanda e i prezzi dell'elettricità possono oscillare molto di ora in ora. Ondate di calore, ondate di freddo, festività e i costi dei combustibili spingono il sistema in direzioni diverse. Gli strumenti di previsione tradizionali, come semplici trend o persino modelli di machine learning standard, spesso trattano il problema come un semplice adattamento ai dati passati. Faticano quando le condizioni cambiano rapidamente o quando molti fattori interagiscono in modi complessi. Gli autori sostengono che le reti moderne, specialmente quelle con quote crescenti di energie rinnovabili, necessitano di strumenti di previsione che possano adattarsi in tempo reale e imparare direttamente dai propri successi e errori.

Un agente che impara nel mercato dell'energia

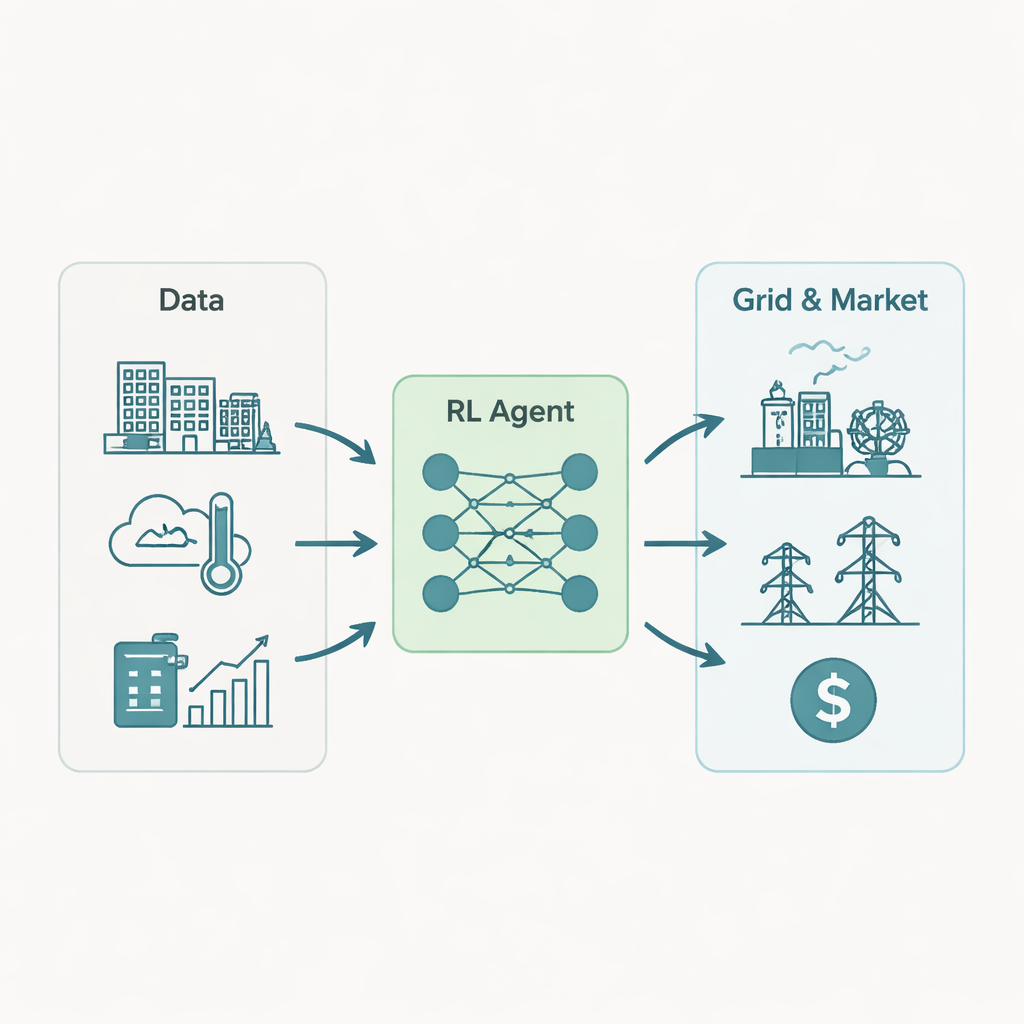

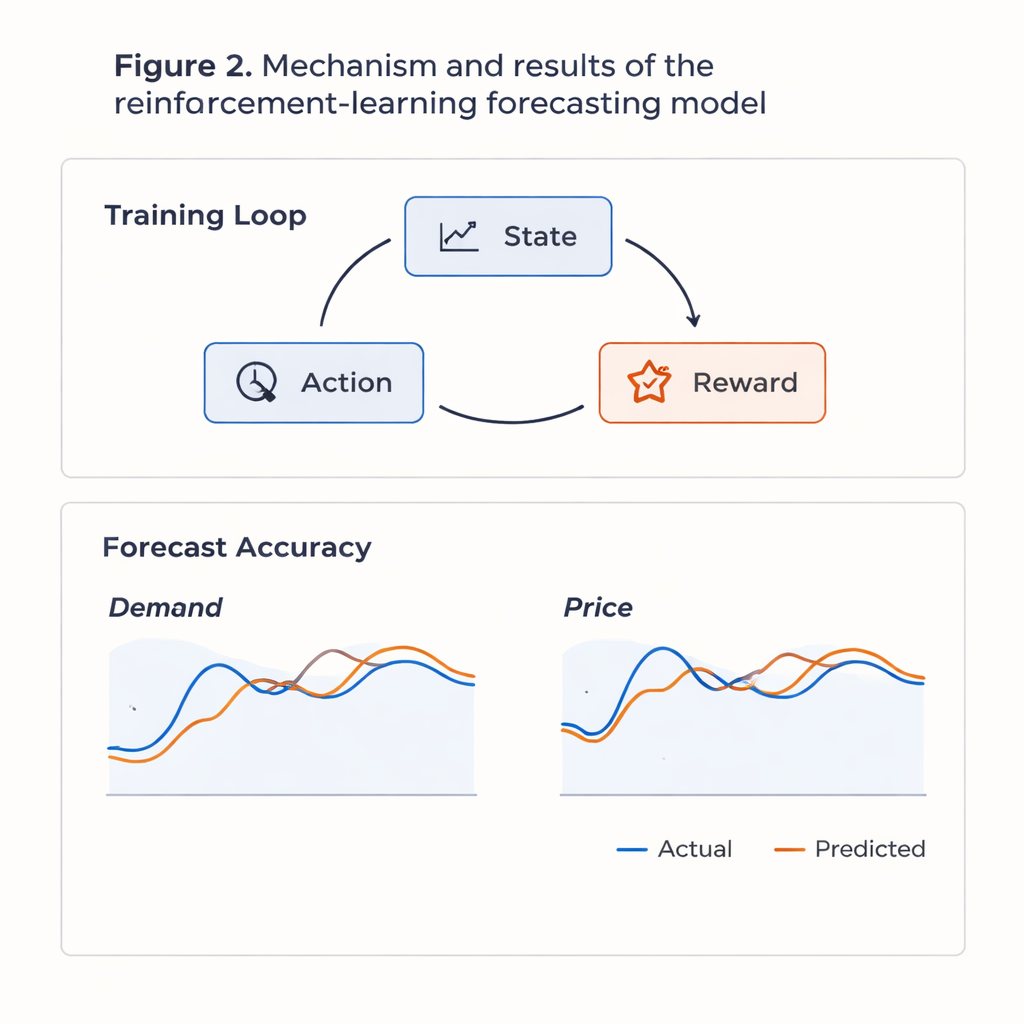

I ricercatori hanno reinterpretato la previsione come un gioco di decisione. Ogni ora, un «agente» informatico osserva la situazione corrente: domanda recente di energia, prezzi passati, temperatura, umidità, giorno della settimana, festività e costi dei combustibili. Sceglie quindi un'azione: la sua migliore stima per la domanda e il prezzo dell'ora successiva. Quando arrivano i valori reali, l'agente riceve un punteggio basato su quanto si è discostato—gli errori grandi vengono penalizzati, quelli piccoli premiati. Nel tempo, il sistema cerca una strategia che massimizzi il punteggio a lungo termine, non solo l'accuratezza di un singolo passo. Per gestire i numerosi input coinvolti, gli autori usano un'architettura di deep reinforcement learning basata su una Deep Q-Network, un tipo di rete neurale che stima quanto sia buona ciascuna azione possibile in ogni situazione.

Da dati grezzi a previsioni affidabili

Per testare l'approccio, il team ha usato dati reali della PJM Interconnection, un importante mercato elettrico statunitense che copre parti del Midwest e della Costa Est. Hanno impiegato circa tre anni di registrazioni orarie (2021–2023), includendo prezzi di mercato, domanda di elettricità, osservazioni meteorologiche e indici dei prezzi dei combustibili. Prima dell'addestramento hanno pulito i dati, riempito i rari valori mancanti, rimosso outlier insoliti e scalato tutto in intervalli comparabili. Hanno inoltre utilizzato tecniche statistiche per comprimere l'ampio insieme di caratteristiche in ingresso mantenendo la maggior parte della variazione utile. L'agente è stato quindi addestrato con passaggi ripetuti su questa storia, passando gradualmente da prove casuali a sfruttare i pattern scoperti.

Quanto bene ha funzionato l'agente che apprende

Confrontato con metodi di previsione ampiamente usati—tra cui ARIMA (un modello tradizionale per serie temporali), reti LSTM e il popolare algoritmo XGBoost—il sistema basato sul reinforcement learning ha ottenuto risultati migliori. Su dati di test non visti in precedenza, ha ridotto gli errori percentuali medi nella domanda e nei prezzi di circa il 15–20 percento rispetto a questi riferimenti. Le previsioni hanno seguito da vicino sia i cicli giornalieri invernali che estivi e i movimenti generali dei prezzi, sebbene il modello incontrasse ancora difficoltà con i picchi di prezzo più netti e rari e con comportamenti insoliti durante le festività. L'analisi della strategia appresa ha mostrato che l'agente ha scoperto implicitamente un comportamento economicamente sensato: dopo aver osservato prezzi molto alti, tendeva a prevedere una domanda leggermente più bassa nell'ora successiva, imitando una risposta reale della domanda senza che gli fosse stato esplicitamente insegnato.

Cosa significa questo per l'uso quotidiano dell'energia

Per i non specialisti, il messaggio chiave è che questo approccio basato sull'apprendimento può aiutare gli operatori di rete a gestire i sistemi elettrici in modo più fluido ed economico. Previsioni più accurate a breve termine permettono a generatori e operatori di mercato di programmare gli impianti in modo più efficiente, integrare le fonti rinnovabili con meno sorprese e ridurre il rischio di improvvisi picchi di prezzo o carenze. Sebbene il metodo richieda molti dati e risorse computazionali e necessiti ancora di perfezionamenti per eventi estremi, indica un futuro in cui i mercati elettrici sono guidati da strumenti adattivi e auto-migliorativi che apprendono continuamente dal comportamento in evoluzione dei consumatori, dal meteo e dai costi dei combustibili.

Citazione: Wu, Y., Ma, Y. & Aliev, H. A novel reinforcement learning-based approach for short-term load and price forecasting in energy markets. Sci Rep 16, 5141 (2026). https://doi.org/10.1038/s41598-026-37366-5

Parole chiave: previsioni smart grid, predizione prezzi dell'elettricità, reinforcement learning, previsione della domanda energetica, deep Q-network