Clear Sky Science · it

RiemannInfer: migliorare l’inferenza dei transformer tramite la geometria Riemanniana

Perché questo è importante per gli utenti comuni di AI

I chatbot moderni e gli assistenti AI possono risolvere problemi di matematica, scrivere saggi e perfino spiegare argomenti medici, eppure non sappiamo ancora davvero come arrivino alle loro conclusioni — né come rendere il loro ragionamento più affidabile. Questo articolo introduce “RiemannInfer”, un nuovo modo di guardare dentro i grandi modelli di linguaggio (LLM) trattando la loro attività interna come un moto su una superficie geometrica curva. Questa prospettiva non solo offre un quadro più intuitivo di come questi sistemi “pensino”, ma rende anche il loro ragionamento più veloce e preciso.

Trasformare il pensiero dell’AI in un viaggio geometrico

All’interno di un LLM come GPT-4 o Llama, ogni parola in una frase è rappresentata da un vettore ad alta dimensionalità, e livelli di “attenzione” decidono quanto fortemente le parole si influenzino a vicenda. Gli autori osservano che questi stati nascosti possono essere visti come punti in uno spazio vasto il cui profilo complessivo codifica la comprensione del linguaggio del modello. Invece di trattare il ragionamento come una serie di calcoli di probabilità sui testi, lo reinterpretano come un problema di ricerca del percorso: il modello si muove da uno stato iniziale (la domanda) a uno stato finale (la risposta) lungo una traiettoria in questo spazio. Usando strumenti della geometria Riemanniana — la matematica delle superfici curve — costruiscono una varietà curva che cattura come gli schemi di attenzione pieghino e deformino questo paesaggio interno.

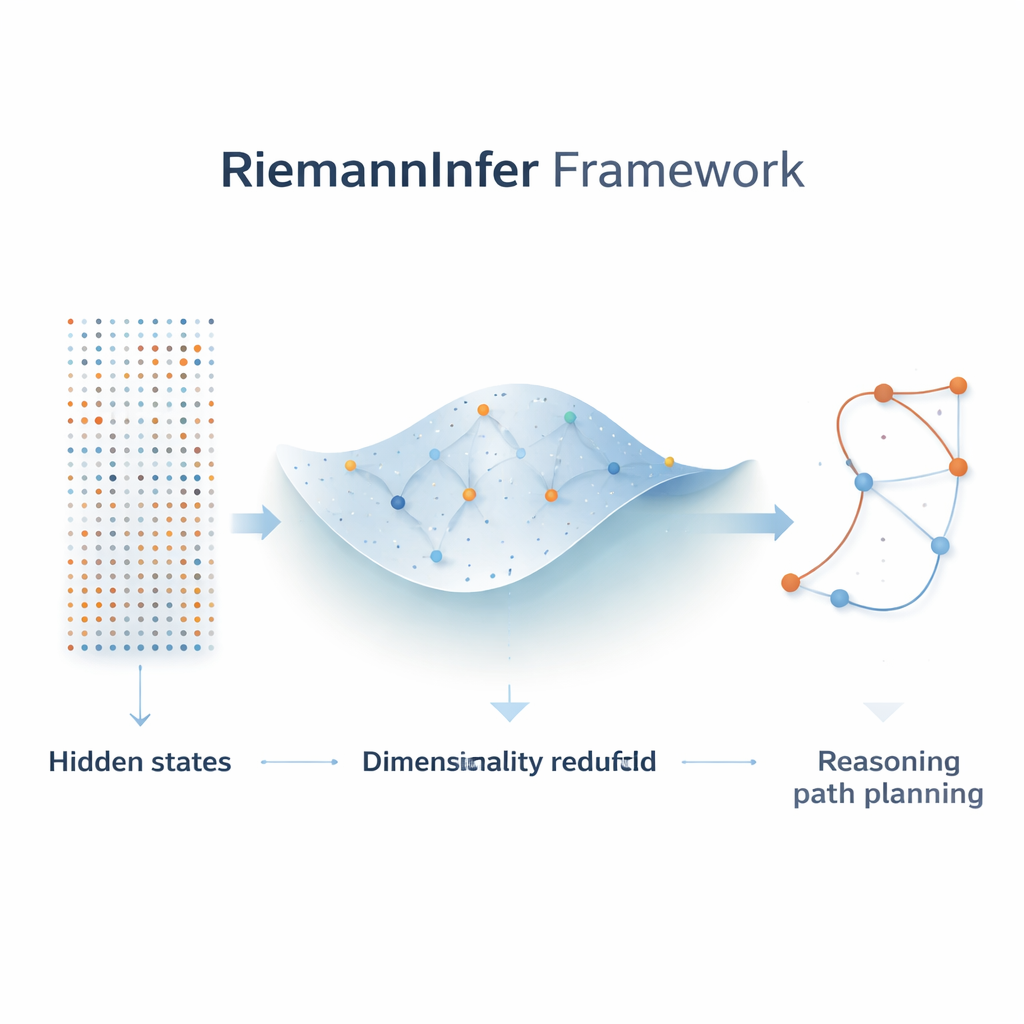

Comprimere la complessità senza perdere il quadro d’insieme

Poiché lo spazio interno grezzo di un LLM è enorme, il primo passo di RiemannInfer è ridurlo preservandone la struttura essenziale. Gli autori combinano tecniche della topologia, che studia come i punti siano connessi, con un noto algoritmo di riduzione dimensionale chiamato UMAP. Prima di abbassare il numero di dimensioni, analizzano la “forma” della nube di stati nascosti per assicurarsi che i pattern di connettività chiave sopravvivano alla compressione. Il risultato è uno spazio a dimensionalità inferiore in cui le relazioni importanti tra i token — come quali parole si prestano forte attenzione a vicenda — sono in gran parte preservate. Questa mappa geometrica compatta rende fattibili calcoli precisi su distanze, percorsi più brevi e curvatura.

Costruire una mappa curva a partire dall’attenzione

L’innovazione centrale consiste nel tradurre i pesi di attenzione in una misura geometrica di distanza. Quando il modello dedica forte attenzione tra due token, RiemannInfer li tratta come vicini sulla varietà; un’attenzione debole li colloca più lontani. Da queste relazioni, gli autori definiscono una metrica — una regola matematica che determina lunghezze e angoli — e la usano per calcolare geodetiche, l’equivalente curvo delle linee rette, oltre alla curvatura, che misura quanto lo spazio si pieghi. L’attenzione multi‑head diventa naturalmente una combinazione di metriche multiple, ciascuna catturante un aspetto diverso della struttura linguistica, come la grammatica o il significato. Con questa costruzione, le decisioni del modello possono essere interpretate come la scelta di particolari percorsi attraverso un paesaggio i cui picchi e valli riflettono dove l’informazione è densa o scarsa.

Pianificare percorsi di ragionamento a basso sforzo

Una volta costruita la varietà, gli autori riformulano il ragionamento come la ricerca di un percorso “facile” dalla domanda alla risposta — uno che minimizzi il lavoro totale svolto lungo il tragitto. Prendono in prestito un’analogia dall’alpinismo: salire una via ripida e accidentata richiede più energia che seguire una cresta più liscia fino alla stessa vetta. Nel contesto degli LLM, la curvatura gioca il ruolo della ripidità, e il lavoro di ragionamento del modello corrisponde a quanto la sua incertezza interna viene ridotta lungo un percorso. Usando formule approssimate per geodetiche e curvatura, combinate con un efficiente algoritmo di ricerca su grafi (l’algoritmo di Dijkstra), RiemannInfer individua rapidamente rotte che minimizzano questo lavoro, guidando di fatto il modello verso catene di pensiero più efficienti.

Cosa mostrano gli esperimenti su modelli reali

Gli autori testano RiemannInfer su diversi LLM all’avanguardia, inclusi GPT‑4o, Llama‑3‑405B e DeepSeek‑V2‑400B, su benchmark impegnativi di matematica e ragionamento come GSM8K, MATH500, StrategyQA e AGIEval. In ciascun caso, integrare questi modelli con il framework RiemannInfer aumenta la loro accuratezza di qualche punto percentuale — numeri piccoli ma comunque significativi alla frontiera delle prestazioni — mantenendo o migliorando leggermente la velocità. Un confronto con un metodo più semplice e puramente lineare mostra che ignorare la geometria curva degli stati nascosti danneggia drasticamente le prestazioni, sottolineando l’importanza della visione della varietà.

Quadro generale: dare al ragionamento dell’AI una dimensione fisica

Per un lettore non specialista, la conclusione principale è che gli autori hanno trasformato il funzionamento opaco dei grandi modelli di linguaggio in qualcosa di più tangibile: un viaggio attraverso un paesaggio curvo in cui un buon ragionamento corrisponde al seguire sentieri lisci e a basso sforzo. Radicando gli schemi di attenzione e i passaggi di ragionamento in concetti geometrici e fisici — distanza, curvatura e lavoro — RiemannInfer offre sia un modo pratico per migliorare i risultati sia un ponte concettuale tra l’AI e la fisica degli spazi continui. Sebbene i metodi attuali siano approssimati e molti dettagli debbano ancora essere raffinati, questo quadro indica la strada verso sistemi AI futuri i cui processi di pensiero possano essere analizzati, ottimizzati e forse persino progettati usando il linguaggio della geometria e della fisica.

Citazione: Mao, R., Zhang, Z., Yang, M. et al. RiemannInfer: improving transformer inference through Riemannian geometry. Sci Rep 16, 6636 (2026). https://doi.org/10.1038/s41598-026-37328-x

Parole chiave: grandi modelli di linguaggio, apprendimento profondo geometrico, varietà Riemanniana, meccanismi di attenzione, efficienza del ragionamento