Clear Sky Science · it

Quando gli LLM parlano ZigBee: esplorare modelli a bassa latenza e di ragionamento per la generazione di traffico di rete

Le case intelligenti hanno bisogno di prove credibili

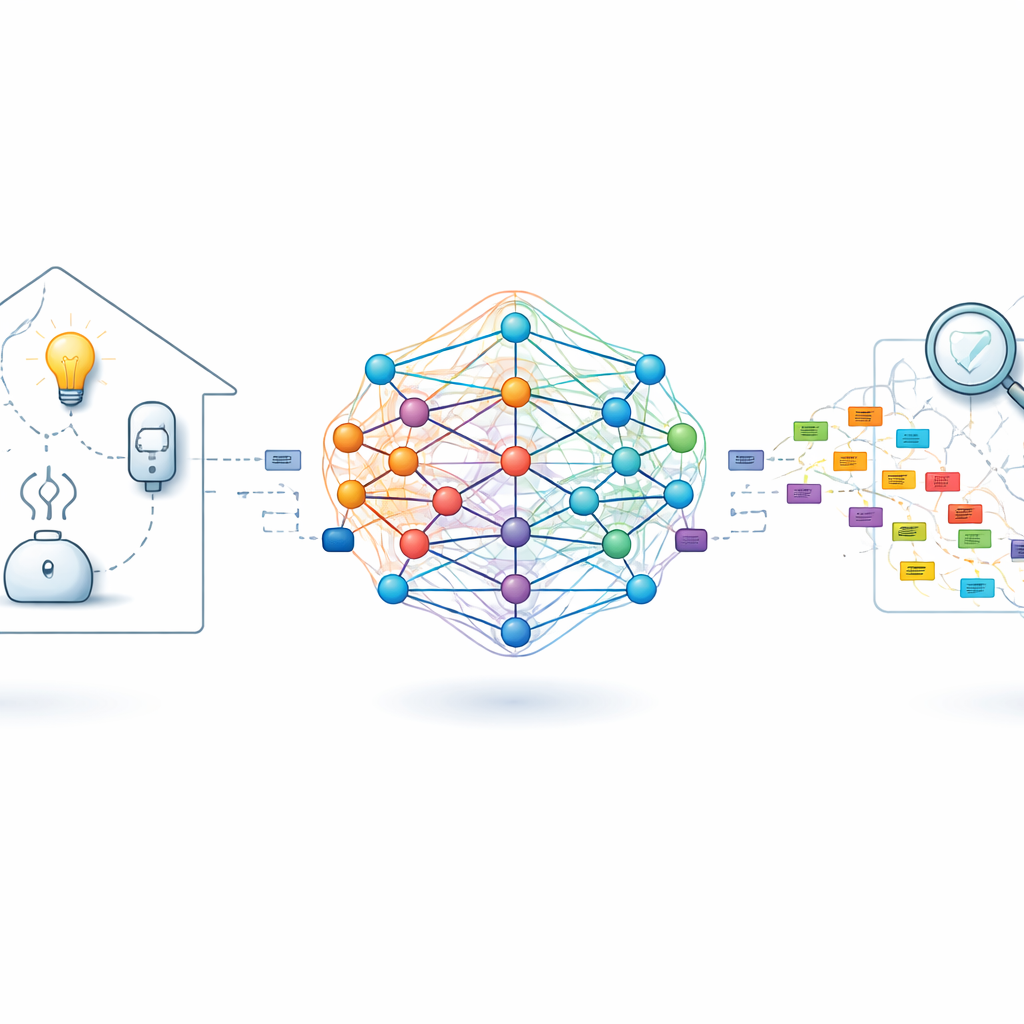

Man mano che le nostre abitazioni si riempiono di luci intelligenti, prese e sensori, il brusio invisibile tra questi dispositivi diventa sia una comodità sia un potenziale punto di vulnerabilità. Gli ingegneri che progettano e mettono in sicurezza questi sistemi hanno bisogno di modi sicuri per “provare” come le reti si comportano in condizioni realistiche, inclusi guasti rari e attacchi informatici. Questo lavoro esplora se i moderni modelli di linguaggio artificiale — gli stessi impiegati per i chatbot — possano essere riadattati per generare traffico di rete credibile per le case intelligenti, offrendo ai ricercatori un nuovo banco di prova potente senza dover registrare ogni possibile scenario in abitazioni reali.

Dalla lingua umana alle conversazioni tra dispositivi

Lo studio si concentra su ZigBee, uno standard wireless diffuso in lampadine smart, prese e sensori di movimento. Invece di generare testo ordinario, gli autori forniscono ai modelli di linguaggio grandi (LLM) campioni di pacchetti ZigBee — registrazioni temporizzate di chi comunica con chi, con quali campi di protocollo — trattandoli come “frasi” strutturate. I modelli apprendono i pattern con cui i dispositivi e l’hub centrale comunicano nel tempo. L’obiettivo non è solo imitare statistiche di base come la dimensione media dei pacchetti, ma produrre nuovo traffico che rispetti le regole rigorose di ZigBee, utilizzi indirizzi dispositivo validi e preservi tempistiche e schemi richiesta‑risposta realistici.

Due esperimenti: comunicazione unidirezionale e dialogo completo

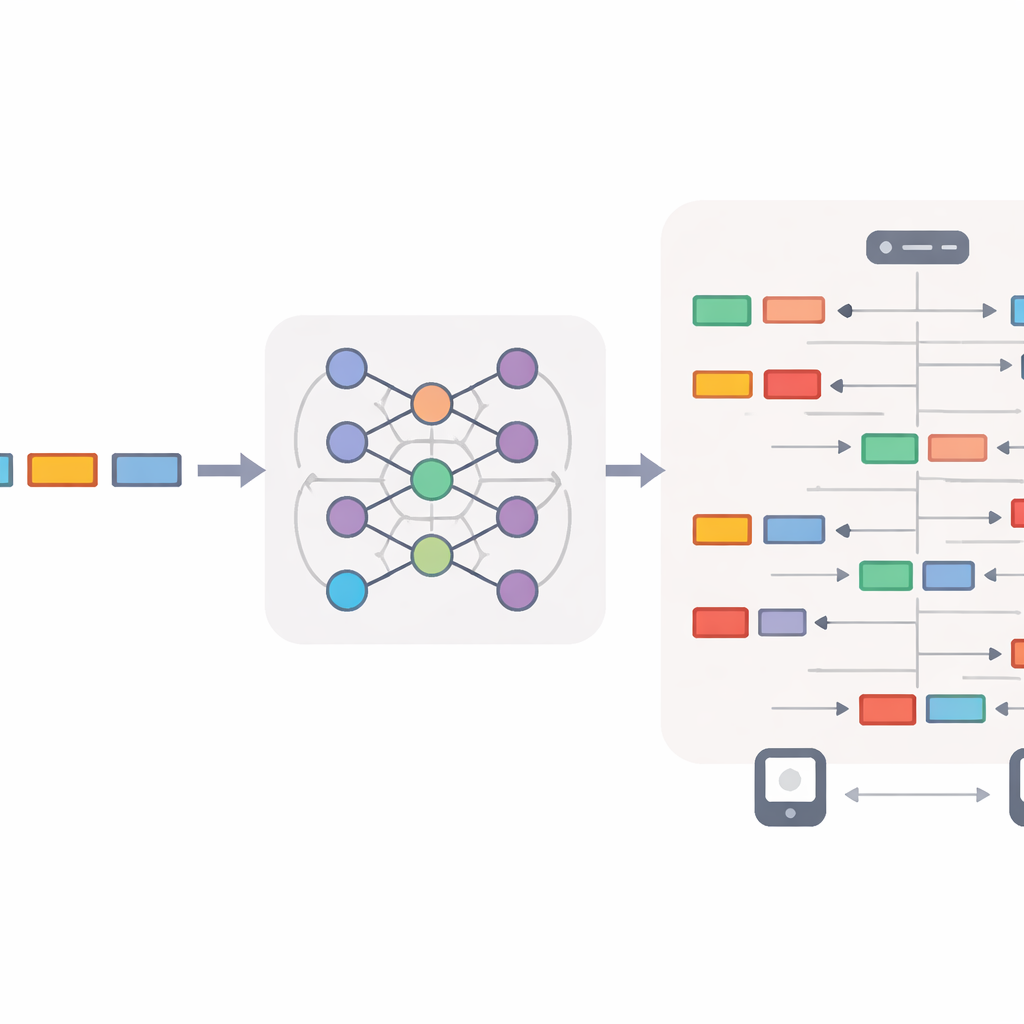

Per mettere alla prova l’idea, i ricercatori progettano due esperimenti principali usando un ampio dataset reale per la casa intelligente chiamato ZigBeeNet, che contiene circa 25 milioni di pacchetti raccolti da 15 dispositivi in 20 giorni. Nel primo esperimento studiano la comunicazione unidirezionale da una singola lampadina intelligente verso l’hub, addestrando l’LLM usando soltanto i primi dieci minuti di traffico reale come esempi. Nel secondo si passa a uno scenario più realistico in cui lampadina e hub si scambiano messaggi in entrambe le direzioni, includendo broadcast dall’hub. In entrambi i casi, un piccolo insieme di pacchetti di esempio viene mostrato al modello nel prompt (few‑shot learning) e al modello si chiede di produrre sequenze più lunghe di traffico completamente nuovo, convertibili nuovamente in file di cattura pacchetti standard e ispezionabili con strumenti di rete comuni.

Guidare il modello con regole e controlli umani

Poiché un campo fuori posto o una marca temporale fuori ordine possono rompere l’illusione di realismo, il team costruisce un accurato flusso di prompting e feedback. Prima filtrano ed esportano i pacchetti reali, poi elaborano prompt che specificano indirizzi dispositivo consentiti, tipi di messaggi e formati temporali. In una fase iniziale, un esperto umano rivede l’output del modello, cercando problemi come indirizzi non validi, numeri di sequenza impossibili o buchi temporali. Invece di correggere manualmente i pacchetti, queste osservazioni vengono tradotte in regole di prompt più rigide — per esempio vietare a un dispositivo di inviare a sé stesso o richiedere che il conteggio dei pacchetti resti in un intervallo realistico. Una volta stabili, le regole vengono “congelate” e riutilizzate senza modifiche, così i successivi esperimenti sono completamente automatici e riproducibili.

Mettere gli LLM a confronto con generatori più vecchi

Per capire se gli LLM apportano realmente valore, gli autori confrontano GPT‑4.1 e GPT‑5 con due approcci classici di deep learning: reti neurali ricorrenti (RNN) e reti generative avversarie (GAN), entrambe adattate per generare sequenze in stile ZigBee. Valutano tutti i modelli su molte dimensioni: quanto i tempi di interarrivo si allineano al traffico reale, se i pacchetti vengono decodificati correttamente negli strumenti standard, se le regole di protocollo e i ruoli dei dispositivi sono rispettati, con quale frequenza i pacchetti si ripetono e quanto spesso copiano esattamente esempi dal training. I risultati mostrano che entrambi i modelli GPT producono traffico praticamente decodificabile e conforme al protocollo con bassa divergenza rispetto ai pattern temporali reali, mentre le RNN faticano con l’ordinamento a lungo termine e le GAN spesso generano traffico irrealisticamente denso o semanticamente non valido, specialmente nelle comunicazioni bidirezionali e per durate più lunghe.

Quando più “pensiero” non aiuta

Lo studio esplora anche una domanda sorprendente: concedere a GPT‑5 — orientato al ragionamento — più “tempo di riflessione” interno migliora il realismo della rete? Variando l’impegno di ragionamento nascosto di GPT‑5 da basso ad alto, gli autori trovano che un impegno maggiore rende il modello più lento e verboso ma non migliora, e talvolta peggiora, la somiglianza del suo traffico alla realtà. GPT‑4.1, un modello non orientato al ragionamento e più rapido, corrisponde o sovraperforma costantemente GPT‑5 sulle metriche chiave di qualità pur usando meno risorse di calcolo. In simulazioni estese di 30 minuti, entrambi gli LLM mantengono comportamenti ZigBee corretti, mentre le baseline classiche RNN e GAN deragliano notevolmente in termini di tempistica e correttezza del protocollo.

Cosa significa per case intelligenti più sicure

Per i non specialisti, il messaggio principale è che i modelli di linguaggio moderni possono apprendere non solo le conversazioni umane ma anche il “linguaggio” dei dispositivi per la casa intelligente, generando su richiesta traffico credibile e conforme alle regole. Il lavoro dimostra che un modello relativamente veloce e a bassa latenza come GPT‑4.1 può già servire come generatore di traffico ad alta fedeltà per test e valutazioni di sicurezza, riducendo potenzialmente la necessità di catturare dati sensibili reali. Evidenzia inoltre che un ragionamento più complesso e pesante non è sempre migliore: per compiti tecnici fortemente strutturati, modelli più semplici ed efficienti possono essere la scelta più intelligente. Con la pubblicazione di codice e dati da parte degli autori, questo approccio potrebbe aiutare ricercatori in tutto il mondo a stressare i sistemi per la casa intelligente, migliorare il rilevamento delle intrusioni ed esplorare nuovi progetti di rete in un ambiente sintetico e sicuro.

Citazione: Keleşoğlu, N., Sobczak, Ł. & Domańska, J. When LLMs speak ZigBee: exploring low-latency and reasoning models for network traffic generation. Sci Rep 16, 8036 (2026). https://doi.org/10.1038/s41598-026-37246-y

Parole chiave: IoT per la casa intelligente, generazione di traffico ZigBee, modelli linguistici di grandi dimensioni, test della sicurezza di rete, dati di rete sintetici