Clear Sky Science · it

Diagnosi del seno BI‑RADS differenziate usando MobileNetV1 e vision transformer basate su intelligenza artificiale spiegabile (XAI)

Individuare il rischio di cancro prima

Il cancro al seno è più trattabile se viene individuato precocemente, ma la lettura delle mammografie è un lavoro difficile e svolto sotto pressione. Questo studio descrive un nuovo sistema di intelligenza artificiale (IA) progettato non solo per rilevare i segni del cancro nelle mammografie con altissima accuratezza, ma anche per mostrare ai medici esattamente quali aree dell’immagine mammaria hanno influenzato le sue decisioni. Combinando in modo intelligente due tecniche moderne di analisi delle immagini, il sistema mira a supportare i radiologi con pareri secondari rapidi, affidabili e trasparenti.

Perché leggere le mammografie è così difficile

Le mammografie sono immagini a raggi X del seno usate per cercare segni precoci di cancro. I radiologi assegnano a ogni esame un punteggio BI‑RADS, una scala standardizzata che va da reperti normali a reperti chiaramente cancerosi. Nei seni densi, dove è presente molto tessuto ghiandolare, le aree sospette possono essere nascoste o assomigliare a strutture innocue. Molti strumenti di supporto precedenti si concentravano solo su decisioni semplici sì/no sul cancro, faticavano a gestire l’intera gamma delle categorie BI‑RADS o funzionavano come una scatola nera, lasciando i medici incerti sul perché di una determinata decisione.

Fondere due modi di “guardare” un’immagine

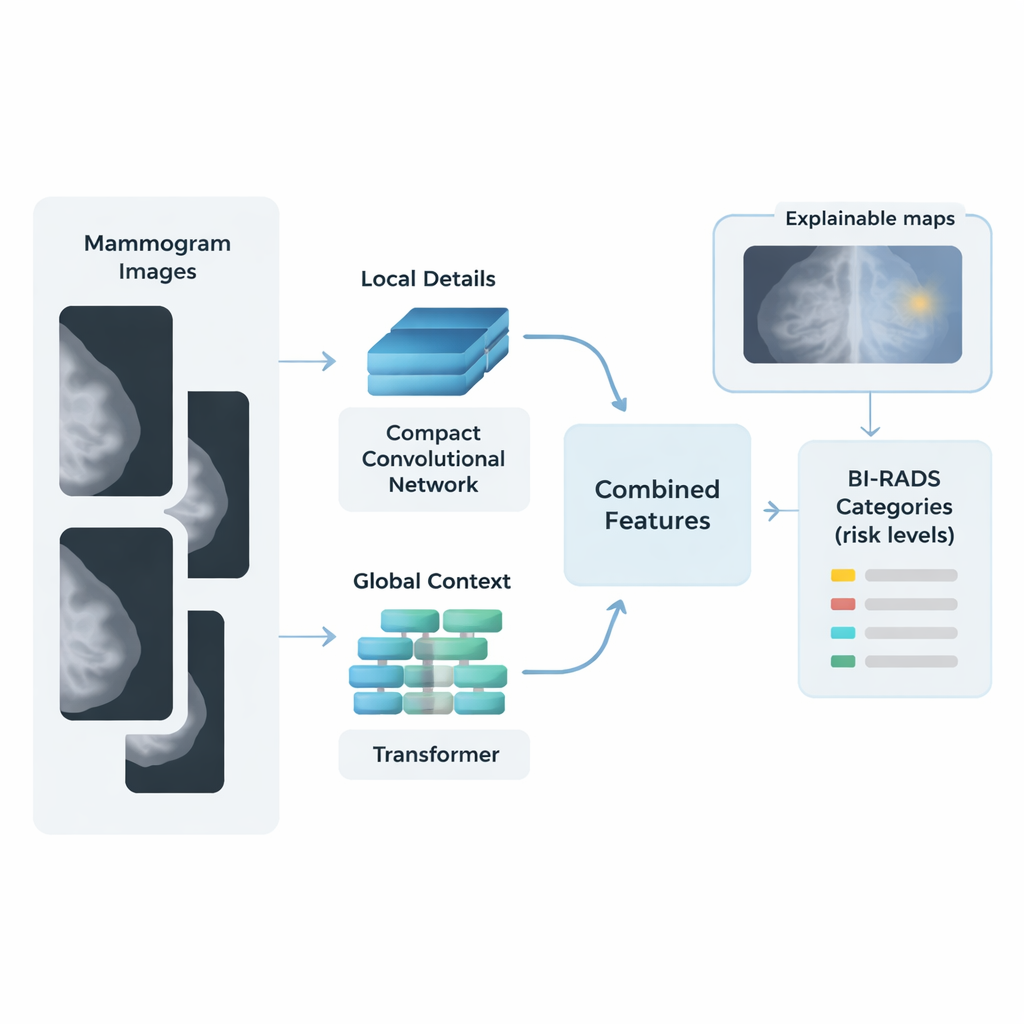

I ricercatori hanno costruito un framework IA ibrido che imita come un lettore umano attento potrebbe esaminare una mammografia: prima osservando i piccoli dettagli, poi considerando il quadro generale. Una parte del sistema, basata su una rete compatta chiamata MobileNetV1, si concentra sui dettagli locali come piccole calcificazioni e bordi netti delle lesioni. Una seconda parte, un vision transformer, suddivide l’immagine in patch e analizza come i pattern si relazionano su tutto il seno, catturando la struttura tessutale complessiva e deformazioni sottili. Le caratteristiche estratte da questi due “flussi” vengono quindi fuse in una singola descrizione ricca di ciascuna immagine.

Pulizia, bilanciamento e semplificazione dei dati

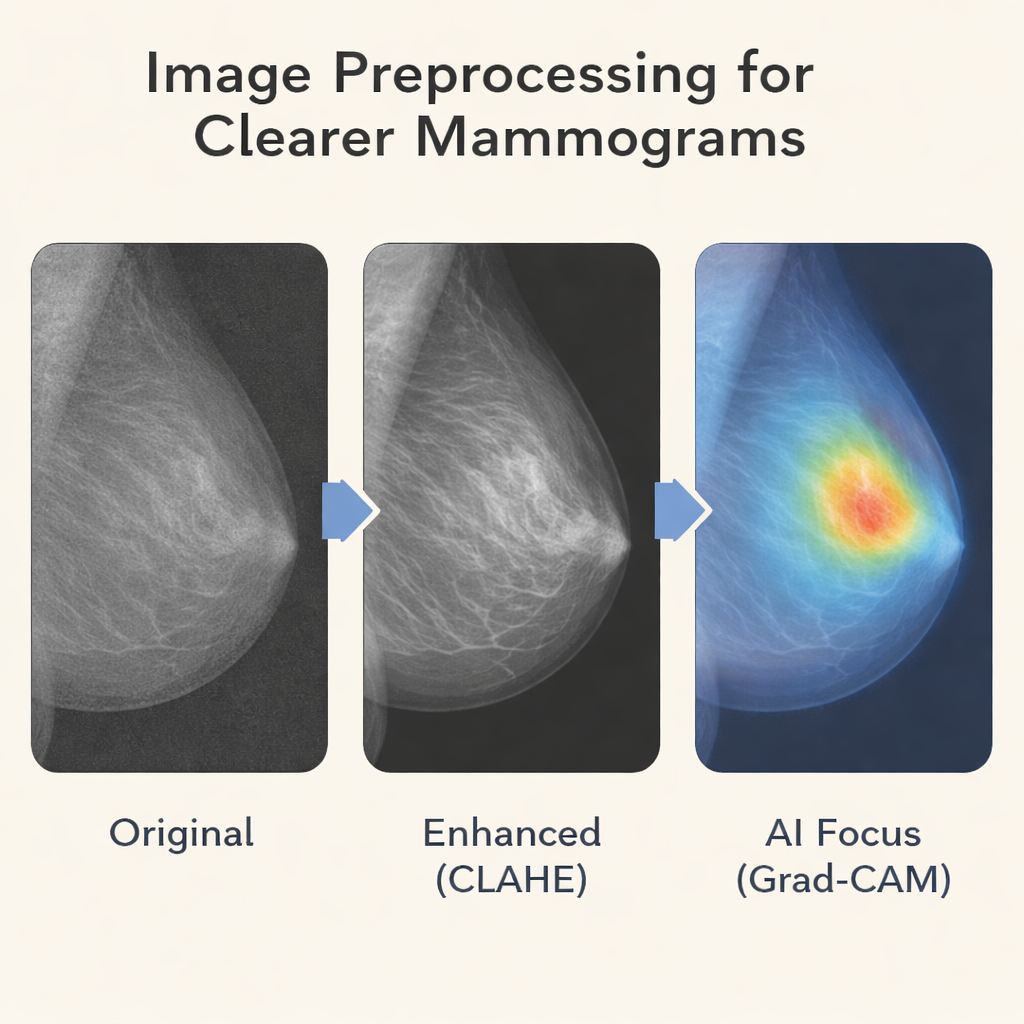

Prima che le immagini entrino nella pipeline IA, passano attraverso diversi passaggi di preparazione. Il team migliora il contrasto con un metodo che rende più evidenti le strutture sottili senza esaltare il rumore, rendendo più facile vedere macchie deboli. Le immagini vengono ridimensionate e normalizzate in modo che il sistema le veda in modo coerente. Per contrastare il fatto che alcune categorie BI‑RADS, come i casi chiaramente maligni, sono relativamente rare, gli autori usano trucchi di data augmentation come piccole rotazioni e ribaltamenti e applicano un addestramento sensibile alla classe in modo che le categorie meno comuni abbiano comunque influenza durante l’apprendimento. Dopo che i due flussi hanno estratto le caratteristiche, uno strumento matematico chiamato analisi delle componenti principali comprime queste informazioni, mantenendo ciò che conta di più e riducendo la complessità.

Dalle caratteristiche ai punteggi di rischio, con spiegazioni

Per il passo finale, invece di affidarsi a un classificatore di rete neurale pesante e opaco, gli autori usano molti semplici modelli di regressione logistica combinati in un ensemble di tipo “bagging”. Ogni modello offre un modo lineare e comprensibile di collegare le caratteristiche dell’immagine ai livelli di rischio BI‑RADS, e la loro votazione a maggioranza fornisce stabilità e resistenza all’overfitting su un dataset relativamente modesto. Testato su più di 6.000 mammografie dal dataset King Abdulaziz University Breast Cancer, il sistema ibrido ha raggiunto oltre il 99% di accuratezza, sensibilità e specificità nelle quattro categorie BI‑RADS chiave a cui mirava: normale, probabilmente benigno, sospetto e maligno.

Far vedere ai medici ciò che vede l’IA

Per rendere le sue decisioni comprensibili, il sistema impiega tecniche di IA spiegabile note come Grad‑CAM e Grad‑CAM++. Queste producono mappe di calore colorate sovrapposte alla mammografia, evidenziando le regioni che più hanno influito sul punteggio BI‑RADS previsto. Nei casi maligni, le aree evidenziate di solito coincidono con masse o aggregati di calcificazioni rilevati dai radiologi esperti; nelle immagini normali c’è poca o nessuna attivazione focalizzata. Questo feedback visivo aiuta i clinici a giudicare se il modello sta prestando attenzione a caratteristiche di rilievo medico e può rivelare perché alcuni casi borderline — come tessuto denso che imita una lesione — sono difficili anche per gli esperti.

Cosa potrebbe significare per i pazienti

Lo studio mostra che, su un singolo dataset clinico, questo sistema IA a doppio flusso e spiegabile può classificare le mammografie in più livelli di rischio con accuratezza comparabile e, sotto alcuni aspetti, superiore a molti metodi precedenti. Pur dovendo ancora essere testato su popolazioni più diverse e in ospedali differenti, l’approccio indica la strada verso strumenti IA non solo molto accurati, ma anche sufficientemente rapidi per cliniche affollate e abbastanza trasparenti da guadagnare la fiducia di radiologi e pazienti. In pratica, tali sistemi potrebbero agire come un paio di occhi esperti in più — segnalando reperti sottili, riducendo i tumori non diagnosticati e supportando conversazioni più chiare e sicure sul rischio di cancro al seno.

Citazione: Abdelsabour, I., Elgarayhi, A., Sallah, M. et al. Different BI-RADS breast cancer diagnosis using MobileNetV1 and vision transformer based on explainable artificial intelligence (XAI). Sci Rep 16, 7190 (2026). https://doi.org/10.1038/s41598-026-37199-2

Parole chiave: cancro al seno, mammografia, intelligenza artificiale, vision transformer, AI spiegabile