Clear Sky Science · it

YOLO-DC per il rilevamento dei veicoli mediante reti convoluzionali deformabili e attenzione alle coordinate cross-canale

Perché individuare le auto dalle telecamere è davvero importante

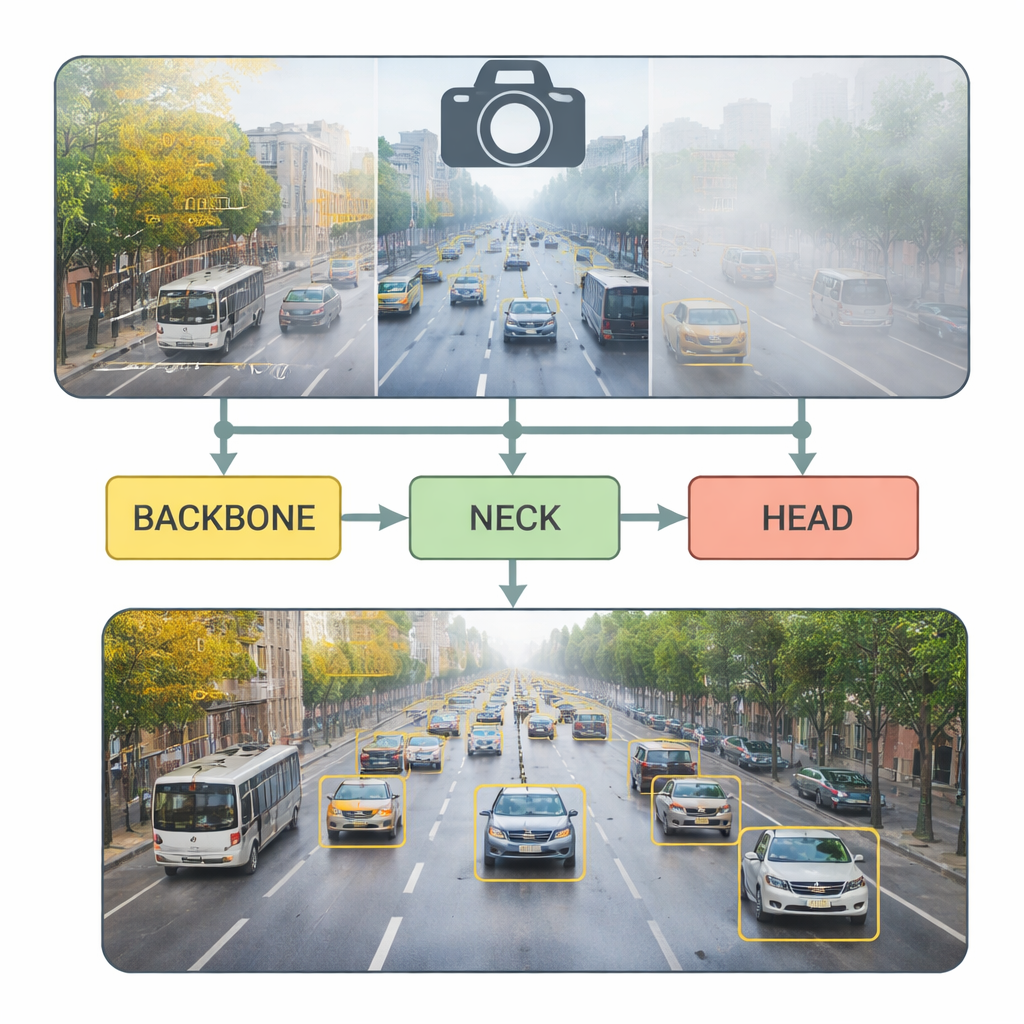

Le città moderne fanno affidamento su telecamere che sorvegliano le strade trafficate, aiutando a gestire gli ingorghi e preparando il terreno per i veicoli autonomi. Ma riconoscere in modo affidabile ogni veicolo nei flussi video è sorprendentemente difficile, specialmente quando le auto sono piccole in lontananza, parzialmente nascoste dal traffico o sfocate dalla pioggia, dalla nebbia o dall’oscurità. Questo articolo presenta YOLO‑DC, un nuovo sistema di visione artificiale che mira a individuare automobili, autobus e altri veicoli rapidamente e con precisione, anche in condizioni del mondo reale difficili e su dispositivi con risorse di calcolo limitate.

Il problema del traffico che sta dietro alla ricerca

Le città in crescita affrontano strade intasate, più incidenti e un aumento delle emissioni. I sistemi di trasporto intelligenti possono aiutare monitorando il traffico in tempo reale e guidando sia i conducenti umani sia quelli autonomi. L’ingrediente chiave è il rilevamento dei veicoli nei video, rapido e affidabile. I precedenti algoritmi “a due stadi” scandagliano le immagini in più passaggi e possono essere molto accurati, ma spesso sono troppo lenti per l’uso in tempo reale su telecamere stradali o a bordo veicolo. I sistemi “a stadio unico” più recenti, come la famiglia YOLO (“You Only Look Once”), sacrificano un po’ di complessità per una velocità molto maggiore, rendendoli popolari nella pratica. Tuttavia, faticano ancora con veicoli piccoli, sovrapposti e con condizioni atmosferiche avverse che nascondono i dettagli. YOLO‑DC si basa sull’ultimo modello YOLOv8 e riprogetta i suoi strati interni per affrontare meglio queste sfide.

Come YOLO‑DC vede di più con una messa a fuoco più intelligente

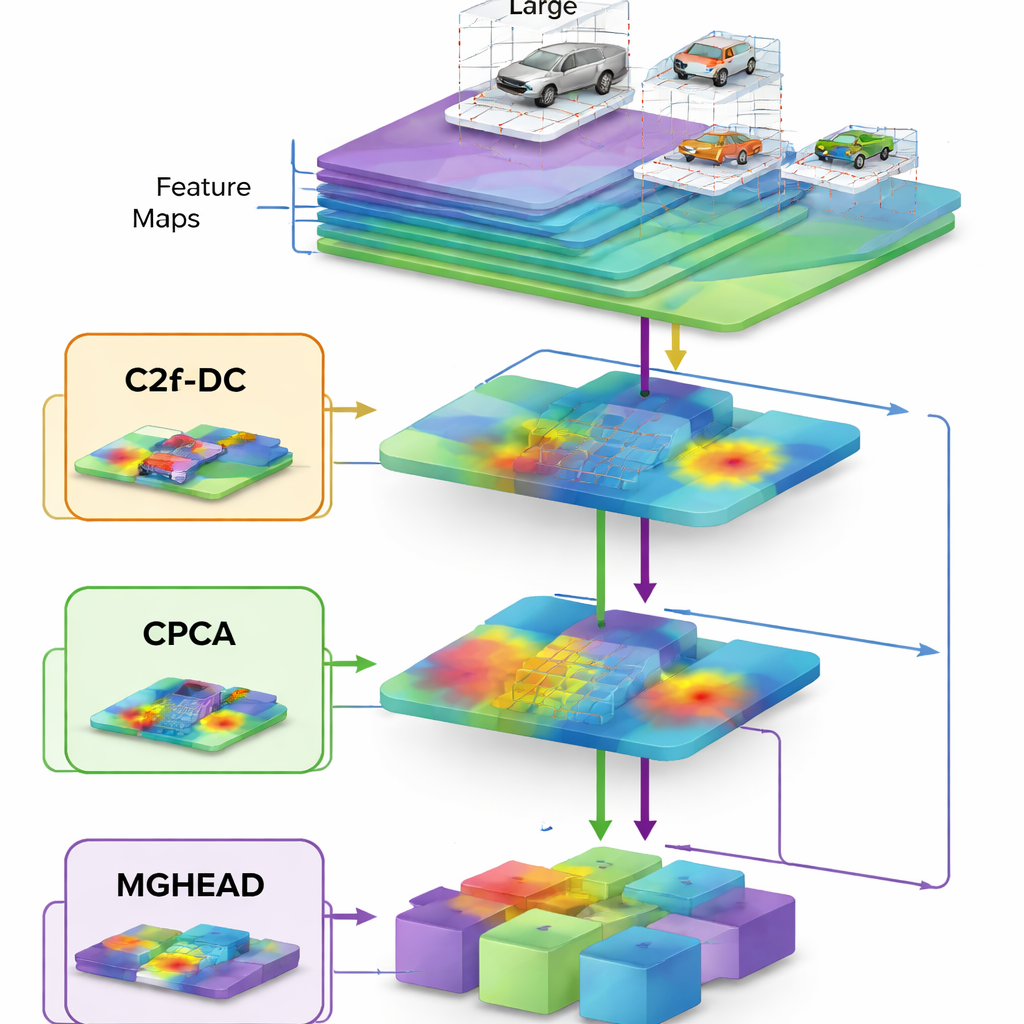

Al cuore di YOLO‑DC c’è una rete “backbone” rinnovata, la parte che per prima trasforma le immagini grezze in caratteristiche astratte. Gli autori introducono un meccanismo chiamato attenzione alle coordinate cross‑canale, che in pratica insegna alla rete non solo dove guardare nell’immagine ma anche quali tipi di pattern visivi meritano più peso. Combinata con le cosiddette convoluzioni deformabili — filtri che possono piegare il loro schema di campionamento per seguire veicoli inclinati o dalle forme insolite — questa backbone riesce ad adattarsi meglio ad automobili viste da angolazioni, scale e posizioni diverse. Invece di trattare ogni porzione di strada allo stesso modo, il sistema impara a enfatizzare i contorni e le texture rivelatori che distinguono i veicoli reali da edifici, alberi o segnaletica stradale.

Catturare veicoli piccoli e distanti senza rallentare

La parte centrale del modello, nota come neck, è responsabile della fusione delle informazioni da viste ampie e grossolane con dettagli ravvicinati e fini. YOLO‑DC potenzia questa fase in due modi. Primo, un modulo di attenzione con priorità per canale aiuta la rete a sopprimere il rumore e a evidenziare segnali sottili provenienti da veicoli minuscoli in lontananza nel fotogramma. Secondo, un blocco riprogettato ispirato all’architettura leggera FasterNet riduce il numero di operazioni applicando convoluzioni complete solo a una porzione dei dati e poi mescolandoli in modo efficiente. Questa riprogettazione attenta riduce sia il numero di parametri sia il traffico di memoria, permettendo al modello di funzionare più rapidamente migliorando al contempo l’accuratezza — una combinazione insolita ma molto desiderabile per dispositivi edge come telecamere del traffico e computer a bordo veicolo.

Vedere i veicoli su molte scale e con maltempo

Lo stadio finale, o head, decide dove si trovano gli oggetti e cosa sono. YOLO‑DC introduce qui convoluzioni raggruppate multi‑scala, dividendo le mappe di caratteristiche in diversi gruppi di canali che usano ciascuno dimensioni di filtro differenti prima di essere ricombinati. Questo conferisce al rilevatore una percezione della scala più ricca, così da riconoscere contemporaneamente autobus enormi che riempiono l’inquadratura, camion di medie dimensioni e auto piccolissime a malapena visibili in lontananza. In test estensivi sul dataset UA‑DETRAC, che contiene scene stradali in condizioni nuvolose, soleggiate, piovose e notturne, YOLO‑DC ha eguagliato o superato l’accuratezza dei rilevatori di fascia alta usando solo una frazione del loro costo computazionale e processando centinaia di fotogrammi al secondo su hardware moderno. Sul dataset DAWN, progettato specificamente per nebbia, pioggia, neve e tempeste di sabbia, il nuovo modello ha ottenuto guadagni particolarmente grandi in caso di pioggia intensa e nebbia densa, condizioni in cui i sistemi tradizionali spesso falliscono.

Cosa significano i risultati per le strade di tutti i giorni

Per i non esperti, il messaggio principale è che YOLO‑DC è più bravo a “vedere” il traffico reale com’è davvero: affollato, disordinato e spesso oscurato da maltempo o scarsa illuminazione. Combinando filtri flessibili che seguono le forme dei veicoli con meccanismi di attenzione che si concentrano sulle regioni più informative, il sistema rileva più veicoli, ne perde meno e gira abbastanza velocemente per l’analisi video in diretta su hardware modesto. Questo lo rende un elemento promettente per una gestione del traffico più intelligente, un monitoraggio degli incidenti più affidabile e una guida autonoma più sicura — il tutto mantenendo i costi di elaborazione abbastanza bassi da consentire una diffusione capillare per le strade cittadine e i veicoli futuri.

Citazione: Liu, Z., Zhu, M., Gao, B. et al. YOLO-DC for vehicle detection using deformable convolutional networks and cross-channel coordinate attention. Sci Rep 16, 6284 (2026). https://doi.org/10.1038/s41598-026-37094-w

Parole chiave: rilevamento veicoli, trasporto intelligente, YOLO, condizioni atmosferiche avverse, visione in tempo reale