Clear Sky Science · it

Divergenza di interpretazione nell’IA spiegabile in presenza di rumore nelle etichette

Perché le spiegazioni dell’IA possono sbagliarsi silenziosamente

Molte persone oggi si affidano all’intelligenza artificiale non solo per ottenere risposte, ma anche per capirne le ragioni: perché è stato negato un prestito? Perché un sistema ha classificato un paziente come ad alto rischio? Questo studio mostra che anche quando l’accuratezza di un modello di IA sembra rassicurantemente stabile, la storia che racconta sul perché ha preso una decisione può cambiare drasticamente se nei dati di addestramento sono presenti errori. Quel cambiamento nascosto nelle spiegazioni — che gli autori chiamano “divergenza di interpretazione” — potrebbe fuorviare i professionisti che si affidano all’IA per giustificare scelte importanti.

Quando dati puliti incontrano etichette disordinate

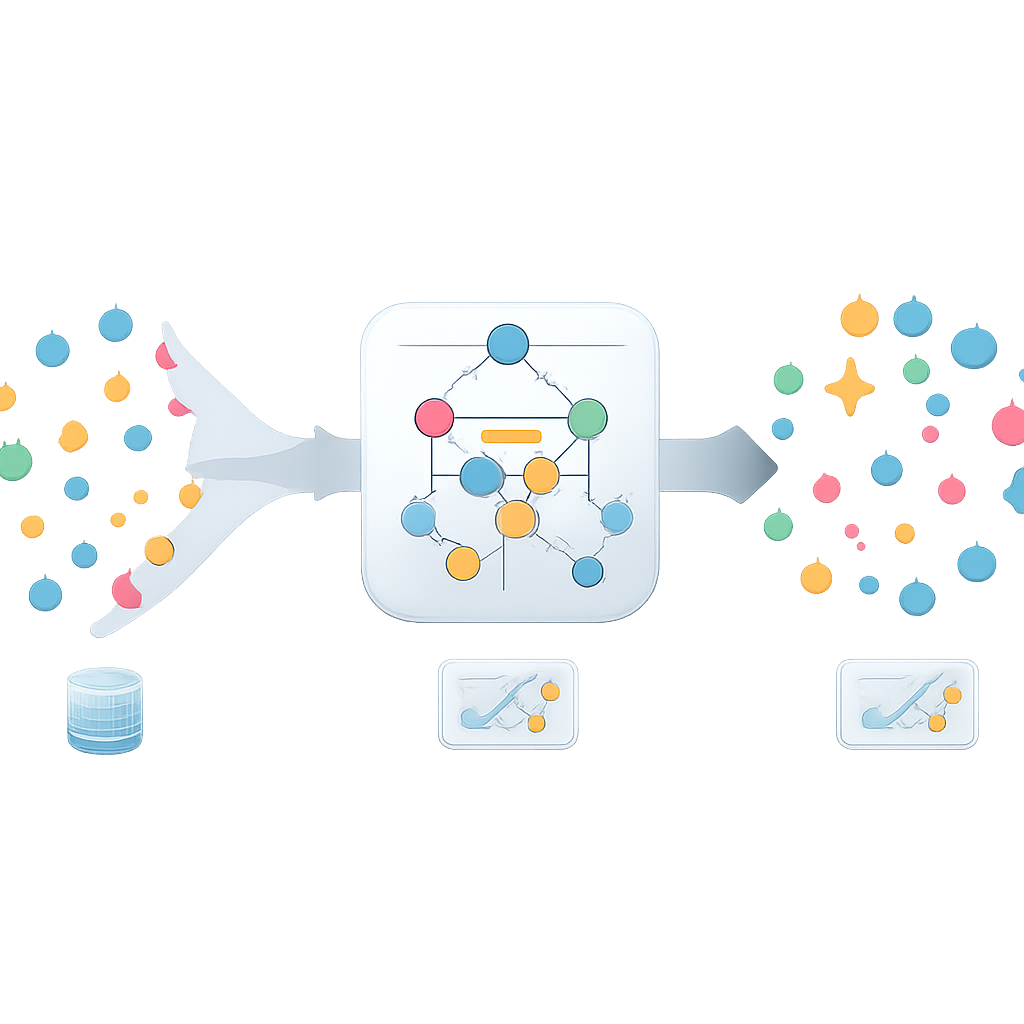

La maggior parte dei sistemi di IA moderni è una “scatola nera”, che fornisce predizioni senza motivazioni chiare. Per rendere l’IA più trasparente, molte applicazioni ricorrono a modelli basati su regole che assomigliano al ragionamento umano if–then: per esempio, “se la pressione sanguigna è alta e l’età è oltre 60 anni, allora il rischio è elevato.” Questi insiemi di regole sono particolarmente attraenti in ambiti sensibili come la sanità, la giustizia e la finanza, dove gli utenti devono poter ispezionare e fidarsi della logica. Ma i dati reali raramente sono perfetti. Un problema comune è il rumore nelle etichette — casi in cui la presunta “risposta corretta” nei dati di addestramento è sbagliata, come una diagnosi registrata in modo errato o un esito cliente etichettato male. Sebbene sia noto che il rumore nelle etichette danneggi la qualità delle predizioni, il suo impatto sulla stabilità delle spiegazioni dell’IA non era stato studiato in modo sistematico.

Testare la tenuta delle spiegazioni sotto rumore

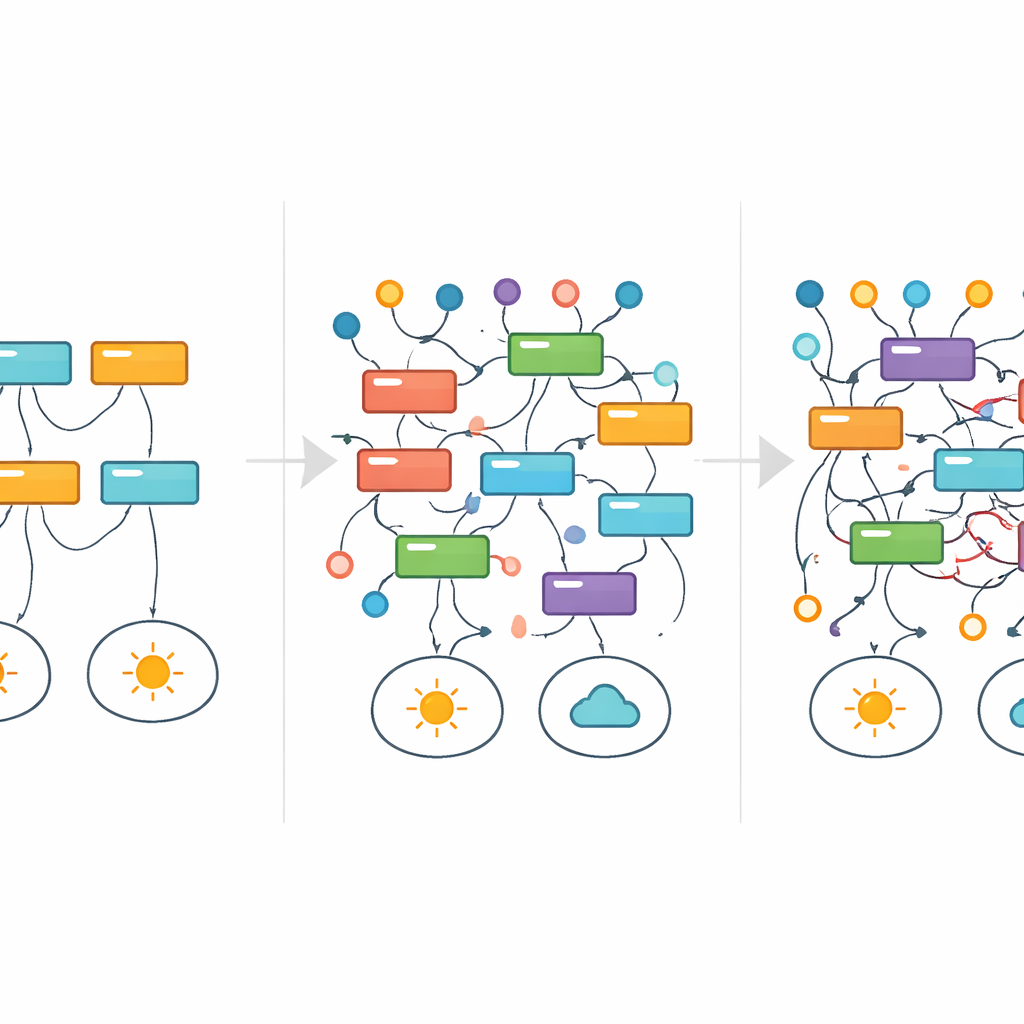

Gli autori hanno valutato quanto siano robuste le spiegazioni basate su regole quando le etichette vengono gradualmente corrotte. Hanno usato quattro dataset diversi provenienti da sanità, settore bancario, malattie epatiche e persino teoria dei numeri, tutti impostati come compiti di predizione sì/no. Sono stati confrontati tre metodi di apprendimento di regole: due algoritmi popolari e veloci (IREP e RIPPER) e un approccio più intensivo dal punto di vista computazionale chiamato Human Knowledge Models (HKM), che mira esplicitamente a produrre insiemi di regole molto semplici e simili a quelli umani. Per ciascun metodo, i ricercatori hanno addestrato ripetutamente i modelli ribaltando casualmente una frazione crescente delle etichette di addestramento — da dati quasi perfettamente puliti fino a quasi totale nonsenso. Hanno monitorato due aspetti in parallelo: quanto bene i modelli continuavano a predire su un set di test pulito e quanto le regole apprese cambiassero rispetto a quelle ottenute con dati privi di rumore.

Accuratezza stabile, logica in mutamento

In superficie, i risultati possono indurre gli utenti in un falso senso di sicurezza. Per livelli moderati di rumore, soprattutto con il metodo HKM, la performance predittiva sembrava relativamente stabile se misurata con il comune punteggio F1. Tuttavia, uno sguardo più attento agli insiemi di regole raccontava una storia diversa. Utilizzando una misura di similarità che confronta collezioni di regole, gli autori hanno constatato che anche quantità modeste di rumore nelle etichette erodevano rapidamente la sovrapposizione tra le spiegazioni originali e quelle ottenute con dati rumorosi. In altre parole, il modello poteva ancora essere corretto su molti casi, ma per ragioni sempre più diverse. Gli insiemi di regole più complessi erano particolarmente fragili: man mano che cresceva il numero di condizioni in una regola, piccole variazioni nei dati tendevano a fratturare o sostituire quelle regole, accelerando la perdita di stabilità interpretativa.

Seguire le regole mentre appaiono e scompaiono

Per visualizzare come le singole spiegazioni resistono o falliscono all’aumentare del rumore, i ricercatori hanno mutuato uno strumento dalla medicina: l’analisi di sopravvivenza. Invece di tracciare la sopravvivenza dei pazienti nel tempo, hanno tracciato per quanto tempo una particolare regola continuava ad apparire tra i migliori modelli mentre il rumore nelle etichette aumentava. Piuttosto che svanire lentamente, molte regole lampeggiavano dentro e fuori — segno che spiegazioni completamente diverse potevano dominare a livelli di rumore differenti, anche per lo stesso compito di base. In un semplice dataset sulla divisibilità dei numeri, per esempio, regole pulite e matematicamente corrette venivano gradualmente sostituite da approssimazioni più ampie e infine da schemi contorti e apparentemente arbitrari che comunque si adattavano alle etichette corrotte. Per gran parte di questo processo, le metriche di performance principali non segnalavano chiaramente che qualcosa non andava.

Cosa significa per chi si affida all’IA

Il messaggio centrale è che un’IA “affidabile” non può essere giudicata solo dall’accuratezza. Anche i modelli che presentano la loro logica in regole leggibili dall’uomo possono cambiare silenziosamente il loro ragionamento quando le etichette da cui apprendono sono imperfette — che è esattamente la situazione nella maggior parte dei database reali. Gli autori sostengono che sviluppatori e regolatori dovrebbero trattare la stabilità delle spiegazioni come un requisito di primo piano, accanto ad accuratezza e equità. Nuove metriche che misurino direttamente quanto rimangono coerenti le spiegazioni di un modello sotto rumore, e strumenti che avvisino gli utenti della divergenza di interpretazione, saranno essenziali se vogliamo sistemi di IA le cui storie sul mondo siano affidabili quanto le loro predizioni.

Citazione: Raikovskaia, A., Rakhimzhanov, N. & Pianykh, O.S. Interpretation drift in explainable AI under label noise. Sci Rep 16, 8528 (2026). https://doi.org/10.1038/s41598-026-37070-4

Parole chiave: IA spiegabile, rumore nelle etichette, interpretabilità del modello, modelli basati su regole, divergenza di interpretazione