Clear Sky Science · it

Valutare le vulnerabilità dei sistemi di gait mediante attacchi avversari generati con PPO e GAN

Perché ingannare un modello di camminata è importante

La maggior parte di noi riconosce amici e familiari dal modo in cui camminano, anche da lontano. Oggi i computer possono fare qualcosa di simile: i sistemi di “gait recognition” analizzano lo stile di camminata di una persona per identificarla senza impronte o scansioni facciali. Questi strumenti sono sempre più impiegati in ambito sicurezza e sorveglianza. Questo studio pone una domanda inquietante: quanto è facile ingannare tali sistemi usando piccole modifiche accuratamente progettate che gli esseri umani non noterebbero — ma che le macchine percepiscono? La risposta ha grandi implicazioni per la privacy, la sicurezza e il livello di fiducia che possiamo riporre nell’intelligenza artificiale in contesti ad alta criticità.

Come i computer interpretano il nostro modo di camminare

Il riconoscimento della deambulazione moderno si basa sul deep learning, la stessa famiglia di tecniche dietro al riconoscimento facciale e alle auto a guida autonoma. Piuttosto che analizzare un singolo fotogramma, questi sistemi combinano molte immagini di una persona che cammina in una singola “gait energy image”, una sorta di silhouette sfocata che cattura il movimento delle parti del corpo lungo un intero ciclo di passo. Una rete neurale progettata ad hoc impara quindi a distinguere la camminata di una persona da un’altra, anche quando cambiano abiti o oggetti portati. In test su due principali collezioni di ricerca di video di camminata (i dataset CASIA-B e OU-ISIR), il modello di riferimento degli autori ha identificato correttamente le persone in oltre il 97% dei casi — una prestazione elevata che potrebbe suggerire che la tecnologia sia pronta per un impiego reale.

Gli adesivi invisibili che ingannano le telecamere intelligenti

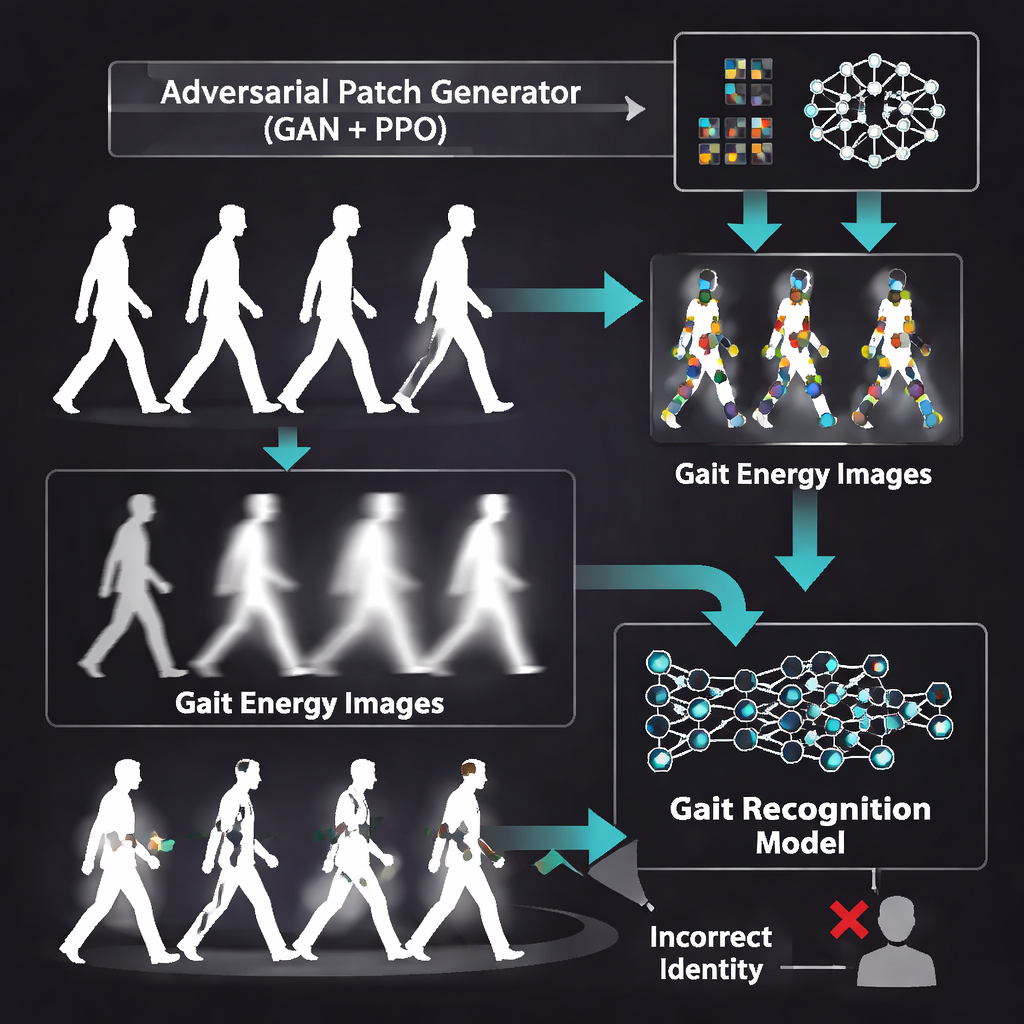

Il nucleo dell’articolo non è costruire un sistema di identificazione migliore, ma romperlo intenzionalmente per mettere in luce le debolezze. I ricercatori generano piccole “patch avversarie” — regioni quadrate di pixel alterati che sembrano innocue, ma sono matematicamente ottimizzate per confondere la rete neurale. Per creare queste patch usano una Generative Adversarial Network (GAN), una forma di IA che impara a produrre immagini dall’aspetto realistico competendo contro un critico interno. La GAN è addestrata direttamente sulle gait energy image in modo che la sua produzione si integri naturalmente nelle silhouette spettrali. Queste patch sono progettate per essere sufficientemente sottili da non attirare l’attenzione di un osservatore umano che guardi il pattern di camminata.

Lasciare che un agente apprendista trovi i punti deboli

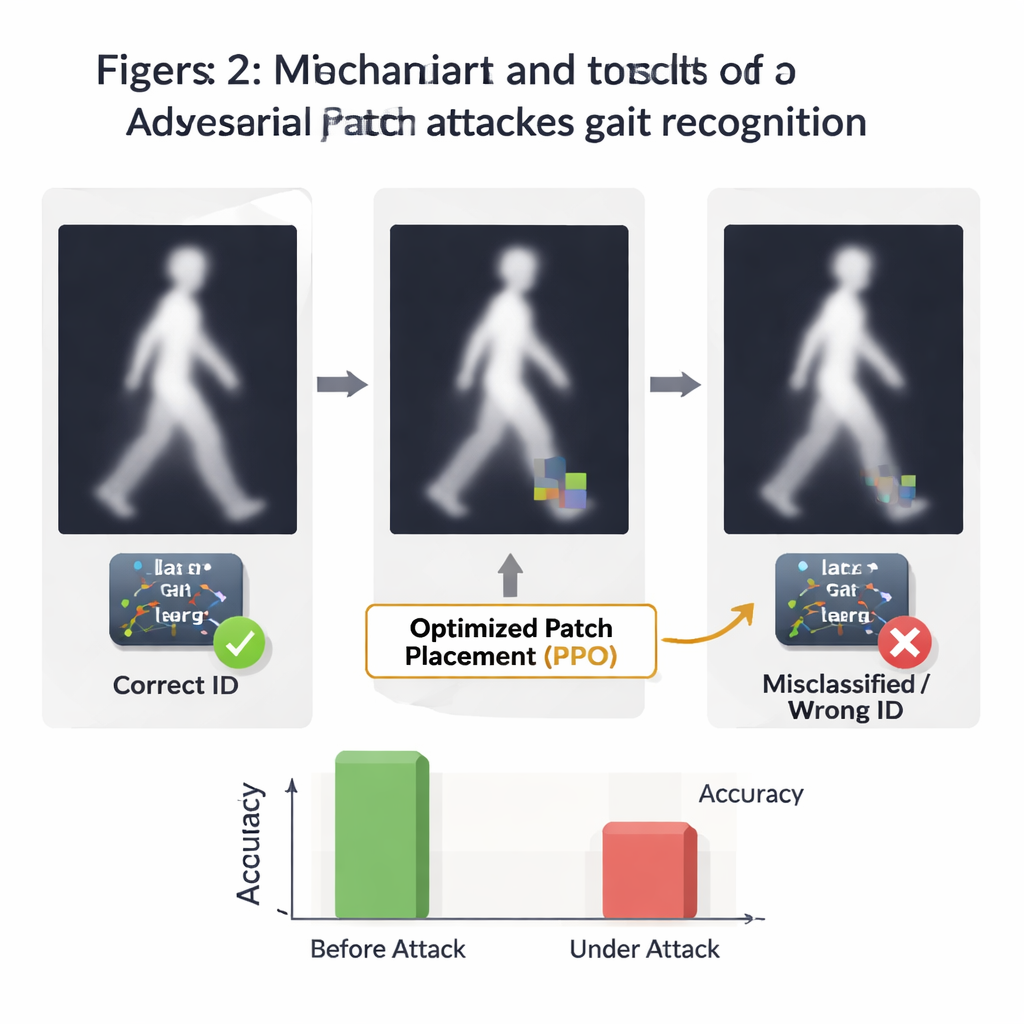

Dove viene posizionata una patch può essere importante quanto il suo aspetto. Per scoprire le posizioni più dannose, gli autori ricorrono a un metodo di apprendimento per rinforzo chiamato Proximal Policy Optimization (PPO). Trattano ogni immagine di gait come un ambiente a griglia e lasciano che un “agente” software muova la patch — su, giù, sinistra o destra — osservando quanto cala la fiducia del sistema di riconoscimento. Quando una posizione induce il modello a identificare erroneamente la persona, l’agente viene ricompensato; quando fallisce, viene penalizzato. Dopo molti episodi, l’agente impara una politica per collocare le patch in regioni particolarmente vulnerabili dell’immagine di gait, spesso vicino alle parti del corpo in movimento su cui il modello fa maggior affidamento.

Cosa succede quando l’attacco viene scatenato

Dopo aver addestrato sia il generatore di patch sia la strategia di posizionamento, il team attacca il proprio riconoscitore di gait ad alte prestazioni. In condizioni normali il sistema mostra un’ottima accuratezza, pochi falsi allarmi e una forte separazione tra corrispondenze corrette e errate. Quando vengono aggiunte le patch avversarie, però, le prestazioni crollano rapidamente. A seconda di quanto aggressivamente la patch può muoversi sull’immagine, i tassi di successo dell’attacco superano il 60% e la frazione di persone identificate correttamente può scendere fino a quasi un terzo del livello originale. Curve che una volta mostravano una discriminazione quasi perfetta tra utenti genuini e impostori si inclinano verso la linea del caso, rivelando quanto facilmente il modello possa essere fuorviato senza distorsioni visibili.

Implicazioni per la sicurezza di tutti i giorni

Per i non specialisti, la conclusione è chiara: un sistema di riconoscimento della deambulazione che appare molto accurato in laboratorio può rivelarsi sorprendentemente fragile di fronte a manomissioni intelligenti progettate dalle macchine. Lo studio mostra che combinare strumenti generativi con apprendimento per tentativi ed errori può produrre modifiche piccole e quasi invisibili che causano gravi errori di identificazione. Piuttosto che una guida per un uso malevolo nel mondo reale, il lavoro vuole essere un avvertimento e un quadro di test. Fornisce ai progettisti di sistemi un modo per sondare e misurare quanto i loro modelli siano vulnerabili e sottolinea l’urgenza di costruire difese contro tali attacchi prima che il riconoscimento della gait sia ampiamente adottato per sorveglianza, controllo degli accessi o altre applicazioni critiche.

Citazione: Saoudi, E.M., Jaafari, J. & Jai Andaloussi, S. Evaluating gait system vulnerabilities through PPO and GAN-generated adversarial attacks. Sci Rep 16, 6039 (2026). https://doi.org/10.1038/s41598-026-37011-1

Parole chiave: riconoscimento della deambulazione, sicurezza biometrica, attacchi avversari, deep learning, apprendimento per rinforzo