Clear Sky Science · it

Valutazione comparativa di modelli di riconoscimento delle azioni per la rilevazione dell’autolesionismo in set di dati di studio e del mondo reale

Sorvegliare i pazienti con occhi digitali

Negli ospedali psichiatrici, gli infermieri lavorano instancabilmente per mantenere i pazienti al sicuro, soprattutto quelli a rischio di farsi del male. Eppure anche il personale più dedicato non può controllare ogni stanza, ogni secondo. Questo studio esplora se l’intelligenza artificiale (IA) può aiutare scansionando automaticamente i video delle telecamere di reparto per individuare segnali precoci di autolesionismo, offrendo un livello aggiuntivo di protezione senza sostituire l’assistenza umana.

Perché l’autolesionismo è così difficile da cogliere

L’autolesionismo — qualsiasi lesione intenzionale che una persona infligge a se stessa — spesso avviene in istanti brevi e nascosti: un graffio rapido sotto una coperta, o un piccolo oggetto usato fuori dalla vista. I reparti psichiatrici si affidano a controlli regolari e alla videosorveglianza, ma punti ciechi, affaticamento del personale e organici ridotti di notte o nei giorni festivi rendono la vigilanza continua impossibile. Allo stesso tempo, registrare e condividere filmati reali dei pazienti solleva gravi problemi di privacy ed etica. Di conseguenza, i ricercatori hanno avuto pochissimi video realistici per addestrare i sistemi di IA che potrebbero rilevare comportamenti pericolosi in tempo reale.

Costruire banchi di prova più sicuri per l’IA

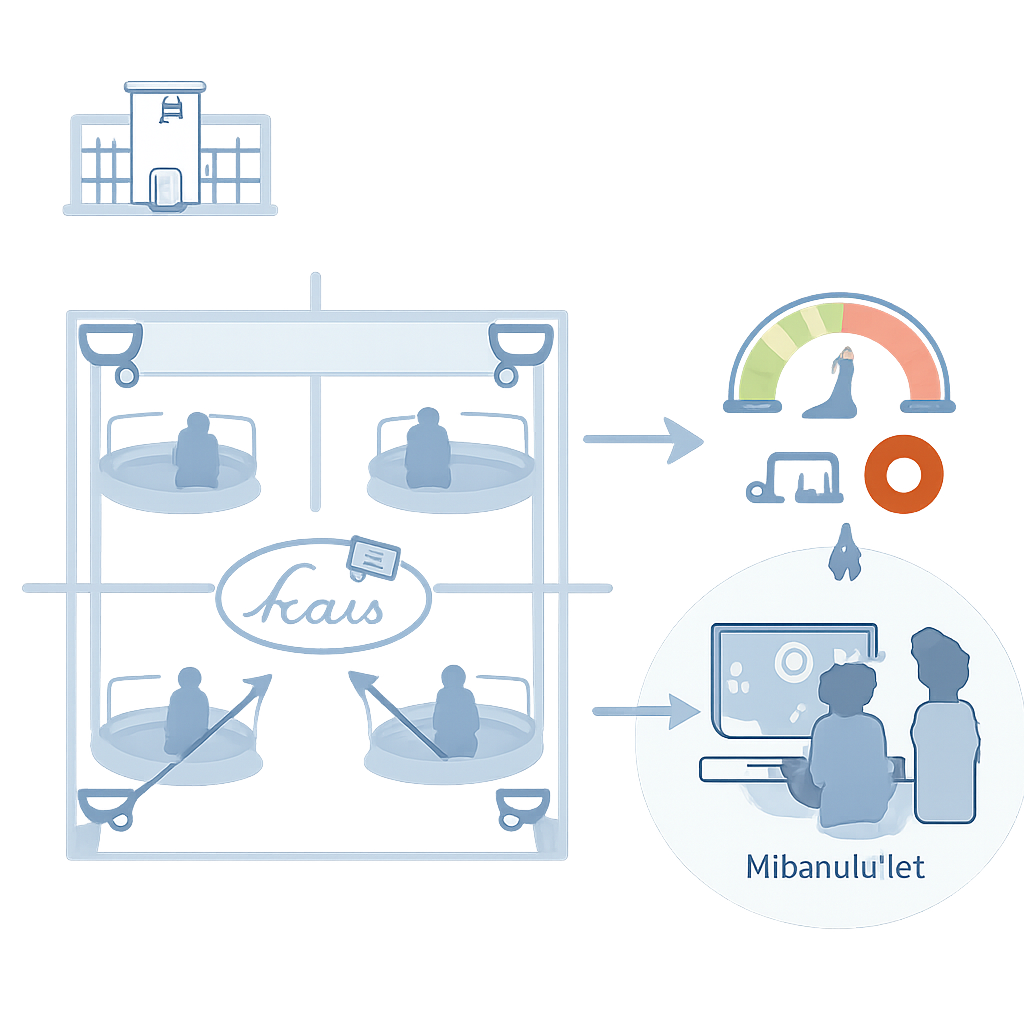

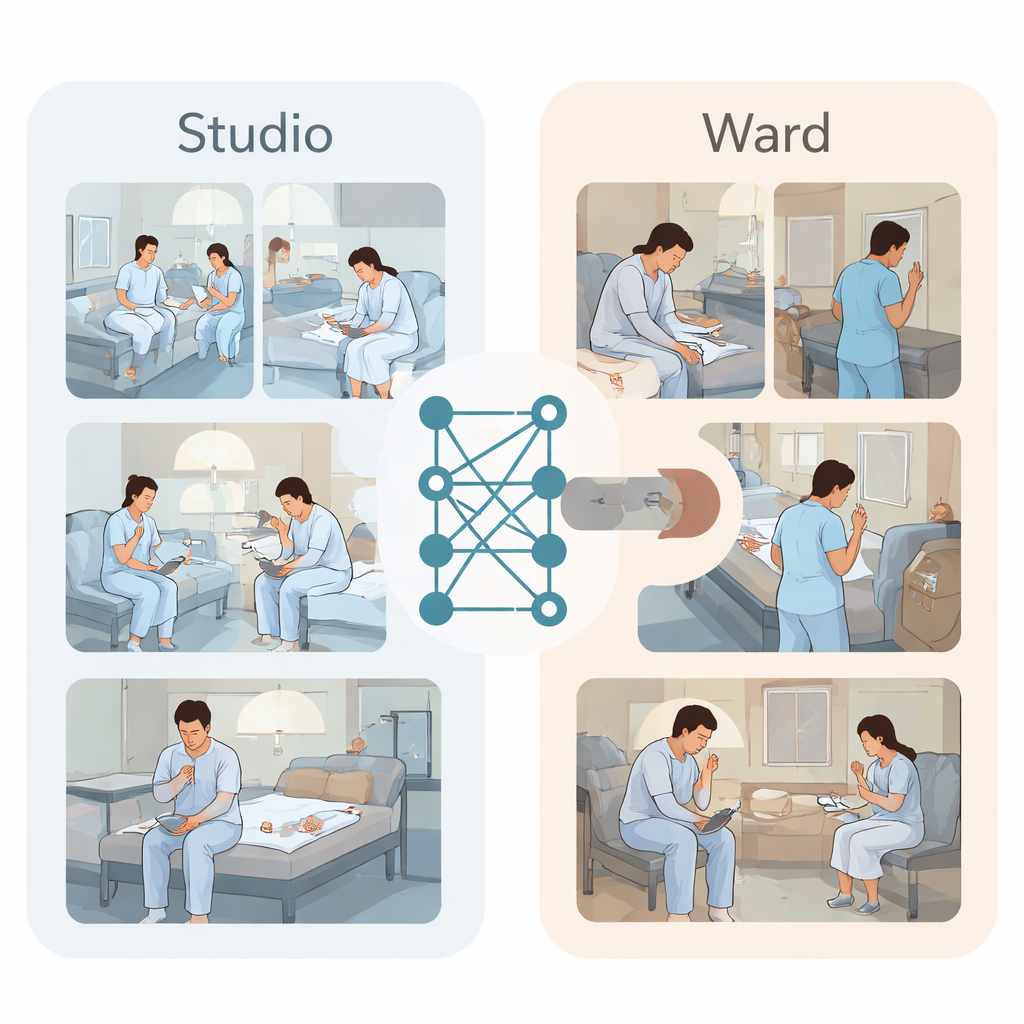

Per sbloccare questa situazione, i ricercatori hanno creato due tipi di set di dati video. Primo, in uno studio ricostruito per assomigliare a una stanza psichiatrica a quattro letti, sette giovani attori in camice da paziente hanno eseguito scene pianificate con cura. Hanno cercato oggetti di uso quotidiano come tappi di plastica, stick per le labbra o piccoli chiodi, quindi hanno recitato brevi sequenze di movimenti autolesivi su polso, avambraccio o coscia, con telecamere dall’alto che registravano da tutti gli angoli. Esperti hanno etichettato ogni segmento video come comportamento normale o autolesionismo, creando una raccolta pulita e bilanciata di 1120 clip. In secondo luogo, il team ha raccolto filmati di sorveglianza reali da reparti psichiatrici protetti per dieci mesi. I clinici hanno cercato nelle cartelle cliniche annotazioni su comportamenti come grattarsi, scavare o tagliarsi e poi hanno rintracciato i video corrispondenti. Dopo aver sfocato i volti e rimosso dettagli identificativi, hanno assemblato 59 clip che mostravano autolesionismo reale e 59 clip normali per il confronto.

Mettere alla prova le migliori IA video odierne

Con questi set di dati a disposizione, il team ha valutato i principali sistemi di riconoscimento delle azioni — programmi informatici progettati per capire cosa fanno le persone in un video. Alcuni si basavano su reti convoluzionali più datate, che analizzano brevi sequenze di fotogrammi, mentre modelli più recenti basati su transformer utilizzano meccanismi di attenzione per collegare pattern nello spazio e nel tempo. Tutti i modelli sono stati addestrati soltanto sui video di studio per decidere se una clip mostrasse autolesionismo o comportamento normale. È importante sottolineare che i ricercatori hanno usato uno schema di test rigoroso: in ogni round, tutte le clip di un attore venivano tenute fuori come dati di test completamente nuovi, assicurando che gli algoritmi non potessero semplicemente memorizzare persone specifiche.

Quando i video puliti di laboratorio incontrano la realtà disordinata

Sui filmati ordinati di studio, il modello transformer più avanzato, chiamato VideoMAEv2, si è distinto. Bilanciava correttamente mancate rilevazioni e falsi allarmi meglio degli altri, raggiungendo un punteggio F1 (una misura combinata di precisione e richiamo) di circa 0,65, mentre metodi più semplici si aggiravano vicino al caso. Le spiegazioni visive mostravano che questo modello si concentrava strettamente sul punto in cui uno strumento incontrava la pelle, invece di distrarsi per il movimento dello sfondo. Ma una volta che gli stessi sistemi addestrati sono stati applicati ai filmati reali del reparto — senza alcun riaddestramento — le prestazioni sono diminuite. VideoMAEv2 ha comunque fatto meglio del caso, con un F1 intorno a 0,61, ma ha avuto difficoltà soprattutto con comportamenti sottili come scavarsi e grattarsi che non erano mai comparsi nei dati simulati, e con pazienti di piccola statura, lontani dalla telecamera o parzialmente nascosti.

Cosa significa per la sicurezza dei pazienti

Nel complesso, i risultati mostrano chiaramente un divario “dalla simulazione alla realtà”. I sistemi di IA che sembrano promettenti su video accuratamente messi in scena possono vacillare quando affrontano il disordine, gli angoli strani e i comportamenti variabili della vita ospedaliera reale. Il contributo principale dello studio non è un prodotto di sicurezza finito ma un punto di partenza: un dataset di studio pubblico e ben annotato, un set di test del mondo reale raccolto con cura e un benchmark trasparente che mostra dove i metodi attuali si guastano. Per i non specialisti, il messaggio è semplice: l’IA può già aiutare a evidenziare momenti sospetti nei flussi video dei reparti, ma non può ancora essere considerata un guardiano autonomo. Colmare questo divario richiederà dati di addestramento più ricchi e diversificati e modelli più intelligenti, sviluppati con privacy, equità e giudizio clinico al centro.»

Citazione: Lee, K., Lee, D., Ham, HS. et al. Benchmarking action recognition models for self-harm detection in studio and real-world datasets. Sci Rep 16, 6850 (2026). https://doi.org/10.1038/s41598-026-36999-w

Parole chiave: rilevazione dell’autolesionismo, reparti psichiatrici, riconoscimento di azioni video, intelligenza artificiale in sanità, sicurezza del paziente