Clear Sky Science · it

Esplorare il riconoscimento delle emozioni degli studenti e il feedback didattico degli insegnanti in aula di lingua straniera universitaria basato sul modello AFCNN

Perché il tuo insegnante potrebbe presto “leggere” l’aula con l’IA

Chiunque abbia seguito una lezione noiosa sa che la noia può silenziosamente uccidere l’apprendimento. Eppure gli insegnanti spesso possono fare affidamento solo sull’intuizione per indovinare come gli studenti si sentono in quel momento. Questo studio esplora un nuovo modo per fornire agli insegnanti universitari di lingue straniere una sorta di “cruscotto emotivo” alimentato dall’intelligenza artificiale (IA). Leggendo in tempo reale le espressioni facciali degli studenti, il sistema aiuta gli insegnanti ad adattare l’insegnamento sul momento e, nel lungo periodo, supporta la loro crescita professionale.

Le emozioni contano quanto la grammatica

Le lezioni di lingua straniera non riguardano solo liste di vocaboli e regole grammaticali. Sono spazi sociali dove fiducia, ansia, curiosità e noia influenzano il modo in cui gli studenti apprendono. Ricerche passate hanno mostrato che la formazione degli insegnanti si concentra di solito su metodi e conoscenze disciplinari prestando meno attenzione alle emozioni in classe. Strumenti tradizionali, come indagini di fine semestre o colloqui post‑lezione, arrivano troppo tardi per salvare una lezione in difficoltà. Gli autori sostengono che se gli insegnanti potessero vedere come le emozioni cambiano minuto per minuto, potrebbero rispondere più rapidamente—accelerando, rallentando o cambiando attività prima che gli studenti si disimpegnino mentalmente.

Trasformare i volti in segnali utili

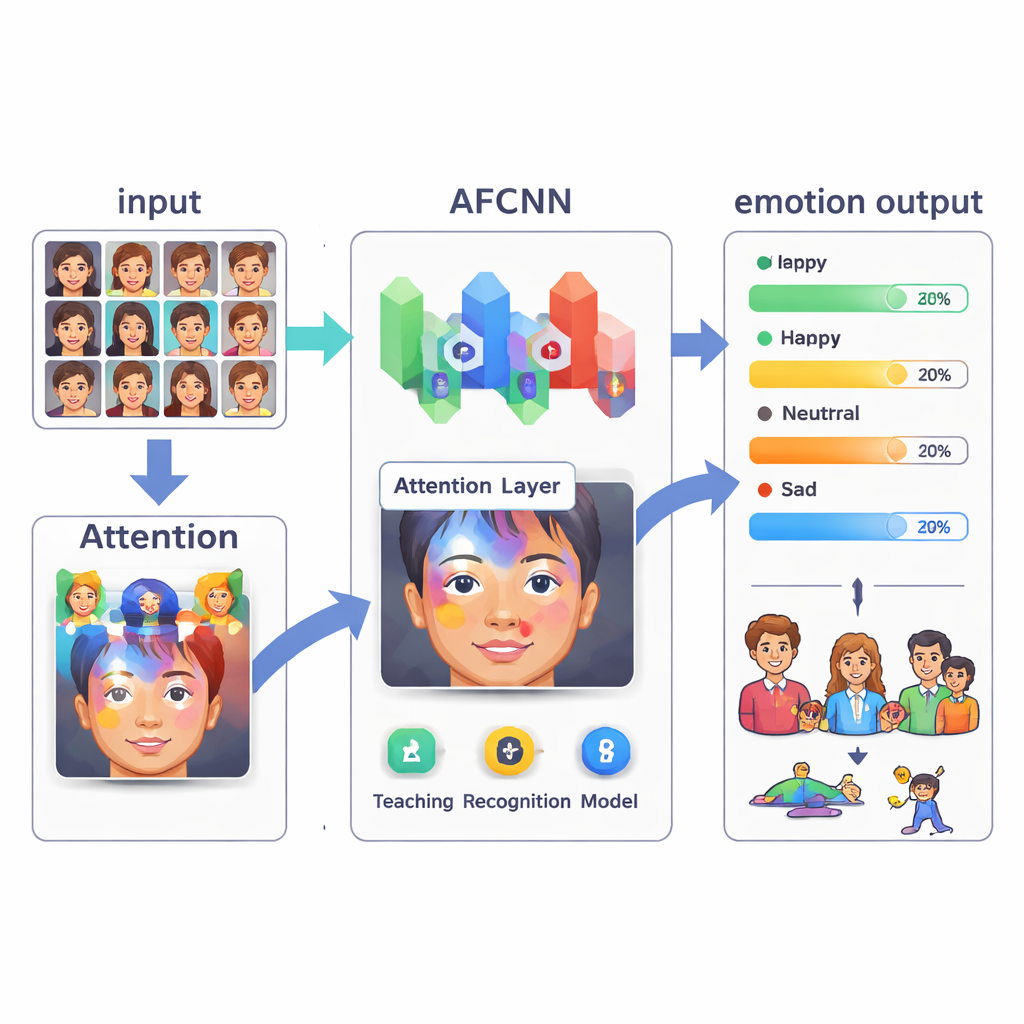

Il cuore dello studio è un modello di deep learning chiamato Attention Feature Convolutional Neural Network, o AFCNN. In termini semplici, una telecamera in aula cattura i volti degli studenti mentre apprendono. Il modello poi segue tre fasi: individua ogni volto, estrae caratteristiche legate alle espressioni e le classifica in una delle sette emozioni di base, come felicità, tristezza, paura o uno stato neutro. Un meccanismo di “attenzione” speciale aiuta l’IA a concentrarsi sulle parti del volto più informative—come occhi o bocca—ignorando distrazioni. A differenza di approcci più vecchi che funzionano meglio con foto pulite e frontali, questo sistema è progettato per gestire condizioni più realistiche, come viste parziali, mani sul volto o studenti che guardano di lato.

Quanto funziona realmente il sistema

Per testare l’AFCNN, i ricercatori lo hanno addestrato su una nota raccolta di immagini facciali etichettate con categorie emotive e hanno ampliato i dati con semplici modifiche come rotazioni e variazioni di luminosità. Hanno poi confrontato le sue prestazioni con due modelli consolidati di riconoscimento delle immagini, VGG16 e ResNet18. In condizioni chiare senza ostruzioni, il nuovo modello ha identificato correttamente le emozioni circa l’81% delle volte ed è risultato particolarmente efficace nel riconoscere espressioni di felicità e stato neutro, raggiungendo intorno alla metà degli anni ’80 in termini di accuratezza. Quando i volti erano parzialmente coperti—da capelli, mani o cappelli—l’accuratezza è calata per tutti i sistemi, ma l’AFCNN ha comunque sovraperformato gli altri e ha mostrato risultati più bilanciati tra le diverse emozioni, suggerendo che è più robusto per le aule reali.

Dai rilevamenti emotivi a lezioni migliori

Lo studio va oltre la semplice accuratezza e si chiede se questa tecnologia migliori effettivamente l’insegnamento. In una prova di un mese con 200 insegnanti universitari di lingue straniere, la metà ha usato il sistema di riconoscimento emotivo e l’altra metà ha insegnato come di consueto. Gli insegnanti con accesso al feedback emotivo in tempo reale hanno modificato i loro piani didattici più del doppio delle volte durante una lezione, hanno riferito maggiore soddisfazione per il loro insegnamento e hanno osservato un aumento della partecipazione e dell’interazione degli studenti. I ricercatori hanno anche progettato una mappatura semplice dai pattern emotivi a risposte suggerite—per esempio, passare a discussione o ripasso quando compaiono segnali di confusione o frustrazione—spostando il sistema dall’osservare semplicemente le emozioni a guidare attivamente il comportamento.

Cosa significa per le aule future

In termini pratici, questa ricerca suggerisce che le aule del futuro potrebbero avere un assistente discreto che osserva i volti degli studenti e sussurra all’insegnante quando la stanza perde energia o quando molti studenti sembrano confusi. Il sistema AFCNN non è perfetto—fa ancora fatica con emozioni sottili come disgusto o paura, e dipende da immagini etichettate di alta qualità—ma dimostra che l’IA può cogliere in modo affidabile tendenze emotive e che gli insegnanti possono usare queste informazioni per insegnare in modo più reattivo. Per gli studenti, ciò potrebbe significare lezioni più coinvolgenti e di supporto; per gli insegnanti, offre un nuovo strumento per lo sviluppo professionale che fonde psicologia, istruzione e IA in un ambiente di apprendimento più intelligente e consapevole dell’aspetto umano.

Citazione: Shi, L. Exploring students’ emotion recognition and teachers’ teaching feedback in college foreign language classroom based on AFCNN model. Sci Rep 16, 5657 (2026). https://doi.org/10.1038/s41598-026-36747-0

Parole chiave: riconoscimento delle emozioni in aula, IA nell'istruzione, insegnamento delle lingue straniere, sviluppo professionale degli insegnanti, modelli di deep learning