Clear Sky Science · it

Algoritmo di ottimizzazione secante per l’ottimizzazione globale efficiente

Ricerca più intelligente per problemi difficili

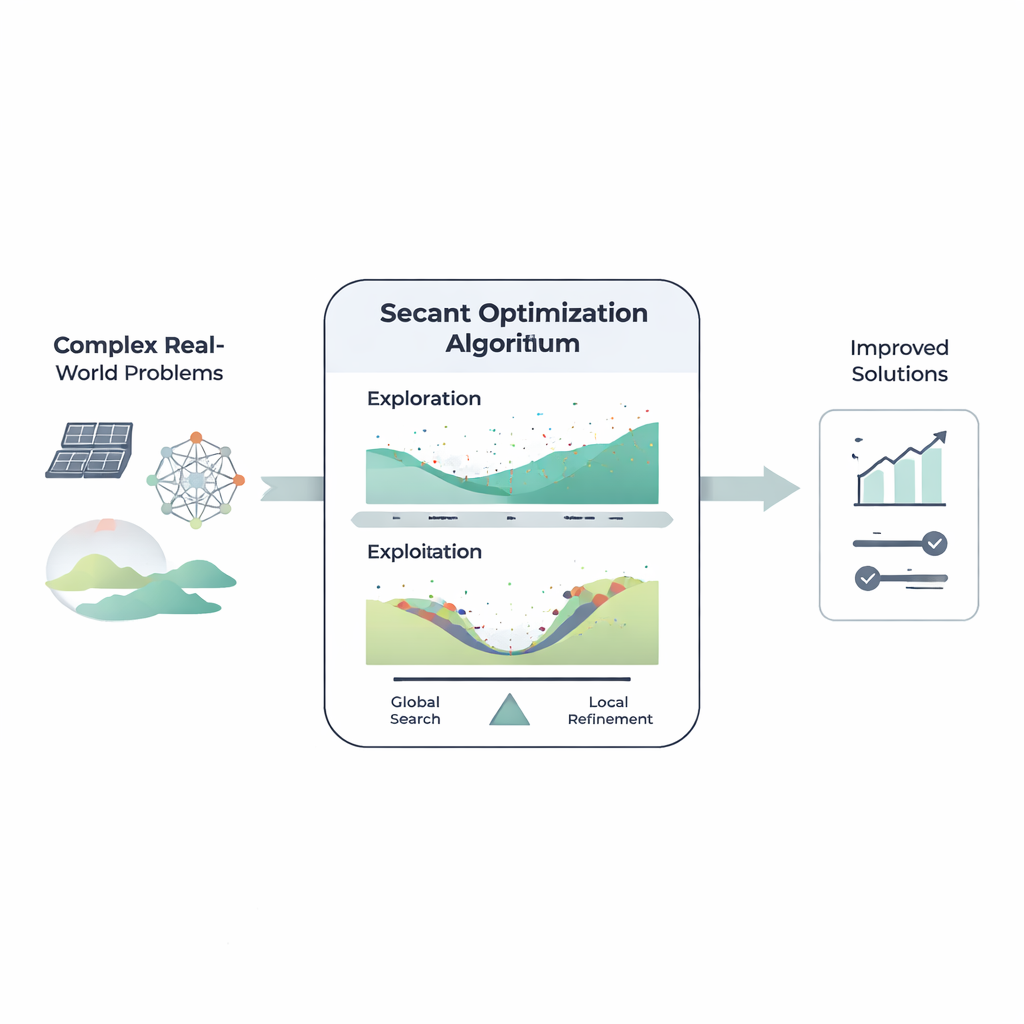

Dalla progettazione di pannelli solari più puliti all’addestramento di sistemi di riconoscimento delle immagini accurati, molte delle sfide odierne si riducono allo stesso compito: esplorare uno spazio enorme di possibilità per trovare una buona soluzione. Questo articolo presenta il Secant Optimization Algorithm (SOA), un nuovo modo di condurre quella ricerca in modo più efficiente. Ispirato a un’idea classica del calcolo ma progettato per dati del mondo reale, spesso rumorosi, SOA punta a essere sia rapido sia affidabile quando i metodi tradizionali incontrano difficoltà.

Perché l’ottimizzazione ha bisogno di nuove idee

I problemi dell’ingegneria moderna e della scienza dei dati spesso coinvolgono decine o centinaia di parametri regolabili, obiettivi multipli e relazioni intrecciate difficili da esprimere con formule semplici. Le tecniche classiche che seguono gradienti esatti, come la discesa più ripida, possono fallire quando il paesaggio è irregolare, pieno di trappole locali, oppure quando le derivate sono difficili o impossibili da calcolare. In risposta, i ricercatori hanno sviluppato algoritmi “metaeuristici” che imitano la natura, la fisica o la matematica per esplorare questi spazi complessi. Questi metodi, come gli algoritmi genetici o gli ottimizzatori a sciame, si sono dimostrati notevolmente versatili ma affrontano ancora compromessi tra l’esplorazione ampia e la ricerca precisa.

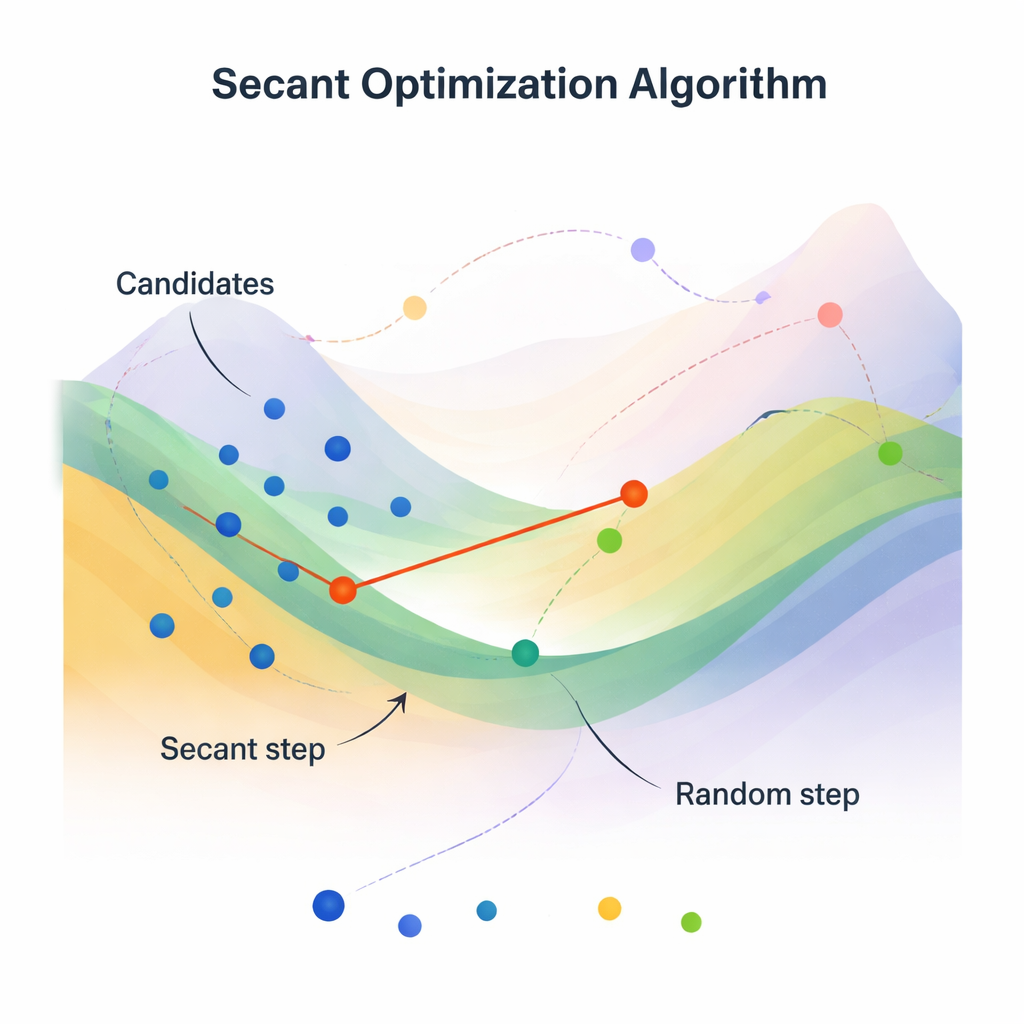

Trasformare un trucco da manuale in un motore di ricerca

Il cuore di SOA è il metodo delle secanti, un vecchio trucco numerico per trovare dove una curva attraversa lo zero senza bisogno di derivate esatte. Piuttosto che usare una pendenza calcolata dal calcolo differenziale, il metodo delle secanti traccia una linea retta tra due punti vicini sulla curva e usa quella linea come pendenza approssimativa. SOA generalizza questa idea a molte dimensioni e a molti candidati contemporaneamente. Mantiene una popolazione di vettori (possibili soluzioni) e la aggiorna ripetutamente usando passi simili alle secanti che approssimano la tendenza della funzione obiettivo, ma basandosi solo sui valori della funzione. Questo rende il metodo interessante in contesti dove i gradienti sono rumorosi, costosi o non definiti, come nella messa a punto degli iperparametri di reti neurali osservando l’errore di validazione.

Bilanciare ampia esplorazione e messa a fuoco precisa

La progettazione di SOA separa esplicitamente come esplora e come affina le soluzioni. Nella fase di esplorazione, ogni candidato viene aggiustato usando una regola basata sulla secante che combina informazioni dalla soluzione attuale migliore, dal vettore corrente e da un pari scelto casualmente. Questo aiuta a dirigere la ricerca in direzioni che appaiono promettenti, senza essere puramente casuale. Nella fase di sfruttamento, SOA introduce un “fattore di espansione” e una casualità controllata. Spinge le soluzioni verso il migliore, la media, i punti più vicini e persino i più lontani della popolazione, e mescola camminate casuali. Una semplice regola di mutazione mantiene occasionalmente una posizione vecchia invece di adottare quella nuova, preservando la diversità. Insieme, queste meccaniche aiutano SOA a sfuggire alle trappole locali pur concentrandosi su soluzioni di alta qualità.

Test su benchmark e dispositivi reali

Per verificare se SOA sia più di una bella idea teorica, gli autori lo testano su famiglie di benchmark ampiamente usate note come CEC2021 e CEC2020. Queste funzioni sono progettate per essere impegnative: alcune sono a bassa dimensione ma piene di falsi minimi; altre arrivano a 50 o 100 dimensioni. In questi test, SOA viene confrontato con due gruppi di algoritmi concorrenti, inclusi 11 metodi ispirati alla matematica e 9 ottimizzatori recenti o in variante. Usando statistiche come errore medio, variabilità, curve di convergenza e test basati sui ranghi, SOA in modo consistente eguaglia o supera la maggior parte degli avversari, particolarmente nel raggiungere soluzioni buone in modo rapido e affidabile. Gli autori passano poi dai test sintetici a due compiti reali esigenti: stimare parametri chiave nei modelli fotovoltaici (PV) e ottimizzare automaticamente gli iperparametri di reti neurali convoluzionali per vari dataset di immagini.

Dai pannelli solari alle reti neurali

Nell’energia solare, modelli accurati delle celle e dei moduli fotovoltaici sono essenziali per prevedere la produzione e ottimizzare il funzionamento. Il team applica SOA a diversi modelli PV standard, inclusi modelli a singolo diodo, a doppio diodo e descrizioni complete del modulo. Usando dati misurati corrente–tensione, SOA aggiusta i parametri del modello per minimizzare l’errore e dimostra di ottenere un errore quadratico medio pari o inferiore rispetto a una serie di ottimizzatori consolidati. Negli esperimenti di machine learning, SOA viene impiegato per sintonizzare l’architettura e i parametri di addestramento di una rete neurale convoluzionale su MNIST e dataset di immagini correlati. Anche qui, l’algoritmo trova combinazioni di iperparametri che offrono accuratezze di classificazione competitive o superiori rispetto ad altre strategie di ricerca automatizzata.

Cosa significa nella pratica

Per i non specialisti, il messaggio principale è che SOA offre un nuovo “motore di ricerca” pratico per problemi di ottimizzazione difficili in cui il paesaggio è irregolare e i gradienti non sono disponibili. Prendendo in prestito la geometria del metodo delle secanti e integrandola in una ricerca basata su popolazione con casualità ben bilanciata, l’algoritmo spesso converge più rapidamente e con maggiore accuratezza rispetto a molte alternative attuali. Poiché è relativamente semplice, privo di derivate e con pochi parametri da tarare, SOA può essere inserito in una varietà di applicazioni — dalla progettazione di sistemi solari più efficienti alla configurazione di modelli di deep learning — rendendolo un’aggiunta promettente alla cassetta degli attrezzi per ingegneri e data scientist.

Citazione: Ibrahim, M.Q., Qaraad, M., Hussein, N.K. et al. Secant Optimization Algorithm for efficient global optimization. Sci Rep 16, 6659 (2026). https://doi.org/10.1038/s41598-026-36691-z

Parole chiave: ottimizzazione globale, algoritmi metaeuristici, algoritmo di ottimizzazione secante, modellazione fotovoltaica, ottimizzazione di iperparametri