Clear Sky Science · it

Un quadro automatizzato per l’educazione coranica dei non udenti tramite classificazione delle pose corporee e integrazione della Lingua dei Segni araba

Aprire un testo sacro alle voci silenziose

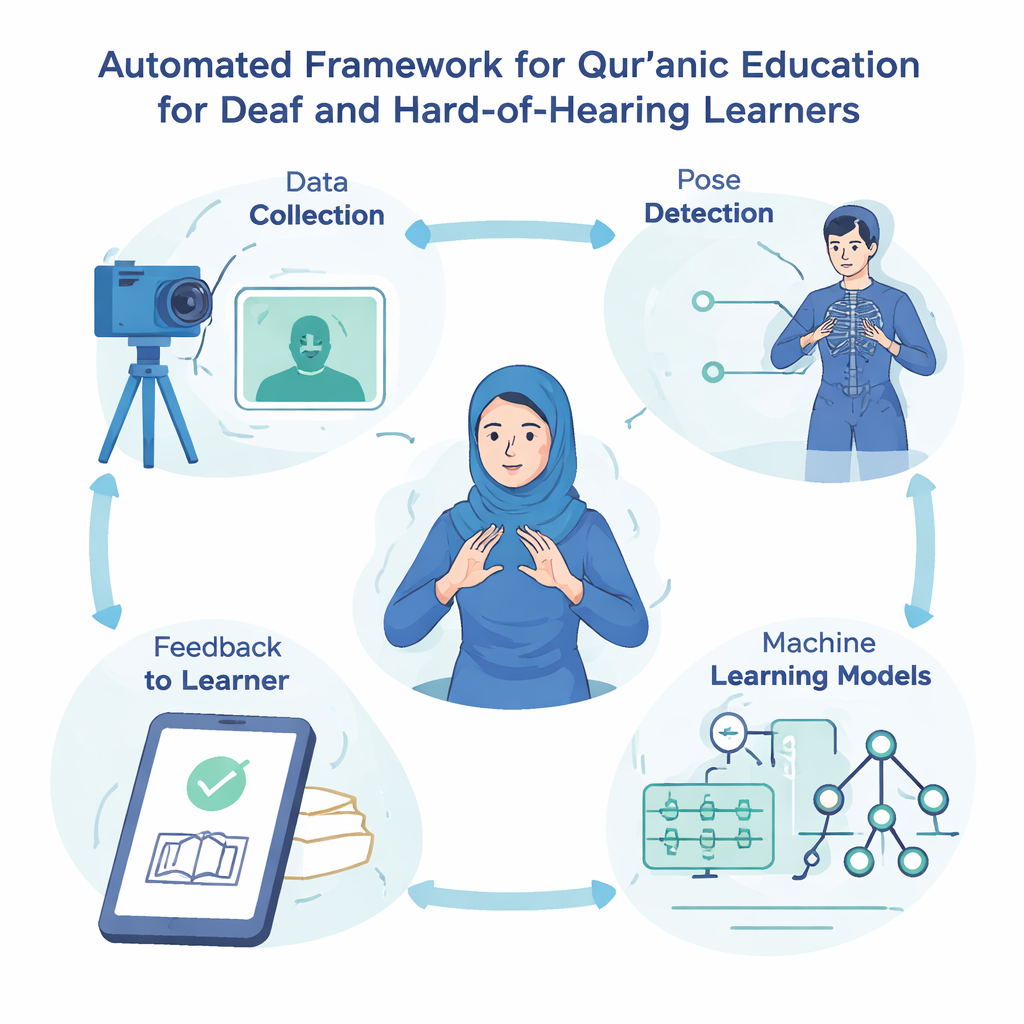

Per molti musulmani sordi e con problemi di udito, imparare a recitare il Qur’an può essere estremamente difficile, perché l’insegnamento tradizionale si basa sull’ascolto e la ripetizione. Questo studio presenta un ausilio didattico basato sulla tecnologia che «vede» i gesti della Lingua dei Segni araba e li collega ai versetti di un capitolo breve del Qur’an. Trasformando i movimenti del corpo in un ponte tra segno e scritto sacro, l’obiettivo è rendere l’apprendimento religioso più inclusivo per milioni di persone che comunicano principalmente tramite la lingua dei segni.

Perché gli apprendenti con deficit uditivo vengono esclusi

I musulmani sordi spesso si affidano a gesti e segni per comunicare, tuttavia gran parte dell’educazione coranica è costruita intorno al suono: gli insegnanti recitano ad alta voce e gli studenti imitano melodia e pronuncia. Le famiglie possono non conoscere bene la lingua dei segni e gli interpreti qualificati sono scarsi, specie per materiale religioso. Di conseguenza, molti credenti sordi faticano ad accedere allo stesso livello di istruzione spirituale dei loro pari udenti. I recenti progressi nella visione artificiale e nell’intelligenza artificiale, capaci di riconoscere movimenti di mani e corpo da immagini video o fotografiche, offrono un modo per cambiare questa situazione trasformando la lingua dei segni in qualcosa che un computer può comprendere e a cui può rispondere in tempo reale.

Trasformare i gesti in unità insegnabili

I ricercatori si sono concentrati sulla Sūrat al-Ikhlāṣ, un capitolo breve ma ricco di significato teologico che molti musulmani memorizzano in giovane età. In collaborazione con istituzioni che servono utenti sordi in Egitto, hanno registrato 2.054 immagini di gesti della Lingua dei Segni araba corrispondenti a singole parole coraniche di questo capitolo. Per evitare ambiguità di significato e pronuncia, ogni gesto è stato etichettato sia in scrittura araba sia tramite un sistema di traslitterazione standardizzato largamente utilizzato negli studi islamici accademici. Questa etichettatura accurata garantisce che il sistema colleghi ogni segno al corretto termine coranico, mantenendo al contempo la flessibilità necessaria per estendersi ad altri capitoli in futuro.

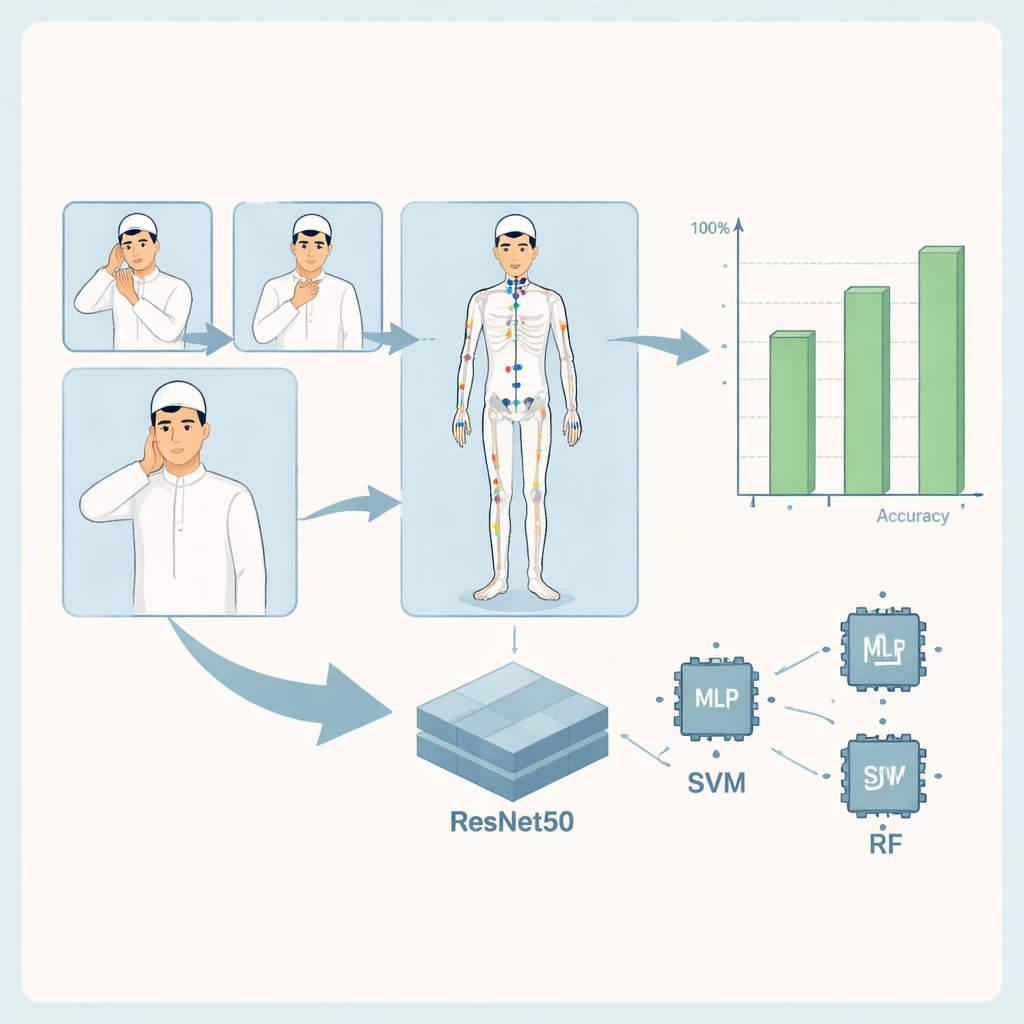

Come il computer impara a riconoscere le pose di devozione

Al centro del sistema c’è una pipeline visiva che prima rileva la posa del corpo del firmatario e poi classifica quale parola coranica viene segnata. Tutte le immagini sono ridimensionate e ripulite in un formato standard. Un toolkit software chiamato MediaPipe individua 33 punti chiave sul corpo — come spalle, gomiti e polsi — e ne traccia le posizioni. Queste coordinate costituiscono una descrizione compatta di ogni posa, che viene poi fornita a tre tipi di modelli di apprendimento automatico: un perceptrone multistrato personalizzato (una rete neurale semplice), una support vector machine e una foresta casuale composta da molti piccoli alberi decisionali. Parallelamente, un modello di deep learning più potente, ResNet50, analizza l’immagine completa per apprendere pattern visivi dettagliati associati a ciascuna parola.

Riconoscimento sorprendentemente accurato dei segni coranici

Per testare il sistema, gli autori hanno suddiviso il loro dataset in set di addestramento, validazione e test e hanno valutato quanto accuratamente ogni modello riconoscesse i gesti. Tutti gli approcci hanno dato risultati robusti, con i modelli basati sulla posa che identificavano correttamente la maggior parte dei segni in 14–16 classi di parole coraniche. Il modello a foresta casuale, per esempio, ha raggiunto punteggi quasi perfetti per molte parole, con solo poche confusioni tra gesti visivamente simili. Il modello combinato basato su ResNet50, che analizza direttamente le immagini beneficiando al contempo delle informazioni di posa, ha raggiunto prestazioni quasi impeccabili sui dati di test: ogni gesto è stato classificato correttamente e le misure standard di accuratezza, precisione, richiamo e un indice di discriminazione chiamato ROC–AUC hanno raggiunto i loro valori massimi. Questi risultati suggeriscono che anche collezioni d’immagini relativamente piccole, se preparate con cura, possono supportare un riconoscimento altamente accurato della lingua dei segni religiosa.

Promesse, limiti e la strada da percorrere

Pur essendo i numeri di performance impressionanti, gli autori sottolineano che si riferiscono soltanto alle condizioni controllate del loro studio: un singolo capitolo, un numero limitato di firmatari e immagini statiche piuttosto che segni continui in movimento. L’uso nel mondo reale richiederebbe dataset più grandi e variegati, una copertura migliore dei movimenti della parte inferiore del corpo e test accurati con firmatari provenienti da regioni diverse. Tuttavia, il lavoro dimostra che gli strumenti moderni di visione e apprendimento possono riconoscere in modo affidabile i segni coranici e fornire feedback istantaneo, ad esempio mostrando un segno di spunta o un’animazione correttiva quando uno studente esegue un gesto. In termini pratici, ciò significa che uno studente sordo potrebbe esercitarsi nei versetti coranici davanti a una semplice telecamera e ricevere indicazioni senza la necessità di un interprete in carne e ossa: un passo importante verso la maggiore accessibilità della conoscenza sacra per tutti.

Citazione: AbdElghfar, H., Youness, H.A., Wahba, M. et al. An automated framework for qur’anic education of the hearing-impaired using body pose classification and Arabic sign language integration. Sci Rep 16, 5939 (2026). https://doi.org/10.1038/s41598-026-36578-z

Parole chiave: Educazione coranica, Lingua dei Segni araba, apprendenti con ipoacusia, riconoscimento della postura, tecnologia assistiva