Clear Sky Science · it

Scientific reports multi relational dual attention graph transformer for fine grained sentiment analysis

Perché i piccoli indizi nelle recensioni contano

Le recensioni online sono piene di sentimenti misti: un ristorante può avere “ottimo cibo ma servizio lento”, oppure uno smartphone può avere uno “schermo bello ma una durata della batteria terribile”. Aziende e ricercatori vogliono che i computer comprendano questo tipo di opinioni dettagliate, non solo se l’intera recensione è positiva o negativa. Questo articolo presenta un nuovo modello di intelligenza artificiale che si concentra sulle parti specifiche di una frase—come “servizio” o “durata della batteria”—e determina esattamente come le persone valutano ciascuna di esse, anche quando gli indizi sono sparsi e sottili.

Oltre il sentimento unico per tutti

L’analisi del sentimento tradizionale interpreta una frase o una recensione come un unico blocco di testo e decide se è complessivamente positiva o negativa. Questo funziona per commenti semplici, ma fallisce quando si elogia un aspetto e se ne critica un altro nella stessa frase. Il campo dell’Analisi del Sentimento Basata sugli Aspetti affronta questo problema chiedendo: qual è il sentimento verso ciascun obiettivo specifico, come “servizio”, “ambiente” o “personale” in una recensione di un ristorante. I metodi precedenti si basavano su regole manuali o su semplici approcci di machine learning che contavano le parole, poi sono passati a reti neurali che leggono il testo in sequenza, come da sinistra a destra. Questi modelli sequenziali hanno migliorato l’accuratezza ma hanno ancora perso legami a lungo raggio e segnali sottili, specialmente quando le parole rilevanti sono lontane o collegate da connettivi di contrasto come “ma” e “anche se”.

Trasformare le frasi in mappe connesse

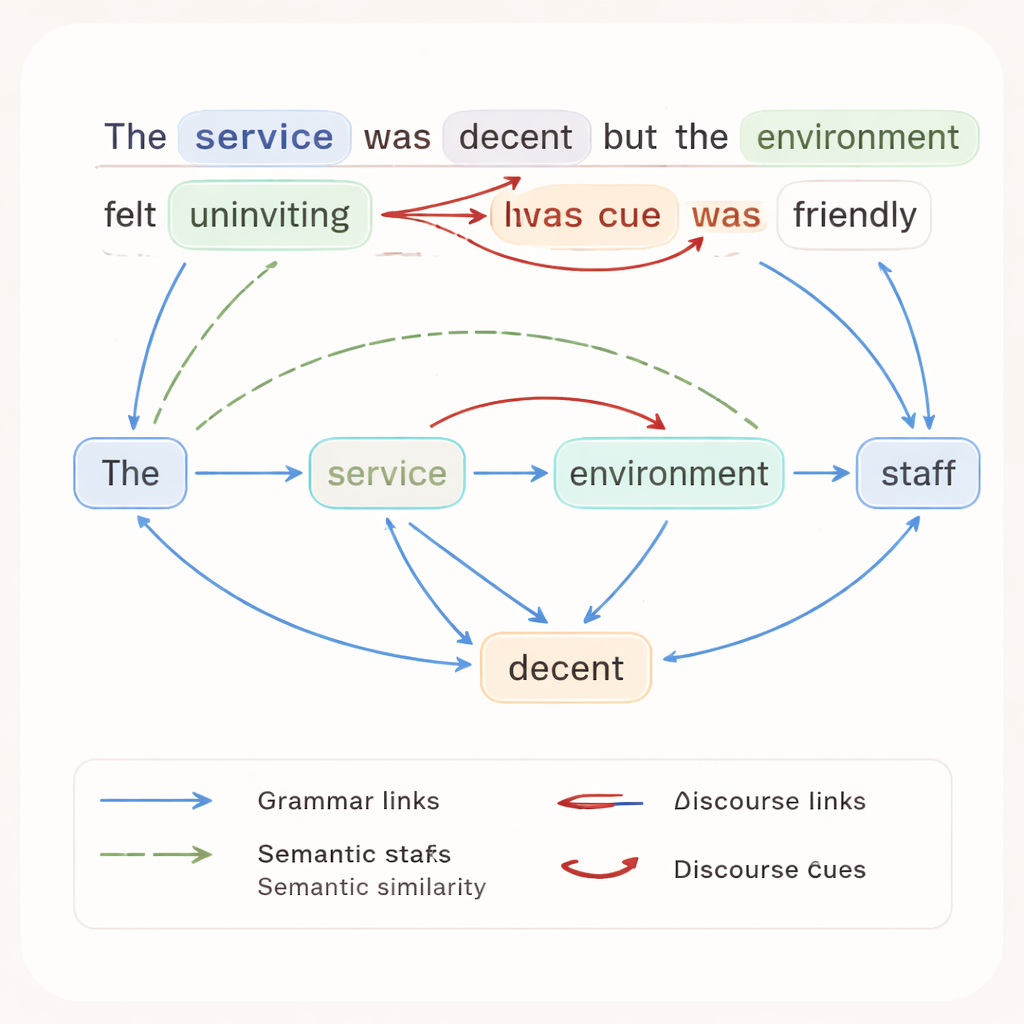

Gli autori sostengono che per comprendere davvero le opinioni a livello fine, un computer dovrebbe vedere una frase come una rete piuttosto che una linea retta. Nel loro approccio, ogni parola diventa un nodo in un grafo e diversi tipi di relazioni diventano archi. Un insieme di archi cattura la grammatica, ad esempio quale parola è soggetto o oggetto. Un altro insieme collega parole simili nel significato, anche se non sono vicine. Un terzo insieme segnala i segnali di discorso—parole come “ma”, “tuttavia” o “sebbene” che spesso indicano un cambiamento di sentiment. In una frase come “Il servizio era discreto ma l’ambiente risultava poco accogliente anche se il personale era cortese”, questo grafo mostra come elogi e critiche siano intrecciati intorno a diversi aspetti.

Un doppio riflettore su contesto e target

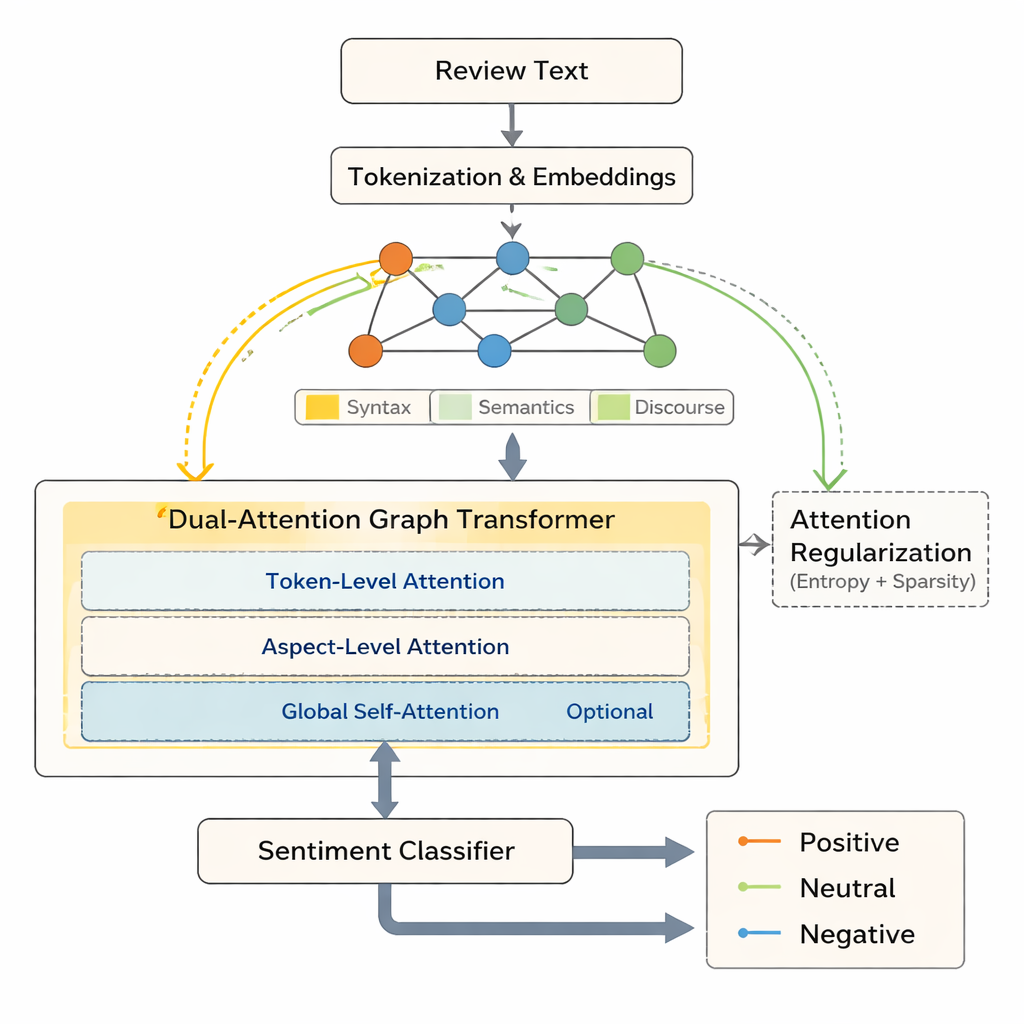

Basandosi su questa visione a grafo, l’articolo presenta il Multi-Relational Dual-Attention Graph Transformer (MRDAGT). Questo modello utilizza un meccanismo di attenzione in stile Transformer adattato ai grafi. Una testa di attenzione guarda in modo ampio a come tutte le parole della frase si relazionano tra loro, raccogliendo contesto locale utile. Una seconda testa di attenzione si concentra specificamente sull’aspetto in esame—per esempio “servizio” o “ambiente”—e aumenta l’influenza delle parole che formano l’opinione su quel target, come “discreto” o “poco accogliente”. Quando ci sono diversi aspetti in una singola frase, uno strato opzionale di attenzione globale aiuta il modello a pesare le loro interazioni. In effetti, il sistema proietta due riflettori coordinati: uno sulla struttura generale della frase e uno direttamente sull’aspetto di cui si vuole valutare il sentimento.

Rendere l’attenzione delle macchine più selettiva e interpretabile

Una preoccupazione chiave con l’IA moderna è che i pesi di attenzione—i numeri che indicano su quali parole il modello si è concentrato—possono essere troppo distribuiti, rendendo difficile interpretare le decisioni. MRDAGT affronta questo problema con due forze di regolarizzazione. Una penalità di entropia scoraggia un’attenzione eccessivamente piatta, spingendo il modello a concentrarsi più nettamente su poche parole importanti. Allo stesso tempo, un termine di sparsità L1 tende a portare molti collegamenti di attenzione verso zero, eliminando connessioni deboli e rumorose. Insieme, queste forze creano una “sparsità focalizzata”: il modello tende ad assegnare pesi chiari e alti alle coppie parola–aspetto veramente rilevanti ignorando le distrazioni. Esperimenti su tre dataset di riferimento—recensioni formali di laptop, recensioni complesse multi-frase e post informali su Twitter—mostrano che MRDAGT supera costantemente sistemi forti esistenti di circa uno o due punti percentuali in accuratezza, producendo al contempo mappe di attenzione più pulite e interpretabili.

Cosa significa per l’opinion mining nel mondo reale

Per i non specialisti, il risultato principale è che questo modello offre un modo più preciso e affidabile per estrarre opinioni da testi reali e disordinati. Invece di limitarsi a dire che una recensione è “per lo più positiva”, MRDAGT può comunicare separatamente che i clienti apprezzano la velocità di un dispositivo ma non la batteria, o che i commensali lodano il personale di un caffè pur lamentandosi del rumore. Poiché i suoi schemi di attenzione si allineano con l’intuizione umana—concentrandosi su parole di contrasto, aggettivi sentimentali e termini di aspetto—è più semplice per gli analisti capire perché il modello ha espresso un determinato giudizio. Gli autori suggeriscono che questo approccio può supportare decisioni di design del prodotto migliori, un monitoraggio più accurato dei social media e future estensioni a molte lingue e persino a dati multi-modali come audio e immagini, il tutto mantenendo il processo di ragionamento relativamente trasparente.

Citazione: Anilkumar, A.P., Kim, SK. & Yoon, YC. Scientific reports multi relational dual attention graph transformer for fine grained sentiment analysis. Sci Rep 16, 7236 (2026). https://doi.org/10.1038/s41598-026-36490-6

Parole chiave: analisi del sentimento basata sugli aspetti, reti neurali grafiche, attenzione transformer, opinion mining, elaborazione del linguaggio naturale