Clear Sky Science · it

Una rete collaborativa multi-attenzione per il rilevamento in tempo reale di oggetti piccoli nelle immagini da UAV

Perché è importante individuare dettagli minuscoli dall’alto

Con i droni sempre più diffusi per il monitoraggio del traffico, gli interventi di soccorso e la sicurezza, devono saper individuare in modo affidabile oggetti molto piccoli — come auto, biciclette o persone — visti da quote elevate. In queste vedute aeree, gli obiettivi occupano solo poche decine di pixel e possono facilmente perdersi in ombre, riflessi o sfondi affollati. Questo articolo presenta un nuovo sistema di visione artificiale, chiamato Collaborative Multi-Attention Network (CMA-Net), progettato per rilevare rapidamente e con precisione tali piccoli oggetti nelle immagini da drone, con prestazioni adatte all’uso in tempo reale.

Le difficoltà nel vedere cose minute dall’alto

Rilevare oggetti piccoli nelle immagini da drone è più complesso che nelle foto stradali ordinarie. Poiché i droni volano in alto e osservano le scene da angolazioni variabili, veicoli e persone appaiono minuti e sfocati, e l’illuminazione può cambiare rapidamente. I rivelatori a due fasi tradizionali possono essere molto accurati ma spesso troppo lenti per l’uso in tempo reale su piattaforme volanti con potenza di calcolo e larghezza di banda limitate. I metodi più veloci a fase singola girano in tempo reale ma tendono a perdere i piccoli bersagli perché i loro dettagli vengono progressivamente attenuati mentre le immagini vengono elaborate strato dopo strato. Gli autori sostengono che per migliorare il rilevamento di oggetti piccoli siano necessarie strategie più intelligenti per combinare informazioni a diverse scale e concentrare l’attenzione computazionale sulle parti più informative dell’immagine.

Costruire una scala di feature più intelligente

CMA-Net parte da un backbone ampiamente utilizzato per l’elaborazione delle immagini, ResNet-50, e aggiunge un Efficient Bi-directional Feature Pyramid Network (E-BiFPN). Questa struttura costruisce una specie di scala di mappe di feature a diverse risoluzioni, permettendo al sistema di mescolare dettagli fini degli strati iniziali con contesto più astratto degli strati profondi. A differenza di progetti precedenti, E-BiFPN elimina livelli di alto livello non necessari e aggiunge un blocco di elaborazione speciale e leggero che utilizza convoluzioni parziali per ridurre il carico computazionale. Uno schema di fusione pesata impara quindi quanto fidarsi delle feature poco profonde rispetto a quelle profonde a ciascuna scala, in modo che le informazioni fragili su auto o pedoni minuscoli vengano amplificate mentre il rumore di fondo viene attenuato.

Insegnare alla rete dove guardare

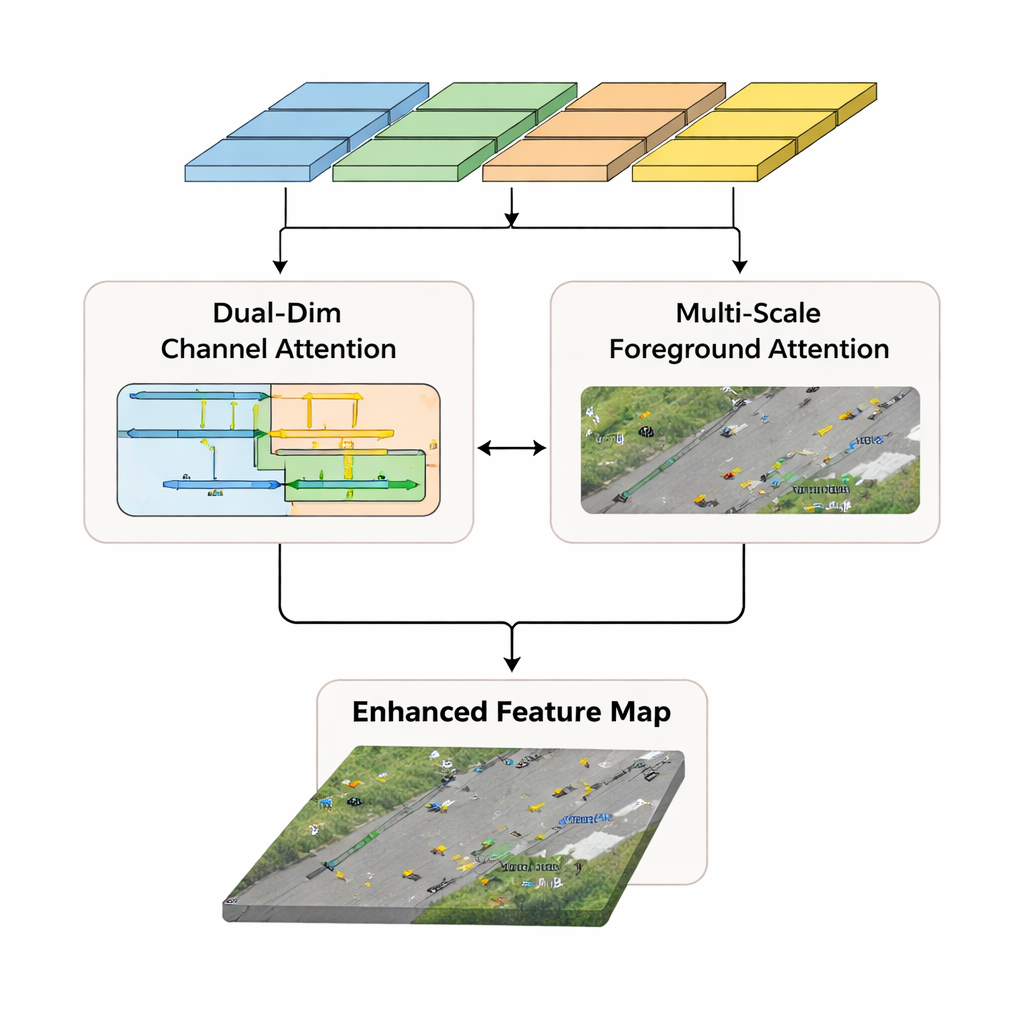

Oltre a riorganizzare le feature, CMA-Net impiega meccanismi di attenzione che imitano il modo in cui gli esseri umani si concentrano sulle parti rilevanti di una scena. Un modulo di Dual-Dimensional Channel Attention (DDCA) analizza le feature separatamente lungo la larghezza e l’altezza dell’immagine, invece di comprimere tutto in un unico riassunto globale. Questo progetto aiuta la rete a catturare pattern a lunga distanza sia in orizzontale sia in verticale, preservando indizi di posizione cruciali quando i piccoli oggetti si confondono in contesti complessi. In parallelo, un modulo Multi-Scale Foreground Attention (MSFA) collega oggetti grandi e facilmente riconoscibili negli strati più profondi con quelli più piccoli degli strati superficiali. Campionando e fondendo informazioni da tre scale, MSFA impara a mettere in evidenza le regioni di primo piano dove è probabile trovare veicoli e a sopprimere texture di sfondo fuorvianti.

Dalle feature potenziate a decisioni rapide

I risultati dei rami DDCA e MSFA vengono uniti in mappe di feature ricche e adatte agli oggetti piccoli, che vengono passate a una testa di rilevamento "anchor-free". Invece di fare affidamento su una griglia densa di box preimpostati, questa testa predice direttamente sia la categoria sia la posizione degli oggetti, semplificando i calcoli e rendendo l’addestramento più flessibile. Gli autori hanno valutato CMA-Net su due dataset pubblici esigenti per immagini da drone, UAVDT e Stanford Drone, che includono strade affollate, condizioni meteorologiche variabili e situazioni giorno-notte. CMA-Net ha raggiunto punteggi di accuratezza del 67,2% e del 62,0% su questi dataset pur operando a 64 fotogrammi al secondo, il che significa che può elaborare video in tempo reale superando molti rivelatori popolari, inclusi alcuni modelli della famiglia YOLO e soluzioni più complesse basate su transformer.

Cosa significa per l’uso reale dei droni

Per i non specialisti, il punto chiave è che CMA-Net migliora in modo significativo la capacità di un drone di notare oggetti piccoli e difficili da vedere senza rallentarne il funzionamento. Fondendo con cura informazioni su più scale e guidando l’attenzione della rete sia attraverso i canali dell’immagine sia tra primo piano e sfondo, il metodo evita che minuscoli veicoli e persone vengano trascurati. Questa combinazione di accuratezza e velocità rende l’approccio promettente per applicazioni pratiche quali il monitoraggio intelligente del traffico, l’osservazione delle folle e la risposta alle emergenze, dove perdere un piccolo oggetto o reagire troppo lentamente potrebbe avere conseguenze gravi.

Citazione: Yang, J., Yue, X. & Wu, L. A collaborative multi-attention network for real-time small object detection in UAV imagery. Sci Rep 16, 5852 (2026). https://doi.org/10.1038/s41598-026-36440-2

Parole chiave: visione drone, rilevamento di piccoli oggetti, sorveglianza in tempo reale, reti di attenzione, monitoraggio del traffico