Clear Sky Science · it

Decoupling dello stile dal contenuto per la generazione di immagini multi-stile usando un’architettura di diffusione latente

Perché gli stili delle immagini più intelligenti contano

Dai poster cinematografici e le illustrazioni per videogiochi ai filtri dei social media, ci aspettiamo sempre più spesso che le immagini siano sia visivamente accattivanti sia altamente personalizzate. Tuttavia, dietro le quinte molti sistemi di trasferimento di stile ancora faticano: possono deformare il volto di una persona, piegare gli edifici o richiedere hardware potente. Questo articolo presenta un nuovo modello di IA che promette stili artistici più ricchi mantenendo intatta l’immagine originale e operando in modo sufficientemente efficiente per dispositivi di uso quotidiano.

Separare “cosa è” da “come appare”

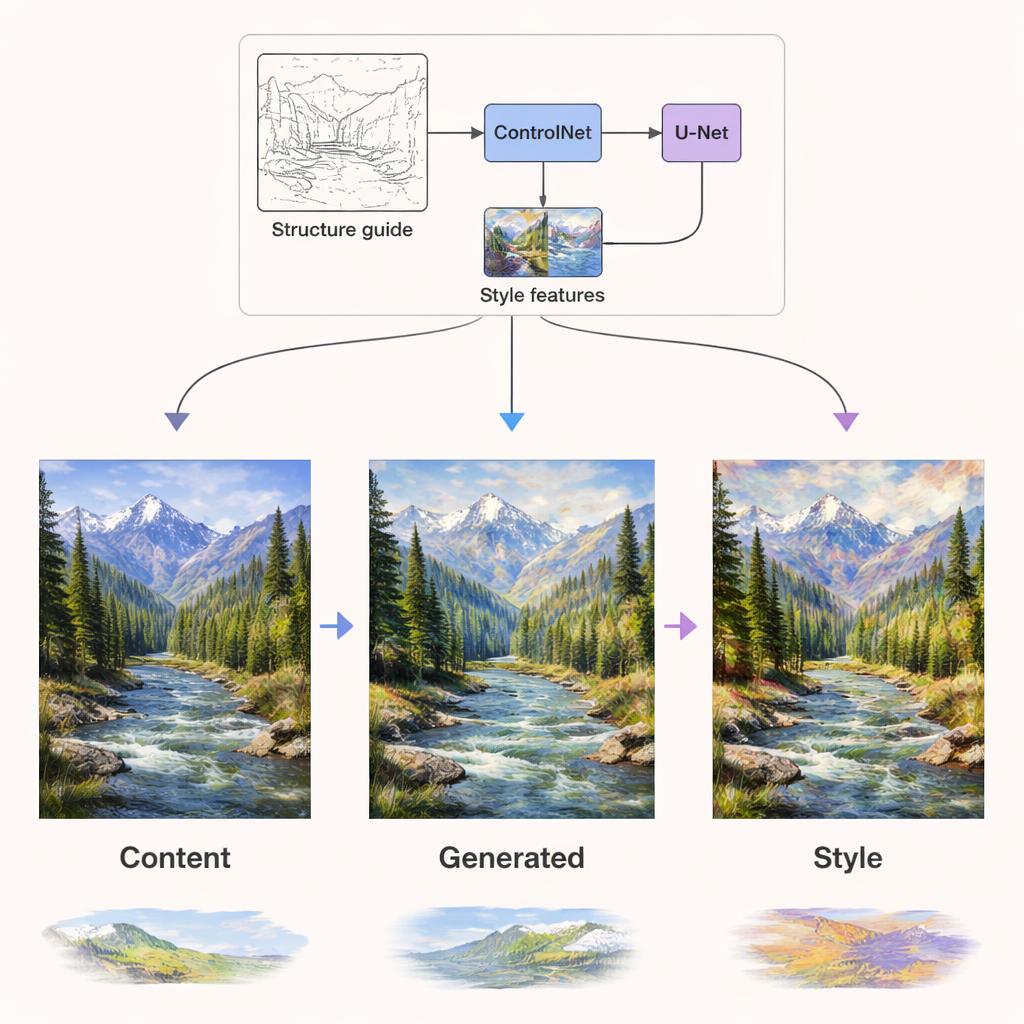

Al centro di questo lavoro c’è un modello chiamato Dual-Condition Lightweight Style Diffusion Model (DCLSDM). L’idea chiave è considerare la sostanza di un’immagine — gli oggetti, la disposizione e la scena — come un “canale”, e il trattamento artistico — colori, texture, pennellate — come un altro, controllandoli separatamente. Invece di lasciare che una singola rete confonda questi due aspetti, DCLSDM utilizza due percorsi dedicati: uno per il contenuto e uno per lo stile. Il percorso del contenuto si concentra sulla comprensione di forme e significati in un’immagine di input o in una descrizione testuale, mentre il percorso dello stile apprende il carattere visivo di un’opera o di una descrizione di stile scelta.

Come è costruito il nuovo modello

DCLSDM si basa sui modelli di diffusione, la stessa famiglia di tecniche dietro molti generatori di immagini moderni. Piuttosto che lavorare direttamente su immagini a piena risoluzione, opera in uno spazio latente compresso, molto più efficiente. Un modulo chiamato Perceiver IO estrae il contenuto: riceve un’immagine o una didascalia e distilla la geometria e la semantica della scena in una rappresentazione compatta. Un modulo di stile separato legge una o più immagini di stile o testi e li converte in vettori di caratteristiche di stile. Queste caratteristiche di stile possono essere miscelate con uno schema di interpolazione pesata, permettendo transizioni fluide, per esempio, tra un aspetto impressionista e uno minimalista senza il consueto effetto “fangoso” della media.

Mantenere la struttura cambiando lo stile

All’interno della rete di diffusione che genera effettivamente l’immagine, i due tipi di informazione vengono iniettati attraverso percorsi indipendenti. I segnali di contenuto guidano gli strati della rete che si occupano della struttura — dove devono andare i bordi, gli oggetti e le disposizioni. I segnali di stile vengono iniettati tramite strati di attenzione dedicati che modellano principalmente texture, colori e pennellate. Su tutto questo, un componente chiamato ControlNet aggiunge una guida strutturale extra utilizzando mappe di bordi o di profondità estratte dal contenuto originale. Questa combinazione permette al sistema di ridipingerе un paesaggio estivo con una tavolozza invernale, o di rendere una fotografia come un dipinto in stile Van Gogh, mantenendo montagne, alberi ed edifici al posto giusto e privi di distorsioni.

Migliore qualità, più stili, meno calcolo

Gli autori testano in modo rigoroso DCLSDM su due dataset pubblici: WikiArt, che copre decine di movimenti artistici, e Summer2Winter Yosemite, incentrato sui cambiamenti stagionali di un paesaggio. Confrontano il loro modello con una serie di sistemi all’avanguardia utilizzati sia nella ricerca sia nell’industria. Sulle misure di somiglianza strutturale, qualità visiva percepita e quanto le immagini generate somiglino ad opere reali, DCLSDM ottiene costantemente i punteggi più alti. Funziona inoltre più velocemente, usa meno memoria e ha meno parametri rispetto a molti concorrenti, pur offrendo mix flessibili di più stili e supportando input di stile sia basati su immagini sia su testo.

Cosa significa per la creatività di tutti i giorni

In termini pratici, questo lavoro dimostra che è possibile dare agli utenti un controllo fine su come appare un’immagine senza sacrificare ciò che l’immagine mostra — e farlo su hardware più modesto. I designer potrebbero esplorare rapidamente molte variazioni artistiche dello stesso impianto, le app mobili potrebbero offrire filtri più ricchi che non deformano volti o scene, e i progetti di patrimonio culturale potrebbero rielaborare vecchie fotografie preservando dettagli strutturali cruciali. Separando nettamente contenuto e stile all’interno di un moderno framework di diffusione, DCLSDM indica un futuro in cui gli strumenti creativi per le immagini sono sia più potenti sia più affidabili per l’uso quotidiano.

Citazione: Chu, K., Shang, Y., Zhang, L. et al. Content style decoupling for multi style image generation using latent diffusion architecture. Sci Rep 16, 6642 (2026). https://doi.org/10.1038/s41598-026-36407-3

Parole chiave: trasferimento di stile delle immagini, modelli di diffusione, separazione contenuto-stile, generazione di arte digitale, generazione efficiente di immagini