Clear Sky Science · it

Un modello di sentiment profondo che combina contesto guidato da ALBERT e architettura ottimizzata con EHO

Perché è importante leggere il sentiment in modo più intelligente

Ogni giorno milioni di persone condividono opinioni su prodotti, servizi, politica ed eventi su Internet. Trasformare questo flusso di testo in informazioni affidabili è vitale per aziende, governi e ricercatori. Tuttavia il linguaggio online è disordinato: battute sarcastiche, gergo, refusi ed emozioni rare possono facilmente confondere i computer. Questo articolo presenta un nuovo sistema di analisi del sentiment che mira a interpretare queste emozioni con maggiore accuratezza, pur utilizzando meno risorse di calcolo rispetto a molti modelli di intelligenza artificiale attuali.

Da semplici conteggi di parole a una lettura consapevole del contesto

I primi strumenti di analisi del sentiment trattavano il testo come un sacco di parole scollegate, contando quante volte comparivano termini come “buono” o “terribile”. Questo approccio ignorava l’ordine delle parole e il contesto sottile, come “non male” che significa qualcosa di più vicino a “abbastanza buono”. I metodi di deep learning hanno migliorato la situazione processando il testo come sequenze, ma spesso richiedevano grandi dataset etichettati e intensa capacità di calcolo. I modelli Transformer come BERT hanno ulteriormente aumentato l’accuratezza, ma la loro grandezza li rende costosi da eseguire in contesti reali come piattaforme di assistenza clienti o sistemi di monitoraggio dei social media. Gli autori di questo lavoro rispondono a questa sfida combinando diversi componenti più leggeri ma potenti in un sistema snello.

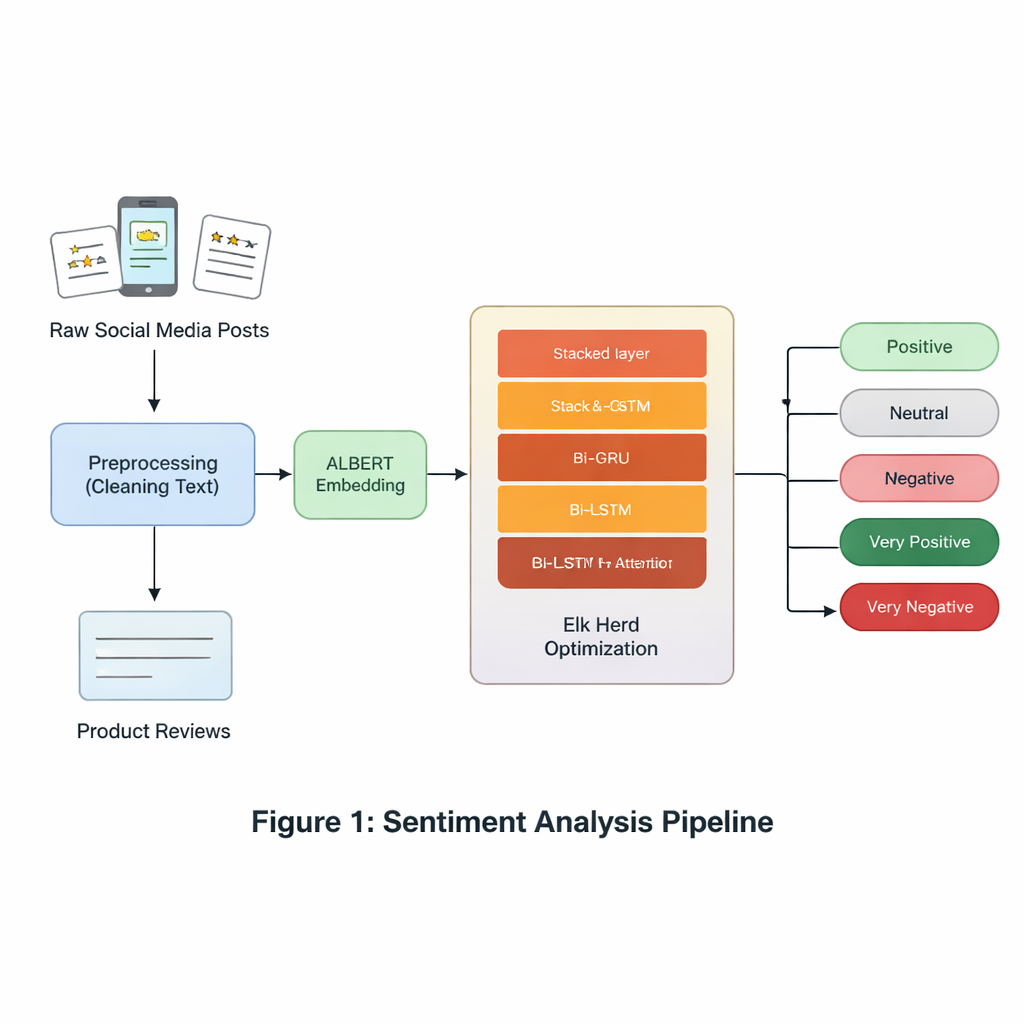

Un cervello più snello per comprendere il testo

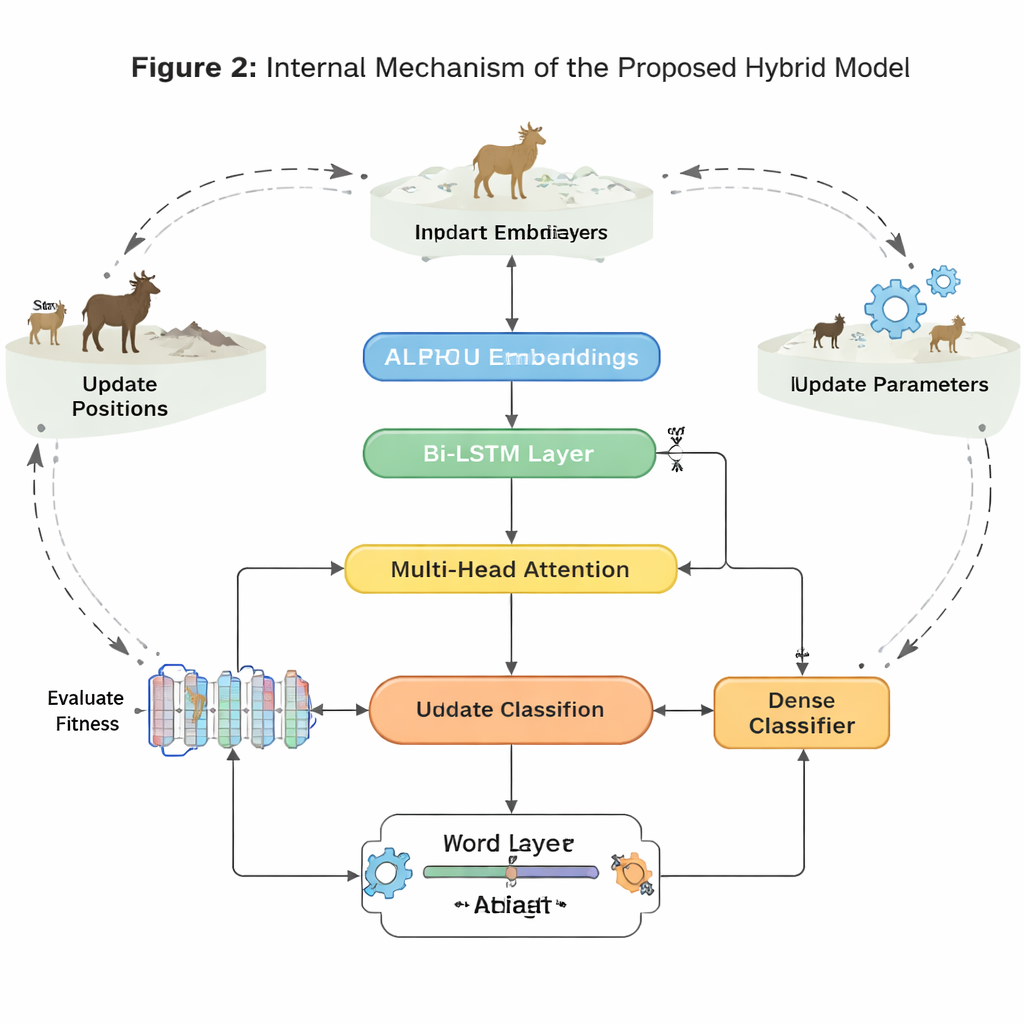

Al centro del modello c’è ALBERT, un parente compatto del modello linguistico BERT. ALBERT trasforma ogni parola in una frase in una rappresentazione numerica sensibile al contesto, catturando come i significati cambiano a seconda delle parole vicine. A differenza dei modelli più grandi, ALBERT riduce l’uso di memoria condividendo i parametri tra i layer e comprimendo il vocabolario delle parole. Ciò lo rende più facile da eseguire su hardware standard senza sacrificare gran parte della comprensione. Queste rappresentazioni lessicali basate su ALBERT diventano l’input per una sequenza di layer specializzati che si concentrano su come il sentiment si sviluppa lungo la frase.

Lasciare che due sistemi di memoria lavorino insieme

Per seguire come il significato cambia da parola a parola, il sistema utilizza due tipi di reti ricorrenti: GRU (Gated Recurrent Units) e LSTM (Long Short-Term Memory), ciascuna eseguita in direzione sia forward che backward. Le GRU sono efficienti nel tracciare frasi brevi con meno parametri, mentre le LSTM sono migliori nel ricordare informazioni su tratti di testo più lunghi. Sovrapponendo un layer bidirezionale GRU a un layer bidirezionale LSTM e aggiungendo un meccanismo di attention, il modello può evidenziare le parti della frase più cariche di sentiment—come la frase “tranne la durata della batteria” in una recensione per il resto positiva. Questo design ibrido mira a catturare sia i rapidi cambi di tono sia il contesto a lungo raggio che potrebbe ribaltare il sentiment complessivo.

Tuning ispirato alla natura per i casi difficili

Oltre all’architettura, gli autori affrontano un importante ostacolo del mondo reale: i dataset di sentiment sono spesso sbilanciati e rumorosi. Emozioni come disgusto o sorpresa, e affermazioni neutre, compaiono meno frequentemente rispetto a quelle chiaramente positive o negative, facendo sì che molti modelli le ignorino. Per contrastare questo, l’articolo usa l’Elk Herd Optimization, una strategia di ricerca ispirata alla natura modellata sul modo in cui gli elk si muovono, competono e si raggruppano. Dopo che la rete neurale produce vettori interni di sentiment, questo passo di ottimizzazione affina come questi vettori rappresentano ciascuna classe, in particolare quelle rare, migliorando iterativamente un punteggio di “fitness”. Questo processo aiuta il modello a evitare soluzioni superficiali e migliora la sua capacità di distinguere emozioni sottili o sottorappresentate.

Mettere il modello alla prova

Gli autori valutano il sistema su sei dataset ampiamente usati, inclusi post di Twitter, recensioni di ristoranti e laptop, e un benchmark di recensioni cinematografiche a cinque livelli che distingue opinioni molto positive e molto negative da quelle più moderate. Attraverso queste fonti variegate, il nuovo approccio supera costantemente diversi concorrenti avanzati basati su grafi e transformer sia in accuratezza che in F1 score, una metrica che bilancia i colpi giusti e i casi mancati. I miglioramenti sono particolarmente marcati nel compito a cinque classi delle recensioni cinematografiche e sulle classi di sentiment sottorappresentate, dimostrando che il metodo può gestire sia emozioni fini che dati sbilanciati. Uno studio di ablazione, in cui i componenti vengono rimossi uno alla volta, conferma che ALBERT, il design combinato GRU–LSTM, l’attenzione e l’ottimizzazione ispirata agli elk contribuiscono ciascuno alle prestazioni complessive.

Cosa significa questo per le applicazioni quotidiane

Per i non specialisti, la conclusione principale è che questa ricerca offre un modo più efficiente e affidabile per interpretare grandi volumi di opinioni online. Combinando un modello linguistico compatto con layer di memoria complementari e un passaggio di tuning ispirato alla biologia, il sistema legge tra le righe con maggiore precisione, specialmente quando i sentimenti sono sottili o i dati sono sbilanciati. Questo lo rende promettente per applicazioni reali come il monitoraggio della soddisfazione dei clienti, la sorveglianza degli atteggiamenti di salute pubblica o la valutazione delle reazioni a politiche ed eventi, dove contano sia la precisione sia il costo computazionale.

Citazione: Oqaibi, H., Sharma, S. A deep sentiment model combining ALBERT-driven context and EHO-optimized architecture. Sci Rep 16, 5784 (2026). https://doi.org/10.1038/s41598-026-36389-2

Parole chiave: analisi del sentiment, ALBERT, deep learning, classificazione del testo, ottimizzazione metaeuristica