Clear Sky Science · it

Sfruttare i modelli di analisi dei topic per esplorare dimensioni psicologiche nei dati dei social media

Perché le nostre parole online contano

Milioni di persone parlano dei propri sentimenti sui social media ogni giorno, spesso in modo più aperto rispetto a come farebbero di persona. Nascosti in questo mare di commenti informali ci sono indizi preziosi sulla salute mentale, compresi segnali di depressione o autolesionismo. Questo studio pone una domanda semplice ma di grande portata: l’intelligenza artificiale moderna può setacciare il chiacchiericcio online, individuare temi significativi e aiutare i professionisti a comprendere meglio i rischi psicologici — senza leggere ogni post uno per uno?

Trasformare il caos in temi

I ricercatori si sono concentrati su un ampio insieme di post Reddit provenienti dall’iniziativa eRisk, che include persone che hanno dichiarato di essere state diagnosticate con depressione e un gruppo di controllo senza diagnosi note. L’obiettivo non era diagnosticare individui, ma verificare se l’analisi dei topic — tecniche che raggruppano testi per temi condivisi — potesse rivelare pattern rilevanti per la salute mentale. Poiché il linguaggio sui social media è disordinato, pieno di gergo, errori di battitura e cambi improvvisi di argomento, rappresenta un banco di prova realistico ma molto impegnativo per questi metodi.

Tre modi per scoprire di cosa parla la gente

Lo studio ha confrontato tre diverse famiglie di modelli di topic. Il primo, Latent Dirichlet Allocation (LDA), è un metodo classico che osserva quanto spesso le parole compaiono insieme nei documenti. Il secondo, BERTopic, usa potenti modelli linguistici moderni per trasformare ogni post in una ricca rappresentazione numerica, quindi raggruppa post simili ed estrae parole chiave per ciascun gruppo. Il terzo, TopClus, si basa anch’esso su reti neurali, combinando meccanismi di attenzione e clustering in uno spazio matematico condiviso. Tutti e tre sono stati eseguiti con impostazioni standard per produrre 50 topic ciascuno, imitando l’uso tipico che molti ricercatori ne farebbero senza personalizzazioni.

Chiedere agli esseri umani, non solo alle formule

Per valutare quali topic fossero davvero significativi, il team non si è affidato esclusivamente a punteggi automatici. Sei annotatori formati hanno esaminato 150 topic, ciascuno rappresentato dalle parole principali e da una manciata di post centrali. Per ogni topic hanno valutato quanto fosse coerente la lista di parole, quanto fossero coerenti gli esempi di post e se le parole e i post si corrispondessero tra loro. Hanno anche cercato di assegnare a ciascun topic un nome breve e intuitivo quando possibile. Questo approccio incentrato sull’umano ha rivelato un risultato chiave: le metriche numeriche di “coerenza”, popolari nella ricerca, spesso non concordavano con il giudizio umano, specialmente sui testi disordinati dei social media.

Il vincitore chiaro e ciò che ha rivelato

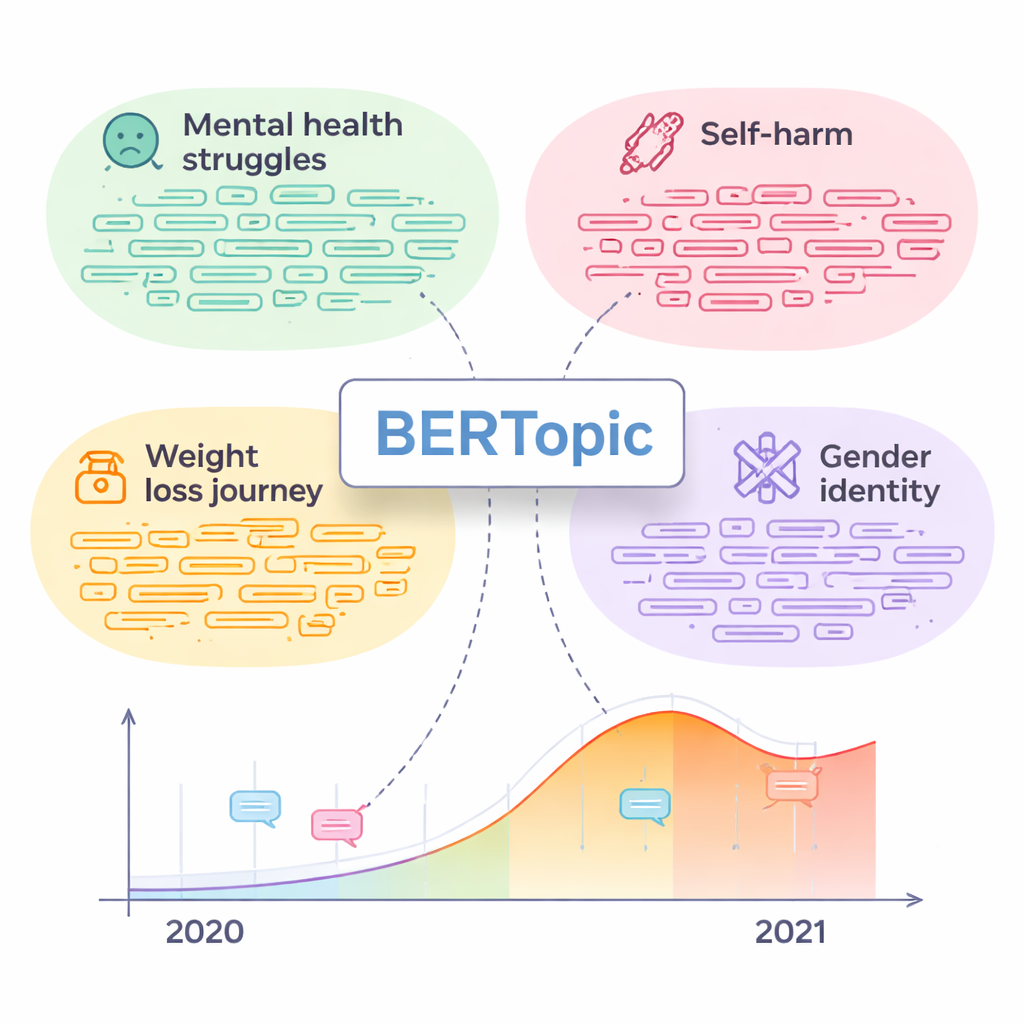

Considerando tutte le valutazioni umane, BERTopic ha prodotto in modo netto i topic più comprensibili e specifici. Gli annotatori sono riusciti a nominare i suoi topic molto più spesso rispetto agli altri modelli, e il loro accordo reciproco è stato solido e di livello moderato. LDA, al contrario, raggruppava spesso parole e post non correlati che ai revisori risultavano quasi casuali. Una volta selezionati i migliori topic, i ricercatori hanno approfondito i contenuti: alcuni temi, come “Difficoltà di salute mentale” e “Autolesionismo”, erano fortemente associati a utenti con depressione e contenevano molti post che esprimevano disagio. Altri erano meno ovviamente clinici — come “Percorso di perdita di peso”, “Identità di genere”, “Sogni sessuali” ed “Etichetta del bere sociale” — ma si sono rivelati contenere una quota elevata di post da utenti depressi e molti segnali di sofferenza emotiva. Un’analisi temporale semplice ha mostrato che l’attività in alcuni di questi topic sensibili è aumentata bruscamente durante la pandemia di COVID-19, rispecchiando i resoconti più ampi di peggioramento della salute mentale.

Da pattern online a aiuto nel mondo reale

Per comprendere meglio la gravità potenziale di alcuni di questi post, gli autori hanno utilizzato un modello linguistico separato per mappare approssimativamente i contenuti su voci di un noto questionario per la depressione (il Beck Depression Inventory). Questo passo esplorativo ha suggerito che certi topic, in particolare quelli legati a difficoltà mentali, autolesionismo, immagine corporea e identità di genere, spesso contengono linguaggio associato a sintomi depressivi da moderati a gravi. Gli autori sottolineano che tali letture automatizzate non sono diagnosi cliniche, ma possono aiutare a evidenziare dove l’attenzione di esperti è più urgentemente necessaria.

Cosa significa per la salute mentale e la tecnologia

In termini semplici, lo studio mostra che i modelli di topic più avanzati di oggi, in particolare BERTopic, possono trasformare conversazioni caotiche sui social media in temi chiari che si allineano con preoccupazioni psicologiche reali. Mostra anche che fidarsi ciecamente di punteggi automatici di qualità è rischioso; la revisione umana rimane essenziale quando l’obiettivo è supportare decisioni legate alla salute mentale. In futuro, strumenti simili potrebbero aiutare clinici, agenzie pubbliche e ricercatori a monitorare tendenze di ampia portata, individuare rischi emergenti e progettare migliori interventi di prevenzione — lasciando comunque il giudizio finale e la cura ai professionisti umani.

Citazione: Couto, M., Parapar, J. & Losada, D.E. Exploiting topic analysis models to explore psychological dimensions in social media data. Sci Rep 16, 6047 (2026). https://doi.org/10.1038/s41598-026-36339-y

Parole chiave: social media e depressione, topic modeling, modelli di salute mentale, segnali di autolesionismo online, modelli linguistici in psicologia