Clear Sky Science · it

ADAT: nuova architettura adattiva aware delle serie temporali per la traduzione della lingua dei segni

Colmare il divario comunicativo

Per milioni di persone sorde o con perdita uditiva, attività quotidiane come andare dal medico o guardare il bollettino meteo possono risultare più difficili del necessario, semplicemente perché gli interpreti qualificati della lingua dei segni sono scarsi. Questo articolo presenta un nuovo sistema di intelligenza artificiale chiamato ADAT che trasforma i video in lingua dei segni in frasi scritte con maggiore accuratezza ed efficienza rispetto a molti sistemi esistenti, avvicinandoci a una traduzione della lingua dei segni in tempo reale, diffusa su telefoni, tablet e computer ospedalieri.

Perché la lingua dei segni è difficile per i computer

Le lingue dei segni sono ricche e complesse, dotate di una grammatica propria, e si basano su molto più del movimento delle mani. Espressioni facciali, postura del corpo e timing sottile cambiano il significato di una frase firmata. I moderni sistemi di traduzione spesso utilizzano un’architettura potente nota come trasformatore, molto efficace nella comprensione di frasi lunghe in linguaggio parlato o scritto. Ma con video ad alta velocità—30–60 fotogrammi al secondo—questi sistemi possono rallentare e faticare a captare i movimenti rapidi e minuti che distinguono un segno dall’altro. Richiedono inoltre molta potenza di calcolo e tempo di addestramento, il che rende più difficile aggiornarli man mano che le lingue dei segni evolvono.

Un modo più intelligente di interpretare le firme

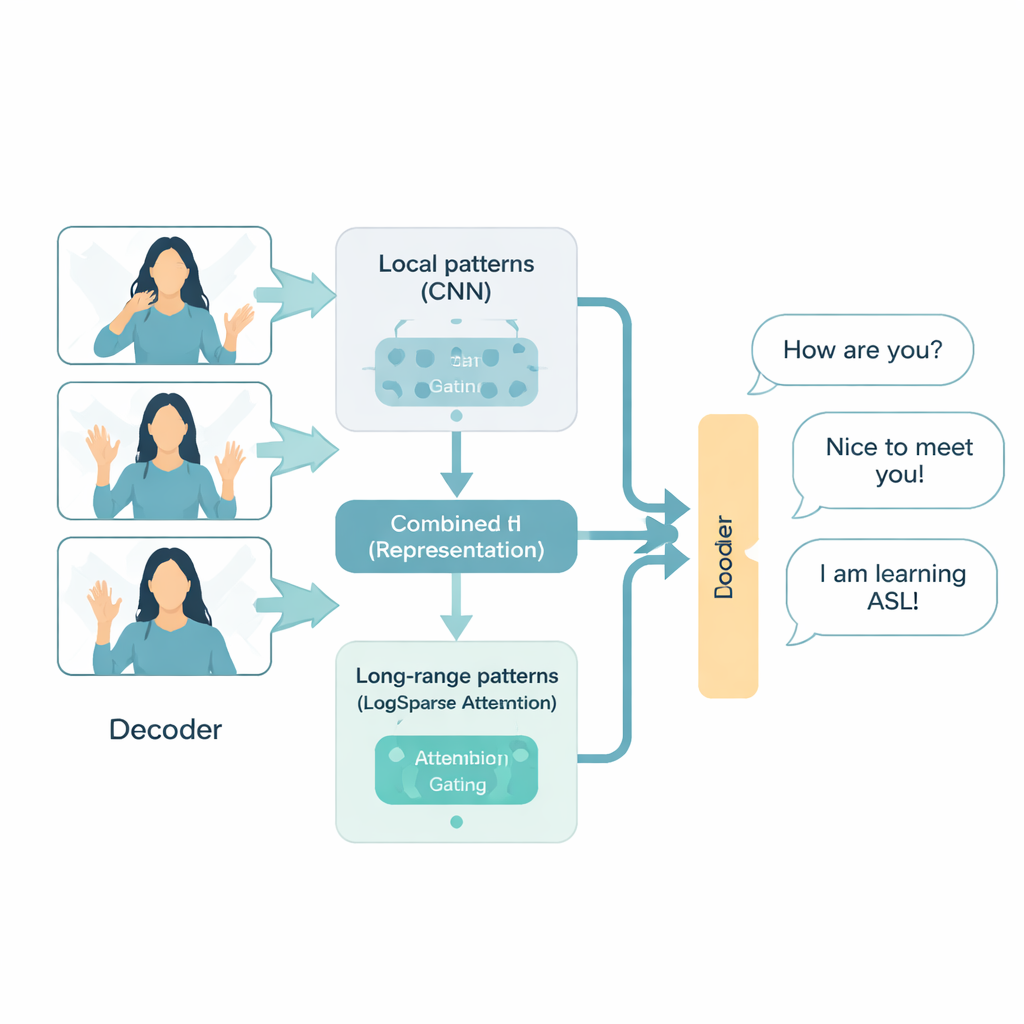

L’architettura ADAT è progettata specificamente per video in lingua dei segni, trattandoli come una serie temporale: un flusso veloce di eventi visivi che si svolgono nel tempo. Combina tre idee. Primo, impiega reti neurali convoluzionali, una tecnica consolidata per le immagini, per concentrarsi su pattern locali come la forma delle mani e segnali facciali. Secondo, utilizza una forma di attenzione più efficiente, che guarda selettivamente ai momenti chiave del video invece di confrontare ogni fotogramma con tutti gli altri. Terzo, un “gate” adattivo impara a fondere informazioni dettagliate a breve termine con un contesto più ampio a lungo termine, decidendo al volo quale sia più rilevante per ogni parte della frase. Insieme, queste componenti permettono ad ADAT di cogliere sia il rapido scatto di un dito sia la struttura complessiva di una conversazione senza sprecare calcolo.

Dai segni alle parole in due modi

La traduzione della lingua dei segni può essere organizzata in due fasi principali: prima riconoscere le unità di base della firma, note come gloss, e poi trasformare quei gloss in testo parlato o scritto. Questo approccio è chiamato sign-to-gloss-to-text. In alternativa, un sistema può provare ad andare direttamente dal video al testo in un unico passaggio, detto sign-to-text. Gli autori testano ADAT in entrambi gli stili. Lo confrontano con diversi solidi baseline basati su trasformatore, incluso un noto sistema chiamato SLTUNET, su tre dataset: un ampio corpus tedesco di previsioni meteo, una raccolta di Indian Sign Language e un nuovo dataset medico in American Sign Language che gli autori hanno creato per riflettere conversazioni realistiche tra medico e paziente.

Addestramento più rapido e traduzioni più nitide

In questi test, ADAT eguaglia o supera i migliori modelli concorrenti in qualità di traduzione, misurata con i classici punteggi BLEU, pur addestrandosi in modo sensibilmente più veloce. Nel setup a due passaggi sign-to-gloss-to-text ottiene punteggi simili o leggermente migliori rispetto a un trasformatore classico, ma riduce il tempo di addestramento di circa un quinto in media. Nell’impegnativo setup diretto sign-to-text, ADAT surclassa chiaramente baseline basate su encoder-only, decoder-only e trasformatore unificato, spesso migliorando l’accuratezza di circa un punto percentuale o più, sempre con circa il 20% in meno di tempo di addestramento. Un’analisi dettagliata della matematica sottostante mostra che l’attenzione più selettiva di ADAT e il design a percorso doppio riducono sostanzialmente il numero di operazioni richieste, specialmente con video lunghi o ad alto frame-rate.

Nuovi dati per conversazioni critiche

Per assicurare che questi metodi si estendano oltre l’ambiente di laboratorio, gli autori introducono MedASL, il primo dataset in American Sign Language focalizzato sulla comunicazione medica. Consiste di 500 frasi uniche, progettate con cura per simulare interazioni reali tra pazienti e operatori sanitari e include annotazioni sia in gloss sia in testo. Questo focus medico è importante perché incomprensioni in ospedale o in clinica possono avere conseguenze gravi, e i dataset esistenti raramente coprono questo dominio. ADAT ottiene buone prestazioni su MedASL, anche se i risultati evidenziano quanto sia impegnativo per qualsiasi sistema generalizzare perfettamente a nuove frasi del mondo reale.

Cosa significa per la vita di tutti i giorni

In termini semplici, lo studio mostra che possiamo costruire sistemi di traduzione della lingua dei segni che siano al contempo più intelligenti e più snelli: richiedono meno tempo e potenza di calcolo per l’addestramento, pur catturando meglio le sottigliezze della firma. ADAT non è ancora un interprete plug‑and‑play per ogni lingua dei segni in ogni situazione, e resta indietro rispetto a sistemi che si basano su enormi modelli pre-addestrati. Ma concentrandosi su pattern video sensibili al tempo ed efficienza, indica la strada verso strumenti pratici che un giorno potrebbero funzionare su dispositivi di uso quotidiano, supportare più lingue dei segni e aiutare le persone sorde a comunicare più facilmente in contesti critici come sanità, emergenze e servizi pubblici.

Citazione: Shahin, N., Ismail, L. ADAT novel time-series-aware adaptive transformer architecture for sign language translation. Sci Rep 16, 6551 (2026). https://doi.org/10.1038/s41598-026-36293-9

Parole chiave: traduzione della lingua dei segni, trasformatore adattivo, attenzione per serie temporali, ASL medico, AI accessibile