Clear Sky Science · it

IASUNet: estrazione degli edifici basata su Swin-UperNet con attenzione migliorata

Perché individuare ogni edificio dallo spazio è importante

Con la crescita delle città e i cambiamenti climatici, sapere con precisione dove si trovano gli edifici — e come cambiano nel tempo — è diventato vitale. Dalla pianificazione di quartieri più sicuri e dal monitoraggio delle costruzioni illegali alla guida delle operazioni di soccorso dopo alluvioni o terremoti, mappe dettagliate degli edifici sono ora un elemento fondamentale delle città intelligenti e resilienti. Questo articolo presenta IASUNet, un nuovo sistema di intelligenza artificiale che impara a individuare automaticamente gli edifici da immagini satellitari ad alta risoluzione con notevole precisione, anche in scene reali complesse e affollate.

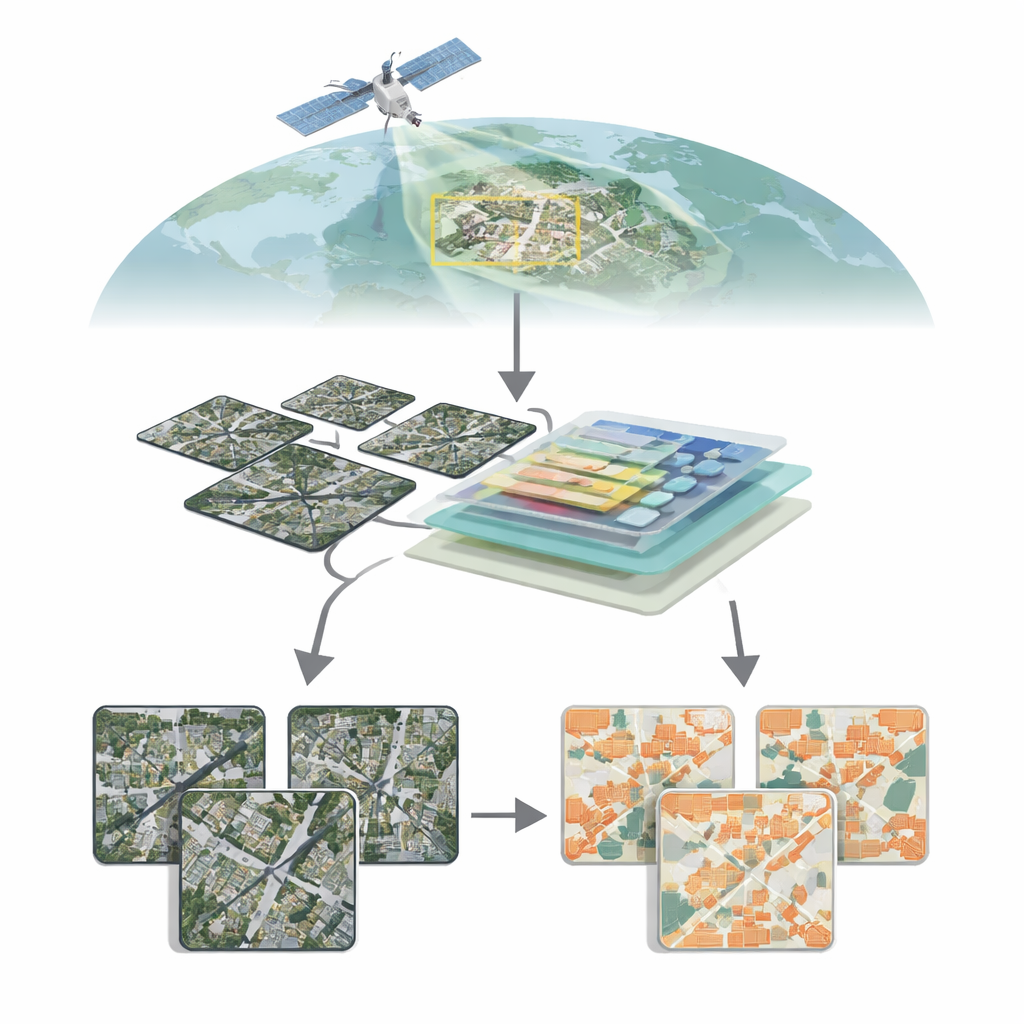

Osservare le città dall'alto

I satelliti moderni possono fotografare la Terra con dettagli straordinari, rivelando singoli tetti, strade e anche vicoli stretti. Trasformare questo mare di pixel in mappe degli edifici pulite, tuttavia, è tutt'altro che banale. Gli edifici variano moltissimo per dimensione, forma, colore e contesto: grattacieli di vetro nei centri urbani, case basse in periferia, edifici agricoli sparsi nelle campagne. In aree rurali o miste, gli edifici possono occupare solo una piccola frazione di ciascuna immagine, mentre vegetazione, suolo e acqua predominano. I metodi tradizionali di visione artificiale, basati principalmente su reti neurali convoluzionali, possono faticare a catturare il quadro d'insieme su un'intera scena pur rispettando confini fini, portando a mancate identificazioni di strutture piccole o a contorni sfocati.

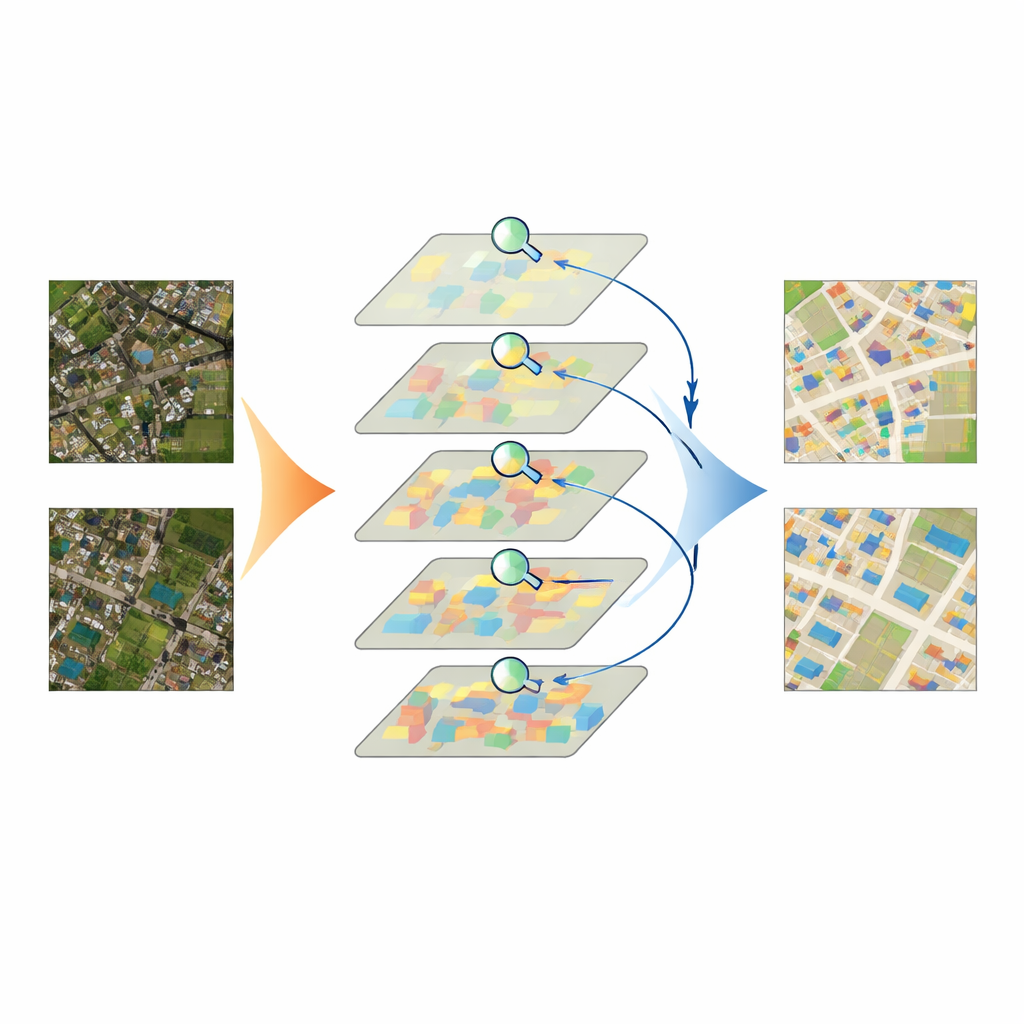

Un'attenzione più intelligente ai dettagli

IASUNet affronta queste sfide combinando due idee potenti: un encoder basato su Transformer chiamato Swin Transformer e un decoder flessibile noto come UperNet. Lo Swin Transformer suddivide un'immagine in molte piccole patch e apprende come esse si relazionano tra loro sull'intera scena, anziché guardare solo attraverso una finestra di dimensione fissa. Questo aiuta il modello a comprendere il contesto più ampio — per esempio se un rettangolo luminoso si trova all'interno di un isolato urbano denso o in un campo isolato — mantenendo però i dettagli. Su questo si innesta un meccanismo di attenzione chiamato Convolutional Block Attention Module (CBAM) in diverse fasi. CBAM impara, canale per canale e regione per regione, quali caratteristiche dell'immagine sono più probabilmente riconducibili agli edifici e quali sono rumore di sfondo, rafforzando le prime e sopprimendo le seconde prima che il decoder ricomponga tutto in una mappa completa degli edifici.

Bilanciare le probabilità quando gli edifici sono rari

Un altro ostacolo pratico è lo sbilanciamento: in molte scene satellitari, la maggior parte dei pixel rappresenta strade, campi, alberi o acqua, mentre gli edifici occupano solo piccole isole. I metodi di addestramento standard tendono a favorire ciò che appare più frequentemente, rischiando di insegnare al modello a considerare gli edifici meno frequenti come secondari. Per contrastare questo, gli autori adattano una funzione di perdita chiamata Focal Cross‑Entropy. Questa strategia riduce l'influenza dei pixel di sfondo «facili» e amplifica l'impatto dei pixel di edificio difficili da classificare durante l'addestramento. Di conseguenza, il modello presta maggiore attenzione a strutture piccole, deboli o insolite che altrimenti potrebbero essere trascurate, migliorando il richiamo senza inondare la mappa di falsi positivi.

Mettere il modello alla prova

Il team ha testato IASUNet su tre dataset noti di edifici provenienti da Germania, Nuova Zelanda e Stati Uniti, oltre che su una raccolta accuratamente curata di immagini satellitari cinesi che hanno preparato e verificato autonomamente. Su questi benchmark, IASUNet ha costantemente eguagliato o superato gli approcci di punta, comprese robuste reti convoluzionali e altri modelli basati su Transformer. Sul dataset ultra‑dettagliato di Potsdam, ha raggiunto una sovrapposizione quasi perfetta tra regioni di edificio previste e reali, pur mantenendo velocità pratiche su hardware grafico moderno. Anche su paesaggi più irregolari, dove gli edifici sono sparsi, parzialmente nascosti o molto vicini tra loro, IASUNet ha tracciato contorni più netti, catturato più bersagli piccoli ed evitato molte delle omissioni e degli errori di confine osservati nei metodi concorrenti.

Dai pixel a città migliori

In termini concreti, lo studio mostra che oggi possiamo insegnare ai computer a leggere i paesaggi urbani dall'orbita con chiarezza senza precedenti. Orientando con cura «l'attenzione» del modello verso le parti giuste di un'immagine e ponderando deliberatamente i pixel di edificio rari ma cruciali, IASUNet trasforma immagini satellitari grezze in mappe degli edifici accurate e aggiornate con un modesto costo computazionale aggiuntivo. Tali mappe possono alimentare la pianificazione urbana, studi sull'energia e sulle isole di calore, regolamentazione dell'uso del suolo e valutazioni rapide dei danni dopo disastri. Pur essendo un lavoro tecnico nel suo nucleo, la conclusione è semplice: un'IA più intelligente può offrire ai decisori una visione più nitida e affidabile dell'ambiente costruito, aiutando le città a crescere in modo più sicuro e sostenibile.

Citazione: Zhang, H., Ma, Y., Wang, G. et al. IASUNet: building extraction based on impoved attention Swin-UperNet. Sci Rep 16, 7969 (2026). https://doi.org/10.1038/s41598-026-36270-2

Parole chiave: telerilevamento, estrazione degli edifici, segmentazione semantica, reti Transformer, mappatura urbana