Clear Sky Science · it

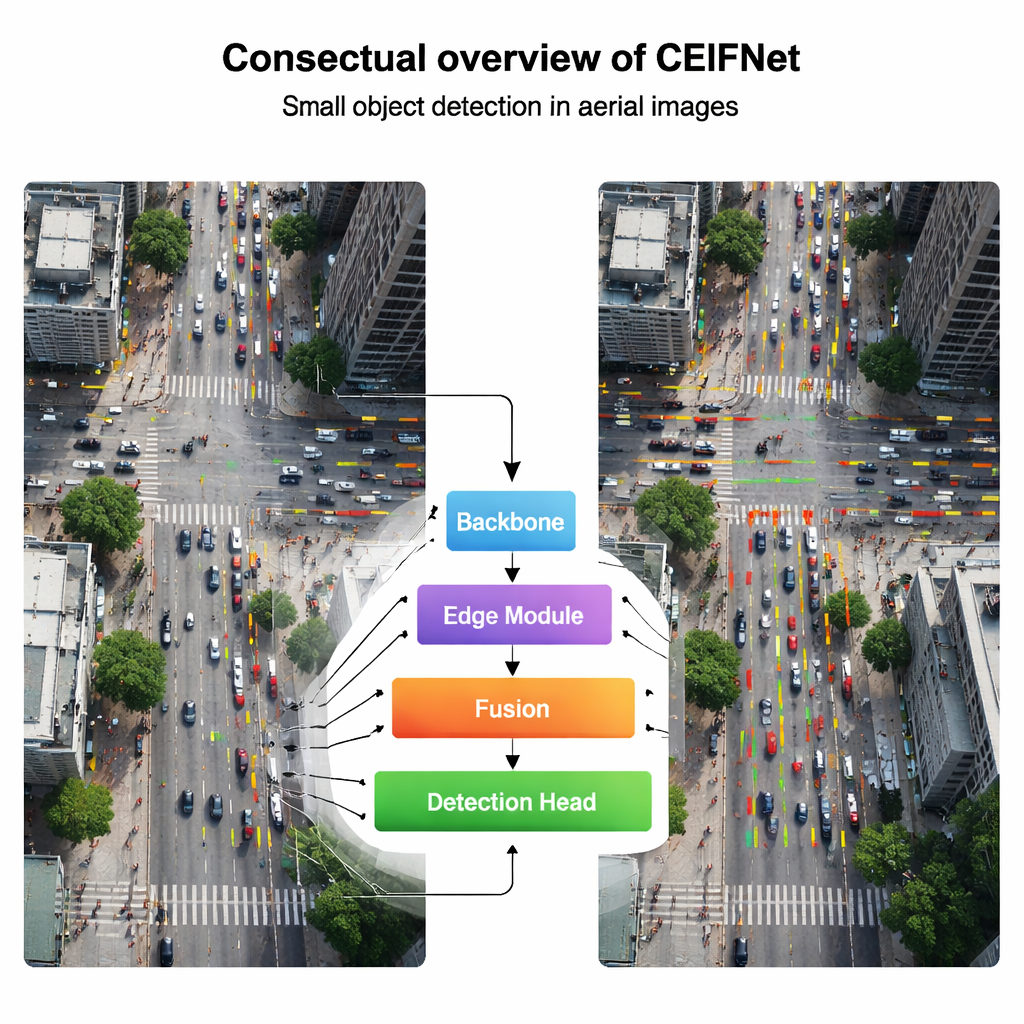

Rete di fusione delle informazioni dei contorni cross-stage per il rilevamento di piccoli oggetti nelle immagini aeree

Perché è importante individuare dettagli minuscoli dall'alto

Dal monitoraggio del traffico e la risposta alle emergenze alla gestione delle colture, sempre più parti del nostro mondo vengono osservate dall'alto dai droni. Tuttavia molte delle cose che ci interessano in queste immagini aeree — persone, auto o animali — appaiono solo come pochi pixel. Questo articolo presenta un nuovo sistema di visione per computer, CEIFNet, progettato specificamente per trovare questi oggetti minuscoli in modo più accurato e rapido, anche quando sono immersi in strade cittadine affollate, campi o disturbi notturni.

Vedere il piccolo in un quadro ampio

I sistemi standard di rilevamento degli oggetti sono stati sviluppati principalmente per foto a livello del suolo, dove un’auto o una persona occupano solitamente una porzione significativa dell’inquadratura. Nelle immagini da drone, invece, la camera può essere a centinaia di metri di altezza, perciò ogni bersaglio è minuscolo e facilmente sfocato o perso quando l’immagine viene ridotta all’interno di una rete neurale. Gli autori spiegano che rilevatori one-shot popolari come la famiglia YOLO funzionano bene per scene quotidiane ma fanno fatica quando gli oggetti sono sia piccolissimi sia molto variabili nelle dimensioni. Il ripetuto sottocampionamento, pensato per comprendere l’intera scena, tende a cancellare i segnali deboli di questi piccoli target.

Combinare visione ravvicinata e contesto d’insieme

Per affrontare il problema, CEIFNet combina due modalità complementari di osservazione. Un percorso usa filtri convoluzionali classici, efficaci nel catturare pattern locali nitidi come angoli e texture. L’altro sfrutta un meccanismo di attenzione in stile Transformer, ottimo nel relazionare parti distanti dell’immagine e comprendere la scena nel suo insieme. All’interno del blocco fondamentale, chiamato blocco trasformatore cross-stage, le feature in ingresso vengono divise: la maggior parte dei canali passa per un percorso convoluzionale leggero, mentre una porzione minore attraversa un percorso di attenzione che ragiona sulle relazioni a lungo raggio. Queste vengono poi ricombinate, fornendo alla rete sia dettagli fini sia consapevolezza globale senza far esplodere il costo computazionale.

Usare i contorni come mappa per i target minuscoli

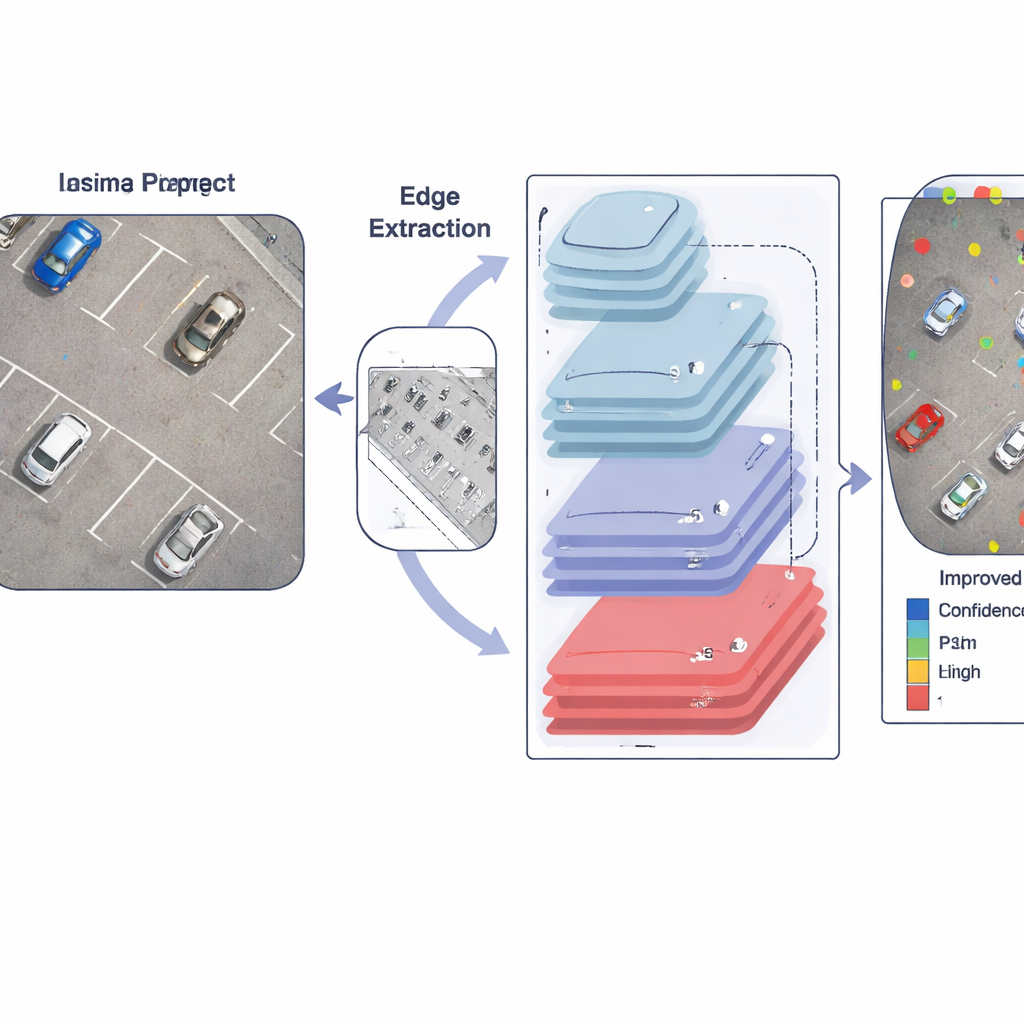

Un'intuizione chiave del lavoro è che i confini degli oggetti — i contorni — sono particolarmente preziosi quando i bersagli sono solo pochi pixel. Invece di affidarsi esclusivamente a filtri appresi, gli autori iniettano deliberatamente informazioni di bordo nella rete. Un modulo dedicato applica prima un operatore di Sobel, un rilevatore di contorni semplice ma robusto, per evidenziare dove la luminosità cambia bruscamente, ad esempio intorno ai profili di auto o persone. Queste mappe di contorni vengono quindi raggruppate (pooled) a più dimensioni per adattarsi a diversi livelli di feature e fuse tramite un modulo cross-channel. Man mano che l’immagine procede più in profondità nella rete, questi segnali di contorno affinati vengono reinseriti ripetutamente negli strati successivi, aiutando il modello a tenere traccia di dove iniziano e finiscono i piccoli oggetti nonostante la consueta sfocatura e riduzione.

Adattarsi a dimensione, posizione e complessità della scena

All’uscita, CEIFNet usa una testa di rilevamento dinamica che può adattare il suo comportamento in base a ciò che rileva. Invece di usare filtri fissi, questa fase finale applica contemporaneamente tre forme di attenzione: può preferire certe dimensioni di oggetto, concentrarsi sulle posizioni più promettenti nell’immagine e enfatizzare i canali di feature più informativi. Insieme a una struttura a piramide di feature che conserva uno strato extra a grana fine, questo rende il sistema più reattivo nei confronti di target minuscoli e densi in filmati reali da drone, dalle intersezioni affollate ai parcheggi pieni e alle scene termiche a infrarossi notturne.

Dimostrare i miglioramenti in scenari reali da drone

I ricercatori hanno testato CEIFNet su due dataset impegnativi per droni: VisDrone2019, composto da scene urbane e suburbane in luce diurna, e HIT-UAV, una collezione a infrarossi termici dove molti bersagli sono deboli e piccoli. In entrambi i casi, il nuovo sistema ha rilevato gli oggetti con maggiore accuratezza rispetto a una solida baseline basata su YOLO e a una serie di altri rilevatori moderni, pur mantenendo una velocità adeguata per l’uso in tempo reale su una potente GPU. Esperimenti di ablazione accurati hanno mostrato che ciascun componente — il blocco ibrido, il modulo di contorni, lo strato fine aggiuntivo e la testa dinamica — ha contribuito al miglioramento complessivo.

Cosa significa per la tecnologia di tutti i giorni

Per i non specialisti, la conclusione è che CEIFNet offre un modo più intelligente per i droni di “accorgersi delle piccole cose” in scene ampie e complesse. Conservando le informazioni sui contorni, mescolando dettaglio locale e contesto globale e adattando dinamicamente l’attenzione, la rete può individuare piccoli oggetti che altri sistemi mancano o localizzano in modo errato. Questo rende il monitoraggio aereo più affidabile per compiti come la sicurezza stradale, le ricerche e soccorsi e l’agricoltura di precisione, e indica la strada verso sistemi futuri in grado di estrarre informazioni attendibili da visuali sempre più alte e ampie del nostro mondo.

Citazione: Xiao, J., Li, C., Chen, H. et al. Cross-stage edge information fusion network for small object detection in aerial images. Sci Rep 16, 7639 (2026). https://doi.org/10.1038/s41598-026-36251-5

Parole chiave: rilevamento di oggetti aerei, oggetti piccoli, imaging da drone, visione basata sui contorni, deep learning