Clear Sky Science · it

Sicurezza ed efficacia di modelli che preservano la privacy per creare sommari in linguaggio semplice di referti di risonanza magnetica cerebrale

Perché il tuo referto può sembrare così confuso

Sempre più pazienti possono leggere i propri risultati online, inclusi referti radiologici dettagliati provenienti da esami cerebrali. Ma questi documenti sono scritti per i medici, non per i pazienti, e sono pieni di termini poco familiari che possono alimentare ansia anziché rassicurazione. Questo studio si chiede se i moderni programmi di intelligenza artificiale (IA) possano trasformare in modo sicuro referti reali di risonanza magnetica cerebrale effettuati in pronto soccorso — scritti in francese per persone con cefalea — in sommari in linguaggio semplice che i pazienti possano effettivamente comprendere, senza inviare dati medici sensibili a server commerciali remoti.

Trasformare il linguaggio dei medici in parole di tutti i giorni

I ricercatori si sono concentrati sui “sommari per i non addetti”: brevi spiegazioni che mantengono i fatti medici ma li traducono in un linguaggio quotidiano e collegano direttamente i riscontri ai sintomi del paziente. Hanno utilizzato tre grandi modelli linguistici (LLM) — Llama 3.3, Athene V2 e Mistral Small — eseguiti interamente su computer all’interno di un ospedale universitario francese, in modo che nessun referto lasciasse mai la rete protetta dell’ospedale. A ciascun sistema IA è stata fornita la stessa istruzione: scrivere in francese un sommario di 4–6 frasi per un paziente, coprendo tutti i punti chiave, spiegando i termini difficili e collegando i reperti della scansione alla cefalea del paziente.

Come i medici hanno valutato accuratezza e sicurezza

Da quasi 600 referti di risonanza magnetica cerebrale redatti nel 2022 per pazienti del pronto soccorso con cefalea, il team ne ha selezionati casualmente 105. Tre neuroradiologi esperti hanno letto ciascun referto originale insieme a tre sommari anonimi generati dall’IA (uno per ogni modello). Li hanno valutati per correttezza medica, completezza, utilità nell’informare il paziente e per stabilire se il testo fosse sufficientemente buono da essere mostrato direttamente nel portale online del paziente. In media, le valutazioni sono state elevate: i medici hanno giudicato i sommari ampiamente accurati e completi, e spesso adatti all’uso clinico. Tuttavia, circa un referto su cinque conteneva almeno un problema, come una spiegazione errata di un’abbreviazione, una descrizione anatomica leggermente imprecisa, una formulazione goffa o un dettaglio inventato non presente nel referto originale.

Cosa hanno davvero capito i non medici

Per verificare se questi sommari aiutassero davvero i lettori comuni, i ricercatori hanno reclutato 11 non medici che lavorano in informatica sanitaria e che gestiscono regolarmente dati sanitari ma non sono medici. Questo gruppo ha valutato 30 referti di RM, alcuni nella forma originale e altri con l’aggiunta di un sommario generato dall’IA. Hanno indicato quanto bene ritenevano di aver compreso ogni referto, quanto erano fiduciosi di poter spiegare i risultati a familiari o amici e quanto ansiosi si sarebbero sentiti se il referto fosse stato il loro. Hanno anche risposto a semplici domande sì/no: c’è qualcosa di anomalo in questo referto, e c’è un reperto che potrebbe ragionevolmente spiegare la cefalea del paziente?

Referti più chiari, guadagni di comprensione modesti ma reali

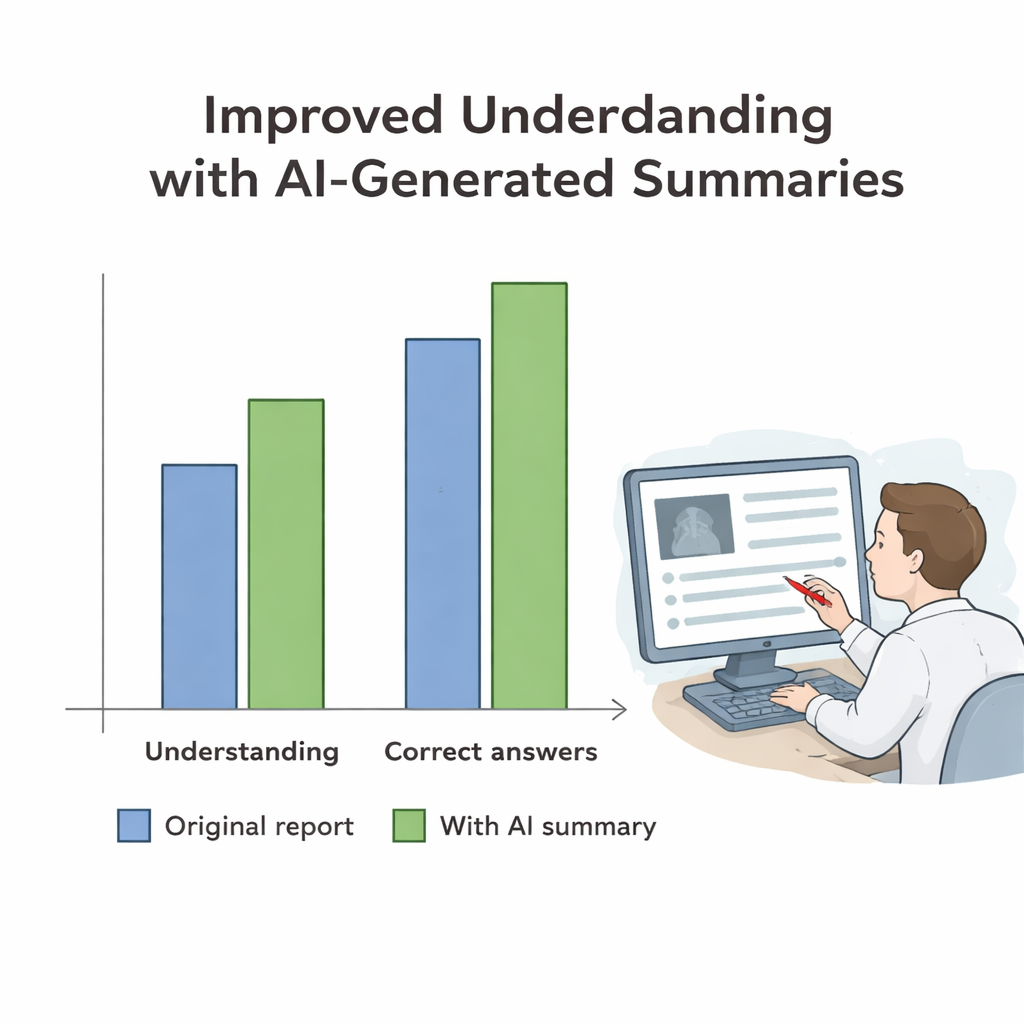

L’aggiunta dei sommari generati dall’IA ha aumentato notevolmente la percezione di comprensione dei partecipanti, facendo salire la valutazione media dell’intesa da livelli “moderati” a livelli “alti”. Anche la loro fiducia nel poter discutere i risultati con altri è aumentata, mentre l’ansia riportata è diminuita leggermente. Per quanto riguarda la comprensione oggettiva, l’effetto è stato più modesto ma comunque significativo. I partecipanti sono migliorati nell’individuare quando una scansione era anormale e nel riconoscere reperti che potrebbero effettivamente causare la cefalea, con miglioramenti concentrati nei referti che contenevano anomalie reali. Per gli esami normali, le persone erano già vicine alla perfezione nel riconoscere che non era stato trovato nulla di grave, quindi i sommari hanno aggiunto poco beneficio extra.

Perché la supervisione umana continua a essere importante

Sebbene questi strumenti di IA che preservano la privacy abbiano migliorato sostanzialmente la chiarezza percepita e offerto piccoli ma importanti guadagni nella comprensione fattuale, non erano infallibili. Circa il 20% dei sommari conteneva errori medici o linguistici, spesso legati ad abbreviazioni mediche insidiose o all’inserimento di parole inglesi o cinesi in frasi in francese. Poiché anche piccoli errori possono fuorviare i pazienti, gli autori sostengono che l’IA debba essere usata in un sistema “human‑in‑the‑loop”: il modello redige un sommario adatto al paziente e un radiologo lo verifica e lo corregge rapidamente prima che raggiunga il paziente. Usata in questo modo, lo studio suggerisce che l’IA locale potrebbe aiutare gli ospedali a offrire spiegazioni dei risultati della risonanza magnetica cerebrale più chiare e rassicuranti, mantenendo al sicuro i dati sanitari sensibili all’interno delle loro mura.

Citazione: Le Guellec, B., Bentegeac, R., Shorten, L. et al. Safety and efficacy of privacy-preserving models to create Lay summaries of brain MRI reports. Sci Rep 16, 6316 (2026). https://doi.org/10.1038/s41598-026-36081-5

Parole chiave: referti radiologici, comunicazione con il paziente, risonanza magnetica cerebrale, grandi modelli linguistici, privacy medica