Clear Sky Science · it

Navigazione autonoma in ambienti esterni non strutturati usando apprendimento per rinforzo guidato dalla segmentazione semantica

I robot che imparano a fare escursioni nel bosco

Immaginate un piccolo robot in grado di percorrere da solo un sentiero forestale, destreggiandosi tra alberi e massi senza GPS né un operatore che tiene un joystick. Questo articolo descrive un sistema che insegna a tali robot a «vedere» i sentieri nei boschi fitti e a decidere, momento dopo momento, come muoversi in sicurezza. Il lavoro è rilevante per robot futuri che potrebbero aiutare nel monitoraggio forestale, nella prevenzione degli incendi, nelle operazioni di soccorso e persino nelle consegne all’aperto in aree dove i segnali satellitari sono deboli o assenti.

Perché i boschi sono così difficili per i robot

I boschi sono tra gli ambienti più impegnativi per macchine autonome. I sentieri possono essere stretti e tortuosi, il terreno è irregolare, rami e cespugli spesso ostruiscono la visuale e gli alberi alti rendono il GPS inaffidabile. I metodi tradizionali di navigazione dipendono da mappe precise, da un GPS forte o da costosi sensori laser, e spesso presuppongono spazi chiari e strutturati come strade cittadine o pavimenti di fabbrica. Nel bosco queste assunzioni collassano: ombre, stagioni diverse e vegetazione fitta confondono i sistemi di visione semplici, mentre i controllori basati su regole faticano a gestire tutte le situazioni disordinate e impreviste che emergono su un sentiero reale.

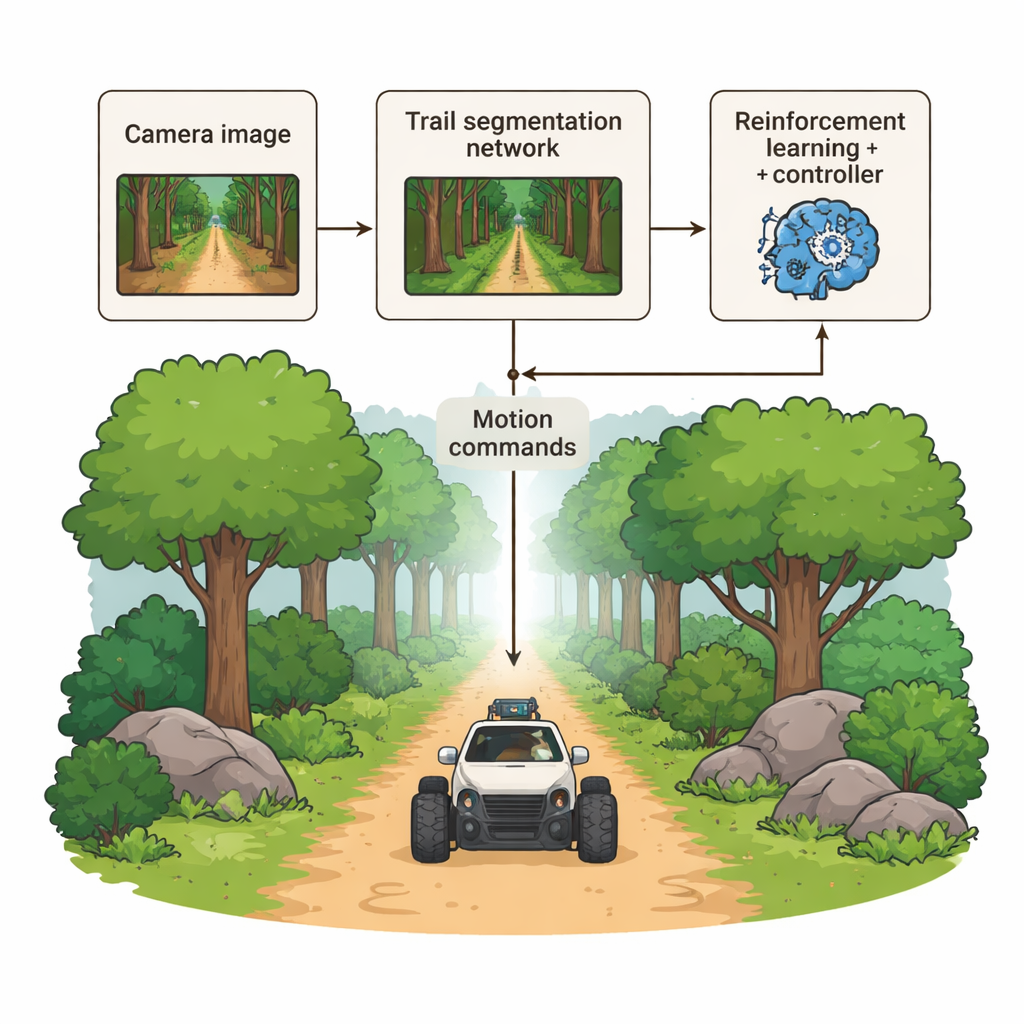

Tre cervelli che lavorano insieme

Gli autori propongono un sistema di navigazione ibrido che dota i robot di tre «cervelli» complementari. Primo, un modulo di visione profonda analizza ogni immagine della camera e marca, quasi pixel per pixel, quali parti appartengono al sentiero calpestabile. Secondo, un modulo decisionale basato sull’apprendimento usa il reinforcement learning per scegliere comandi fluidi di sterzata e velocità, premiando comportamenti che restano sul sentiero, evitano collisioni e raggiungono la meta in modo efficiente. Terzo, un controllore classico trasforma la forma del sentiero prevista in movimenti delle ruote stabili, smussando movimenti improvvisi e mantenendo il percorso del robot aggraziato piuttosto che scattoso. Invece di una singola rete opaca end-to-end, questi moduli sono separati ma strettamente collegati, permettendo agli ingegneri di comprendere e debuggare ogni fase.

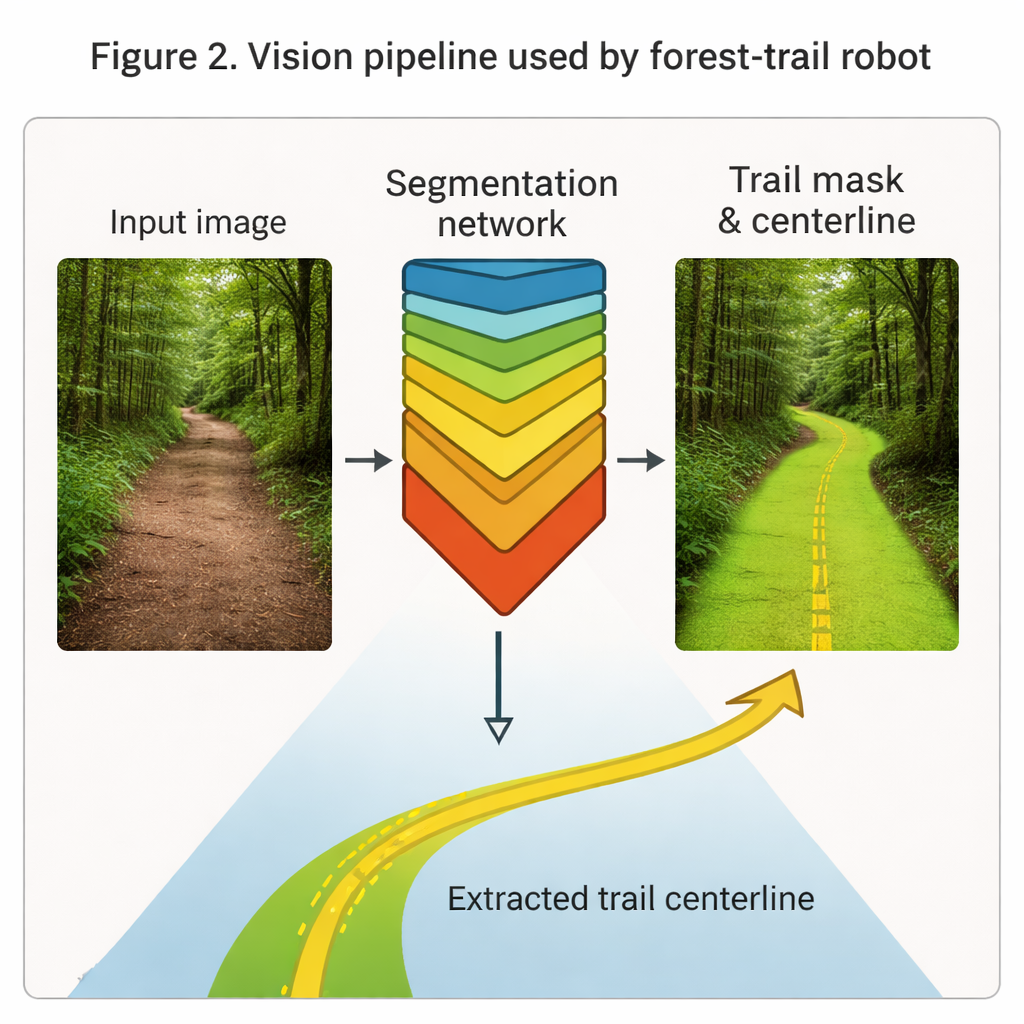

Insegnare alla visione a riconoscere i sentieri

Al centro degli «occhi» del robot c’è una rete profonda nota come Mask R-CNN, qui messa a punto per evidenziare i sentieri forestali in immagini a colori ordinarie. Addestrata su quasi 24.000 fotogrammi etichettati di riprese reali fatte dall’altezza di una persona e in condizioni di luce, tempo e tipi di sentiero variabili, il sistema impara a colorare l’area del sentiero in ogni fotogramma come una maschera pulita. Da questa maschera estrae una sottile curva di centro che cattura la direzione e la curvatura del percorso davanti. Nei test, il modulo di visione raggiunge un’elevata sovrapposizione con le etichette disegnate dall’uomo e oltre il 90% di accuratezza a livello di pixel, delineando in modo robusto i sentieri anche quando rami o ombre ne nascondono parzialmente il tracciato. Questi indizi geometrici alimentano direttamente sia i moduli di apprendimento sia quelli di controllo come descrizione compatta di «dove si trova il sentiero».

Addestrare un robot a fare buone scelte

Il secondo elemento chiave è il modulo decisionale, che usa una tecnica chiamata apprendimento per rinforzo. Invece di ricevere istruzioni dettagliate su cosa fare, il robot prova azioni in una foresta simulata realistico e ottiene ricompense per risultati positivi e penalità per quelli negativi. Procedere lungo il sentiero è positivo; allontanarsi, collidere con ostacoli o restare incastrati è negativo. In circa 150.000 passi di addestramento, il sistema scopre gradualmente strategie che lo mantengono centrato sul sentiero, gestiscono le curve con eleganza e reagiscono in modo sensato quando rami o massi appaiono sulla sua strada. Per mantenere i movimenti fluidi e sicuri, le azioni apprese possono essere miscelate con quelle del controllore classico, particolarmente utile nelle curve strette o in condizioni rumorose.

Mettere il sistema alla prova

Per valutare l’efficacia di questa combinazione, i ricercatori hanno costruito tre foreste virtuali dettagliate: una con sentieri stretti e ingombrati, un’altra con terreno ripido e irregolare e grandi ostacoli, e una terza piena di bivi, vicoli ciechi e falsi sentieri distraenti. Su 90 prove in queste mappe, il robot ha raggiunto la meta senza collisioni in circa l’87% degli episodi, con una media di soli 0,2 urti per corsa e rimanendo tipicamente entro circa 30 centimetri dal centro del sentiero. Ha inoltre completato i percorsi in modo rapido e coerente. Quando gli autori hanno rimosso o semplificato uno dei moduli alla volta, le prestazioni sono calate drasticamente, dimostrando che tutti e tre i componenti sono necessari. Rispetto ad altri sistemi recenti, inclusi quelli che usano scanner laser, questo approccio ibrido basato solo sulla visione ha offerto la migliore combinazione complessiva di tasso di successo, precisione e sicurezza.

Cosa significa per i robot nel mondo reale

Per un non specialista, la conclusione è che i robot stanno migliorando nel camminare sui sentieri come utenti cauti e competenti. Combinando un forte senso del contesto visivo («questo è il percorso»), decisioni fondate sull’esperienza («queste manovre hanno funzionato bene in passato») e un meccanismo di sterzata stabile, il sistema proposto permette a un piccolo robot su ruote di navigare boschi complessi senza mappe o GPS. Sebbene il lavoro sia stato testato in simulazione e affronti ancora sfide come illuminazione estrema e tipi di sentiero rari, offre un progetto pratico per robot di campo futuri che possano condividere in sicurezza ambienti selvatici con le persone, aiutandoci a ispezionare le foreste, supportare le squadre di soccorso e gestire le risorse naturali in modo più efficace.

Citazione: Tibermacine, A., Tibermacine, I.E., Akrour, D. et al. Autonomous navigation in unstructured outdoor environments using semantic segmentation guided reinforcement learning. Sci Rep 16, 2633 (2026). https://doi.org/10.1038/s41598-026-36022-2

Parole chiave: navigazione autonoma, robotica forestale, visione artificiale, apprendimento per rinforzo, segmentazione semantica