Clear Sky Science · it

Un sistema intelligente di riconoscimento delle emozioni basato su IoT utilizzando parametri corporei interni

Perché le tue emozioni potrebbero presto diventare un segno vitale

Immagina il tuo smartwatch che monitora silenziosamente non solo i passi e la frequenza cardiaca, ma anche quanto sei stressato, calmo o gioioso durante la giornata—e che avvisi il tuo medico prima che insorgano esaurimento o depressione. Questo articolo descrive un passo verso quel futuro: un sistema intelligente che legge i segnali corporei interni, li invia tramite l’Internet delle Cose (IoT) e usa l’apprendimento automatico per determinare quale emozione stai provando in tempo reale.

Ascoltare i sentimenti attraverso il corpo

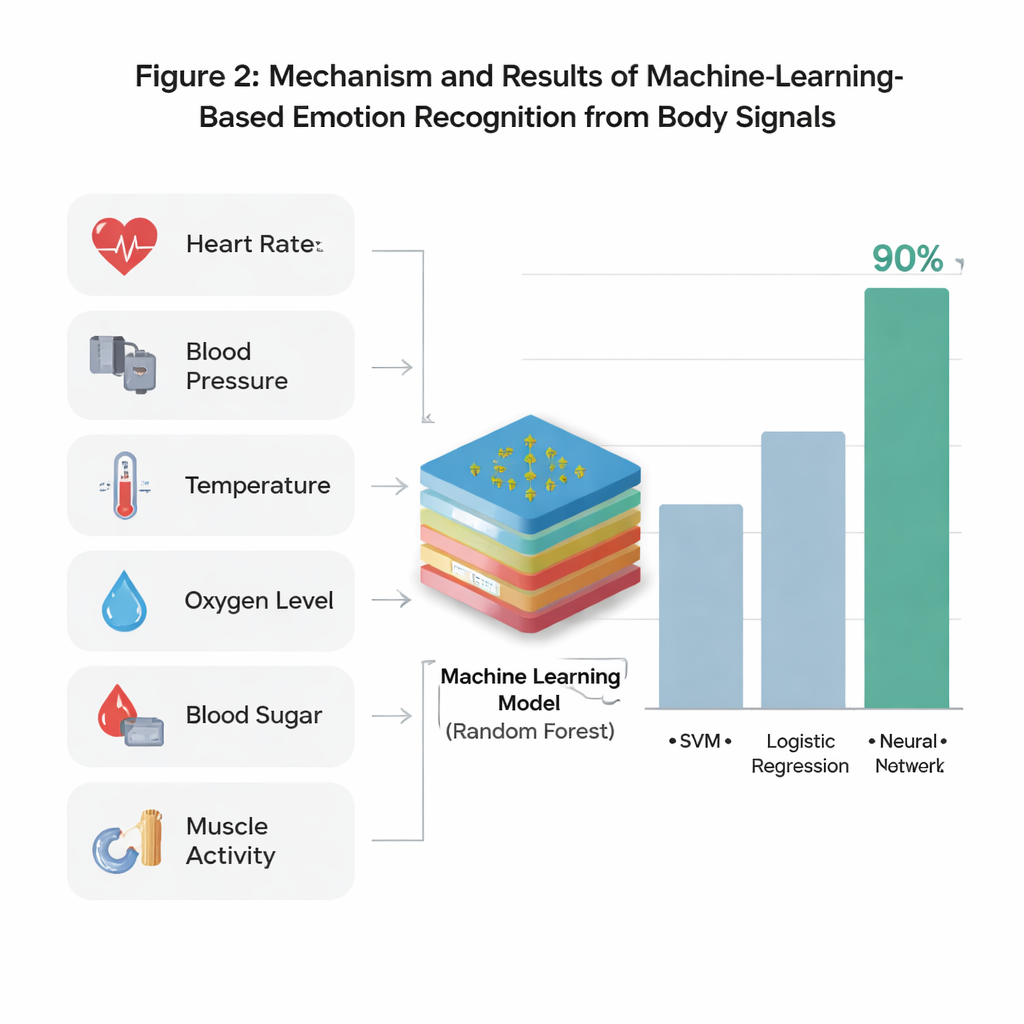

Le nostre emozioni non risiedono solo sul volto o nella voce; si irradiano attraverso il corpo. Quando siamo arrabbiati, la pressione sanguigna può aumentare. La paura può accelerare il battito, mentre la tristezza può rallentarci. I ricercatori dietro questo studio si sono proposti di costruire un sistema che legga queste perturbazioni interne e le traduca in sei stati emotivi comuni: neutro, felice, triste, paura, rabbia e sorpresa. Invece di telecamere o microfoni, si sono basati su misurazioni corporee interne—come frequenza cardiaca, pressione sanguigna, temperatura corporea, glicemia, saturazione di ossigeno e attività muscolare—rilevate da sensori indossabili e inviate a un sistema informatico per l’analisi.

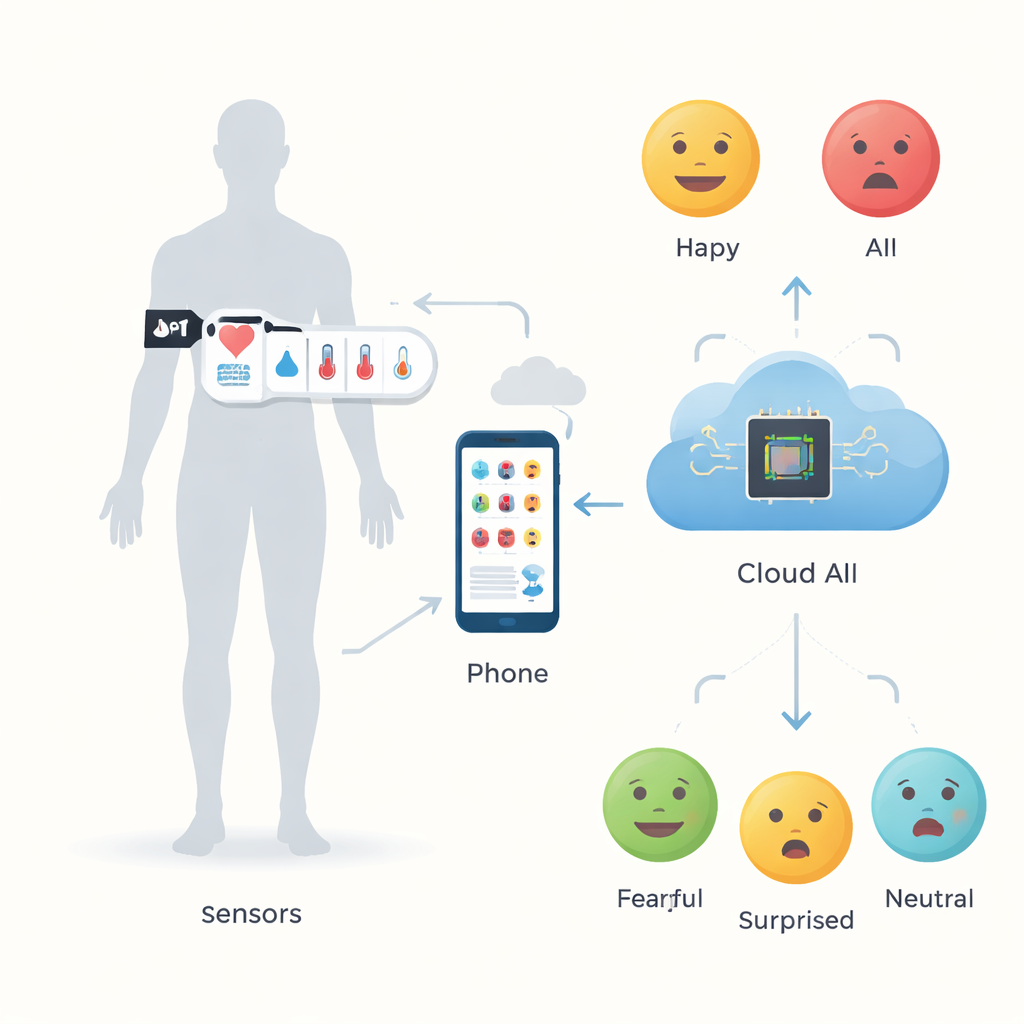

Trasformare un indossabile in un radar delle emozioni

Il team ha progettato un bracciale multi-sensore abbinato a un piccolo microcontrollore con connettività Wi‑Fi. Questo dispositivo raccoglie più flussi di dati contemporaneamente: la velocità del battito cardiaco, la temperatura della pelle, la quantità di ossigeno trasportata dal sangue, la tensione muscolare, i livelli di pressione arteriosa e le fluttuazioni della glicemia. Questi segnali viaggiano senza fili verso un telefono o un gateway vicino e poi a server basati su cloud. Lì i dati vengono puliti—rimuovendo il rumore, correggendo errori evidenti e normalizzando le unità—prima di essere memorizzati in database locali e cloud. Esperti medici hanno aiutato a definire intervalli realistici per ogni parametro e hanno elaborato regole che collegano pattern specifici di variazione corporea alle emozioni probabili, creando un dataset etichettato per addestrare i modelli di apprendimento automatico.

Insegnare alle macchine a leggere gli stati d’animo

Con un ampio insieme di esempi etichettati, i ricercatori hanno testato undici diversi metodi di apprendimento automatico per vedere quale potesse indovinare meglio l’emozione di una persona a partire dalle letture interne. Questi includevano tecniche note come regressione logistica, macchine a vettori di supporto, k‑nearest neighbors, reti neurali e diversi metodi “ensemble” che combinano molti semplici alberi decisionali. L’approccio Random Forest—un metodo che vota tra molti alberi decisionali—è risultato il migliore. Sul loro dataset principale, ha identificato correttamente le sei emozioni in circa il 91% dei casi nei test standard, e circa il 93% quando verificato più rigorosamente mediante una procedura di validazione incrociata k‑fold che aiuta a proteggere dall’overfitting.

Testare il sistema oltre il laboratorio

Per verificare se il modello funzionasse su persone e situazioni al di fuori dei dati di addestramento, il team ha eseguito un test esterno utilizzando un benchmark emotivo ampiamente usato chiamato DEAP. In questo contesto, i volontari hanno guardato video attentamente selezionati per evocare diverse sensazioni, mentre i loro segnali interni venivano misurati con la stessa configurazione di sensori. Il modello Random Forest addestrato, senza essere riaddestrato, è stato quindi incaricato di classificare queste nuove registrazioni. Ha raggiunto circa il 94% di accuratezza, con punteggi solidi su tutte le emozioni—evidenza che il sistema può generalizzare oltre il campione originale. Gli autori sostengono che ciò valida sia la scelta dei segnali corporei sia il progetto complessivo, che abbraccia hardware di sensori, comunicazione IoT, archiviazione cloud e software intelligente.

Da prototipo di ricerca a compagno quotidiano

Per un non specialista, la conclusione principale è semplice: i segnali nascosti del tuo corpo possono rivelare in modo affidabile come ti senti, e i computer possono imparare a leggerli. Questo lavoro mostra che una rete di sensori indossabili, connessi tramite internet e analizzati con algoritmi avanzati, può monitorare le emozioni in modo non invasivo e in tempo quasi reale. Sebbene l’attuale sistema presenti limiti—come una dimensione del campione modesta e la focalizzazione su sole sei emozioni di base—indica la direzione verso strumenti futuri che potrebbero supportare la salute mentale, personalizzare le esperienze digitali, monitorare persone sole o vulnerabili a casa e rendere gli ambienti intelligenti più sensibili alla nostra vita interiore.

Citazione: Rashid, T., Bajwa, I.S. & Kim, J. An IoT-based smart emotion recognition system by using internal body parameters. Sci Rep 16, 7210 (2026). https://doi.org/10.1038/s41598-026-35982-9

Parole chiave: riconoscimento delle emozioni, sensori indossabili, segnali fisiologici, Internet delle Cose, apprendimento automatico