Clear Sky Science · it

Valutazione dei fattori che influenzano l’efficacia didattica nelle università utilizzando tecniche fuzzy e di deep learning

Perché misurare meglio l’insegnamento è importante

Chiunque abbia seguito sia lezioni eccellenti sia lezioni meno buone sa che la qualità dell’insegnamento può fare la differenza nell’esperienza universitaria. Eppure molte università continuano a basarsi su strumenti rozzi come i voti degli esami e i questionari di fine corso per valutare ciò che funziona. Questo articolo esplora un modo più intelligente di misurare quanto bene insegnano le università combinando due metodi informatici—uno che gestisce bene dati umani sfumati e un altro che eccelle nell’individuare schemi nascosti. Insieme, promettono orientamenti più affidabili per migliorare i corsi e sostenere gli studenti.

Ripensare come giudichiamo una “buona lezione”

L’insegnamento universitario è plasmato da molte variabili: il numero di studenti in aula, l’esperienza dell’insegnante, la difficoltà del corso, l’atmosfera in aula e l’uso della tecnologia, per citarne alcune. I sistemi di valutazione tradizionali spesso riducono tutto questo a un singolo punteggio d’esame o a una valutazione numerica del corso. Questa semplificazione trascura contesti importanti e ignora il lato disordinato e soggettivo dell’apprendimento. Gli autori sostengono che se vogliamo capire perché alcune lezioni aiutano gli studenti a prosperare mentre altre non riescono, servono strumenti in grado di gestire molteplici fattori contemporaneamente e di affrontare informazioni imperfette e basate su opinioni.

Un approccio ibrido “umano” e “individuazione di schemi”

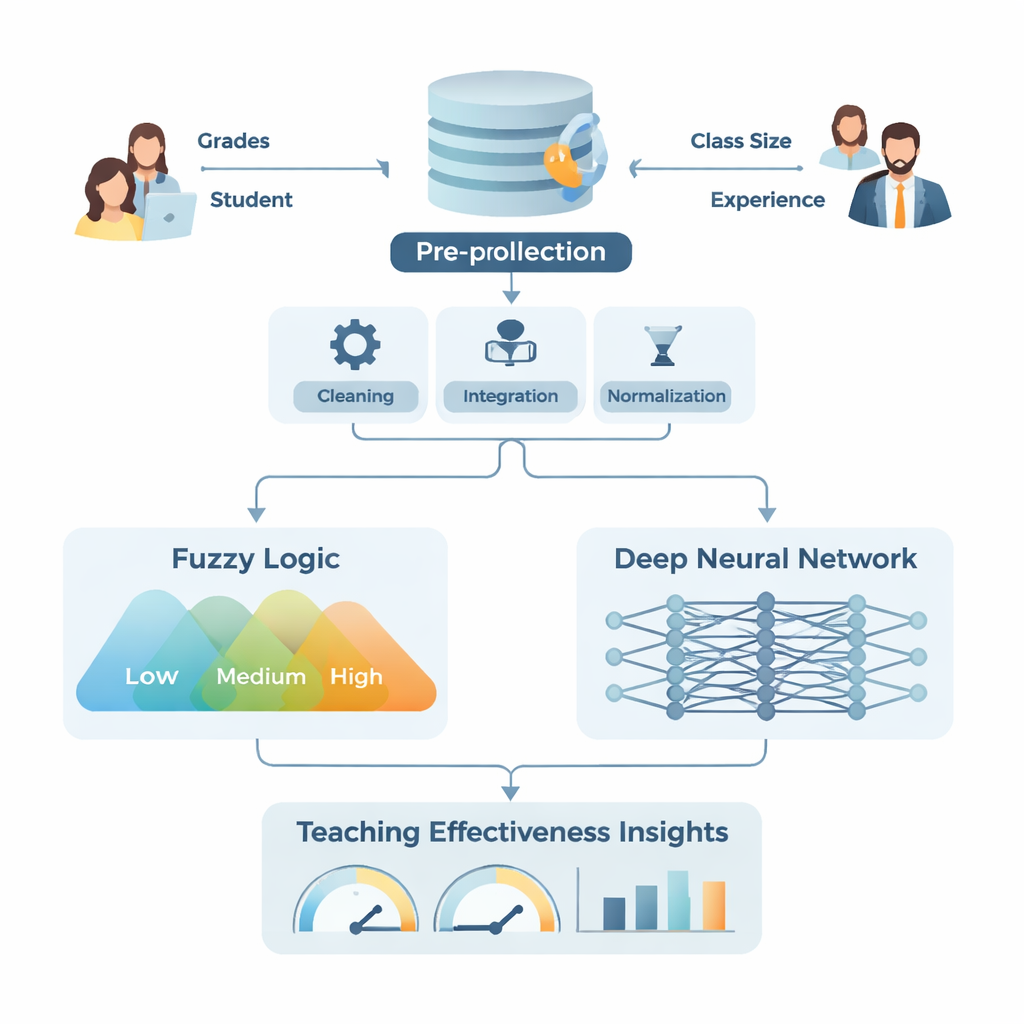

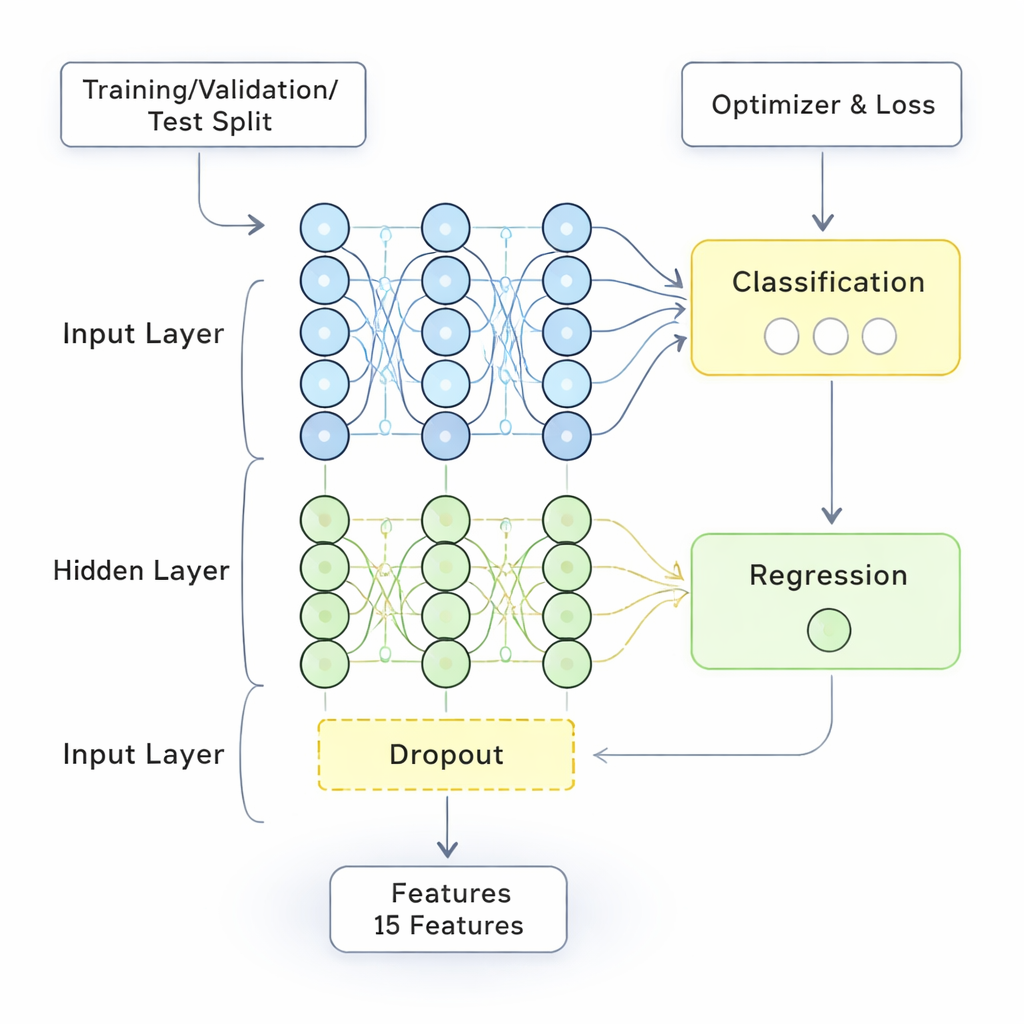

Lo studio introduce un modello ibrido chiamato Fuzzy and Deep Learning (FDL). La parte “fuzzy” imita il modo in cui le persone pensano in sfumature di grigio piuttosto che in categorie nette sì/no—forse ad esempio valutando la performance di uno studente come “bassa”, “media” o “alta” con transizioni morbide anziché soglie rigide. Converte input vaghi come l’esperienza didattica, il rapporto studenti-docente e la difficoltà del corso in categorie flessibili, poi usa regole semplici del tipo “se la performance degli studenti è alta e la classe è piccola, l’efficacia didattica è alta.” Nel frattempo, la componente di deep learning è una rete a strati che elabora grandi quantità di dati puliti e standardizzati, scoprendo legami complessi che potrebbero non essere evidenti ai revisori umani.

Dai questionari grezzi a segnali significativi

Per verificare il loro approccio, i ricercatori hanno utilizzato i dati del National Survey of Student Engagement, un ampio questionario largamente usato compilato da studenti del primo e dell’ultimo anno in college e università nordamericane. Hanno adattato diverse domande per concentrarsi più attentamente su quanto i docenti svolgono i loro ruoli, quindi hanno controllato l’affidabilità del questionario rivisto. Successivamente hanno eseguito una pipeline accurata di preparazione dei dati: correzione degli errori, imputazione dei valori mancanti, unione delle informazioni da lato studenti e lato docenti e scalatura di tutto su una scala comune. Hanno anche creato indicatori combinati, come un voto complessivo ponderato basato su risultati d’esame, completamento dei compiti e frequenza, e hanno ridotto la complessità dei dati usando una tecnica standard chiamata analisi delle componenti principali. Questo dataset preparato ha alimentato sia il modulo di logica fuzzy, che gestiva categorie imprecise, sia la rete di deep learning, che affrontava pattern numerici ad alta dimensionalità.

Quanto bene funziona il nuovo modello?

Il modello FDL è stato addestrato e testato su porzioni separate dei dati per evitare di ingannarsi con esempi già noti. Le sue prestazioni sono state confrontate con diverse alternative solide, incluse reti neurali standard e modelli deep più avanzati. Sulle misure chiave—accuratezza complessiva, precisione, richiamo e F1-score—il metodo ibrido ha eguagliato o superato le soluzioni concorrenti, raggiungendo circa il 98% di accuratezza e un basso tasso d’errore poco superiore al 10%. Altrettanto importante, le regole fuzzy hanno reso le decisioni più interpretabili rispetto ai modelli a scatola nera. Il sistema poteva evidenziare quali combinazioni di fattori—come classi numerose abbinate a bassa esperienza docente, o corsi esigenti supportati da un feedback solido—erano più fortemente correlate a esiti didattici migliori o peggiori.

Cosa significa questo per studenti e atenei

In termini pratici, lo studio dimostra che oggi è possibile costruire un “barometro dell’insegnamento” automatizzato, sia altamente accurato sia ragionevolmente comprensibile. Invece di affidarsi principalmente a medie grezze e questionari sporadici, le università potrebbero usare questo tipo di sistema per individuare precocemente ambienti didattici deboli, identificare quali docenti o corsi necessitano di interventi mirati e verificare se nuove politiche aiutano effettivamente gli studenti a imparare di più. Gli autori sottolineano che il modello non è perfetto—dipende dalla qualità dei dati, può richiedere risorse computazionali significative e semplifica necessariamente il ricco aspetto umano dell’istruzione. Tuttavia, se usato con attenzione, offre una nuova lente potente per rendere le aule universitarie più efficaci, eque e reattive alle esigenze degli studenti.

Citazione: He, Z., Zhang, X., Zhang, Z. et al. Assessment of influencing factors of college and universities’ teaching effects using fuzzy and deep learning techniques. Sci Rep 16, 5168 (2026). https://doi.org/10.1038/s41598-026-35940-5

Parole chiave: efficacia didattica, istruzione superiore, risultati degli studenti, logica fuzzy, deep learning