Clear Sky Science · it

Comprendere il discorso sulla salute mentale su Reddit con i transformer e l’esplicabilità

Perché conta parlare delle emozioni online

Molte persone che affrontano ansia, depressione, disturbo bipolare o disturbo borderline di personalità si rivolgono a internet prima ancora di parlare con un professionista. Reddit, con le sue comunità anonime, è diventato un enorme punto d’incontro per condividere paure, chiedere aiuto e sostenere gli altri. Questo studio esplora come appaiono migliaia di queste conversazioni e come l’intelligenza artificiale può classificarle e mettere in evidenza le parole che le persone usano più frequentemente quando parlano di diverse sfide legate alla salute mentale.

Dare uno sguardo alle comunità di supporto

I ricercatori si sono concentrati su quattro grandi comunità Reddit dedicate ad ansia, depressione, disturbo bipolare e disturbo borderline di personalità (spesso abbreviato in BPD). Ogni post nel loro dataset era semplicemente etichettato in base alla comunità da cui proveniva, non da una diagnosi medica. Il gruppo ha trattato queste comunità come “spazi di preoccupazione”, dove persone con difficoltà simili si riuniscono per sfogarsi, cercare consigli e offrire conforto. Studiando come il linguaggio differisce tra questi spazi, hanno cercato di capire come le persone descrivono le loro esperienze con parole proprie, al di fuori di una clinica.

Addestrare i computer a classificare le conversazioni

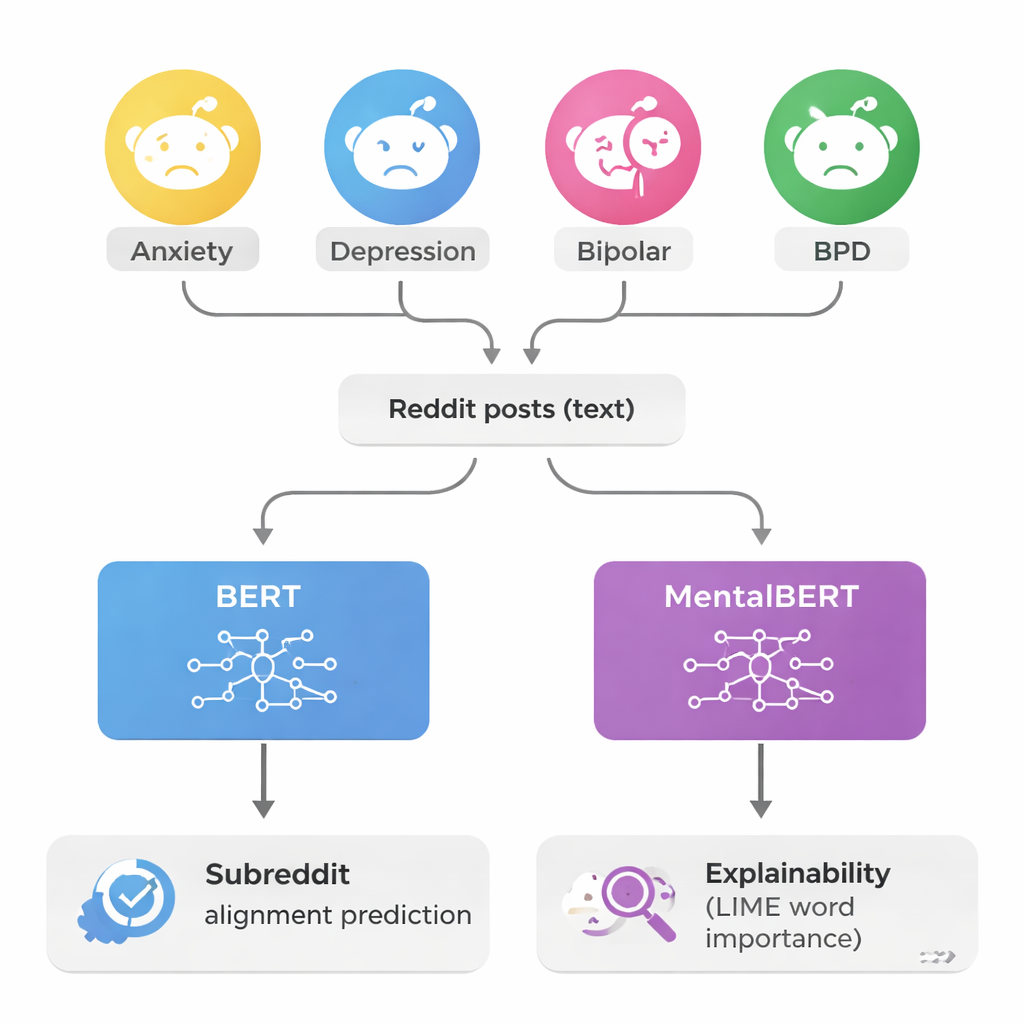

Per analizzare più di 150.000 post, gli autori hanno utilizzato potenti modelli linguistici chiamati transformer, in particolare BERT e una versione focalizzata sulla salute mentale denominata MentalBERT. Questi modelli leggono ogni post e cercano di indovinare a quale delle quattro comunità appartiene. Poiché alcune comunità avevano molti più post di altre, il team ha bilanciato con attenzione il dataset in modo che ogni gruppo fosse rappresentato equamente. Questo ha reso il compito più difficile ma più equo, costringendo i modelli ad apprendere davvero le differenze nel linguaggio invece di favorire semplicemente le comunità più comuni. Nei test, i modelli hanno etichettato correttamente i post circa l’82% delle volte — un grande salto rispetto al caso, che sarebbe corretto solo in un quarto dei casi.

Aprire la scatola nera dell’IA

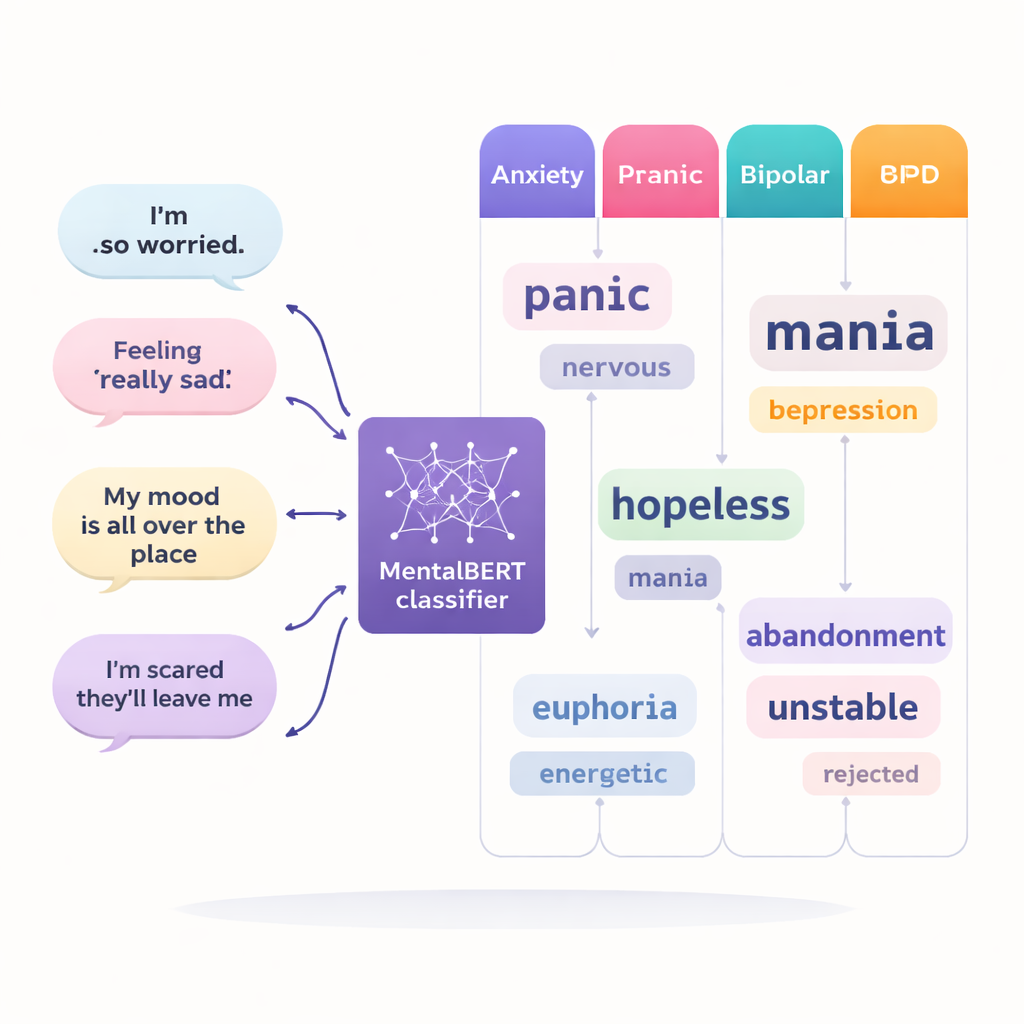

Una preoccupazione importante nella tecnologia per la salute mentale è che i sistemi informatici possano sembrare misteriose “scatole nere”, offrendo previsioni senza ragioni chiare. Per affrontare questo problema, i ricercatori hanno utilizzato un approccio chiamato LIME che rivela quali parole hanno spinto il modello verso una decisione particolare. In termini semplici, LIME nasconde o modifica parti di un post e osserva come cambia la risposta del modello. Se rimuovere una parola come “panico” cambia improvvisamente la comunità prevista, quella parola viene considerata importante. Ripetendo questo processo migliaia di volte su molti post, il team ha costruito elenchi delle parole più influenti per ogni comunità e ha verificato che queste parole corrispondessero a quanto i clinici sanno su ciascuna condizione.

Voci distinte per diverse difficoltà

Le spiegazioni hanno rivelato chiari schemi linguistici. Nelle comunità sull’ansia, parole come “panico”, “attacco” e “preoccupazione” si distinguevano, spesso legate a sintomi fisici e a improvvisi picchi di paura. I post sulla depressione includevano frequentemente termini come “senza speranza”, “inutile”, “vita” e “più”, che riecheggiano profonda tristezza e la sensazione che le cose non miglioreranno. Nelle discussioni sul BPD, le parole chiave si spostavano verso relazioni ed emozioni, incluse “abbandono”, “relazione”, “attaccamento” e “fp” (abbreviazione di “favorite person”, un termine comune in questi gruppi). I post sul disturbo bipolare evidenziavano cambiamenti dell’umore e linguaggio legato al trattamento, con parole come “mania”, “manico”, “ipomania”, “umore” e nomi di farmaci come “litio” e “lamictal”. I modelli hanno anche mostrato dove le condizioni si sovrappongono: per esempio, post di ansia e depressione possono entrambi concentrarsi su sofferenza e sentimenti negativi, rendendoli più facili da confondere, proprio come accade nella diagnosi nella vita reale.

Dai post online all’impatto nel mondo reale

Per un non specialista, il messaggio chiave è che i computer possono classificare in modo affidabile le conversazioni sulla salute mentale per tema ed esporre quali parole guidano le loro scelte, ma non possono e non devono diagnosticare nessuno. I modelli di questo studio funzionano più come bibliotecari per gli spazi di supporto online: aiutano a verificare se le discussioni in una data comunità corrispondono davvero al suo focus dichiarato. Questo potrebbe aiutare i moderatori a mantenere le conversazioni rilevanti e aiutare ricercatori o clinici a comprendere meglio come le persone descrivono le loro difficoltà al di fuori degli appuntamenti formali. Con attenta supervisione umana e attenzione alla privacy e allo stigma, tali strumenti potrebbero un giorno sostenere spazi online più accoglienti e meglio organizzati per parlare di salute mentale.

Citazione: Sánchez Rodríguez, I., Bianchi, J., Pinelli, F. et al. Understanding mental health discourse on Reddit with transformers and explainability. Sci Rep 16, 6796 (2026). https://doi.org/10.1038/s41598-026-35918-3

Parole chiave: salute mentale, social media, Reddit, IA spiegabile, classificazione del testo