Clear Sky Science · it

Aggregazione gerarchica di informazioni contestuali per la segmentazione dei polipi

Perché le piccole escrescenze nel colon contano

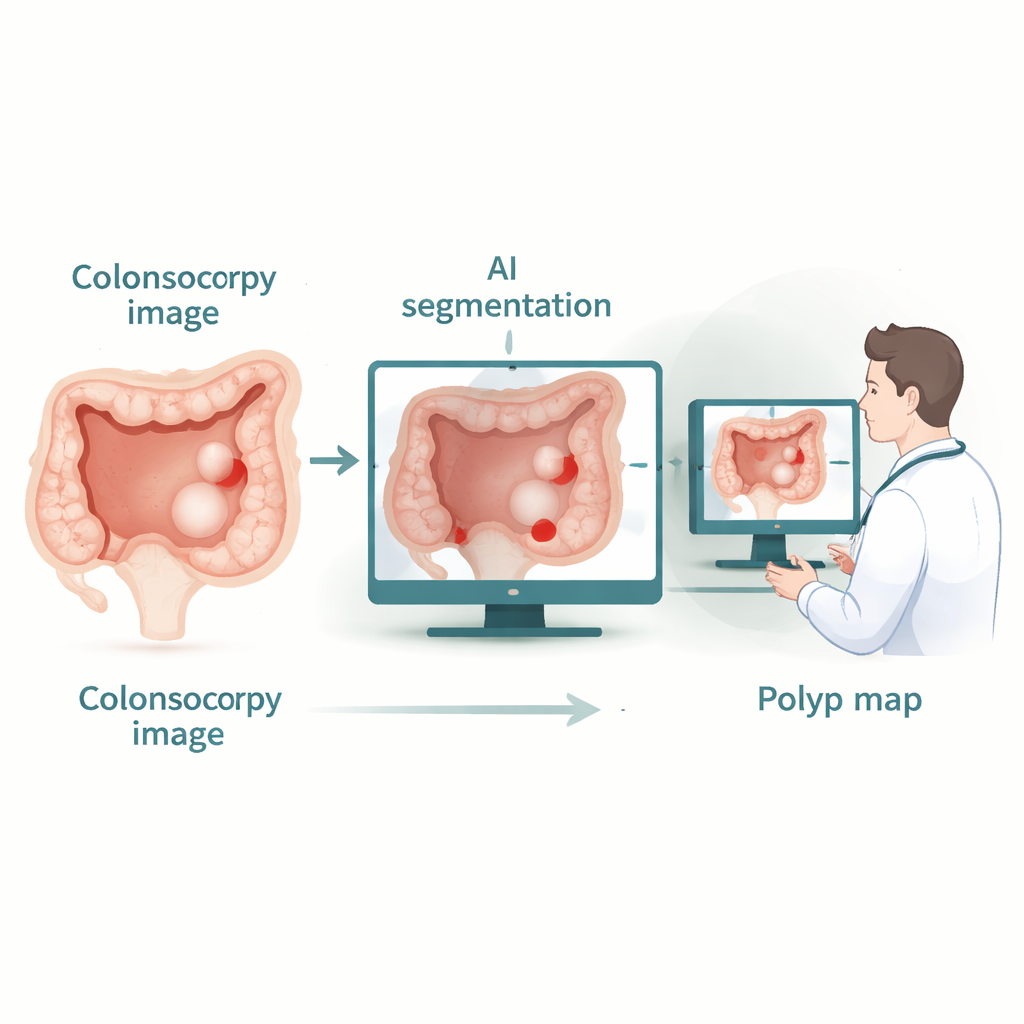

Il cancro colorettale spesso inizia come piccole protuberanze apparentemente innocue chiamate polipi sulla mucosa dell’intestino crasso. Durante una colonscopia i medici cercano di individuare e rimuovere queste escrescenze prima che diventino pericolose. Ma gli esseri umani si stancano, la visuale non è perfetta e gli studi mostrano che fino a un quarto dei polipi può essere trascurato. Questo articolo presenta un nuovo sistema di intelligenza artificiale (IA) progettato per delineare automaticamente i polipi nelle immagini di colonscopia con elevata precisione, con l’obiettivo di diventare un assistente affidabile che aiuti i clinici a vedere di più e a sbagliare meno.

Vedere la foresta e gli alberi

Gli strumenti di IA moderni per le immagini mediche di solito appartengono a due filoni. Un filone, basato sulle classiche reti neurali convolutive, è molto bravo a riconoscere dettagli locali fini, come bordi sottili o variazioni di texture, ma fatica a capire come regioni distanti nell’immagine siano tra loro correlate. L’altro filone, basato su modelli transformer, eccelle nel catturare relazioni a lungo raggio — vede il “quadro generale” su tutta l’immagine — ma può perdere nitidezza attorno a piccole strutture come i confini sottili dei polipi, e può richiedere molte risorse computazionali. I sistemi ibridi recenti cercano di mescolare i due approcci, ma spesso finiscono per favorire la parte convolutiva e non sfruttano appieno i meccanismi di attenzione, portando a bordi sfocati e a contesti non sfruttati completamente.

Un nuovo modo di combinare indizi su più scale

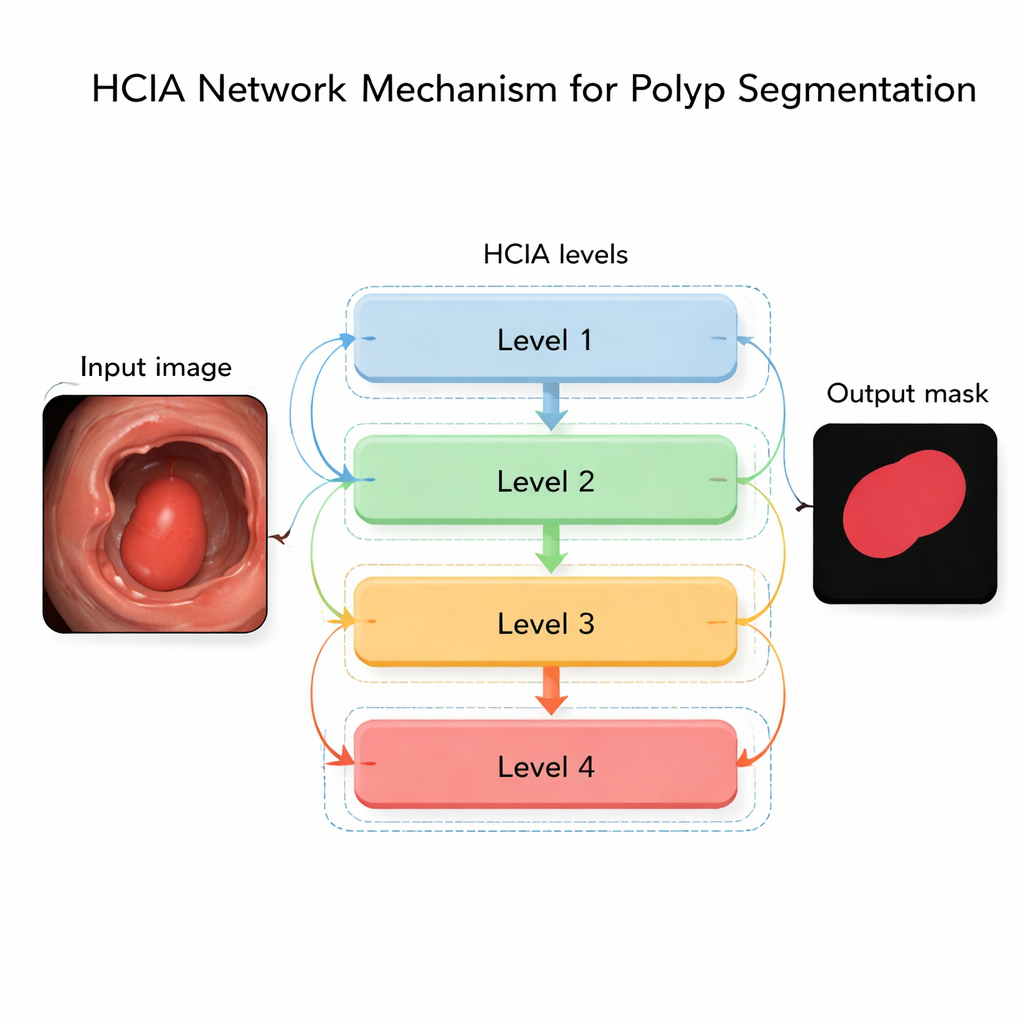

Gli autori propongono una rete chiamata Hierarchical Contextual Information Aggregation (HCIA) per superare queste limitazioni. HCIA è progettata per osservare un’immagine di colonscopia a diversi livelli di dettaglio contemporaneamente — da viste grossolane e ingrandite a viste più ravvicinate — e per far dialogare questi livelli in modo strutturato. Un componente chiave, il Hierarchical Aggregation Module (HAM), fonde le informazioni provenienti dai livelli adiacenti. Mescolando il contesto più grosso con i dettagli più fini, HAM aiuta il sistema a distinguere i polipi dal tessuto circostante che può variare per colore, forma e dimensione, contribuendo al contempo ad affinare i confini dove il polipo incontra il tessuto sano.

Attenzione intelligente senza elevato costo computazionale

Il secondo elemento cruciale, l’Interconnected Attention Module (IAM), affronta la sfida del contesto globale. Invece di calcolare l’attenzione nel modo tradizionale — che confronta ogni pixel con tutti gli altri e diventa rapidamente oneroso dal punto di vista computazionale — IAM utilizza una “memoria” condivisa che sintetizza ciò che la rete ha imparato attraverso tutti i livelli. Ogni livello consulta questa memoria per decidere quali parti delle proprie feature meritano maggiore attenzione. Questo design permette a IAM di costruire connessioni a lungo raggio su tutta l’immagine mantenendo sotto controllo il costo computazionale. Importante, la stessa memoria è condivisa fra i rami della rete, offrendo una forma di supervisione globale e coerente che aiuta il modello a restare focalizzato sui polipi indipendentemente dalla loro dimensione o posizione.

Mettere il sistema alla prova

Per verificare se il progetto di HCIA conta nella pratica, gli autori lo hanno testato su tre collezioni di immagini di polipi ampiamente usate, ciascuna contenente da centinaia a un migliaio di fotogrammi di colonscopia con contorni dei polipi tracciati da esperti. Hanno confrontato HCIA con più di venti modelli IA di punta, includendo reti convolutive tradizionali e ibridi più recenti basati su transformer. Su quasi tutte le misure — quanto bene le regioni di polipo previste si sovrappongono alle etichette degli esperti, quanto accuratamente sono catturate le forme e quanto bene si allineano le strutture — HCIA è risultata superiore o pari ai migliori concorrenti. Si è dimostrata particolarmente solida nei test cross-dataset, un setting impegnativo che simula come lo strumento debba funzionare in ospedali che utilizzano apparecchiature e condizioni di imaging diverse. Confronti visivi dettagliati hanno mostrato che HCIA cattura in modo più affidabile forme polipo irregolari e confini deboli rispetto ai metodi rivali.

Cosa significa per pazienti e clinici

Per i non specialisti, il punto principale è che HCIA è un sistema di IA che delinea con maggiore accuratezza le escrescenze potenzialmente cancerose nelle immagini di colonscopia pur essendo sufficientemente veloce per l’uso in tempo reale. Combinando dettagli locali netti con un forte senso del contesto generale, ed eseguendo il tutto in modo efficiente, riduce le probabilità che polipi sottili o di forma insolita passino inosservati. Sebbene il modello necessiti ancora di ulteriori ottimizzazioni per dispositivi molto leggeri e non sfrutti ancora informazioni da sequenze video nel tempo, rappresenta un passo significativo verso un’assistenza computerizzata più intelligente e affidabile nello screening del cancro colorettale — supportando i medici nel rilevare più escrescenze pericolose prima che diventino letali.

Citazione: Li, L., Yang, H., Zhang, J. et al. Hierarchical contextual information aggregation for polyp segmentation. Sci Rep 16, 5959 (2026). https://doi.org/10.1038/s41598-026-35703-2

Parole chiave: polipi colorettali, IA per colonscopia, segmentazione di immagini mediche, deep learning, rilevamento precoce del cancro