Clear Sky Science · it

Sinapsi neo‑Hebbiane per accelerare l’addestramento online di hardware neuromorfico

Insegnare ai chip a imparare dall’esperienza

L’intelligenza artificiale moderna è straordinariamente potente, ma ancora lontana dall’eguagliare la capacità del cervello di apprendere da feedback scarsi e ritardati — per esempio ricordare quale scorciatoia in città ha davvero fatto risparmiare tempo. Questo articolo presenta un nuovo tipo di «sinapsi» artificiale, le connessioni tra neuroni artificiali, che permette ai chip neuromorfici di apprendere in modo più simile al cervello e in modalità online, restando compatti ed efficienti dal punto di vista energetico. Per chi è interessato al futuro dell’hardware per l’IA, mostra come il calore stesso possa diventare un segnale utile per l’apprendimento all’interno di minuscoli dispositivi di memoria.

Perché i cervelli neuromorfici hanno bisogno di sinapsi migliori

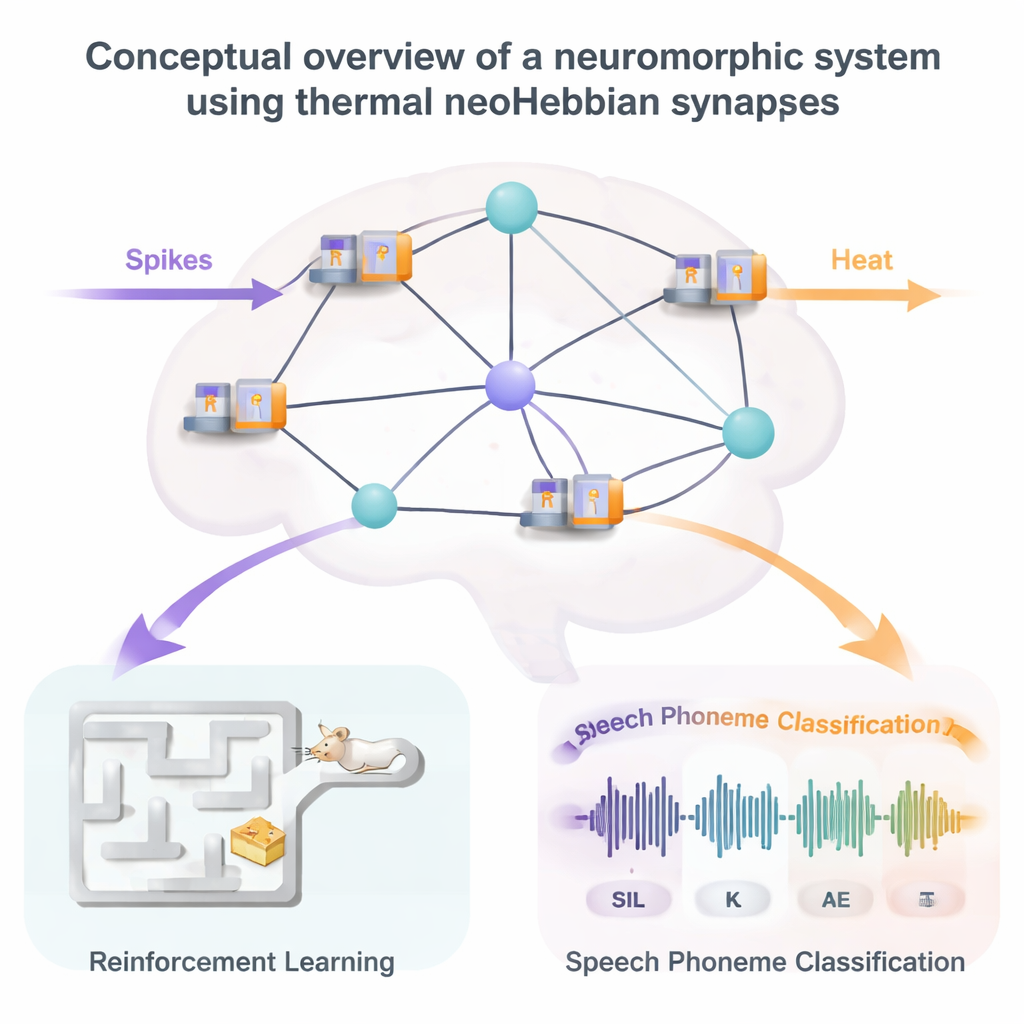

Il calcolo neuromorfico mira a emulare il modo in cui il cervello elabora le informazioni: usando reti neurali a spike, in cui brevi impulsi elettrici attraversano vaste reti di sinapsi. L’hardware attuale può già implementare sinapsi con componenti memristive come le ReRAM, la cui conduttanza elettrica può essere regolata per memorizzare un peso. Tuttavia, semplici regole di apprendimento «hebbiane» — dove le sinapsi si rinforzano o si indeboliscono soltanto sulla base del timing locale degli spike — faticano su compiti realistici che richiedono di collegare eventi separati nel tempo, come comprendere il parlato o risolvere problemi di navigazione. Le tecniche standard del deep learning risolvono questo con il backpropagation attraverso il tempo, ma quel metodo richiede troppa memoria e troppa energia per l’hardware di tipo cerebrale. La comunità si è così orientata verso regole di apprendimento a “tre fattori” e algoritmi come eligibility propagation (e‑prop), che introducono una traccia di memoria locale extra in ogni sinapsi in modo che un segnale di ricompensa globale ritardato possa comunque aggiustare le connessioni giuste.

Memorizzare una memoria sfumata nel calore

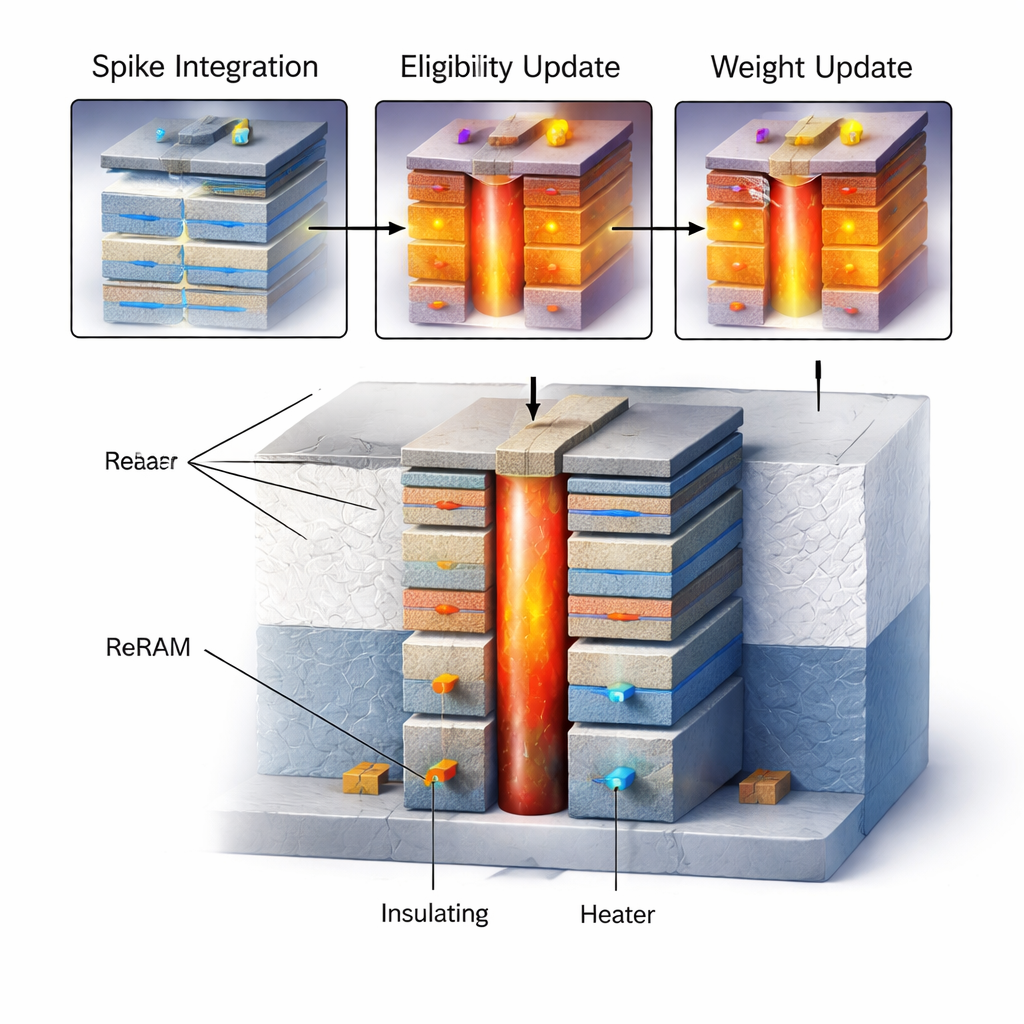

L’idea centrale di questo lavoro è una sinapsi «neo‑hebbiana» che ha due variabili di stato interne: un peso di accoppiamento a lungo termine e una traccia di eleggibilità a breve termine che ricorda l’attività recente. Il peso è codificato, come di consueto, nella conduttanza di un dispositivo ReRAM. La traccia di eleggibilità, invece, è immagazzinata nella temperatura locale di quel dispositivo, controllata da un riscaldatore resistivo su scala nanometrica integrato direttamente sopra o accanto ad esso. Durante l’elaborazione normale degli spike, la ReRAM moltiplica semplicemente gli spike in ingresso per il suo peso memorizzato. Durante l’apprendimento, segnali generati dai neuroni corrispondenti a «chi ha sparato prima» e «quanto è sensibile in questo momento il neurone postsinaptico» fanno scorrere corrente attraverso il minuscolo riscaldatore. Poiché il riscaldatore e la ReRAM sono accoppiati termicamente, questa potenza aumenta la temperatura del dispositivo in proporzione al prodotto di quei due segnali — la traccia di eleggibilità matematica richiesta dall’algoritmo e‑prop.

Come il calore modifica la memoria

Dopo che una breve sequenza di input — chiamata dataframe — è stata processata, l’aumento di temperatura accumulato codifica quanto quella sinapsi sia «eleggibile» a cambiare. Viene quindi applicato un impulso di programmazione fisso attraverso la ReRAM. È cruciale: esperimenti dettagliati mostrano che la variazione di conduttanza risultante dipende fortemente dalla temperatura: i dispositivi più caldi cambiano di più, e direzione e grandezza del cambiamento dipendono dallo stato di conduttanza iniziale e dal fatto che il dispositivo venga spinto verso una conduttanza più alta o più bassa. Scegliendo con cura le ampiezze degli impulsi e sfruttando questa sensibilità alla temperatura, gli autori ottengono che la variazione del peso sia approssimativamente proporzionale alla eleggibilità immagazzinata. Modelli numerici del flusso di calore in uno stack 3D integrato riscaldatore‑più‑ReRAM confermano che la temperatura può essere innalzata e lasciata decadere su scale temporali regolabili, e che la struttura può essere ingegnerizzata per aumentare l’auto‑riscaldamento desiderato limitando il «crosstalk» termico verso sinapsi vicine.

Mettere alla prova le sinapsi termiche

Per valutare se questa sinapsi esotica sia realmente utile, gli autori simulano sistemi neuromorfici completi che includono comportamenti realistici del dispositivo come decadimento della temperatura, variabilità tra dispositivi e precisione incompleta. In una dimostrazione, una rete a spike controlla un topo virtuale che deve imparare a navigare in un labirinto a griglia per trovare il formaggio evitando le trappole. Qui, il naturale raffreddamento termico — che erode lentamente l’eleggibilità immagazzinata — agisce come il «fattore di sconto» noto nel reinforcement learning: le coppie stato‑azione recenti contano più di quelle lontane. Le simulazioni mostrano che l’apprendimento è più rapido quando questo decadimento non è né troppo veloce né troppo lento, e che la variabilità nel comportamento delle ReRAM degrada le prestazioni solo gradualmente. In un secondo test, più impegnativo, una rete ricorrente a spike con sinapsi neo‑hebbiane termiche viene addestrata online sul benchmark TIMIT per la classificazione dei fonemi, un compito standard di riconoscimento vocale. Con sufficiente risoluzione di conduttanza (circa l’equivalente di 8 bit), il modello consapevole dell’hardware raggiunge un’accuratezza entro pochi punti percentuali rispetto a un’implementazione ideale in virgola mobile.

Cosa significa per l’hardware IA del futuro

Nel complesso, lo studio dimostra che la temperatura locale può servire come una memoria interna pratica e controllabile per regole di apprendimento avanzate, permettendo un addestramento veloce on‑chip senza un enorme overhead digitale. La sinapsi proposta occupa circa lo stesso ingombro di una cella ReRAM convenzionale, ma implementa sia un peso stabile sia una traccia decadente, e il suo costo energetico per passo di apprendimento è nell’ordine dei picojoule. Pur comportando sfide reali — la temperatura è difficile da misurare direttamente e può accelerare l’usura del dispositivo — il lavoro suggerisce che abbracciare, invece di combattere, gli effetti elettro‑termici potrebbe sbloccare nuove classi di hardware di apprendimento compatti. Per i non esperti, la conclusione è che i chip IA del futuro potrebbero non limitarsi a spostare elettroni: potrebbero anche calcolare con schemi di calore attentamente progettati, avvicinando l’apprendimento automatico all’efficienza e all’adattabilità del cervello umano.

Citazione: Pande, S., Bezugam, S.S., Bhattacharya, T. et al. NeoHebbian synapses to accelerate online training of neuromorphic hardware. Sci Rep 16, 6836 (2026). https://doi.org/10.1038/s41598-026-35641-z

Parole chiave: calcolo neuromorfico, reti neurali a spike, sinapsi ReRAM, apprendimento online, IA efficiente in termini di hardware