Clear Sky Science · it

Generazione accurata dei referti di dimissione usando grandi modelli linguistici ottimizzati con autovalutazione

Perché la burocrazia ospedaliera conta davvero

Quando un paziente lascia l'ospedale, la storia della sua malattia non si conclude alla porta d'uscita. I medici in altri reparti, i medici di base e gli stessi pazienti si affidano a un documento chiave chiamato referto di dimissione per capire cosa è successo durante il ricovero e quali sono i passi successivi. Tuttavia la redazione di questi referti è un lavoro lento e ripetitivo che può richiedere ai clinici impegnati mezz'ora o più per paziente. Questo studio esplora come gli strumenti linguistici di intelligenza artificiale moderni possano aiutare a redigere i referti di dimissione più rapidamente e con maggiore precisione, mantenendo al contempo la riservatezza dei dati dei pazienti e il controllo da parte dell'ospedale.

Trasformare cartelle frammentarie in una narrazione chiara

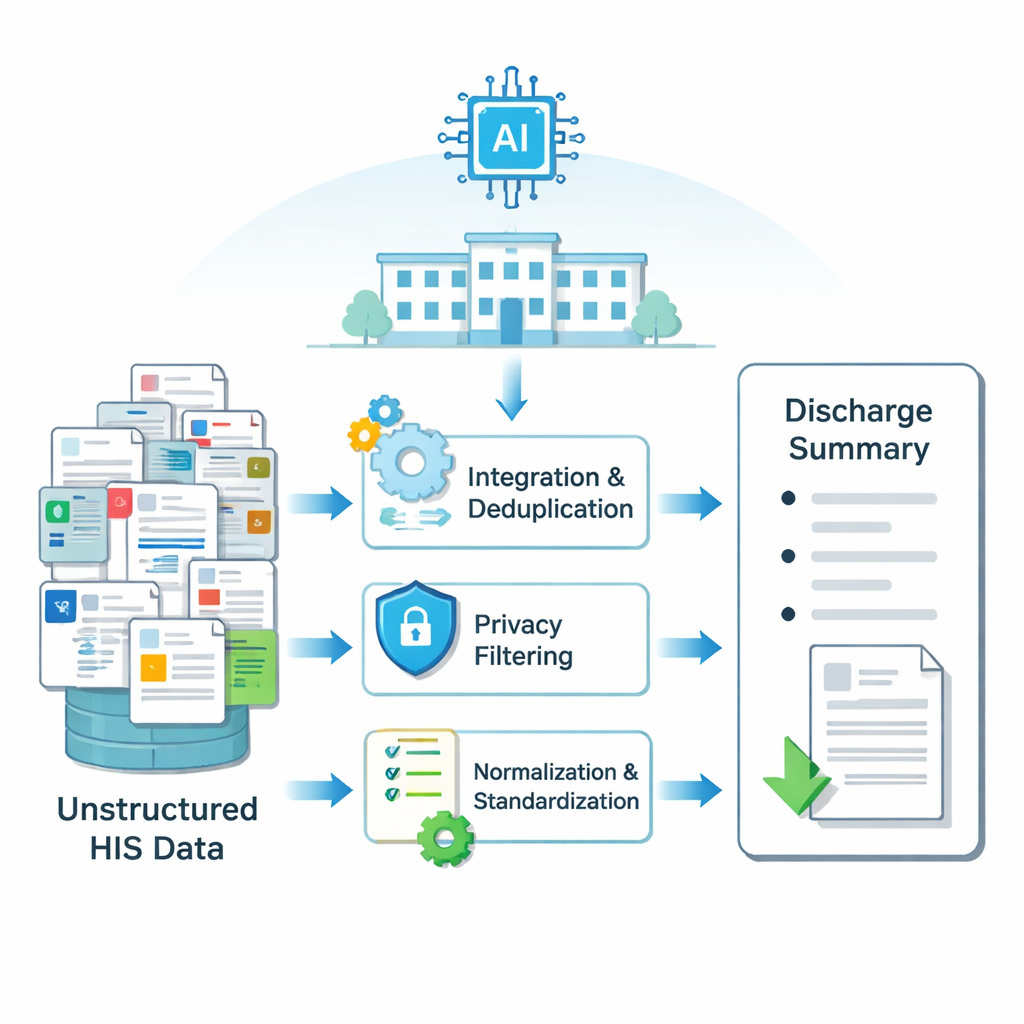

Le informazioni ospedaliere sono distribuite su molti sistemi elettronici: risultati di laboratorio in una tabella, note chirurgiche in un'altra, osservazioni infermieristiche in una terza, e così via. Il soggiorno di ogni paziente genera migliaia di piccoli frammenti di testo. I ricercatori hanno prima costruito una pipeline per trasformare queste informazioni disperse e disordinate in un input pulito che un modello di IA possa comprendere. Usando metodi per unire e rimuovere duplicati tra record sovrapposti, filtrare dettagli privati come nomi e identificativi, correggere errori di ortografia e standardizzare termini medici, hanno creato input strutturati per ogni degenza. Questo processo è stato applicato ai dati di oltre 6.000 pazienti sottoposti a chirurgia tiroidea in un importante ospedale cinese, producendo esempi abbinati di referti di dimissione reali e dei dati grezzi da cui erano stati redatti.

Ottimizzare l'IA per parlare il linguaggio della medicina

I modelli linguistici di serie sono addestrati su testi generali reperiti in rete e nei libri, perciò spesso faticano con il linguaggio medico specialistico e gli stili documentali locali. Il team ha confrontato diversi approcci per «mettere a punto» i modelli esistenti in modo che comprendano meglio i referti medici cinesi. Un nuovo metodo chiamato adattamento a bassa rango con decomposizione dei pesi, o DoRA, regola i pesi interni del modello in modo più mirato rispetto a tecniche più datate come LoRA e QLoRA. Tra vari modelli, inclusi Qwen2, Mistral e Llama 3, DoRA ha prodotto costantemente referti più fluidi, più vicini per significato a quelli scritti da esseri umani e meno confusi (misurati con una metrica standard chiamata perplexity). In sostanza, DoRA ha aiutato l'IA ad apprendere frasi e terminologia medica senza richiedere un riaddestramento completo su hardware massiccio.

Insegnare all'IA a ricontrollare il proprio lavoro

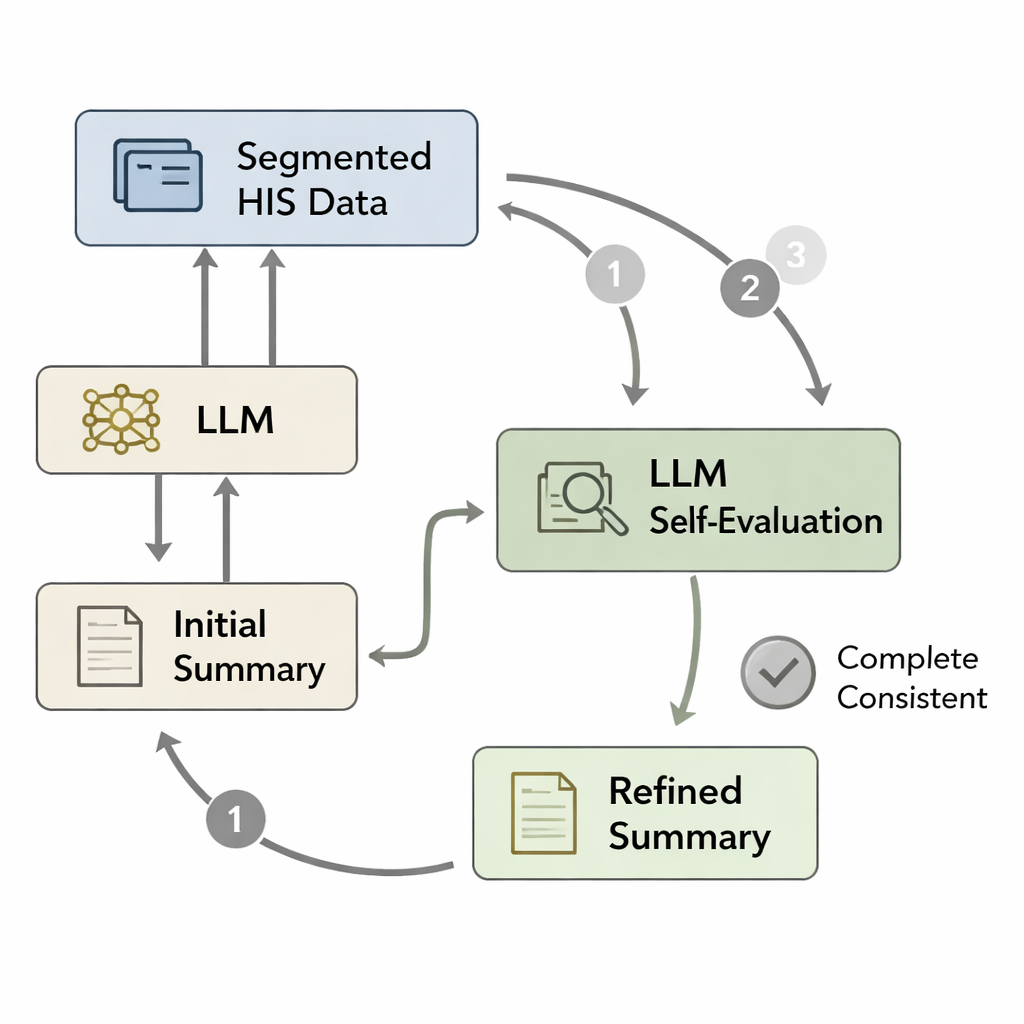

Anche un modello ben addestrato può dimenticare dettagli importanti o introdurre errori minori quando scrive un lungo referto in un'unica passata. Ispirandosi a concetti psicologici del pensiero rapido «Sistema 1» contro il ragionamento più lento e accurato «Sistema 2», gli autori hanno progettato un ciclo di autovalutazione. Per prima cosa, il modello scrive un referto di dimissione iniziale a partire dai dati ospedalieri elaborati. Poi i dati originali vengono suddivisi in segmenti — come referti di patologia, prescrizioni mediche o pannelli di esami di laboratorio — e ogni segmento viene ri-accoppiato con la bozza del referto. Al modello viene chiesto, in pratica, «tutto ciò che c'è in questo segmento è riflesso nel referto?». Se la risposta è no, il modello rivede il testo per aggiungere informazioni mancanti o correggere incongruenze. Questo ciclo si ripete fino a tre volte o fino a quando il modello giudica il referto completo, producendo una versione raffinata che corrisponde più fedelmente alla documentazione del paziente.

Quanto bene ha fatto l'IA rispetto alle persone?

Per valutare la qualità, il team ha utilizzato sia punteggi automatici sia revisori umani. Medici e ricercatori clinici hanno valutato i referti per accuratezza, completezza, chiarezza, coerenza e utilità per la cura successiva. Il sistema migliore — che combina il fine-tuning DoRA con il ciclo di autovalutazione — si è avvicinato maggiormente ai referti scritti da persone in tutte le misure. Ha migliorato in particolare la completezza, cioè ha ridotto il numero di diagnosi, trattamenti o valori di laboratorio mancanti. In un esempio dettagliato, l'IA inizialmente aveva omesso di menzionare un piccolo cancro alla tiroide e una specifica compressa ormonale; dopo due passaggi di autovalutazione, entrambi i dettagli erano stati correttamente aggiunti. In media, il sistema ha generato un referto di dimissione in circa 80 secondi su un server ospedaliero, rispetto ai 30–50 minuti che un clinico impiega per redigerne uno da zero, sebbene la revisione umana rimanga essenziale prima che il testo entri nel fascicolo ufficiale.

Cosa può significare per pazienti e clinici

Lo studio mostra che, con un addestramento accurato e controlli di qualità integrati, i sistemi di IA possono produrre referti di dimissione sufficientemente accurati da essere considerati clinicamente accettabili dopo una rapida verifica umana. Questo non sostituisce i medici, ma può spostare il loro tempo dalla digitazione ripetitiva alla revisione e al processo decisionale di livello superiore. Mantenendo tutta l'elaborazione all'interno della rete ospedaliera e rimuovendo i dettagli identificativi, l'approccio rispetta anche la privacy dei pazienti. Sebbene i risultati finora provengano da un singolo reparto di un unico ospedale, il quadro prospetta un futuro in cui l'IA aiuta a trasformare dati medici complessi in narrazioni chiare e affidabili in molte specialità, favorendo passaggi di cura più sicuri e una migliore comprensione da parte di pazienti e famiglie.

Citazione: Li, W., Feng, H., Hu, C. et al. Accurate discharge summary generation using fine tuned large language models with self evaluation. Sci Rep 16, 5607 (2026). https://doi.org/10.1038/s41598-026-35552-z

Parole chiave: referti di dimissione, IA medica, grandi modelli linguistici, documentazione clinica, autovalutazione