Clear Sky Science · it

CRFusion: una nuova rete di fusione LiDAR-camera per la costruzione di mappe BEV

Mappe digitali più intelligenti per le auto a guida autonoma

Per un’auto a guida autonoma, comprendere la strada davanti a sé è come leggere una mappa in continuo cambiamento. Il veicolo deve sapere con precisione dove sono le corsie, le strisce pedonali e i bordi della carreggiata, anche quando è buio, piove o qualcosa ostruisce la visuale. Questo articolo presenta CRFusion, un nuovo sistema che combina scanner laser e telecamere per costruire mappe dall’alto delle strade cittadine più pulite e affidabili, aiutando le auto autonome a restare nelle corsie e a evitare i pedoni con maggiore fiducia.

Perché due “occhi elettronici” sono meglio di uno

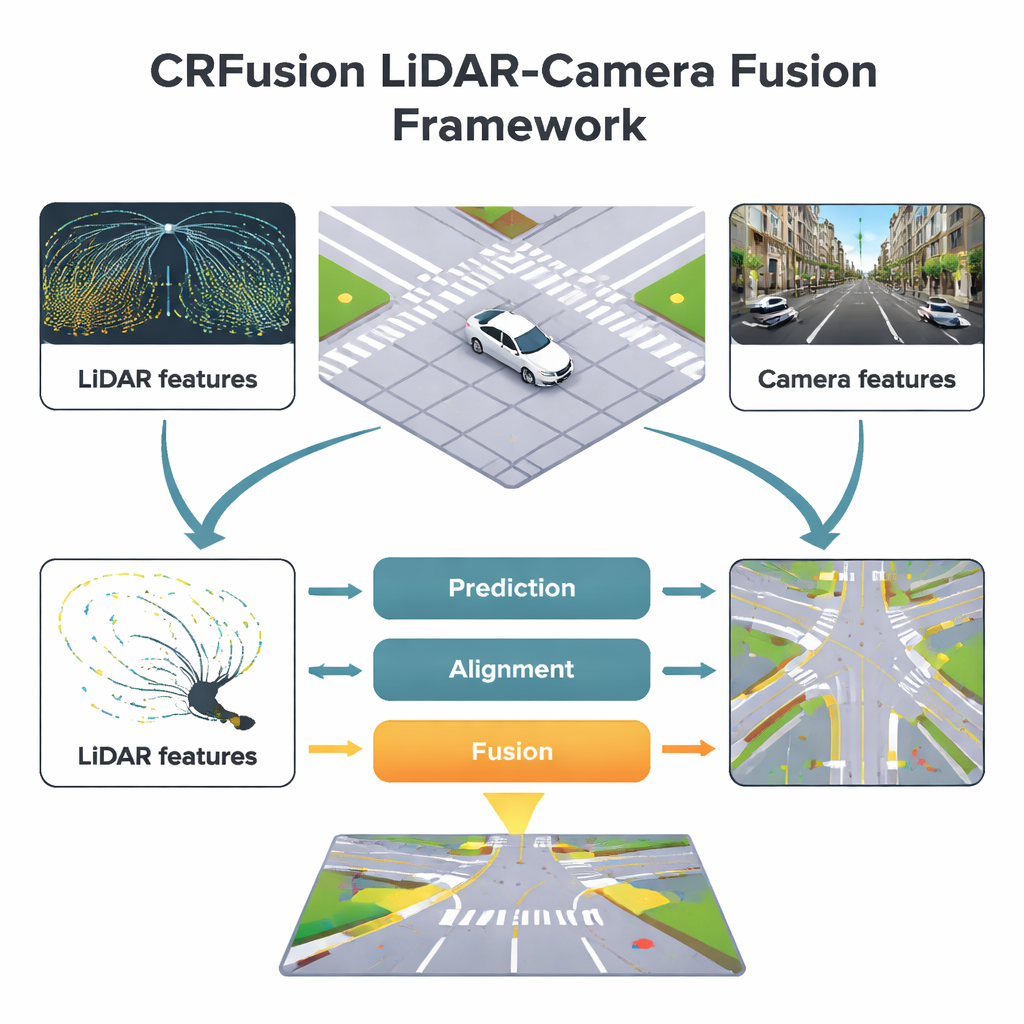

Le auto a guida autonoma moderne si basano molto su due sensori principali. Le telecamere catturano immagini ricche di colore, rendendo semplice individuare vernice delle corsie, segnali stradali e strisce pedonali a distanza. I laser scanner, o LiDAR, emettono impulsi di luce e misurano il ritorno, costruendo un quadro 3D accurato delle distanze e delle forme attorno al veicolo. Ognuno ha punti deboli: le immagini delle telecamere possono essere ingannate da scarsa illuminazione o maltempo, mentre le misure LiDAR diventano sparse e incomplete con l’aumentare della distanza. CRFusion è progettato per fondere questi punti di forza e di debolezza in una singola vista dall’alto (bird’s-eye view), una mappa top-down in cui ogni pixel rappresenta una piccola porzione di terreno etichettata come corsia, spartitraffico o attraversamento pedonale.

Colmare le lacune nella visione a lunga distanza

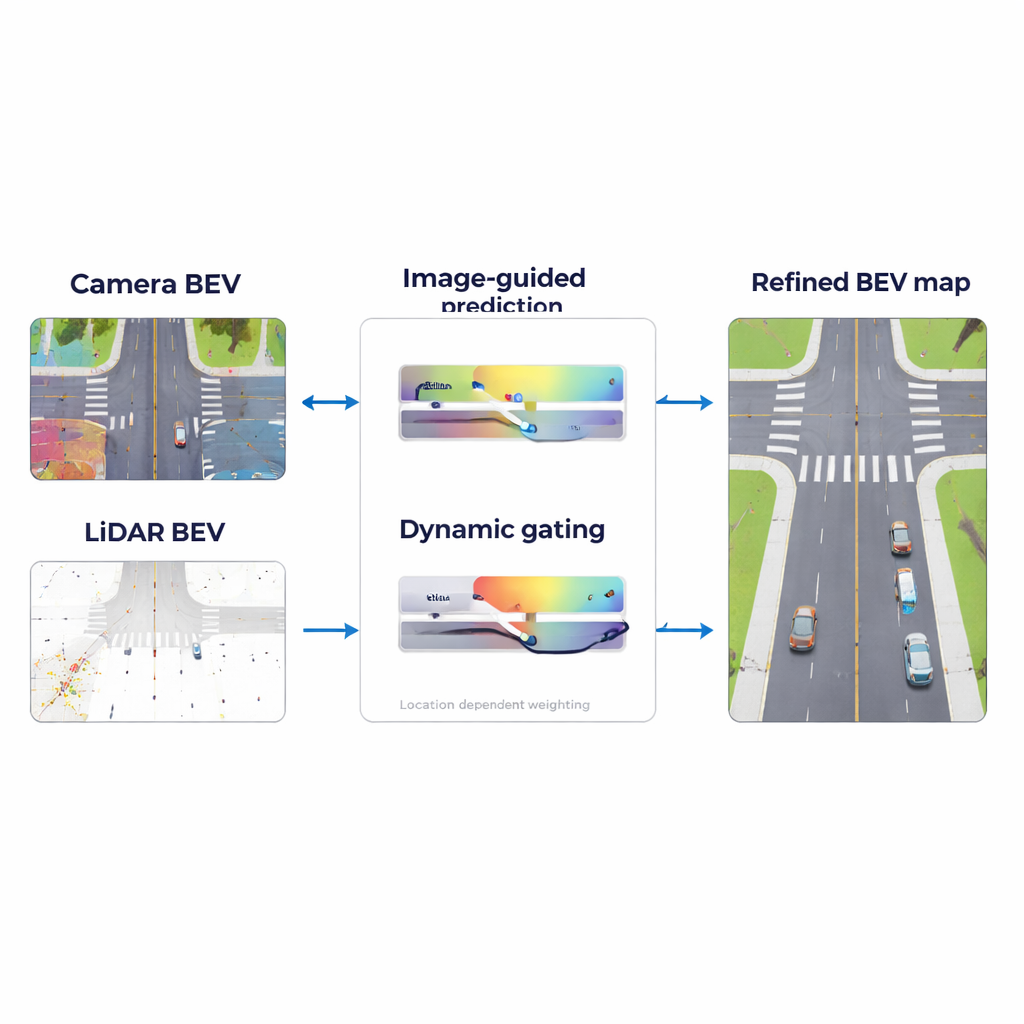

Una sfida chiave nella mappatura stradale è che il LiDAR spesso perde dettagli lontano dal veicolo, proprio dove la pianificazione anticipata è più importante. CRFusion affronta questo problema con un “Predittore di Raggio LiDAR”. In termini semplici, il sistema osserva ciò che la telecamera vede in lontananza e usa quelle informazioni per indovinare cosa il LiDAR avrebbe misurato se fosse stato denso e completo. Un meccanismo chiamato attention aiuta il modello a decidere quali parti della vista della telecamera meglio spiegano le aree vuote o incerte nella mappa basata su LiDAR. Quindi affina questa previsione confrontando regioni vicine nella mappa, rafforzando pattern coerenti come linee di corsia continue e riducendo il rumore casuale.

Far concordare i sensori sulla stessa immagine

Anche quando sia la telecamera sia il LiDAR funzionano, non sono perfettamente allineati. Piccoli errori nelle stime di distanza o nel posizionamento dei sensori possono far sì che le marcature viste dalla telecamera appaiano leggermente spostate rispetto alle letture LiDAR. CRFusion introduce una fase di allineamento che “deforma” con delicatezza le feature top-down della telecamera in modo che corrispondano meglio alla vista LiDAR. Questo è ottenuto mediante una rete di correzione leggera che prevede come ogni punto nella mappa della telecamera debba essere leggermente spostato. Di conseguenza, le due viste dei sensori descrivono le stesse posizioni fisiche della strada, rendendo la fusione successiva molto più affidabile.

Adattarsi a giorno, notte e maltempo

Una volta che le due viste dei sensori sono allineate, il sistema deve ancora decidere quanto fidarsi di ciascuna in ogni punto della mappa. Un’autostrada soleggiata con vernice delle corsie chiara è molto diversa da una notte piovosa in una città affollata. CRFusion affronta questo con un modulo di “Fusione Dinamica a Cancello” che assegna pesi flessibili alle feature della telecamera e del LiDAR sulla mappa. Dove i ritorni LiDAR sono forti, come bordi della strada vicini o oggetti solidi, il sistema si appoggia di più al LiDAR. Dove gli indizi visivi sono più chiari, come strisce pedonali luminose a distanza, si affida maggiormente alla telecamera. Questi pesi sono appresi automaticamente dai dati, permettendo alla strategia di fusione di spostarsi in modo fluido al cambiare delle condizioni.

Dimostrare i benefici con dati reali

I ricercatori hanno testato CRFusion su un dataset ampiamente usato per la guida autonoma chiamato NuScenes, che include molte scene di guida in diverse città, condizioni meteorologiche e orari del giorno. Rispetto ai metodi precedenti di punta, CRFusion ha prodotto confini di corsia, spartitraffico e attraversamenti pedonali più accurati, specialmente a distanze medie e lunghe fino a 90 metri. Ha migliorato le misure standard di qualità sia per la sovrapposizione con le mappe di verità a terra sia per la capacità di rilevare singoli segmenti di corsia, e uno studio di “ablation” ha mostrato che ciascuna componente principale — la predizione a lunga distanza, la rete di allineamento e la fusione dinamica — ha contribuito con guadagni significativi. Esempi visivi hanno rivelato una continuità delle corsie più fluida e attraversamenti più nitidi, confermando che le mappe del sistema assomigliano più a piani stradali disegnati con cura.

Cosa significa per la guida di tutti i giorni

Per i non specialisti, la conclusione principale è che CRFusion aiuta le auto a guida autonoma a costruire mappe stradali più pulite e affidabili permettendo a telecamere e LiDAR di “dialogare” in modo più intelligente. Predicendo le informazioni LiDAR mancanti a partire dalle viste della telecamera, mettendo in allineamento le due prospettive dei sensori e regolando quanto si fida di ciascuna in base alla situazione, il sistema riduce i punti ciechi e le ipotesi incerte. Questo avvicina i veicoli autonomi alla capacità di gestire strade cittadine complesse e affollate con la stessa sicurezza di un guidatore umano attento che segue corsie e attraversamenti ben segnati.

Citazione: Guan, Y., Wang, T., Cheng, Q. et al. CRFusion: a novel LiDAR-camera fusion network for BEV map construction. Sci Rep 16, 5169 (2026). https://doi.org/10.1038/s41598-026-35551-0

Parole chiave: guida autonoma, fusione LiDAR-camera, mappe semantiche HD, percezione in vista dall’alto, mappatura stradale urbana