Clear Sky Science · it

Il ruolo della diagnosticità nel giudicare la competenza dei robot

Perché gli scivoloni dei robot ci riguardano tutti

I robot e i sistemi di intelligenza artificiale stanno rapidamente passando dai laboratori a fabbriche, ospedali e strade. Man mano che iniziamo a fare affidamento su di essi, una domanda diventa cruciale: come decidono le persone se un robot è davvero competente? Questo articolo esplora come giudichiamo un robot che solitamente funziona bene ma occasionalmente commette un errore sorprendente — o ottiene un successo inaspettato. I risultati aiutano a spiegare perché le nostre «sensazioni» sui macchinari possono differire da ciò che dichiariamo a voce, e perché un singolo errore può essere liquidato con indifferenza oppure cambiare permanentemente la nostra fiducia.

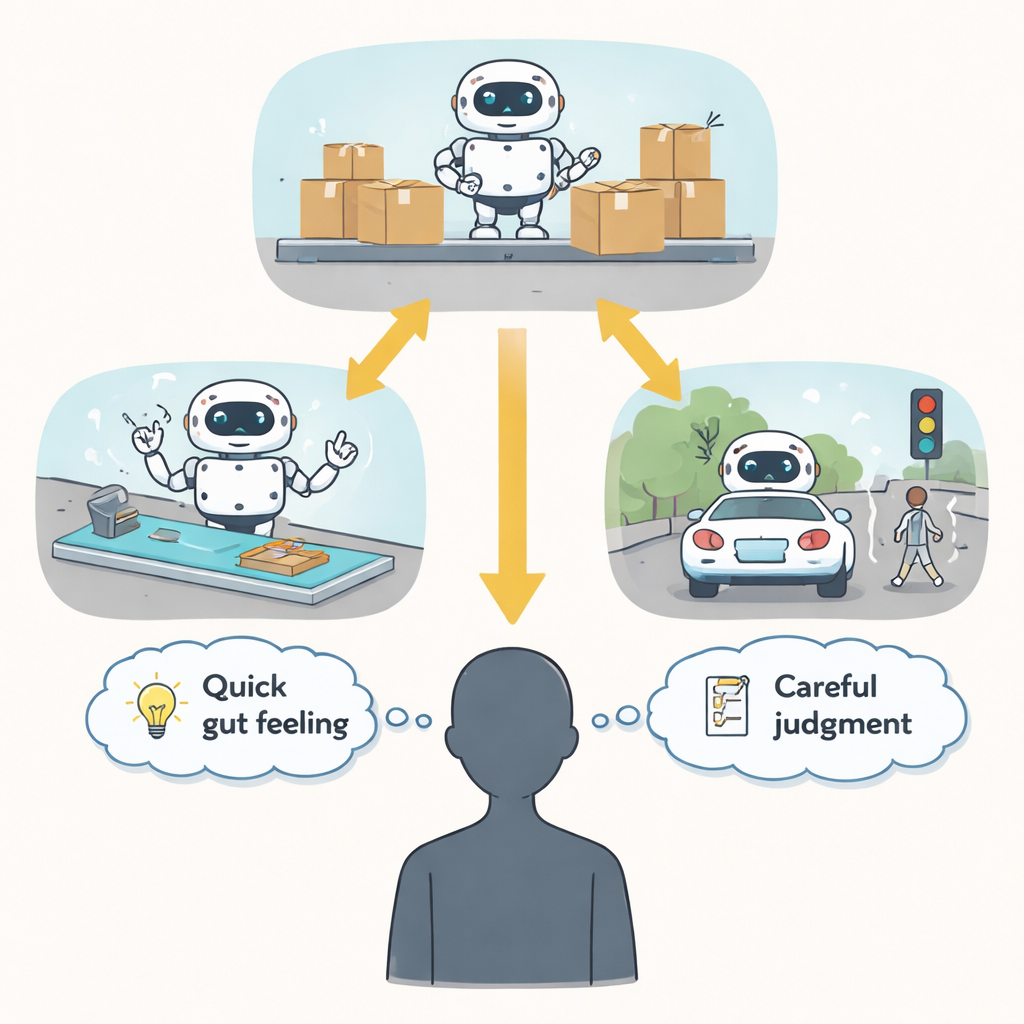

Due modalità con cui la mente giudica le macchine

Gli psicologi distinguono due tipi di impressioni. Le impressioni esplicite sono i giudizi che possiamo riportare direttamente quando ci viene chiesto, per esempio valutare la competenza di un robot su una scala da 1 a 7. Le impressioni implicite sono più automatiche, riflesse nelle risposte rapide che le persone danno senza concentrarsi sulla valutazione. Lavori precedenti suggerivano che le impressioni esplicite cambiano rapidamente quando vediamo nuovi comportamenti, mentre quelle implicite si spostano più lentamente. Questo studio chiede se quella differenza riguardi davvero sistemi mentali diversi — o se dipenda da quanto il nuovo comportamento appare informativo, o diagnostico, sulle reali capacità del robot.

Dai pavimenti di fabbrica alle sale operatorie e alle autostrade

In nove esperimenti online con più di 3.700 partecipanti, i ricercatori hanno mostrato persone diverse tipologie di robot operare in contesti realistici: un robot industriale che si muove in un magazzino affollato, un robot chirurgico che traccia percorsi precisi e un’auto a guida autonoma che reagisce agli ostacoli sulla strada. A volte il robot era costantemente abile o costantemente impacciato. In altri casi era per lo più competente ma commetteva un singolo errore evidente, oppure per lo più incompetente ma otteneva un successo isolato. Dopo aver visto brevi sequenze di queste prestazioni, le impressioni dei partecipanti sono state misurate in due modi: domande dirette di autovalutazione e compiti indiretti che rilevavano reazioni rapide e automatiche.

Quando una performance strana pesa molto

In questi scenari realistici, le valutazioni esplicite dei robot da parte delle persone riflettevano sia il modello complessivo di prestazioni sia la singola prova «anomala». Un errore isolato tra molte prove positive poteva abbassare in modo evidente le valutazioni esplicite, e un successo isolato tra molti fallimenti poteva migliorarle. Le impressioni implicite, però, raccontavano una storia diversa. Rispondevano in modo marcato al comportamento tipico del robot — se di solito era competente o meno — ma ignoravano in gran parte il singolo episodio anomalo. Questa dissociazione rimaneva anche quando i ricercatori riprogettavano con cura le misure in modo che i compiti «espliciti» e «impliciti» sembrassero e si percepissero il più possibile simili, differendo principalmente nel fatto che ai partecipanti fosse detto di giudicare il robot intenzionalmente.

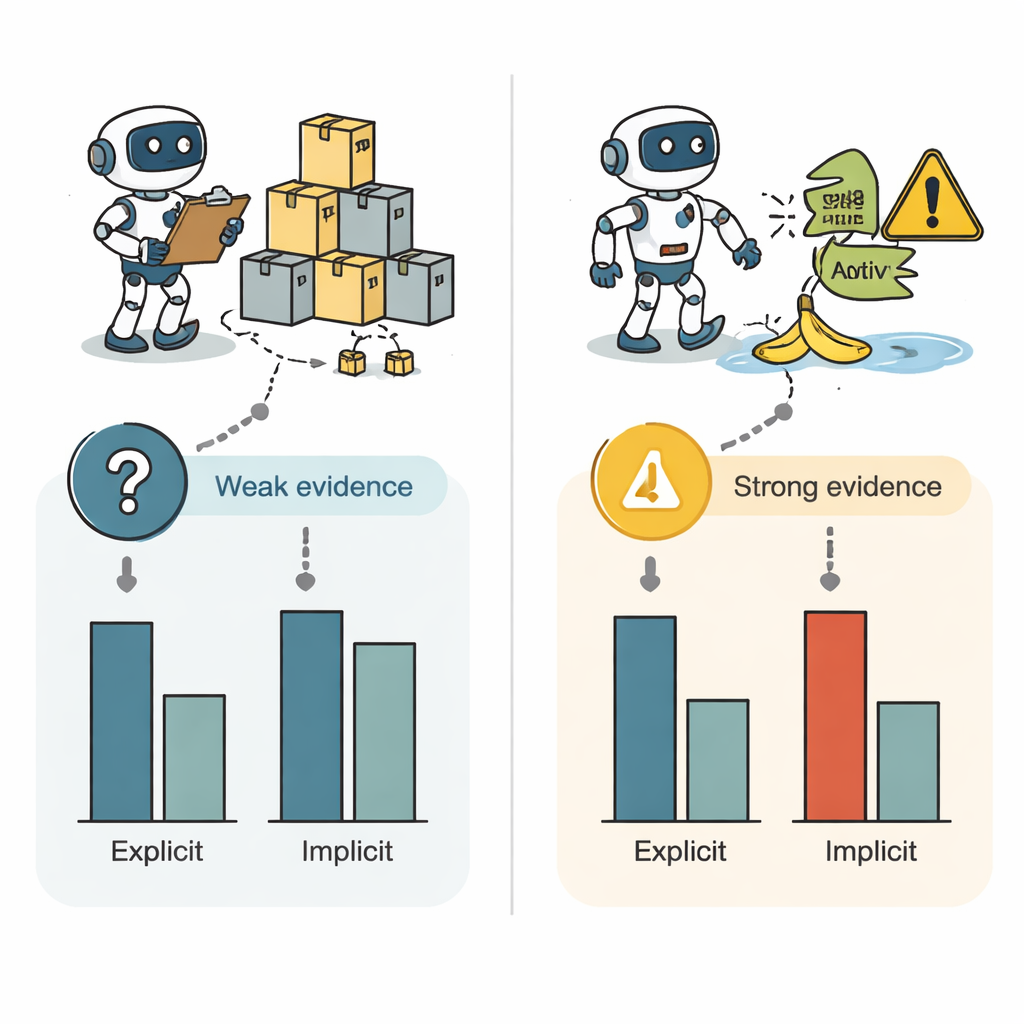

Cosa rende un errore del robot davvero significativo

Il gruppo ha quindi testato un’idea chiave: che la forza di un evento anomalo dipende da quanto esso sembra diagnostico — se le persone pensano che riveli qualcosa di duraturo sul robot. In studi successivi, i partecipanti vedevano prima un robot eseguire diverse prove impeccabili, e poi una o più mancanze. Quando i fallimenti successivi venivano inquadrati come importanti, test recenti, o quando diversi fallimenti si accumulavano fino a pareggiare la quantità di successo precedente, sia le impressioni esplicite sia quelle implicite cambiavano. Fondamentale: in queste condizioni ad alta diagnosticità anche un singolo errore era sufficiente a spostare le impressioni automatiche e implicite. Quando lo stesso tipo di errore veniva descritto come obsoleto, poco importante o come un evento isolato, le impressioni implicite quasi non si muovevano, anche se le valutazioni esplicite invece cambiavano ancora.

Perché questo conta per la fiducia quotidiana nell’IA

Complessivamente, i risultati suggeriscono che le nostre impressioni rapide e automatiche sulla competenza dei robot non sono cieche alle nuove informazioni, ma richiedono prove più forti o più chiaramente significative prima di cambiare. Le nostre valutazioni dichiarate, al contrario, sono molto reattive anche ad eventi deboli o ambigui, in parte perché sentiamo la pressione di usare qualunque informazione abbiamo quando qualcuno chiede un giudizio. Per progettisti, ingegneri e responsabili politici, ciò significa che gestire la fiducia nei robot non riguarda solo la riduzione degli errori, ma anche come quegli errori vengono inquadrati e compresi. Un singolo fallimento altamente rivelatore — come un’auto che non si ferma quando chiaramente dovrebbe — può rimodellare sia le nostre sensazioni istintive sia le opinioni dichiarate, con conseguenze dirette sulla nostra disponibilità ad adottare e affidarsi a macchine intelligenti.

Citazione: Surdel, N., Ferguson, M.J. The role of diagnosticity in judging robot competence. Sci Rep 16, 7578 (2026). https://doi.org/10.1038/s41598-026-35375-y

Parole chiave: competenza dei robot, interazione uomo-robot, pregiudizio implicito, fiducia nell'IA, informazione diagnostica