Clear Sky Science · it

Un approccio multimodale per riconoscere le fake news e i nodi influenti nella loro diffusione usando deep learning e analisi di rete

Perché questo è importante per la vita quotidiana

Ogni giorno milioni di persone scorrono i contenuti dei social media, vedendo post su salute, politica, denaro e altro. Mischiati alle informazioni utili ci sono voci e notizie false che possono scatenare paura, confusione o addirittura danni nel mondo reale. Questo studio introduce un modo potente per fare due cose insieme: innanzitutto identificare automaticamente post falsi o fuorvianti, e in secondo luogo mappare chi è maggiormente responsabile della loro diffusione all’interno di una comunità online. Il lavoro si concentra su messaggi Twitter riguardanti il Covid‑19, ma le idee potrebbero aiutare piattaforme, giornalisti e pubblico a rispondere più rapidamente e con maggiore precisione alla disinformazione dannosa in molti ambiti della vita.

Come le voci si propagano tra folle online

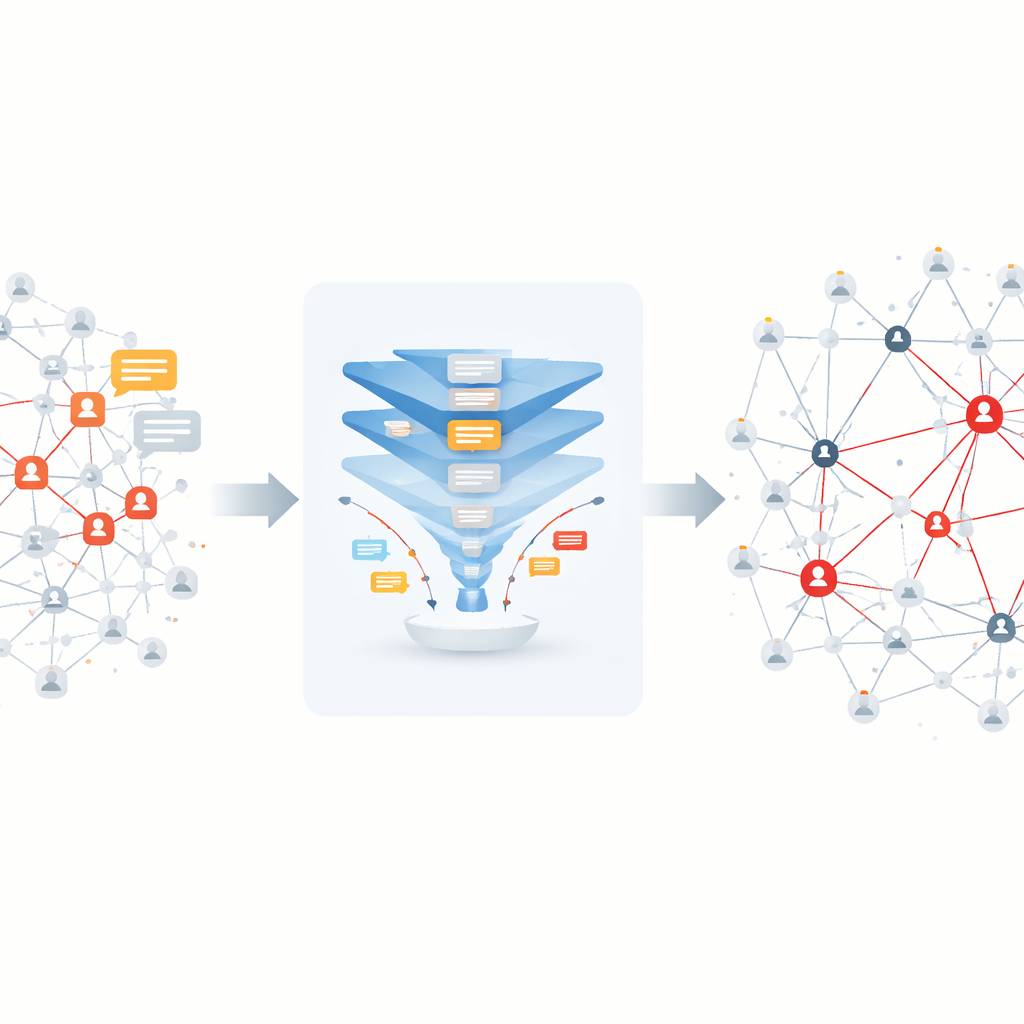

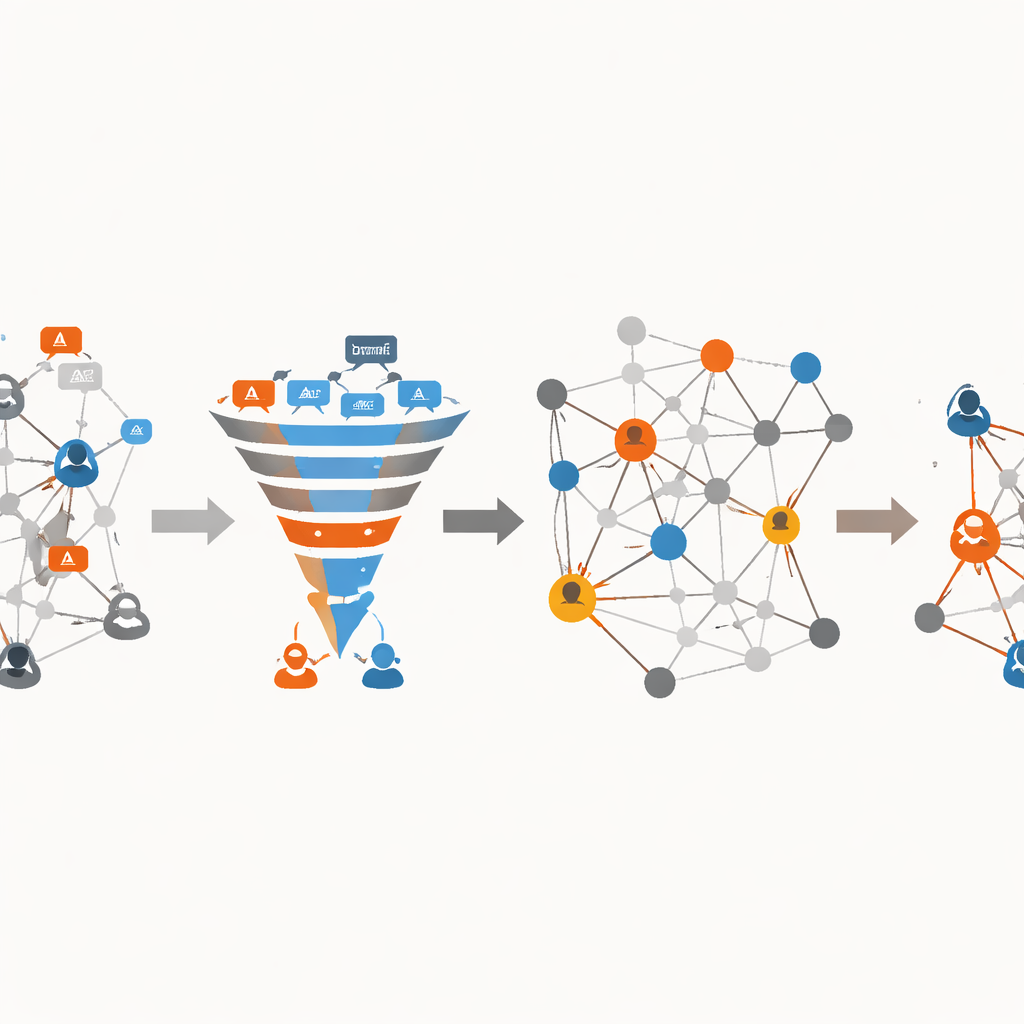

I social network come Twitter, Facebook o le app di messaggistica possono essere pensati come enormi reti di persone (nodi) connesse dalle loro interazioni (link). Quando un utente pubblica un messaggio e altri rispondono o lo condividono, quell’informazione può rapidamente propagarsi attraverso la rete. Le voci—affermazioni non verificate o false—si comportano molto come malattie contagiose: possono saltare da persona a persona, crescere rapidamente e risultare difficili da fermare. Ricerche passate hanno spesso trattato separatamente due questioni: come stabilire se un dato post è una voce, e come individuare i principali “diffusori” che aiutano quella voce a raggiungere molti altri. Gli autori sostengono che affrontare entrambe le domande insieme, prestando anche attenzione a come la rete è strutturata e a come l’attività cambia nel tempo, fornisce un quadro molto più chiaro di come si muovono le storie false.

Insegnare a un computer a leggere e segnalare i post dubbiosi

La prima parte del metodo si concentra sul contenuto di ogni tweet. I ricercatori trattano ogni tweet come un breve documento e lo ripuliscono rimuovendo elementi superflui come simboli in eccesso, sostituendo link web e indirizzi email con semplici tag e eliminando parole di riempimento comuni che aggiungono poco significato. Poi traducono ogni parola in un vettore numerico usando una tecnica largamente usata chiamata GloVe, che cattura come le parole tendono ad apparire insieme in grandi raccolte di testi. Mediando questi vettori di parola, ogni tweet diventa un compatto riassunto numerico del suo significato. Questi riassunti vengono poi alimentati in una rete neurale convoluzionale monodimensionale—un tipo di modello di deep learning capace di individuare pattern sottili—per decidere se un tweet è un messaggio genuino o una voce.

Individuare i diffusori chiave all’interno della rete

Dopo che il sistema ha separato i tweet di voce da quelli reali, la seconda parte dell’approccio si concentra sulla struttura della rete sociale stessa. Ogni utente è un punto in un grafo orientato e pesato, e ogni risposta o retweet diventa un link la cui forza riflette quanto spesso un utente reagisce ai messaggi di un altro. Utilizzando queste informazioni, gli autori prima raggruppano gli utenti in comunità—gruppi che interagiscono più tra loro che con gli esterni—costruendo una rappresentazione ad albero speciale della rete e poi unendo sottoinsiemi strettamente connessi in base a quanto bene si combinano. All’interno di queste comunità, calcolano quanto spesso ogni utente si trova sui percorsi più importanti tra gli altri, una misura nota come betweenness. Gli utenti che ricompaiono ripetutamente su percorsi di alto valore sono considerati diffusori influenti. I pesi delle connessioni vengono quindi aggiornati per riflettere sia la frequenza delle interazioni sia la centralità degli utenti connessi, rivelando le rotte più probabili che le voci seguono attraverso la rete nel tempo.

Cosa ha rivelato il caso di studio sul Covid‑19

Per testare il loro framework, i ricercatori lo hanno applicato a un enorme dataset Twitter sul Covid‑19: quasi 100 milioni di tweet che coinvolgevano più di 150.000 utenti, da cui hanno estratto oltre 14.000 messaggi unici etichettati come informazione autentica o voci. Su questi dati, il loro modello di deep learning ha classificato correttamente circa il 99 percento dei tweet, superando diversi metodi esistenti, inclusi altri rilevatori avanzati di fake news. Nella seconda fase, hanno confrontato la loro lista di utenti influenti con un noto modello matematico di diffusione dell’informazione, trovando la massima concordanza tra i metodi testati. Hanno inoltre mostrato che analizzando periodi temporali più lunghi—120, 240 e poi 360 giorni—la capacità del modello di individuare i diffusori chiave e le principali rotte delle voci migliorava, e lo faceva con tempi di elaborazione inferiori rispetto a tecniche concorrenti basate sulle reti.

Cosa significa questo per la lotta alla disinformazione

In parole semplici, lo studio dimostra che è possibile costruire un sistema che non solo identifica con altissima accuratezza le probabili fake news, ma rintraccia anche come viaggiano e chi è più responsabile della loro diffusione. Invece di trattare tutti gli utenti e tutte le connessioni allo stesso modo, il metodo mette in evidenza un insieme più piccolo di comunità e individui il cui comportamento conta di più per contenere storie dannose. Pur essendo stato condotto su dati Twitter anonimizzati sul Covid‑19 e potendo non generalizzare direttamente a ogni piattaforma o argomento, suggerisce una strada verso risposte più mirate e basate sui dati alle voci online—come indirizzare fact‑checking, avvisi o interventi della piattaforma dove possono avere il maggiore impatto, mantenendo al contempo la privacy individuale e un uso etico in primo piano.

Citazione: Zhang, W., Qian, M. & Zhang, Q. A multi-modal approach for recognizing fake news and influential nodes in spreading them using deep learning and network analysis. Sci Rep 16, 9775 (2026). https://doi.org/10.1038/s41598-026-35342-7

Parole chiave: fake news, social network, diffusione di voci, deep learning, utenti influenti