Clear Sky Science · it

Integrazione della conoscenza per la regressione simbolica informata dalla fisica usando grandi modelli linguistici pre-addestrati

Insegnare ai computer a indovinare le formule della natura

Molte delle grandi idee della scienza sono espresse in eleganti equazioni: da come cade una palla a come le onde luminose si propagano nello spazio. Questo articolo esplora un nuovo modo per aiutare i computer a riscoprire automaticamente tali equazioni a partire dai dati grezzi, permettendo loro di consultare un grande modello linguistico—lo stesso tipo di IA che alimenta i moderni chatbot—così che le loro ipotesi non siano solo accurate, ma anche sensate dal punto di vista fisico.

Dai dati grezzi alle leggi leggibili dall’uomo

Gli autori si concentrano su una tecnica chiamata regressione simbolica, che cerca una formula matematica che colleghi ingressi e uscite misurate. A differenza del semplice adattamento di curve, la regressione simbolica non parte da una forma di formula fissata; costruisce ed evolve invece equazioni candidate finché una non si adatta bene ai dati. Questo la rende uno strumento promettente per la scoperta scientifica, perché può potenzialmente rivelare nuove relazioni che nessuno ha ancora scritto. C’è però un problema: una formula che si adatta perfettamente ai dati può comunque essere insensata dal punto di vista fisico—per esempio, sommando una distanza a un tempo o producendo unità che non corrispondono a nessuna grandezza reale.

Perché l’intuizione fisica conta ancora

Per evitare tali sciocchezze, i ricercatori hanno sviluppato versioni “informate dalla fisica” della regressione simbolica che incorporano regole note della natura nella ricerca. Questi metodi premiano equazioni che, per esempio, conservano l’energia o rispettano la coerenza dimensionale. Tuttavia, codificare questa conoscenza ha tipicamente richiesto agli esperti di progettare a mano vincoli e funzioni di perdita speciali per ogni nuovo problema. Questo rende l’approccio potente ma difficile da generalizzare. Ogni nuovo sistema fisico può necessitare del proprio lavoro di progettazione accurata, limitando l’accessibilità di questi strumenti ai non esperti.

Lasciare che i modelli linguistici giudichino le equazioni

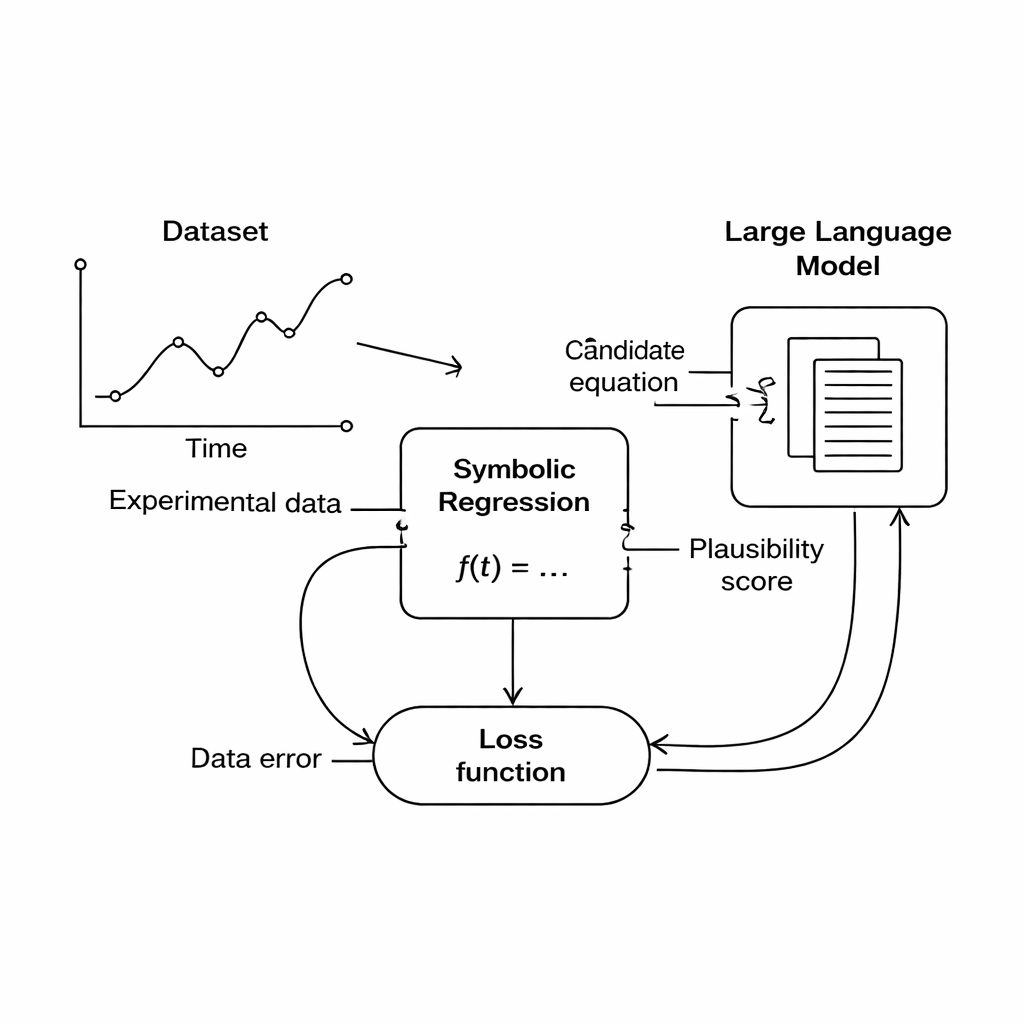

Questo studio propone una strada diversa: invece di codificare rigidamente le regole del dominio, usare un grande modello linguistico (LLM) come giudice flessibile della plausibilità scientifica. Durante la ricerca, il motore di regressione simbolica produce equazioni candidate che si adattano ai dati in una certa misura. Ciascuna equazione viene poi tradotta in testo e inviata all’LLM, insieme a un breve prompt che descrive le quantità coinvolte e eventuali vincoli fisici noti. L’LLM restituisce punteggi su tre aspetti: se le unità dell’equazione hanno senso, quanto è semplice, e se sembra fisicamente realistica. Questi punteggi vengono incorporati nella funzione obiettivo principale, così il computer bilancia ora “si adatta ai dati” con “sembra buona fisica” nella scelta delle equazioni da mantenere e perfezionare.

Mettere il metodo alla prova

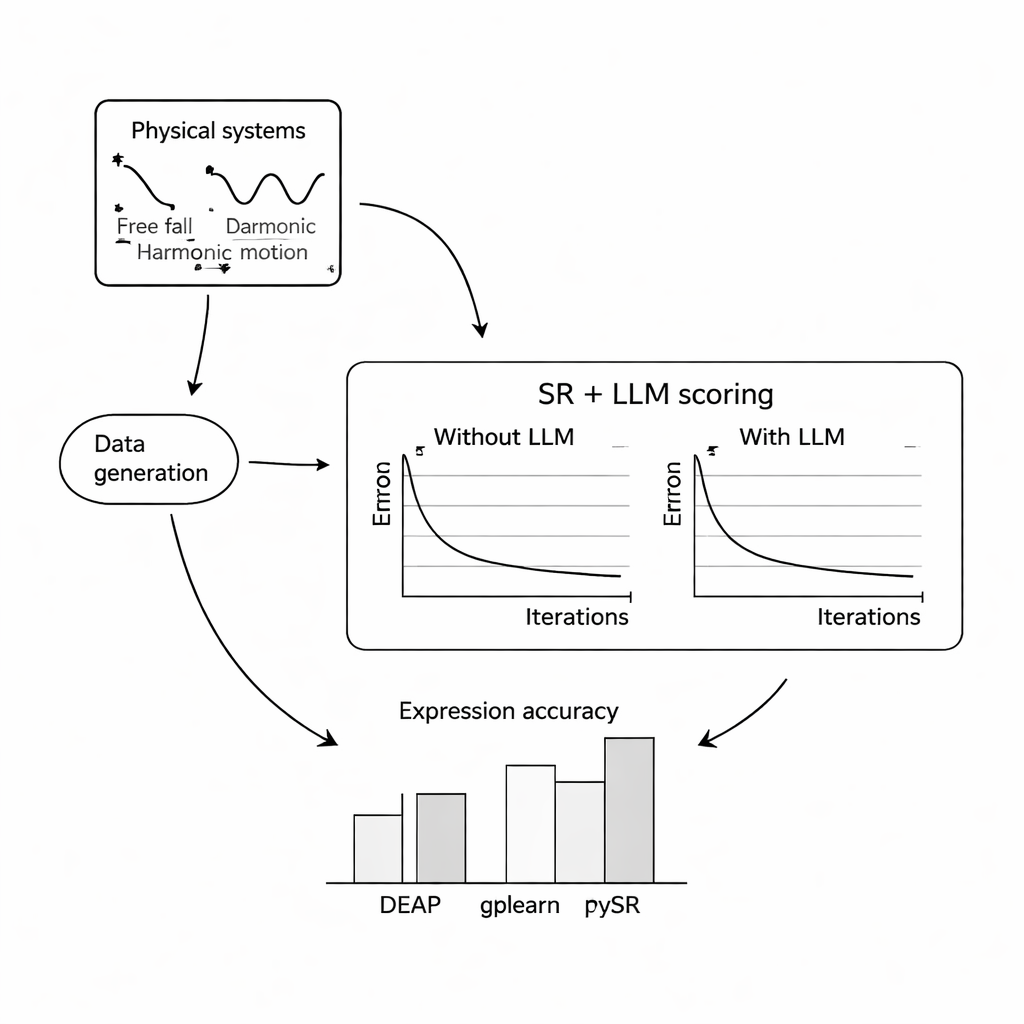

Per valutare l’efficacia, gli autori hanno svolto esperimenti estesi su tre problemi classici: la caduta libera di una palla nella gravità terrestre, il moto armonico semplice di una massa su una molla, e un’onda elettromagnetica smorzata. Per ciascun sistema hanno simulato migliaia di misurazioni rumorose in condizioni variate, quindi hanno chiesto a tre popolari programmi di regressione simbolica di recuperare le equazioni sottostanti, con o senza l’aiuto di un LLM. Hanno provato tre modelli linguistici compatti e open-source—Mistral, Llama 2 e Falcon—e hanno esplorato come diversi design dei prompt, dal contesto minimo a descrizioni complete e persino la formula vera, cambiassero l’orientamento fornito dall’LLM. Nella maggior parte delle impostazioni, aggiungere il punteggio dell’LLM ha migliorato quanto le equazioni recuperate corrispondessero alle leggi note e le ha rese più robuste al rumore, con la combinazione di PySR (una libreria di regressione simbolica) e Mistral che in genere ha dato i migliori risultati.

Quando le parole guidano la matematica

Un risultato chiave è che la formulazione del prompt incide in modo significativo sui risultati. Quando i prompt includevano descrizioni chiare delle variabili, la natura dell’esperimento e talvolta la formula obiettivo esatta, la ricerca guidata dall’LLM convergeva più affidabilmente alla struttura corretta. In questi casi più ricchi, le equazioni scoperte erano spesso strutturalmente identiche alle leggi di riferimento, non solo vicine numericamente. Gli autori hanno inoltre testato la robustezza dell’approccio con livelli crescenti di rumore casuale nelle misure. Sebbene tutti i metodi degradassero man mano che i dati diventavano più rumorosi e le equazioni sottostanti più complesse, le versioni arricchite dall’LLM tendevano a perdere accuratezza più lentamente rispetto alle controparti standard, suggerendo che il senso di plausibilità del modello linguistico può fungere da fattore stabilizzante.

Cosa significa per le scoperte future

Per il lettore generale, il messaggio principale è che le IA basate sul testo possono fare più che scrivere saggi o rispondere a domande: possono anche guidare altri algoritmi verso equazioni scientifiche che “sembrano giuste” secondo la nostra conoscenza esistente della natura. Il metodo presentato qui non garantisce che ogni equazione scoperta sia corretta e si basa ancora sulla supervisione umana e su prompt accuratamente costruiti. Ma dimostra che i grandi modelli linguistici, addestrati su oceani di testi scientifici, possono servire come fonte riutilizzabile di conoscenza di dominio, aiutando gli strumenti automatizzati a passare dall’adattare ciecamente i dati al proporre leggi che gli scienziati possono interpretare, verificare e approfondire.

Citazione: Taskin, B., Xie, W. & Lazebnik, T. Knowledge integration for physics-informed symbolic regression using pre-trained large language models. Sci Rep 16, 1614 (2026). https://doi.org/10.1038/s41598-026-35327-6

Parole chiave: regressione simbolica, IA informata dalla fisica, grandi modelli linguistici, scoperta scientifica, apprendimento di equazioni