Clear Sky Science · it

YOLOv11n potenziato per la rilevazione di piccoli oggetti nelle immagini UAV: maggiore accuratezza con meno parametri

Perché individuare piccole cose dal cielo è importante

I droni stanno rapidamente entrando nella vita quotidiana, dal monitoraggio del traffico e dalle operazioni di soccorso alla consegna di pacchi. Ma resta un problema ostinato: quando un velivolo guarda giù da centinaia di metri, persone, auto e imbarcazioni si riducono a poche decine di pixel o meno. I sistemi standard di visione artificiale spesso non riescono a rilevare questi puntini o li confondono con il rumore di sfondo. Questo articolo presenta una versione più intelligente e snella di un noto sistema di rilevamento, YOLOv11n, appositamente ottimizzata per trovare questi oggetti minuscoli nelle immagini da drone mantenendo l’efficienza operativa su computer di bordo leggeri.

Cogliere più informazioni nei dettagli piccoli e sfocati

Le immagini da drone sono ambienti difficili per gli algoritmi. La maggior parte degli obiettivi è più piccola di 32×32 pixel, e molti sono sotto i 16 pixel. Movimento, vibrazioni, variazioni di illuminazione, foschia e sfondi urbani complessi rendono ancora più arduo distinguere questi target minuti. Peraltro, i droni spesso montano processori modesti e hanno risorse energetiche limitate, quindi modelli pesanti sono impraticabili. Gli autori partono da YOLOv11n, un rilevatore compatto in tempo reale, e riprogettano componenti interni per estrarre più informazioni utili da regioni piccole e a basso contrasto senza appesantire il modello. L’obiettivo è semplice ma ambizioso: aumentare significativamente l’accuratezza sui piccoli oggetti, mantenendo uguale o inferiore il numero di parametri apprendibili e garantendo velocità accettabili su hardware edge.

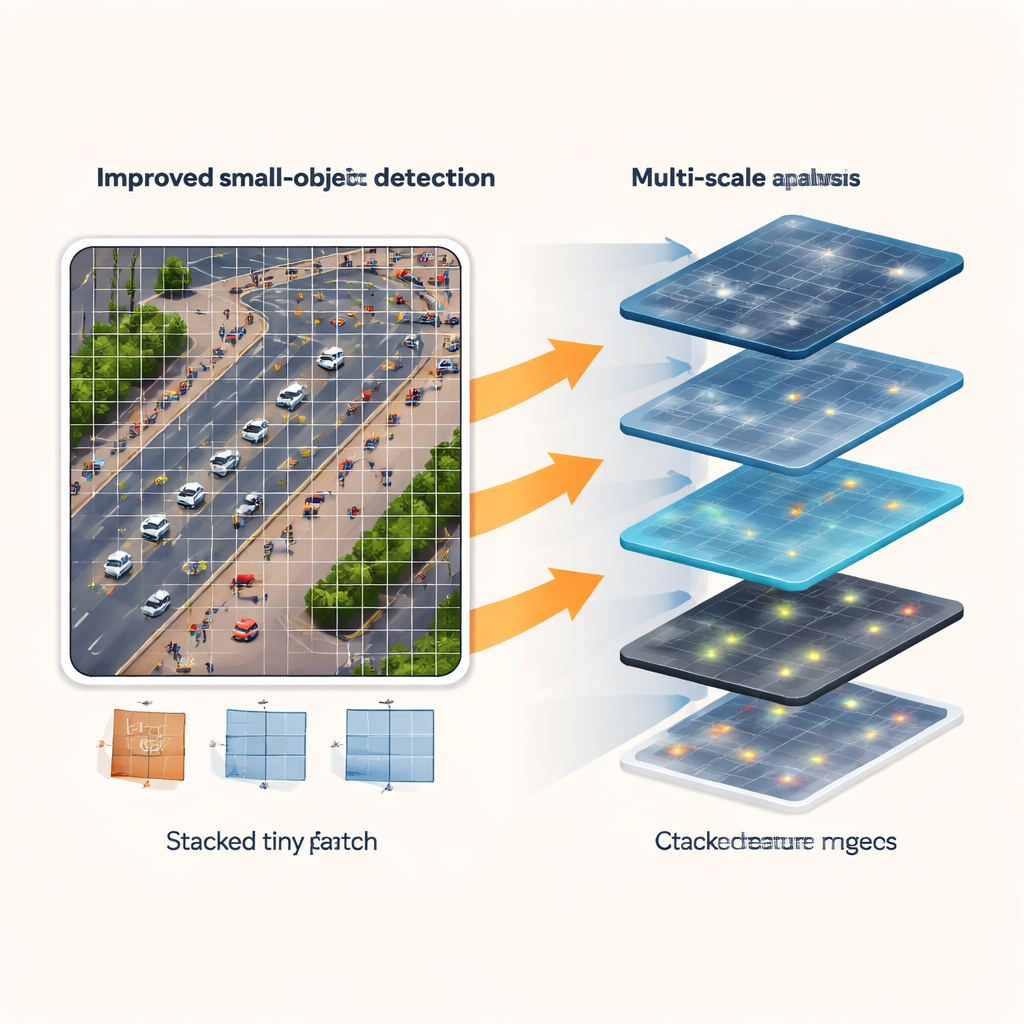

Imparare dalla scena su molte scale

Il primo miglioramento riguarda il modo in cui la rete “vede” la scena. Invece di osservare attraverso una singola finestra di dimensione fissa, il nuovo modulo Multiscale Edge-Feature Adaptive Selection (MSEAF) analizza l’immagine a più scale contemporaneamente. Le viste più grossolane catturano la disposizione generale di strade, edifici e assembramenti, mentre quelle più dettagliate mantengono informazioni su singole auto o persone. Un passaggio di potenziamento dei bordi enfatizza contorni e forme che per l’occhio umano sono facili da riconoscere ma che spesso si attenuano in patch d’immagine molto piccole. Un meccanismo di fusione intelligente potenzia quindi le regioni più informative sopprimendo il rumore di fondo. Questa rappresentazione multiscala e sensibile ai bordi fornisce al resto della rete un punto di partenza più ricco per individuare oggetti difficili da vedere.

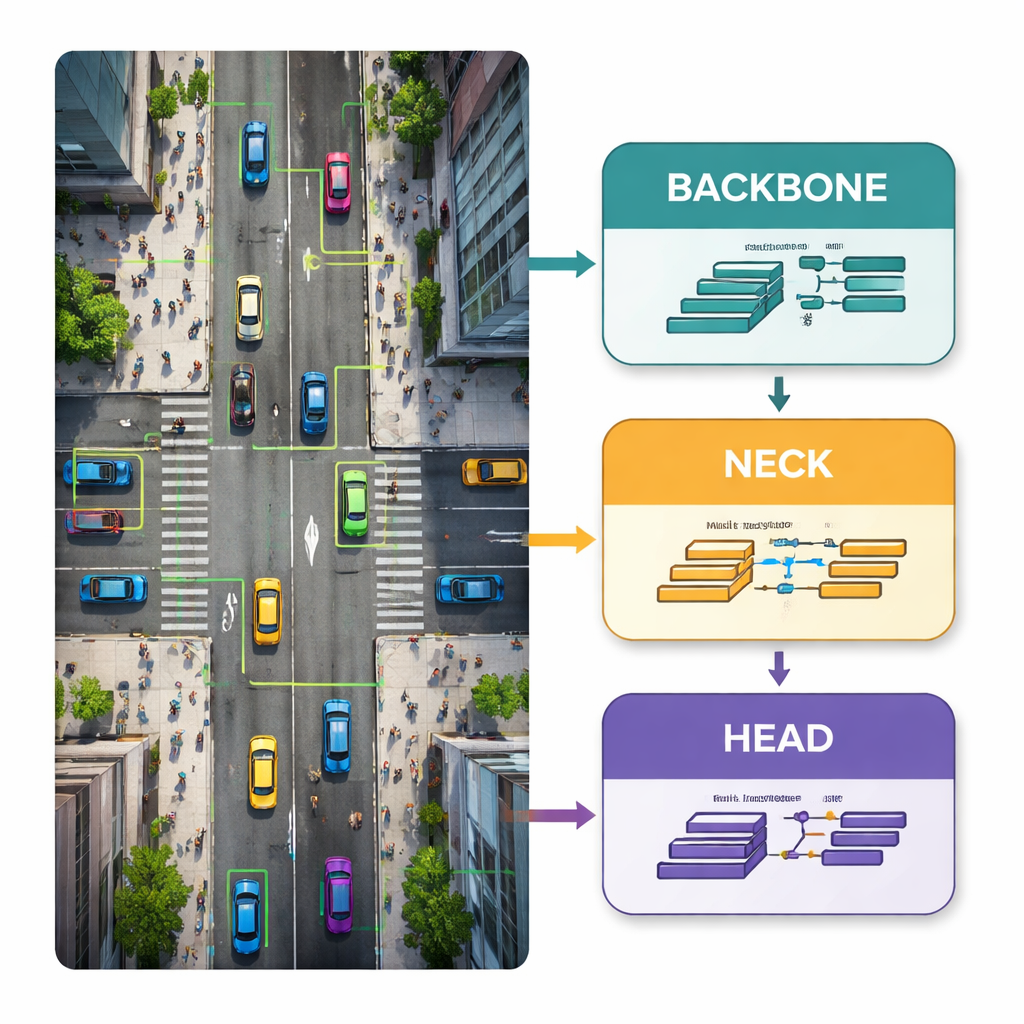

Mantenere vivi i piccoli oggetti lungo la pipeline

Le reti YOLO tradizionali riducono ripetutamente le mappe di caratteristica man mano che l’informazione scorre dall’input all’output. Per oggetti grandi questo è accettabile, ma per quelli minuscoli può essere fatale: dopo diversi passaggi di downsampling, un pedone può occupare solo uno o due pixel in una mappa interna, o sparire del tutto. Per evitarlo, gli autori rimodellano la parte centrale — il cosiddetto “neck” — della rete e aggiungono una nuova testa di rilevamento P2 che opera su feature a risoluzione più elevata. Moduli personalizzati chiamati ScalCat e Scal3DC combinano accuratamente informazioni provenienti da layer diversi in modo che i dettagli fini degli strati superficiali e il contesto più ricco degli strati profondi si rinforzino a vicenda. Il risultato è un rilevatore che segue auto e persone piccole attraverso più scale, invece di sacrificarle in nome della velocità.

Decisioni più nette con meno parametri

L’ultimo passo è snellire la fase di predizione, nota come detection head. Nel progetto originale, layer più profondi con molti canali erano dedicati principalmente agli oggetti grandi, relativamente rari nelle scene da drone. La nuova testa Shared Re-parameterized Detection (SRepD) uniforma il numero di canali tra le scale e utilizza un trucco di addestramento intelligente: durante l’apprendimento, diverse branche convoluzionali specializzate esplorano modi alternativi di evidenziare le feature; in fase di inferenza, queste branche vengono matematicamente fuse in un’unica convoluzione semplice. Questo design condiviso e re-parametrizzato migliora la fusione delle feature riducendo in realtà il numero di parametri e mantenendo i calcoli gestibili per dispositivi edge.

Cosa dicono i numeri nei test sul campo

Il modello potenziato è valutato su tre dataset pubblici impegnativi: VisDrone2019 (scene urbane miste), TinyPerson (persone estremamente piccole su terra e mare) e HazyDet (veicoli in forti condizioni di foschia dal punto di vista di un drone). Su VisDrone2019 il nuovo progetto aumenta una misura chiave di accuratezza (mAP50) e la precisione di 4,6 punti percentuali rispetto al YOLOv11n originale, riducendo al contempo i parametri di circa l’8,5%. Su TinyPerson i miglioramenti sono ancora maggiori — circa 5,9 punti in mAP50 e 5,6 in precisione — con una riduzione simile dei parametri, e il modello compatto supera addirittura un molto più grande YOLOv11s che impiega quattro volte più parametri. In condizioni di foschia, il rilevatore aggiornato supera il baseline sia in termini di accuratezza sia di robustezza, mantenendo al contempo velocità real-time su una scheda edge a basso consumo Huawei Atlas 200 DK.

Perché questo conta per l’uso quotidiano dei droni

Per i non specialisti, la conclusione principale è che questa ricerca dimostra che i droni possono diventare contemporaneamente più acuti e più parsimoniosi nelle risorse. Ripensando dove e come la rete cerca i dettagli, preservando informazioni ad alta risoluzione per i target minuti e semplificando il motore di predizione, gli autori rompono il consueto compromesso tra accuratezza e dimensione. Il sistema risultante è migliore nel rilevare persone e veicoli piccoli e distanti in scene affollate, fosche o complesse senza richiedere hardware ingombrante. Questo tipo di progresso avvicina il monitoraggio aereo affidabile e in tempo reale per la sicurezza del traffico, la ricerca e soccorso e l’osservazione ambientale a un impiego quotidiano più ampio.

Citazione: Zhu, H., Xie, X. Enhanced YOLOv11n for small object detection in UAV imagery: higher accuracy with fewer parameters. Sci Rep 16, 5536 (2026). https://doi.org/10.1038/s41598-026-35301-2

Parole chiave: rilevamento oggetti con droni, riconoscimento di piccoli oggetti, rete neurale YOLO, analisi di immagini aeree, AI per edge nei UAV