Clear Sky Science · it

Valutazione della precisione dei dati nucleari appresi con machine learning nelle analisi neutriniche Monte Carlo e di efficienza computazionale per reattori a cuore completo

Perché le simulazioni di reattori più veloci sono importanti

Le centrali nucleari si basano su modelli informatici dettagliati per prevedere il comportamento del combustibile nel corso di mesi e anni di funzionamento. Questi modelli sono fondamentali per la sicurezza, l’efficienza e la progettazione di nuovi reattori, ma sono notoriamente lenti e avidi di memoria. Questo articolo esplora se l’apprendimento automatico può ridurre le enormi tabelle di dati nucleari che guidano queste simulazioni — abbattendo significativamente i costi computazionali — senza sacrificare l’accuratezza fisica di cui gli ingegneri si fidano.

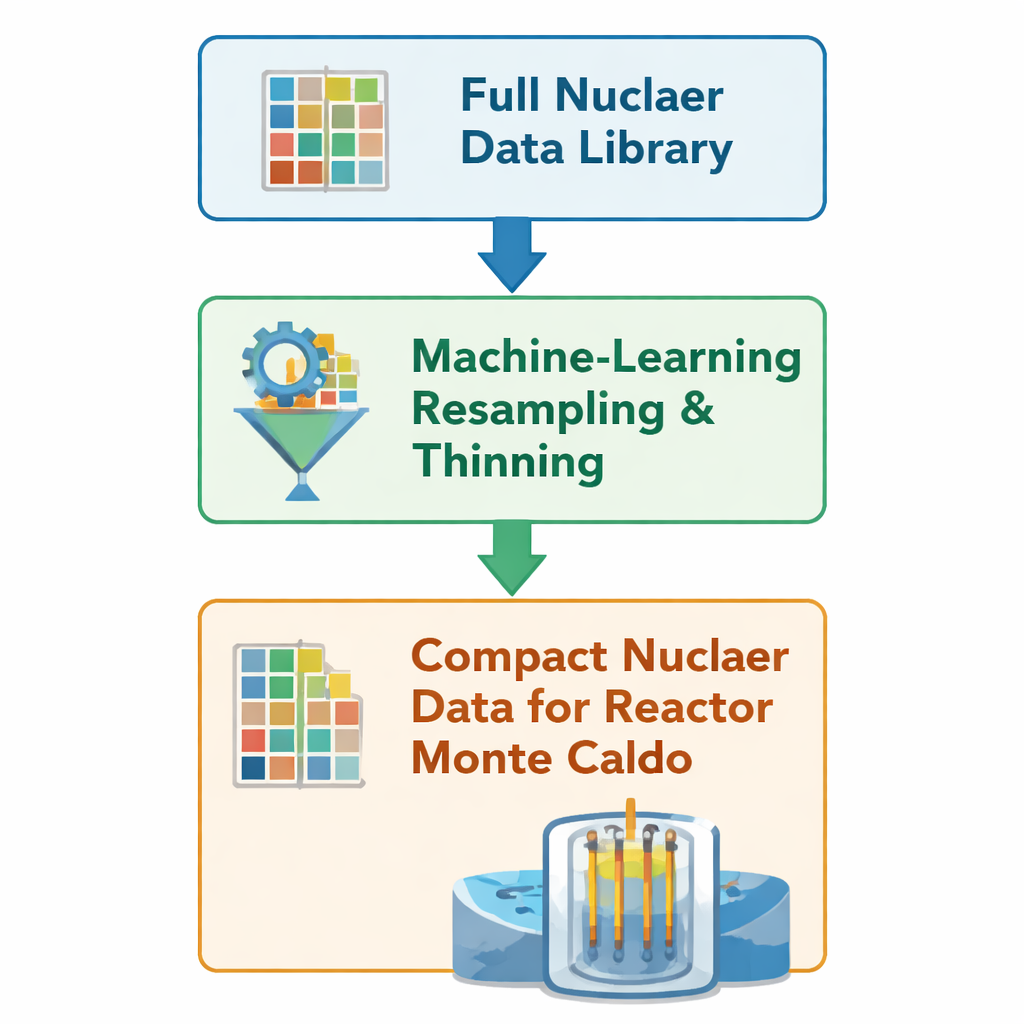

Ridurre i dati alla base della fisica

Ogni volta che un neutrone simulato si muove attraverso un nucleo di reattore virtuale, il codice consulta grandi tabelle che descrivono la probabilità di disperdersi, essere assorbito o provocare una fissione. Queste tabelle, chiamate librerie di dati nucleari, codificano probabilità su migliaia di punti di energia per molti isotopi nel combustibile e nei suoi prodotti di decadimento. Gli autori si basano su un metodo di machine learning precedente che “sfoltisce” quelle tabelle: rimuove i punti di energia ridondanti preservando caratteristiche pronunciate come soglie di reazione e picchi di risonanza, dove le probabilità cambiano rapidamente. Invece di rigenerare i dati tramite una lunga catena di elaborazione tradizionale, il metodo modifica direttamente i file HDF5 nativi di OpenMC, mantenendo solo circa il 10–50% dei punti della griglia originale per 23 nuclidi particolarmente importanti.

Testare l’idea su cuori di reattore completi

Per verificare se questi dati più snelli producono ancora risultati affidabili in contesti realistici, il team esegue simulazioni annuali di due grandi reattori ad acqua pressurizzata: un European Pressurized Reactor (EPR) e un VVER‑1000, utilizzando il codice Monte Carlo open‑source OpenMC. Per ciascun nucleo, conducono due campagne altrimenti identiche: una con la libreria di dati nucleari completa e una con la versione sfoltita dal machine learning. Tutta la geometria, le condizioni di esercizio e i parametri numerici sono fissati; differiscono solo le tabelle di dati alla base della fisica. Disattivano altre funzionalità di accelerazione all’interno di OpenMC affinché qualsiasi cambiamento in velocità o memoria possa essere ricondotto direttamente alla riduzione dei dati, non a cambiamenti di algoritmi o impostazioni.

Incrementi di velocità con limiti di errore stretti

Il beneficio è sostanziale. Per il caso EPR, il tempo totale di calcolo diminuisce di circa il 18%, e per il VVER‑1000 il tempo di esecuzione si riduce di circa il 43%. L’uso della memoria cambia in modo più modesto: l’utilizzo di picco diminuisce di circa il 4% nell’EPR e aumenta di circa il 5% nel VVER‑1000, a riflettere le differenze in quanto tempo ciascun modello dedica alla ricerca dei dati nucleari rispetto al tracciamento dei percorsi delle particelle nella geometria. Crucialmente, le principali grandezze a livello di reattore rimangono molto vicine agli originali. Su un anno intero nel VVER‑1000, il fattore di moltiplicazione efficace — sostanzialmente, quanti neutroni produce in media ogni fissione — non si discosta mai di più di circa 100 parti per milione, e tipicamente di solo poche decine di parti per milione. Per canali di reazione chiave come la fissione in uranio‑235 e uranio‑238 e la cattura neutronica in xenon‑135 e samario‑149, le differenze medie rimangono ben al di sotto di un decimo di percento.

L’evoluzione del combustibile e i veleni rimangono in linea

Poiché il comportamento a lungo termine del reattore dipende non solo dalle reazioni istantanee ma da come si accumulano e si consumano combustibile e prodotti di fissione, gli autori tracciano anche gli inventari variabili degli isotopi importanti. Esaminano i principali isotopi dell’uranio, una famiglia di isotopi del plutonio generati dall’uranio‑238, e forti nuclidi “veleni” che assorbono neutroni, in particolare xenon‑135 e samario‑149. Anche dopo un anno intero, le differenze in questi inventari tra i casi con dati completi e ridotti sono minime: dell’ordine di qualche centesimo di percento per xenon e samario, e generalmente sotto un decimo di percento per le specie di plutonio. L’uranio‑235 e l’uranio‑238, che dominano la produzione di energia del cuore e l’equilibrio neutrinico, sono riprodotti con accuratezza molto migliore di un centesimo di percento. Dove gli errori relativi eccedono brevemente l’uno percento per alcuni isotopi di plutonio, ciò avviene all’inizio del ciclo quando le loro quantità assolute sono ancora estremamente piccole, quindi l’effetto pratico sul comportamento del reattore è trascurabile.

Cosa significa per la modellazione dei reattori in futuro

Per i non specialisti, il messaggio essenziale è che una procedura di machine learning opportunamente addestrata può rendere le “tabelle di consultazione” nucleari all’interno di simulazioni avanzate di reattori significativamente più piccole e veloci da usare, mantenendo al contempo il comportamento simulato del reattore quasi indistinguibile dall’approccio tradizionale. Lo studio dimostra questo per due cuori di reattore su scala industriale su un anno intero di funzionamento, con margini di errore piccoli rispetto ad altre incertezze tipiche nell’analisi di reattori. Gli autori sottolineano che le loro conclusioni si applicano attualmente a reattori ad acqua pressurizzata in regime stazionario usando una specifica libreria di dati e impostazioni di codice, e che sono necessari ulteriori lavori per testare altri tipi di reattore e condizioni transitorie. Tuttavia, i risultati suggeriscono una via promettente verso simulazioni nucleari ad alta fedeltà più veloci ed efficienti, permettendo di svolgere più studi di progettazione e analisi di sicurezza con risorse di calcolo limitate.

Citazione: Hashemi, A., Macián-Juan, R. & Ohlerich, M. Evaluating machine learned nuclear data precision in full core nuclear reactor Monte Carlo neutronics and computational efficiency analyses. Sci Rep 16, 1314 (2026). https://doi.org/10.1038/s41598-026-35227-9

Parole chiave: simulazione di reattori nucleari, apprendimento automatico, neutrinica Monte Carlo, librerie di dati nucleari, reattori ad acqua pressurizzata