Clear Sky Science · it

Valutazione di ChatGPT-4o e Gemini per la gestione della gotta: un’analisi comparativa basata sulle linee guida EULAR

Perché i chatbot intelligenti e le articolazioni doloranti contano

La gotta, una forma dolorosa di artrite che spesso colpisce l’alluce, sta diventando sempre più comune nel mondo. I medici hanno già linee guida chiare e basate sull’evidenza su come diagnosticarla e trattarla, eppure molti pazienti non ricevono cure ottimali. Allo stesso tempo, chatbot di intelligenza artificiale potenti come ChatGPT-4o e Gemini stanno iniziando a comparire in ambito clinico, sollevando una domanda semplice ma cruciale: questi strumenti possono davvero fornire consigli sicuri e conformi alle linee guida sulla gotta, o rischiano di fuorviare medici e pazienti?

Verificare quanto i chatbot rispettano il manuale

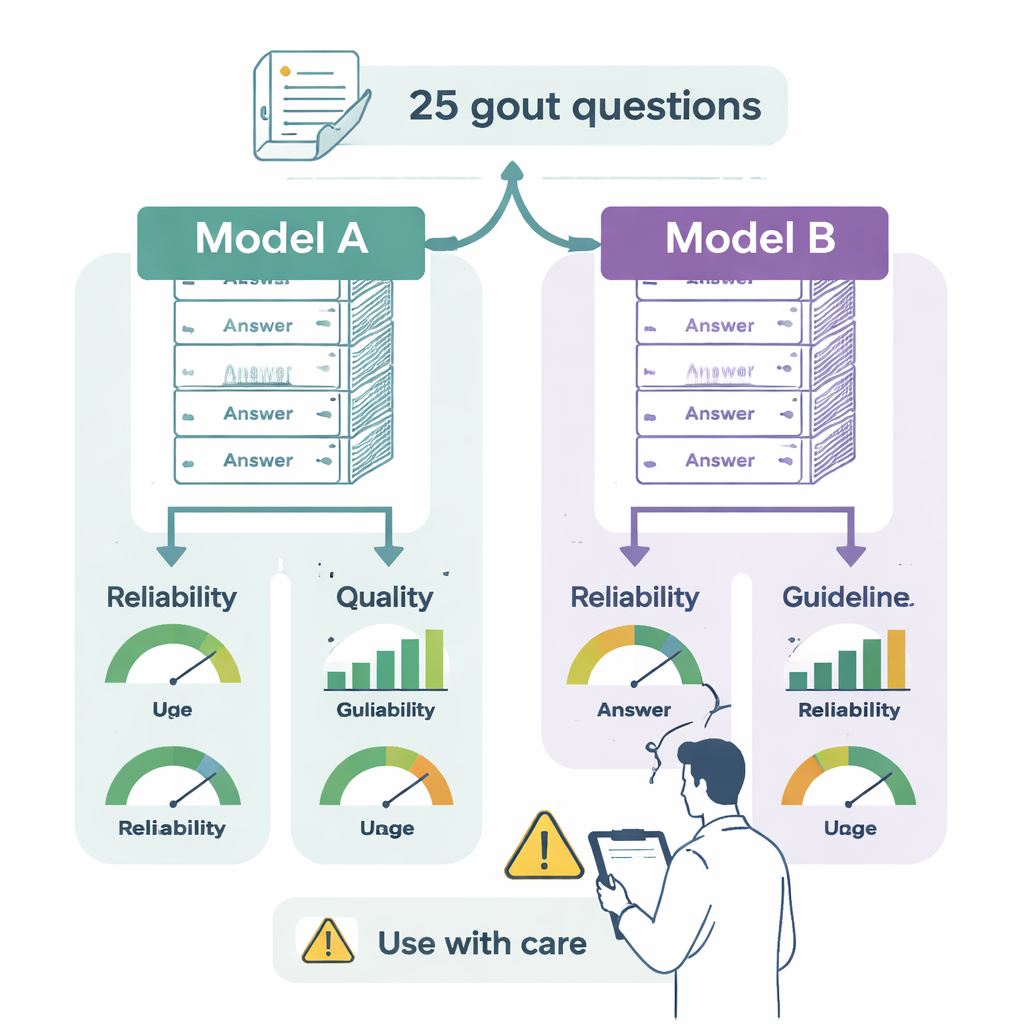

I ricercatori hanno testato due modelli linguistici di punta—ChatGPT-4o e Gemini 2.0 Flash—rispetto alle linee guida ufficiali europee (EULAR) per la gotta. Due specialisti hanno trasformato 25 raccomandazioni chiave delle linee guida in domande in stile clinico su problemi del mondo reale: come diagnosticare la gotta, quando iniziare farmaci che abbassano l’acido urico, come gestire le crisi, quali obiettivi perseguire negli esami del sangue e come adattare stile di vita o altri farmaci. Entrambi i chatbot hanno ricevuto le stesse domande in sessioni distinte e pulite, così da evitare che risposte precedenti influenzassero quelle nuove.

Come sono state valutate le risposte

Ogni risposta è stata valutata da due clinici esperti in gotta, ignari di quale modello avesse prodotto il testo. Hanno giudicato tre aspetti. Primo, affidabilità: la risposta appare equilibrata, obiettiva e attendibile, o omette fatti chiave o sovrastima i benefici? Secondo, qualità: la risposta è chiara, ben organizzata e utile per uno specialista che deve decidere? Terzo, allineamento alle linee guida: corrisponde a quanto raccomandato da EULAR, è in parte d’accordo con lacune, o contraddice direttamente le regole? Il team ha inoltre valutato la difficoltà di lettura delle risposte usando test standard che stimano il livello di istruzione necessario per comprendere un testo.

ChatGPT vs. Gemini: chi ha fatto meglio?

Entrambi i chatbot hanno prodotto risposte generalmente sensate e ben scritte, e spesso hanno ricordato ai lettori di consultare un professionista sanitario. Ma sono emerse differenze importanti. ChatGPT-4o è risultato pienamente conforme alle linee guida per la gotta nel 76% dei casi e ha fornito risposte per lo più corrette ma incomplete in un ulteriore 20%, con una sola risposta contenente un errore medico chiaro. Gemini è stato pienamente allineato nel 48% delle risposte e parzialmente corretto ma incompleto nel 32%. Più preoccupante, il 12% delle sue risposte ha mescolato idee corrette con informazioni errate e l’8% ha contraddetto apertamente le linee guida—forse suggerendo, ad esempio, un uso ampio di una potente classe di farmaci antinfiammatori (inibitori dell’IL-1) che EULAR riserva a pazienti selezionati e difficili da trattare, o raccomandando l’avvio routinario di terapie urato‑riducenti durante una crisi acuta, ambito in cui gli esperti raccomandano maggiore cautela.

Leggibile, ma non di facile lettura

Quanto allo stile, i due sistemi si sono rivelati sorprendentemente simili. Su più scale di lettura, entrambi hanno prodotto testi che richiedono almeno un livello di istruzione universitario per essere seguiti comodamente. Questo può essere accettabile per medici specialisti, ma è troppo complesso per la maggior parte dei pazienti. Nessuno dei due modelli ha fornito riferimenti o link alle fonti a meno che non fosse richiesto esplicitamente, rendendo difficile verificare l’origine delle informazioni. L’accordo tra i revisori è stato valutato da buono a eccellente, suggerendo che la valutazione era coerente e che le differenze tra i chatbot erano reali e non solo questioni di opinione.

Cosa significa per chi convive con la gotta

Complessivamente, lo studio suggerisce che i chatbot avanzati possono essere assistenti utili per i medici che gestiscono la gotta, ma non sono pronti a operare in autonomia. ChatGPT-4o si è dimostrato più affidabile, più completo e più fedele alle linee guida rispetto a Gemini, tuttavia anche i suoi rari errori possono avere conseguenze quando in gioco ci sono farmaci e sicurezza. Entrambi gli strumenti si sono espressi a un livello troppo complesso per la maggior parte dei pazienti e sono mancati di trasparenza integrata sulle fonti. Per ora, sostengono gli autori, l’IA dovrebbe essere considerata uno strumento di supporto promettente che può aiutare clinici e formatori—ma solo se i suoi consigli vengono verificati rispetto a linee guida aggiornate e al giudizio di esperti, specialmente in patologie come la gotta dove piccoli dettagli di dosaggio e scelte di tempistica possono fare una grande differenza nel dolore, nei danni a lungo termine e nella qualità della vita.

Citazione: Meral, H.B., Kolak, E. Evaluation of ChatGPT-4o and Gemini for gout management: a comparative analysis based on EULAR guidelines. Sci Rep 16, 4831 (2026). https://doi.org/10.1038/s41598-026-35166-5

Parole chiave: gotta, linee guida cliniche, intelligenza artificiale, modelli linguistici di grandi dimensioni, reumatologia