Clear Sky Science · it

Inpainting automatizzato delle immagini per il restauro di reperti storici mediante ibridazione del transfer learning con modelli generativi profondi

Perché riparare l'arte antica con l'IA è importante

Musei e archeologi di tutto il mondo corrono contro il tempo. Antichi murales, affreschi e pareti dipinte si sgretolano, sbiadiscono e si incrinano dopo secoli di esposizione all'umidità, all'inquinamento e a manipolazioni disattente. Restaurarli manualmente è lento, costoso e talvolta irreversibile. Questo studio presenta un nuovo sistema di intelligenza artificiale in grado di riparare digitalmente immagini danneggiate di opere storiche, offrendo a curatori e ricercatori un modo sicuro per visualizzare come potrebbero essere state scene perdute e per preservarle per le generazioni future.

Pareti screpolate, pittura mancante e una rete di sicurezza digitale

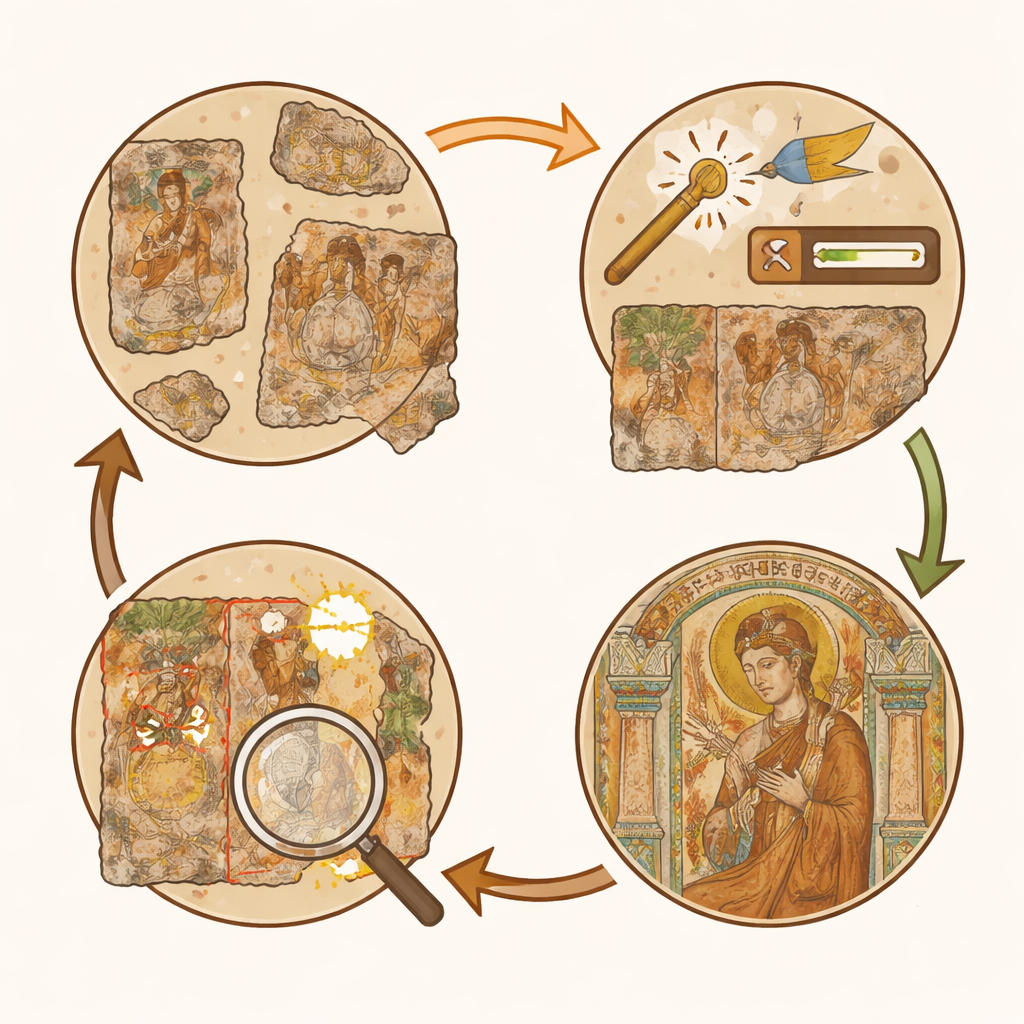

Il restauro tradizionale spesso significa che un conservatore ritocca fisicamente l'opera, aggiungendo nuova pittura dove la precedente è andata perduta. Per quanto fatto con cura, questi interventi non sono facilmente reversibili e possono introdurre bias moderni. Il restauro digitale prende una strada diversa: fotografie ad alta risoluzione di murales danneggiati sono elaborate da algoritmi che suggeriscono come riempire le regioni mancanti. Poiché tutto avviene in software, i restauri proposti possono essere confrontati, rivisti o scartati senza toccare l'oggetto fisico. Gli autori si concentrano su murales di Dunhuang in Cina — un famoso complesso di templi rupestri le cui pitture murali hanno subito crepe, sfaldature, muffa e ampie aree mancanti. L'obiettivo è costruire un sistema che possa riparare automaticamente tali immagini mantenendo quanto più possibile lo stile originale, i colori e i dettagli fini.

Da foto rumorose a punti di partenza puliti

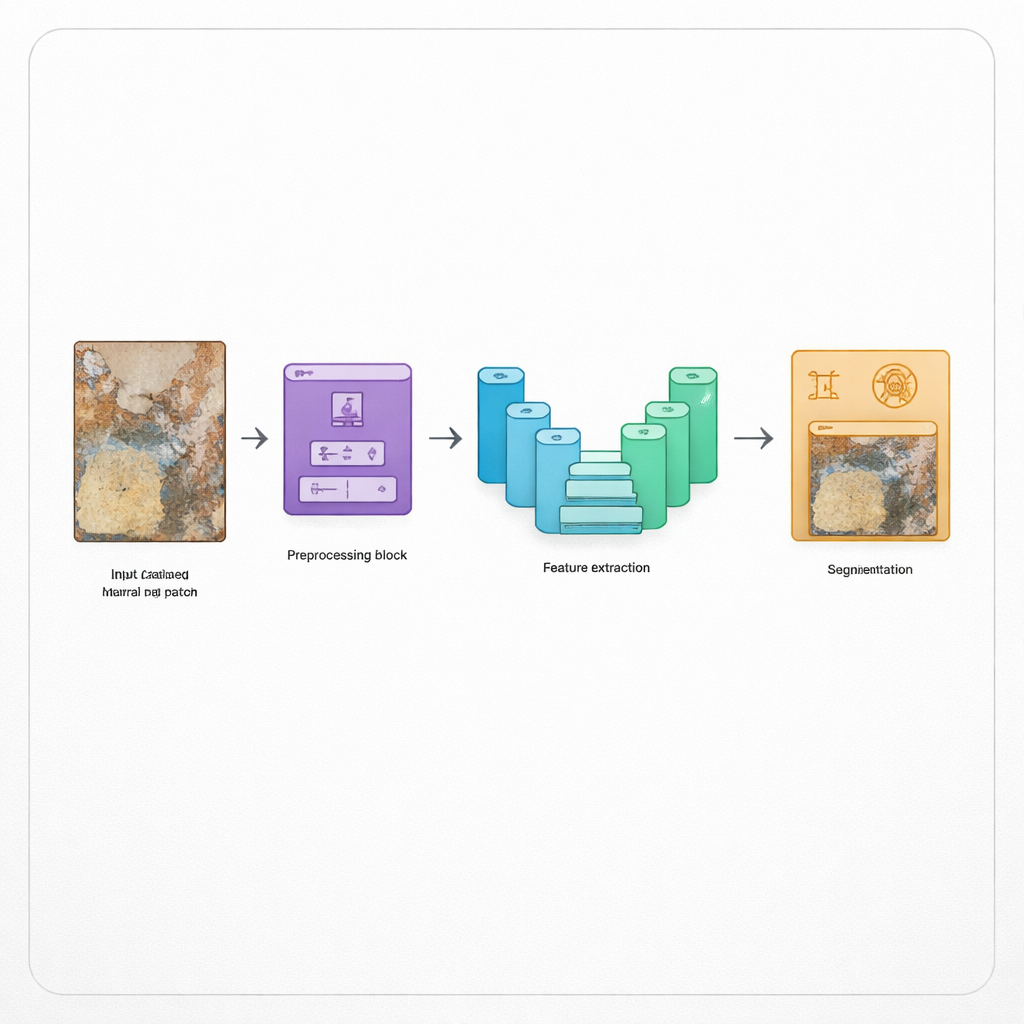

Il primo passo nel sistema è ripulire le fotografie in ingresso in modo che le fasi successive non siano fuorviate dal rumore della fotocamera o da illuminazione scarsa. Il metodo usa un filtro mediano adattivo, una tecnica che attenua spuntinature e pixel casualmente chiari o scuri preservando i bordi netti, come i contorni in una scena murale. Quindi migliora il contrasto affinché linee sbiadite e colori attenuati risultino più facili da distinguere. Questi aggiustamenti funzionano come lucidare delicatamente una lente impolverata: non inventano nuovo contenuto, ma rendono più visibili i dettagli esistenti. Regolando accuratamente questa fase, gli autori evitano un eccesso di levigatura che potrebbe cancellare pennellate sottili di interesse per gli studiosi.

Insegnare al sistema a riconoscere i danni

Una volta che l'immagine è pulita, il modello deve decidere quali parti del murale sono integre e quali sono danneggiate. Per farlo, gli autori impiegano una rete neurale compatta ma potente chiamata SqueezeNet, adattata con un meccanismo di attenzione per focalizzarsi sulle regioni informativamente rilevanti. Questa rete impara a leggere il linguaggio visivo dei murales — le trame dell'intonaco, i pattern di pigmento e le forme delle crepe o delle pareti scoperte. L'output alimenta un'altra rete chiamata U-Net, progettata per compiti di tipo ‘‘ritaglio’’ molto precisi. U-Net etichetta ogni pixel come pittura sana, area mancante o altre forme di deterioramento. Grazie alle connessioni a salto e ai blocchi di attenzione e residuali aggiunti, mantiene traccia sia della struttura generale (dove si trova una figura o una cornice) sia dei dettagli minuti (come linee sottili e ornamenti), mappando con precisione dove è necessario l'inpainting.

Lascare che un pittore IA colmi i vuoti

Con le regioni danneggiate segnate, la fase finale è immaginare come quelle aree potrebbero essere apparse originariamente. Qui gli autori combinano due idee all'avanguardia: le reti generative avversarie (GAN), esperte nella creazione di immagini realistiche, e le reti transformer, eccellenti nel catturare relazioni a lungo raggio. Il loro ibrido ‘‘transformer-based GAN’’ osserva la pittura intatta circostante e il murale nel suo insieme per inferire texture, forme e colori plausibili per le zone mancanti. Non si limita a copiare e incollare pixel vicini; sintetizza invece nuovo contenuto che si fonde armoniosamente nella scena e rispetta la composizione globale, come la simmetria dei motivi o la continuità di vesti e linee architettoniche.

Quanto bene funziona il restauratore digitale

Per verificare il sistema, i ricercatori hanno usato un dataset specializzato di immagini dei murales di Dunhuang che include versioni danneggiate artificialmente e i corrispondenti originali di riferimento. Questo permette di misurare quanto l'output restaurato digitalmente si avvicini al riferimento non danneggiato. Segnalano che il loro metodo, chiamato HDLIP-SHAR, supera diverse tecniche consolidate su più metriche di qualità, inclusa la chiarezza complessiva (PSNR), la somiglianza strutturale (SSIM) e una misura percettiva moderna (LPIPS) che rispecchia meglio il giudizio visivo umano. Il modello funziona anche in modo efficiente, richiedendo meno risorse di calcolo e meno tempo rispetto a molti approcci concorrenti, cosa importante se i musei vogliono processare grandi collezioni.

Cosa significa per la salvezza della storia

Per i non specialisti, il punto chiave è che questo sistema IA si comporta come un assistente attento e reversibile piuttosto che come un pittore troppo sicuro di sé. Può suggerire come volti, motivi o scene mancanti in antichi murales potrebbero essere completati, offrendo agli studiosi uno strumento potente di visualizzazione senza mettere a rischio gli originali. Allo stesso tempo, gli autori osservano limiti: il metodo dipende ancora da materiale di riferimento ragionevolmente chiaro, fatica con danni estremamente gravi e non integra ancora nel calcolo la ricerca storica o l'analisi dei materiali nelle sue ipotesi. Anche così, approcci ibridi come HDLIP-SHAR rappresentano un passo importante verso l'uso dell'IA non solo per migliorare immagini esteticamente gradevoli, ma per contribuire a preservare patrimoni culturali irrinunciabili in modo trasparente, verificabile e non invasivo.

Citazione: Swathi, B., Rao, D.B.J. Automated image inpainting for historical artifact restoration using hybridisation of transfer learning with deep generative models. Sci Rep 16, 4810 (2026). https://doi.org/10.1038/s41598-026-35056-w

Parole chiave: restauro digitale di murales, image inpainting, deep learning, patrimonio culturale, modelli GAN transformer