Clear Sky Science · it

Uno studio sul design e la valutazione multimodale di interfacce intuitive per sistemi informativi complessi nella cooperazione uomo/veicolo

Perché schermate più intelligenti contano nelle missioni ad alta pressione

Le missioni militari moderne fanno sempre più affidamento su team di velivoli con equipaggio che operano insieme a sciami di droni. I comandanti devono districarsi in pochi secondi tra schermate radar affollate e pannelli di stato, dove la confusione può significare minacce non rilevate o errori di fuoco amico. Questo studio pone una domanda semplice ma dalle grandi implicazioni: se riprogettiamo queste schermate complesse in modo che risultino più “ovvie” a colpo d’occhio — usando immagini, colore e movimento invece di testo denso — le persone possono pensare più velocemente, restare più calme e prendere comunque la decisione giusta?

Trasformare l’intuito in design di schermate

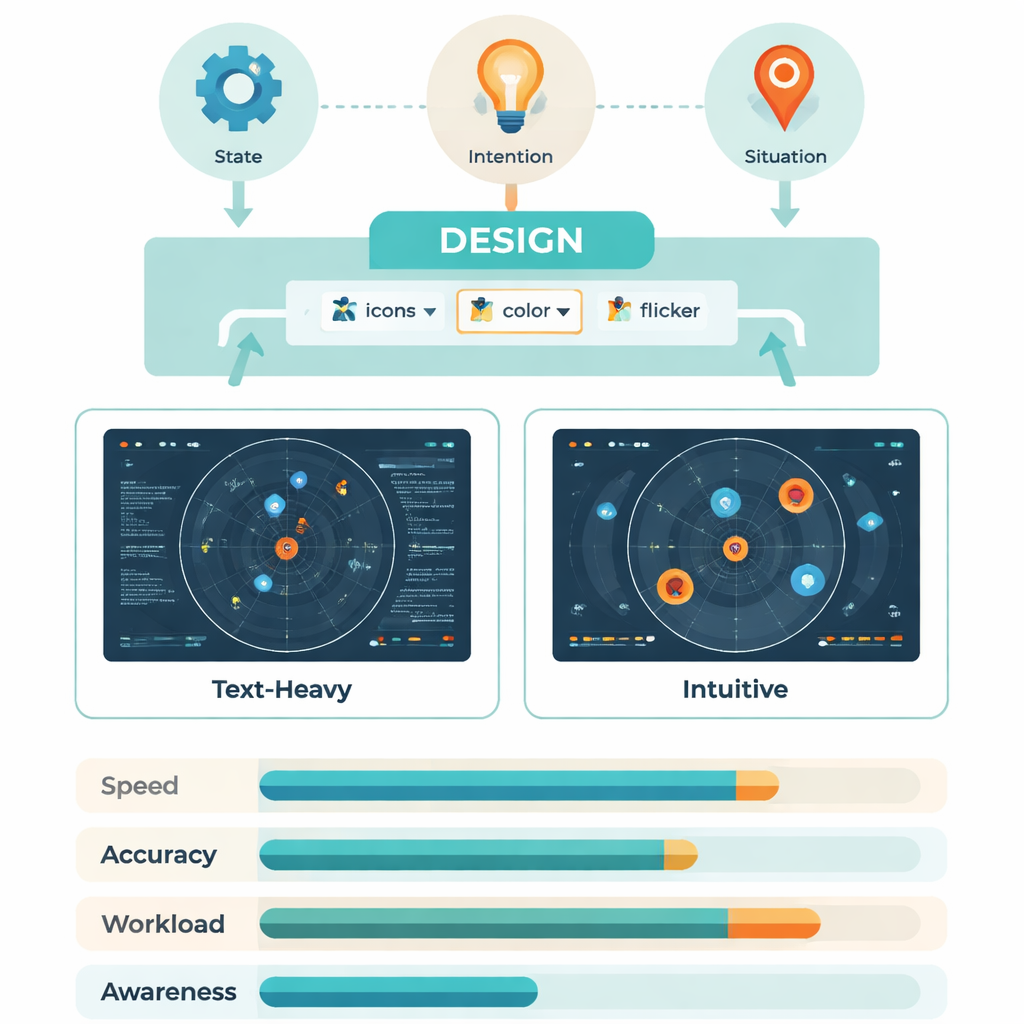

I ricercatori partono dall’idea di “interazione intuitiva”: il modo in cui riconosciamo automaticamente una luce rossa come pericolo o una catena spezzata come connessione persa. Psicologia e studi di fattori umani suggeriscono che questi schemi incorporati — riflessi corporei, simboli quotidiani e icone familiari — possono essere sfruttati affinché gli utenti non debbano decodificare consciamente ogni informazione. In questo progetto tali idee sono applicate a schermate di gestione della battaglia che mostrano tre tipi principali di informazioni: quali bersagli e armamenti sono presenti (stato), cosa i droni stanno per fare (intenzione) e come sta evolvendo il quadro generale (situazione). Mappando ciascuno di questi su forme semplici, colori e movimento, il team mirava a creare display che si “spiegano da soli” nel momento in cui appaiono.

Dai bozzetti di esperti a display operativi

Progettare un’interfaccia del genere non è stato un esercizio di tentativi a caso. Il team ha prima intervistato operatori esperti e progettisti di sistema, chiedendo, per esempio, “Che tipo di simbolo ti permette di riconoscere un drone che disturba senza pensarci?”. Da queste sessioni hanno estratto parole chiave come occhio, onda, catena e zona, trasformandole in set di icone rudimentali. Un secondo gruppo di esperti ha poi testato questi prototipi mentre pensava a voce alta. Qualsiasi simbolo non compreso correttamente da tutti è stato rivisto finché ogni elemento potesse essere letto istantaneamente. L’interfaccia finale adottava silhouette di velivoli invece di etichette testuali, luminosità per mostrare il livello di minaccia, evidenziazioni lampeggianti per segnalare dove un drone si sarebbe mosso, mirini o linee ondulate per indicare attacchi o disturbo, e piccoli indicatori locali sotto ciascun bersaglio per mostrare se era entrato in un raggio critico.

Mettere alla prova le schermate intuitive

Per verificare se queste idee funzionassero nella pratica, 30 operatori addestrati dell’Aeronautica si sono seduti a una console di comando simulata e hanno svolto compiti fittizi da campo di battaglia. A volte usavano un display tradizionale ricco di testo; altre volte la nuova versione intuitiva, con layout e colori accuratamente abbinati in modo che cambiasse solo la codifica dell’informazione. Mentre cercavano droni specifici, missili, livelli di minaccia, guasti di collegamento o bersagli nel raggio d’azione, il sistema ha registrato la velocità e l’accuratezza delle risposte, dove si posavano i loro occhi e come reagiva il loro cervello mediante segnali EEG collegati al carico mentale. Successivamente i partecipanti hanno valutato quanto fosse impegnativo il compito usando la nota scala di carico di lavoro NASA‑TLX.

Occhi più veloci, cervelli più leggeri

Le schermate intuitive hanno aiutato costantemente in condizioni di carico informativo basso e moderato. Gli operatori hanno risposto più rapidamente — spesso centinaia di millisecondi in meno per ogni interrogazione — e hanno avuto bisogno di meno fissazioni oculari e spostamenti per trovare l’elemento corretto. Indicatori dinamici come un lieve lampeggio si sono rivelati particolarmente efficaci per evidenziare la posizione futura di un drone, mentre simboli di uso comune (come i mirini per attacco) hanno prevalso su codici professionali più criptici nel descrivere azioni imminenti. Le misure delle onde cerebrali raccontano la stessa storia: un segnale chiave chiamato P300, che aumenta con lo sforzo e il ritardo nel processamento, era più piccolo e si manifestava prima con i display intuitivi, indicando che il cervello lavorava in modo più efficiente. Per compiti densi e ad alto carico il vantaggio si è ridotto, suggerendo che nessuna interfaccia può annullare completamente una complessità estrema.

Cosa significa per le persone nel ciclo decisionale

In un test di follow‑up su una versione ottimizzata dell’interfaccia intuitiva, un nuovo gruppo di operatori ha mostrato migliore consapevolezza situazionale, maggiore efficacia e minore affaticamento mentale riportato rispetto al layout tradizionale. In parole semplici, trasformando numeri e gergo in immagini chiare, codici colore e movimento che si allineano con l’esperienza quotidiana, il sistema ha permesso alle persone di individuare minacce e opportunità più rapidamente e con meno fatica mentale. Pur essendo il lavoro condotto in laboratorio su un gruppo d’utenza ristretto, offre una ricetta concreta per progettare future sale di controllo — militari o civili — dove gli operatori umani devono tenere il passo con macchine intelligenti senza esserne sovraccaricati.

Citazione: Qu, J., Chen, S., Dang, S. et al. A study on design and multimodal evaluation of intuitive interfaces for complex information systems in manned/unmanned cooperation. Sci Rep 16, 4746 (2026). https://doi.org/10.1038/s41598-026-35017-3

Parole chiave: interfacce intuitive, collaborazione uomo‑macchina, consapevolezza situazionale, eye tracking e EEG, cooperazione uomo‑veicolo