Clear Sky Science · it

Esaminare la dipendenza umana dall’intelligenza artificiale nelle decisioni

Perché conta la nostra fiducia nelle macchine intelligenti

Dalle raccomandazioni cinematografiche alla selezione del personale e alla giustizia penale, l’intelligenza artificiale (IA) aiuta sempre più le persone a prendere decisioni. Molti di noi presumono che i computer siano meno faziosi e più accurati degli esseri umani. Ma cosa succede realmente quando le persone ricevono consigli da un sistema di IA: li usano con giudizio o se ne affidano troppo? Questo studio esplora come le persone rispondono alle indicazioni fornite dall’IA rispetto a quelle provenienti da altri esseri umani e cosa ciò significa per il ruolo crescente dell’IA nelle decisioni quotidiane.

Testare persone reali con volti reali e falsi

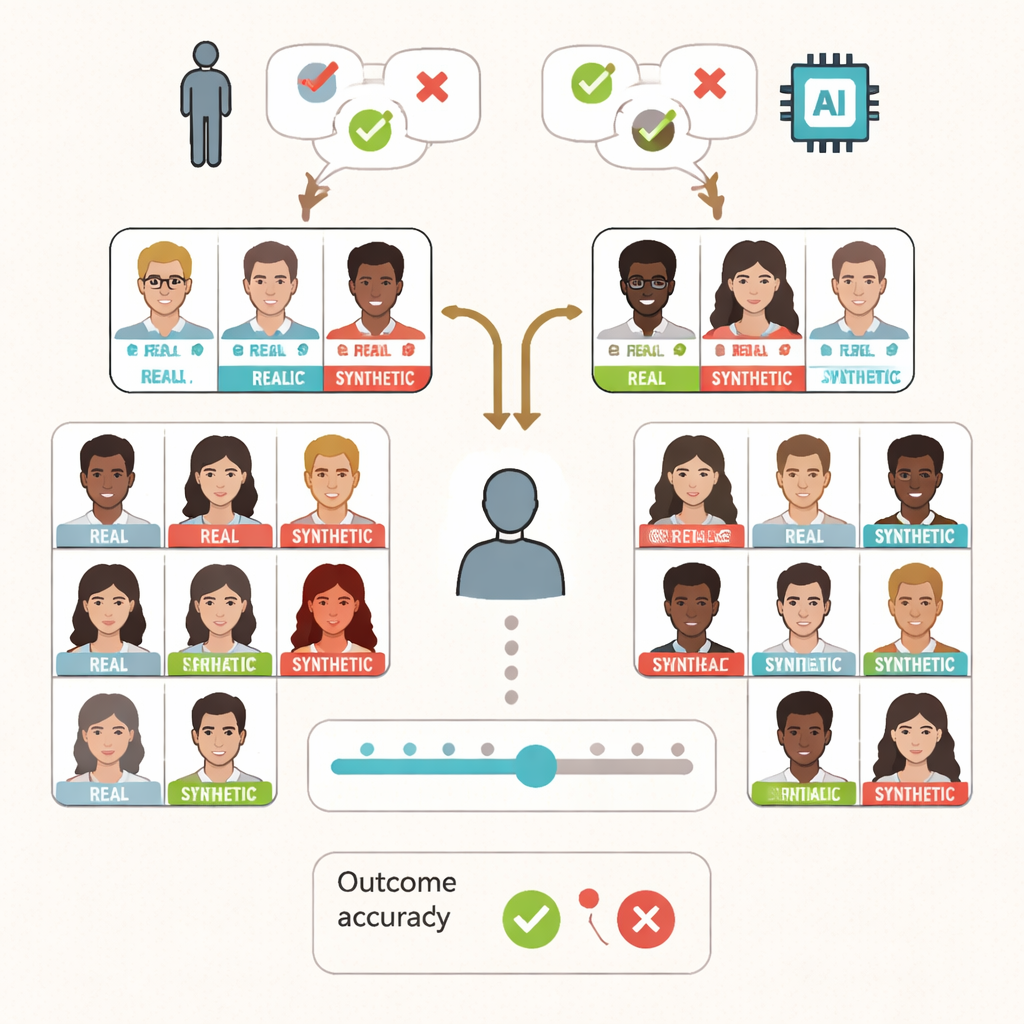

I ricercatori hanno chiesto a 295 adulti di svolgere un compito apparentemente semplice: decidere se un volto sullo schermo fosse la fotografia di una persona reale o un falso generato dall’IA. Ogni partecipante ha visto 80 volti—metà reali, metà sintetici—selezionati con cura in lavori precedenti in modo che la maggior parte delle persone potesse identificarli nella maggior parte dei casi, ma non perfettamente. Accanto a ciascun volto, i partecipanti vedevano un breve suggerimento che indicava se il volto fosse “reale” o “sintetico”. È stato detto loro che questo consiglio proveniva da un gruppo di esperti umani o da un sistema di IA, anche se in realtà tutti i consigli erano pre-programmati e corretti solo metà delle volte.

Usare i consigli, ma non a occhi chiusi

La questione centrale era se le persone avrebbero semplicemente seguito il consiglio o avrebbero ragionato da sole. I risultati mostrano che i partecipanti non si sono comportati come semplici premitori di pulsanti. Hanno seguito il consiglio molto più spesso quando questo si è rivelato corretto e sono stati più propensi a ignorarlo quando era sbagliato, indipendentemente dal fatto che provenisse da umani o dall’IA. L’accuratezza complessiva nel distinguere volti reali da sintetici si è mantenuta intorno ai due terzi di risposte corrette—molto simile a un gruppo separato in ricerche precedenti che aveva svolto lo stesso compito senza alcuna guida. In altre parole, la presenza di un “aiutante” IA non ha né migliorato né compromesso drasticamente le prestazioni in media.

Quando un atteggiamento positivo verso l’IA ritorce contro

Sotto queste medie, però, è emerso un andamento più sottile. I partecipanti hanno compilato anche questionari su quanto generalmente si fidano degli altri e su come percepiscono l’IA. Coloro che avevano un atteggiamento più positivo verso l’IA sono effettivamente peggiorati nel distinguere il reale dal falso quando ricevevano indicazioni dall’IA. Sono stati meno capaci di separare volti genuini da sintetici rispetto ai partecipanti con opinioni più caute o negative sull’IA. Questo effetto non è apparso quando i partecipanti credevano che i consigli provenissero da esseri umani, suggerendo che i suggerimenti dell’IA possono modellare—e talvolta distorcere—il nostro processo decisionale in modo peculiare. Lo studio ha inoltre rilevato che le persone che dichiaravano di affidarsi sempre ai consigli hanno ottenuto risultati peggiori rispetto a chi diceva di usarli solo a volte o per nulla.

Le persone restano al centro della decisione

I ricercatori hanno approfondito come le persone bilanciavano il proprio giudizio con i suggerimenti. In media, i partecipanti hanno mostrato una tendenza a etichettare i volti come reali, e questo bias è aumentato leggermente tra coloro che dichiaravano una maggiore propensione a fidarsi degli altri esseri umani. Tuttavia il modo in cui le persone utilizzavano i consigli appariva “strategico”: sembravano ricorrervi soprattutto quando erano meno sicuri. Le valutazioni di fiducia corrispondevano abbastanza bene alle prestazioni—quando le persone si sentivano più sicure, erano generalmente più accurate—indicando che i partecipanti avevano un senso ragionevole di quando stavano sbagliando o azzeccando la risposta, anche con l’IA nel circuito.

Cosa significa per gli strumenti di IA nella vita quotidiana

Per un lettore non specialista, il messaggio chiave è che l’IA non elimina magicamente i bias umani, né sovrasta automaticamente il nostro giudizio. Le persone spesso trattano i consigli dell’IA in modo simile a quelli umani e possono ignorarli quando appaiono poco utili. Ma quando qualcuno ha già un’opinione molto positiva sull’IA, è più probabile che vi si appoggi in modi che riducono la sua accuratezza. Con la diffusione dei sistemi di IA in ambiti critici come la sanità, la sicurezza e la giustizia, progettisti e decisori politici dovranno comprendere queste tendenze umane. Questo studio suggerisce che l’uso efficace dell’IA dipende non solo da algoritmi migliori, ma anche da persone informate che sappiano quando fidarsi della macchina—e quando fidarsi di se stesse.

Citazione: Pearson, J., Dror, I., Jayes, E. et al. Examining human reliance on artificial intelligence in decision making. Sci Rep 16, 5345 (2026). https://doi.org/10.1038/s41598-026-34983-y

Parole chiave: intelligenza artificiale, processo decisionale umano, fiducia nell'IA, bias di automazione, volti deepfake