Clear Sky Science · it

Un metodo di calibrazione extrinseca LiDAR–fotocamera a lungo raggio per il trasporto ferroviario

Mantenere i treni al sicuro da lontano

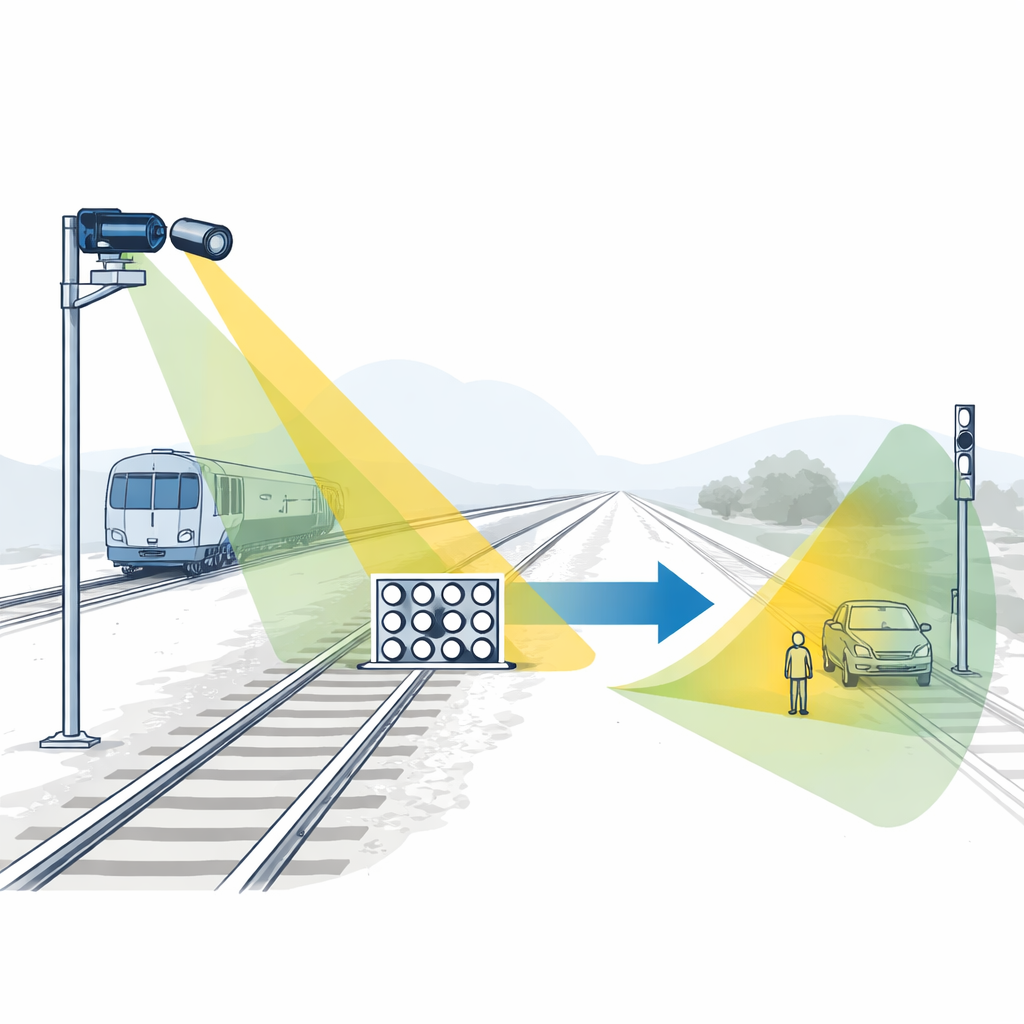

I moderni treni senza conducente si affidano a “occhi” elettronici per sorvegliare i binari alla ricerca di ostacoli molto prima di quanto potrebbe fare un essere umano. Due dei sensori più importanti sono le fotocamere e i rilevatori laser detti LiDAR, che percepiscono il mondo in modo diverso. Per lavorare insieme devono essere allineati con grande precisione, un compito che diventa sorprendentemente difficile quando osservano binari a centinaia di metri di distanza. Questo studio presenta un nuovo modo di allineare questi sensori affinché possano proteggere in modo affidabile i sistemi ferroviari a lungo raggio.

Perché l’allineamento dei sensori è importante

Su un treno autonomo, le fotocamere acquisiscono immagini a colori dettagliate mentre il LiDAR misura la distanza emettendo impulsi di luce e cronometra il loro ritorno. Fondendo queste due viste il sistema può individuare e tracciare oggetti che potrebbero invadere l’area dei binari, da un’auto bloccata a un incrocio a detriti sui binari. Ma la fusione funziona solo se il sistema conosce esattamente come fotocamera e LiDAR sono posizionati l’uno rispetto all’altro. Una piccola disallineamento può spostare un ostacolo rilevato di molti centimetri — o persino metri — a lunghe distanze, rendendo i sistemi di protezione automatici più lenti o meno affidabili.

La sfida di vedere lontano lungo i binari

Per le applicazioni ferroviarie, gli ingegneri spesso utilizzano obiettivi tele per consentire alla fotocamera di vedere chiaramente oggetti a centinaia di metri. A quelle distanze, però, i ritorni LiDAR da qualsiasi target di calibrazione diventano molto scarsi: solo pochi punti laser colpiscono la tavola usata per allineare i sensori. La maggior parte delle tecniche di allineamento esistenti presume una nuvola densa di punti LiDAR o bordi ricchi nella scena, condizioni che semplicemente non si verificano a lungo raggio. Di conseguenza, diventa difficile trovare caratteristiche corrispondenti tra l’immagine 2D e la nuvola di punti 3D con la precisione necessaria a supportare un controllo sicuro del treno.

Una tavola di calibrazione più intelligente

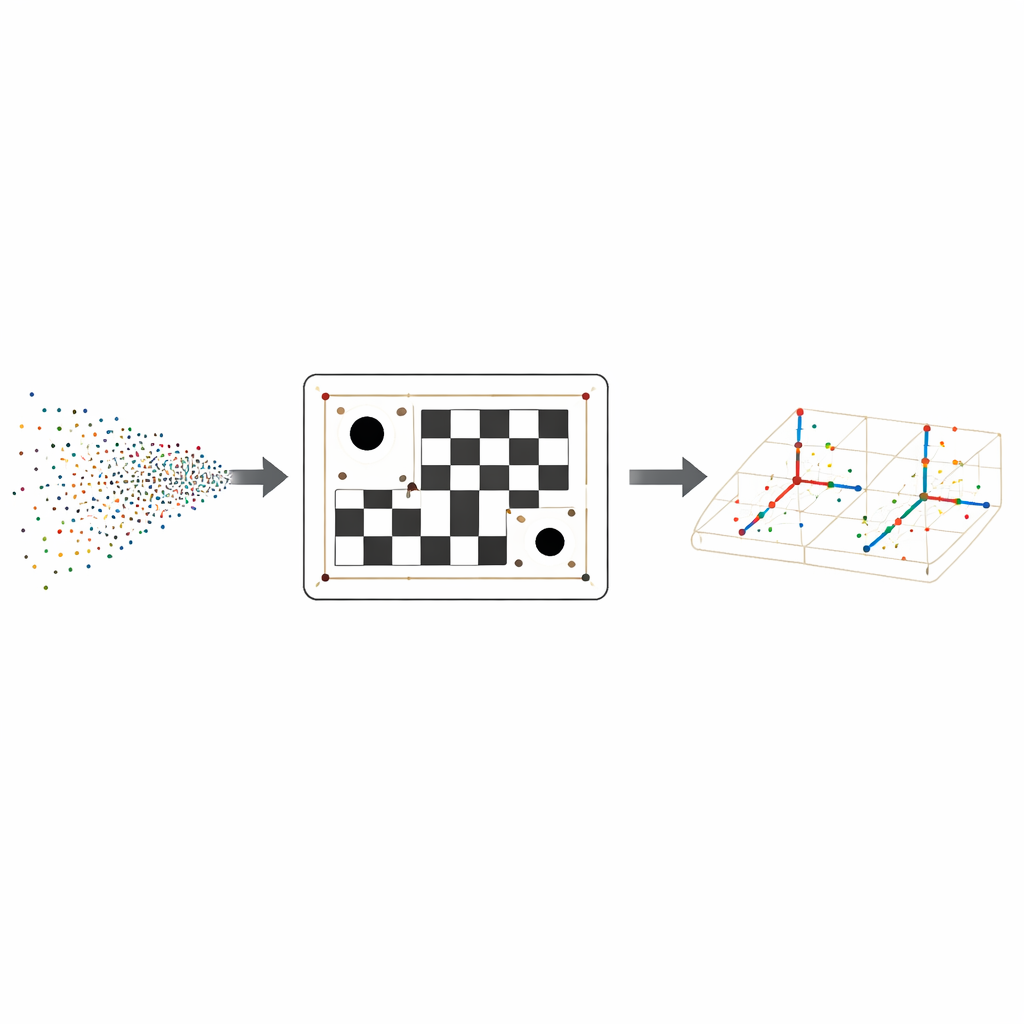

Per superare questo problema, gli autori progettano una tavola di calibrazione speciale che combina un familiare motivo a scacchiera bianco‑nero con tre fori circolari i cui centri formano un triangolo irregolare. Il motivo a scacchiera fornisce molti punti di angolo precisi nell’immagine della fotocamera, mentre i fori creano forti indizi geometrici per il LiDAR, che può facilmente rilevare i loro bordi circolari anche a grande distanza. Poiché i tre fori sono posizionati in un triangolo asimmetrico, l’orientamento della tavola nello spazio può essere determinato in modo univoco, evitando confusione dovuta a viste riflesse o ruotate.

Trasformare punti sparsi in corrispondenze affidabili

Dal lato LiDAR, il metodo innanzitutto pulisce la nuvola di punti e adatta un piano che rappresenta la tavola. Quindi proietta i punti su questo piano e utilizza una procedura robusta di adattamento di cerchi per trovare il centro di ciascun foro, perfezionandone le posizioni imponendo le distanze fisiche note tra i fori. Con il triangolo dei centri dei fori stabilito, l’algoritmo costruisce una griglia di coordinate locale sulla tavola, prevede dove ogni angolo della scacchiera dovrebbe trovarsi in 3D e controlla i punti LiDAR vicini per i giusti valori di brillantezza, o riflettività. Questa combinazione di geometria e riflettività trasforma una manciata di ritorni sparsi in un insieme affidabile di posizioni 3D degli angoli che corrispondono agli angoli 2D della fotocamera.

Affinare la relazione tra i sensori

Una volta che gli stessi angoli fisici sono identificati sia nell’immagine della fotocamera sia nella nuvola LiDAR, gli autori risolvono l’esatta rotazione e traslazione che collegano i due sensori. Utilizzano una tecnica di ottimizzazione iterativa che aggiusta ripetutamente questa relazione per ridurre la differenza tra dove i punti LiDAR si proiettano nell’immagine e dove la fotocamera vede effettivamente gli angoli. Test su una piattaforma ferroviaria reale, impiegando obiettivi di fotocamera da teleobiettivi moderati a potenti, mostrano che il nuovo metodo mantiene costantemente errori di proiezione di circa un pixel o meno, e supera diverse alternative ben note soprattutto alle lunghezze focali maggiori dove i dati sono più scarsi.

Cosa significa per la sicurezza ferroviaria

In termini concreti, lo studio offre un modo più affidabile per dire alla fotocamera e al LiDAR di un treno autonomo: “siete qui e guardate esattamente in questa direzione.” Ridisegnando la tavola di calibrazione e aggiungendo un’elaborazione intelligente dei dati LiDAR scarsi, il metodo mantiene un’elevata accuratezza anche quando i sensori osservano scene a centinaia di metri di distanza. Questo allineamento più stretto permette al sistema fuso di posizionare gli ostacoli con maggiore precisione nello spazio 3D, rafforzando la base tecnologica per un trasporto ferroviario più sicuro e una percezione multisensore più affidabile nel mondo reale.

Citazione: Liu, X., Wang, H., Ruan, S. et al. A long-range LiDAR–camera extrinsic calibration method for rail transit. Sci Rep 16, 8018 (2026). https://doi.org/10.1038/s41598-025-34547-6

Parole chiave: sicurezza del trasporto ferroviario, fusione LiDAR e fotocamera, calibrazione dei sensori, treni autonomi, percezione a lungo raggio