Clear Sky Science · it

Approccio di apprendimento incrementale per la segmentazione semantica di immagini istologiche cutanee

Perché insegnare ai computer a leggere i campioni cutanei è importante

Il cancro della pelle è uno dei tumori più diffusi al mondo e i medici spesso si affidano a sottili fette di tessuto, osservate al microscopio, per valutare la gravità di un tumore e scegliere il trattamento. L’interpretazione di questi vetrini è un lavoro lento e impegnativo che può variare tra esperti. Questo studio esplora come costruire sistemi informatici che imparino a riconoscere diversi tessuti e tumori cutanei nelle immagini microscopiche e, cosa importante, continuino a migliorare nel tempo man mano che vengono aggiunti nuovi tipi di immagini — proprio come un medico in formazione che apprende continuamente durante la carriera.

Da risposte semplici sì/no a mappe tissutali dettagliate

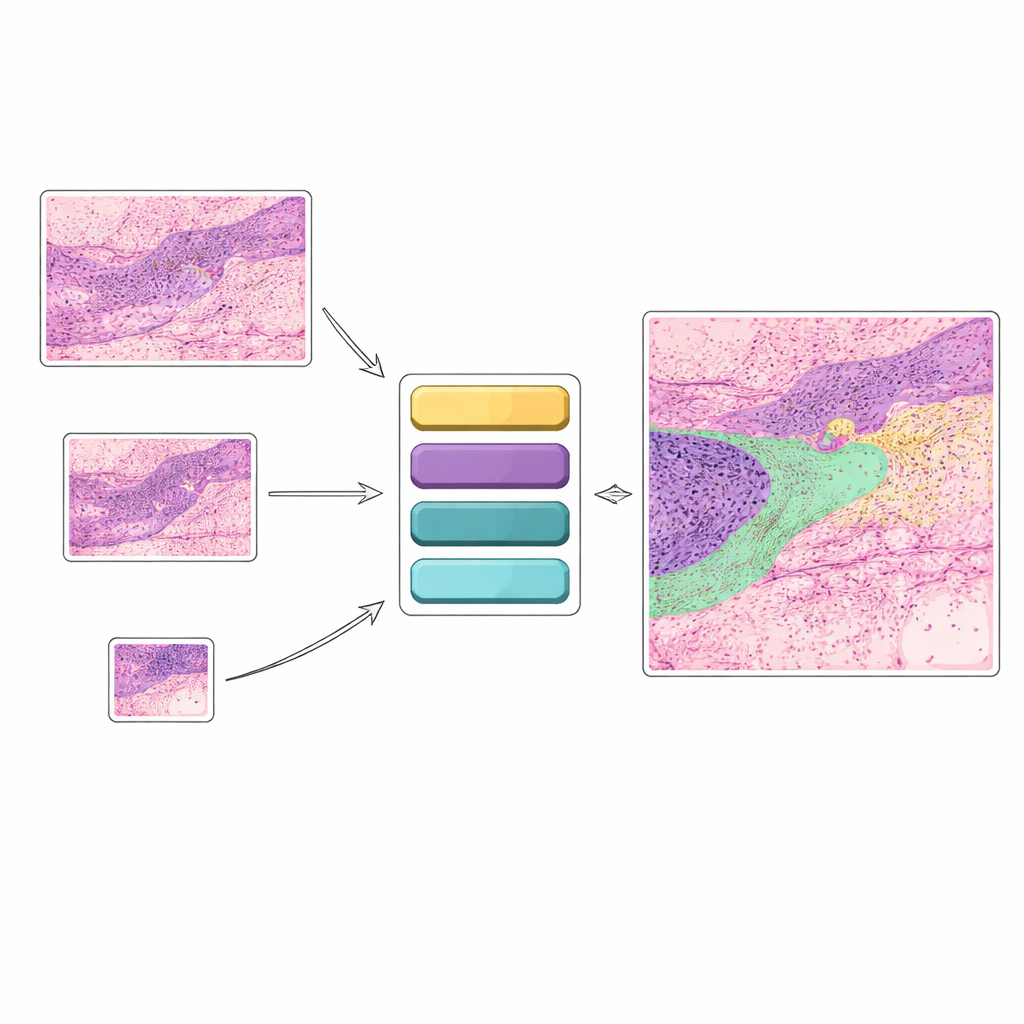

Molti strumenti di intelligenza artificiale per il cancro della pelle analizzano un’immagine e forniscono una risposta ristretta come “cancro” o “nessun cancro”. Pur essendo utili, queste decisioni binarie non colgono la ricchezza di dettaglio visibile ai patologi. In pratica, i medici si interessano a molte strutture contemporaneamente: diversi tipi di tumore, strati cutanei sani, follicoli piliferi, ghiandole, zone infiammate e altro. Questo studio si concentra invece sulla “segmentazione semantica”, dove ogni pixel di un’immagine istologica viene assegnato a una delle dodici categorie tissutali. Si ottiene così una mappa a colori che mostra esattamente dove si trovano tumori e tessuti normali, offrendo indicazioni più chiare per la diagnosi e la pianificazione del trattamento.

Perché i sistemi intelligenti attuali faticano ad adattarsi

I potenti modelli di deep learning odierni di solito presuppongono che tutti i dati di addestramento siano disponibili contemporaneamente. Una volta addestrati, tendono a “congelare” le conoscenze. Se in seguito vengono introdotti nuovi dati con caratteristiche diverse — ad esempio immagini a un’altra ingrandimento — l’opzione più sicura è spesso riaddestrare il modello da zero. Questo è costoso e lento e, cosa peggiore, l’aggiunta di nuove informazioni può causare un “dimenticare catastrofico”, dove le prestazioni su compiti precedenti peggiorano silenziosamente. In ambito clinico, però, i dati evolvono continuamente: gli scanner vengono aggiornati, cambiano le impostazioni di imaging e gli ospedali raccolgono nuovi tipi di campioni. Uno strumento di IA che non riesce ad assorbire questi cambiamenti in modo fluido è difficile da utilizzare con fiducia nella pratica quotidiana.

Una strategia di apprendimento a tappe ispirata a come imparano gli umani

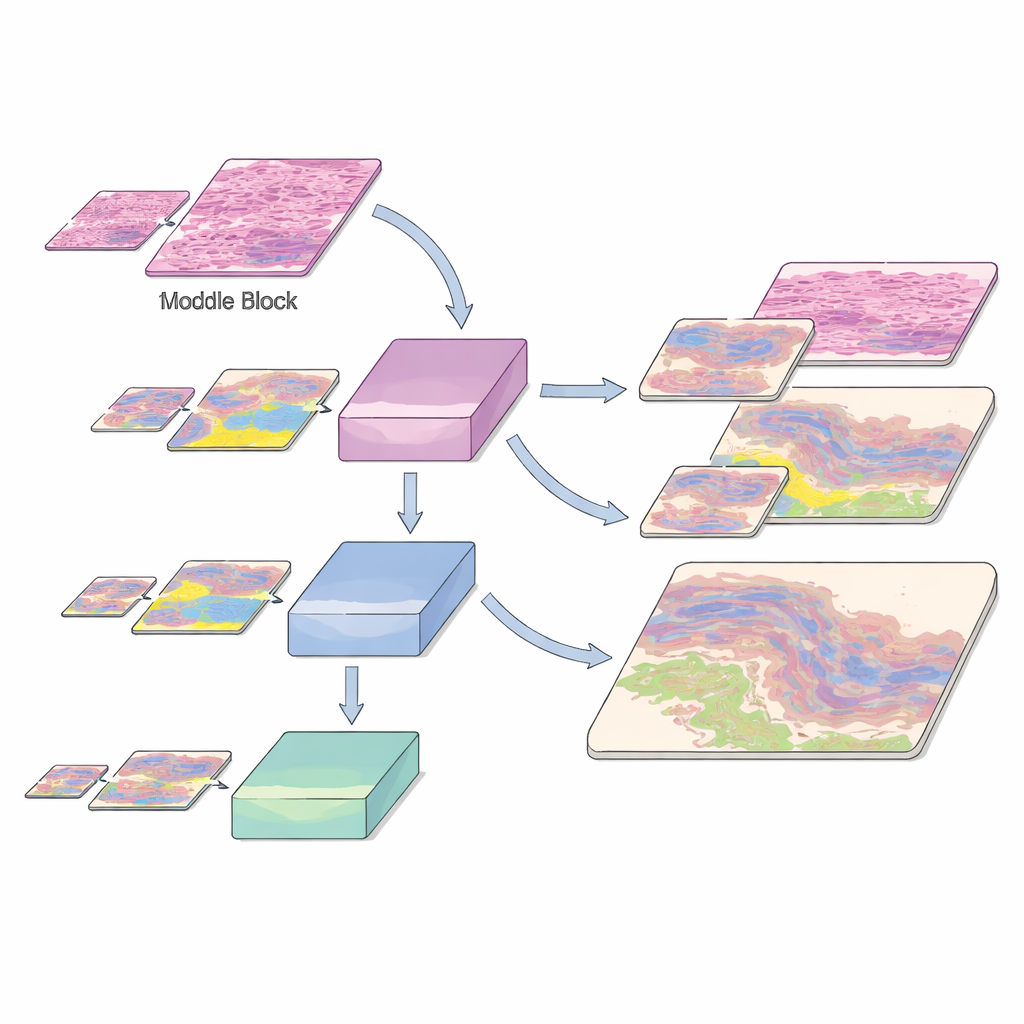

Gli autori partono da una moderna architettura transformer per la visione chiamata SegFormer e la trasformano in un sistema di “apprendimento incrementale” per i tumori cutanei non melanocitici. Invece di avere tutti i dati insieme, il modello viene addestrato per fasi usando vetrini istologici di un dataset pubblico dell’Università del Queensland. Prima impara da immagini ad alto ingrandimento (10×), dove i dettagli sono nitidi. Successivamente vengono aggiunte immagini a 5× e poi a 2×, mantenendo però una parte dei dati ad alta risoluzione nel train set. Funzioni di loss speciali aiutano la nuova versione del modello a conservare ciò che aveva appreso sui pattern tissutali, pur adattandosi alle viste più grossolane e più ampie. Questo “apprendere senza dimenticare” è guidato da una tecnica chiamata distillazione della conoscenza, in cui un modello precedente agisce da insegnante per quello nuovo, e da un termine di distillazione reciproca che spinge entrambe le rappresentazioni, vecchia e nuova, a restare in armonia.

Apprendere attraverso livelli di zoom e tipi tissutali rari

Le immagini istologiche sono sfidanti non solo perché esistono molti tipi tissutali, ma anche perché alcune strutture importanti sono rare. Il dataset include tumori comuni come il carcinoma basocellulare e il carcinoma squamoso, oltre a strati cutanei normali e infiammati, tutti annotati a livello di pixel da esperti — un processo meticoloso che richiede centinaia di ore. Gli autori sezionano questi enormi vetrini in piccoli patch e addestrano il modello usando una suddivisione attenta in set di training, validazione e test, preservando la distribuzione delle classi tissutali a ciascun ingrandimento. Per aiutare il sistema a riconoscere regioni scarse ma clinicamente cruciali, aumentano le classi sottorappresentate ruotando i patch e presentando al modello quei tessuti a più livelli di zoom. Questa esposizione multi-risoluzione aiuta l’IA a riconoscere la stessa struttura biologica sia che appaia come un primo piano nitido sia come una forma più sfumata e distante.

Cosa ottiene il modello rispetto agli strumenti precedenti

I modelli SegFormer addestrati separatamente a ciascun ingrandimento superano già i precedenti progetti convoluzionali come U-Net in molte categorie tissutali. Ma quando si applica lo schema di apprendimento incrementale — addestrando prima a 10×, poi a 10× più 5× e infine a 10×, 5× e 2× insieme — i miglioramenti diventano evidenti. L’accuratezza complessiva aumenta da circa il 89% con solo immagini a 10× a oltre il 95% dopo l’inclusione di tutti e tre gli ingrandimenti. Anche le misure di sovrapposizione tra regioni predette e reali migliorano costantemente, e le prestazioni su tumori come il carcinoma basocellulare e il carcinoma squamoso, oltre a strati normali chiave come l’epidermide e il derma papillare, superano i metodi concorrenti. Importante, con l’aggiunta di ogni nuovo livello di zoom il modello non dimentica ciò che aveva imparato; al contrario, la sua comprensione della struttura tissutale diventa più robusta e generale.

Come questo lavoro avvicina la diagnosi assistita dall’IA alla clinica

Per i non specialisti, il messaggio principale è che gli autori hanno creato un “mappatore” dei tessuti cutanei che può continuare a studiare nuovi tipi di immagini senza perdere le abilità precedenti. Progettando con cura come il modello apprende per fasi e come riutilizza la propria conoscenza passata, dimostrano che è possibile costruire strumenti di IA che si adattano all’evoluzione delle pratiche di imaging medico. Pur richiedendo ulteriori validazioni tra diversi ospedali e tipi di patologia, questo approccio incrementale basato su transformer indica la strada verso sistemi di IA che restano aggiornati con dati in evoluzione, offrono spiegazioni visive dettagliate di dove si trovano i tumori e, in ultima istanza, supportano i patologi nel prendere decisioni terapeutiche più sicure e coerenti.

Citazione: Fatima, S., Salam, A.A., Akram, M.U. et al. Incremental learning approach for semantic segmentation of skin histology images. Sci Rep 16, 9593 (2026). https://doi.org/10.1038/s41598-025-31553-6

Parole chiave: cancro della pelle, immagini istologiche, segmentazione semantica, apprendimento incrementale, transformer per deep learning