Clear Sky Science · it

StatLLM: un set di dati per valutare le prestazioni dei grandi modelli linguistici nell'analisi statistica

Perché questo è importante per gli utenti di dati quotidiani

Con l'integrazione di strumenti di intelligenza artificiale come gli assistenti conversazionali nel lavoro di tutti i giorni, sempre più persone chiedono a questi sistemi di elaborare numeri, condurre esperimenti e analizzare dati. Ma quando un'IA scrive il codice per uno studio statistico — per esempio per verificare se un nuovo trattamento medico funziona o per esplorare dati sulle prestazioni scolastiche — come possiamo sapere se il lavoro è stato svolto correttamente? Questo articolo presenta StatLLM, un dataset pubblico pensato per testare quanto bene i grandi modelli linguistici affrontano compiti di analisi statistica reali, offrendo a ricercatori e professionisti una visione più chiara di quando fidarsi del codice scritto dall'IA e quando essere cauti.

Un nuovo banco di prova per il codice statistico generato dall'IA

Il nucleo di StatLLM è una raccolta accuratamente assemblata di 207 compiti di analisi statistica costruiti a partire da 65 dataset reali provenienti da campi come istruzione, medicina, business, finanza, ingegneria e sport. Ogni compito include una descrizione in linguaggio naturale, una spiegazione dettagliata del dataset e delle sue variabili, e un breve frammento di codice SAS scritto e verificato da esperti umani. I compiti coprono ciò che uno studente universitario di buon livello o uno studente magistrale in statistica potrebbe apprendere: da riepiloghi e grafici semplici fino alla regressione, analisi di sopravvivenza e metodi più avanzati. Questo fornisce un test realistico, in stile accademico e industriale, per valutare se gli strumenti di IA sono in grado di comprendere questioni pratiche e tradurle in passaggi di analisi affidabili.

Far scrivere il codice all'IA, poi valutarne il lavoro

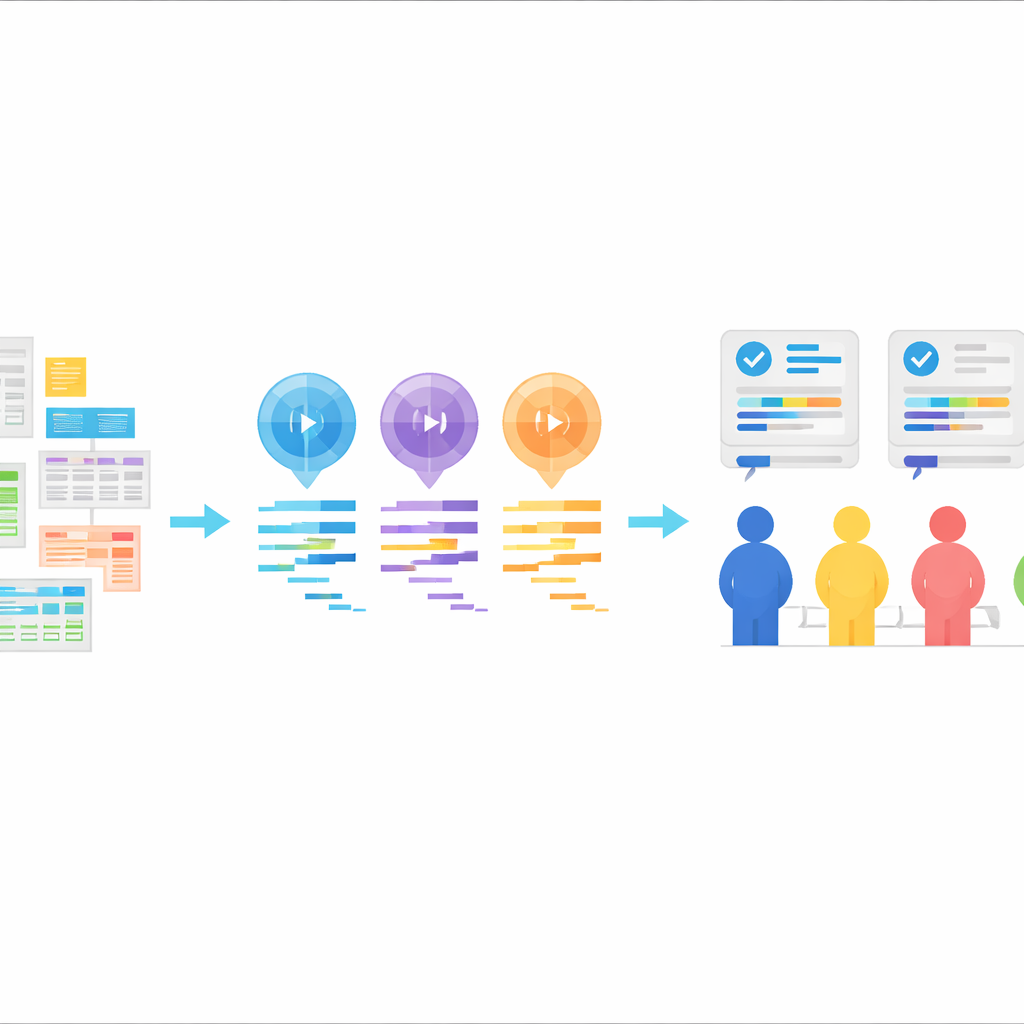

Utilizzando questi compiti, gli autori hanno chiesto a tre grandi modelli linguistici — GPT-3.5, GPT-4 e Llama‑3.1 70B — di generare codice SAS. A ogni modello sono stati forniti gli stessi ingredienti: la descrizione del compito, la descrizione del dataset, il file di dati reale e un'istruzione esplicita per produrre codice SAS. I modelli sono stati usati in modalità “zero-shot”, cioè non è stato mostrato loro alcun esempio di codice SAS corretto in anticipo. Le risposte sono state pulite in modo che rimanesse solo il codice, senza spiegazioni. Questa configurazione imita un comune scenario reale: un utente descrive ciò che vuole, l'IA restituisce codice e quel codice viene quindi eseguito in un pacchetto statistico.

Esperti umani come standard d'oro

Per capire quanto fosse davvero buono il codice generato dall'IA, il team ha organizzato una rigorosa revisione umana. Nove utilizzatori esperti di SAS si sono organizzati in tre gruppi, ognuno concentrato su una parte della valutazione: se il codice fosse logicamente corretto e leggibile, se effettivamente venisse eseguito senza errori e se l'output risultante rispondesse alla domanda originale in modo chiaro e accurato. Per ogni compito, i programmi SAS prodotti dai tre modelli sono stati mescolati in modo che i valutatori non sapessero quale modello avesse generato quale codice. I punteggi sono stati assegnati su una scala a cinque punti e combinati in un totale complessivo, fornendo una visione sfumata di punti di forza e debolezza attraverso centinaia di coppie modello–compito. Queste valutazioni di esperti sono ora pubblicate insieme a tutto il codice e ai compiti nel dataset StatLLM.

Insegnare alle macchine a giudicare il codice come fanno gli umani

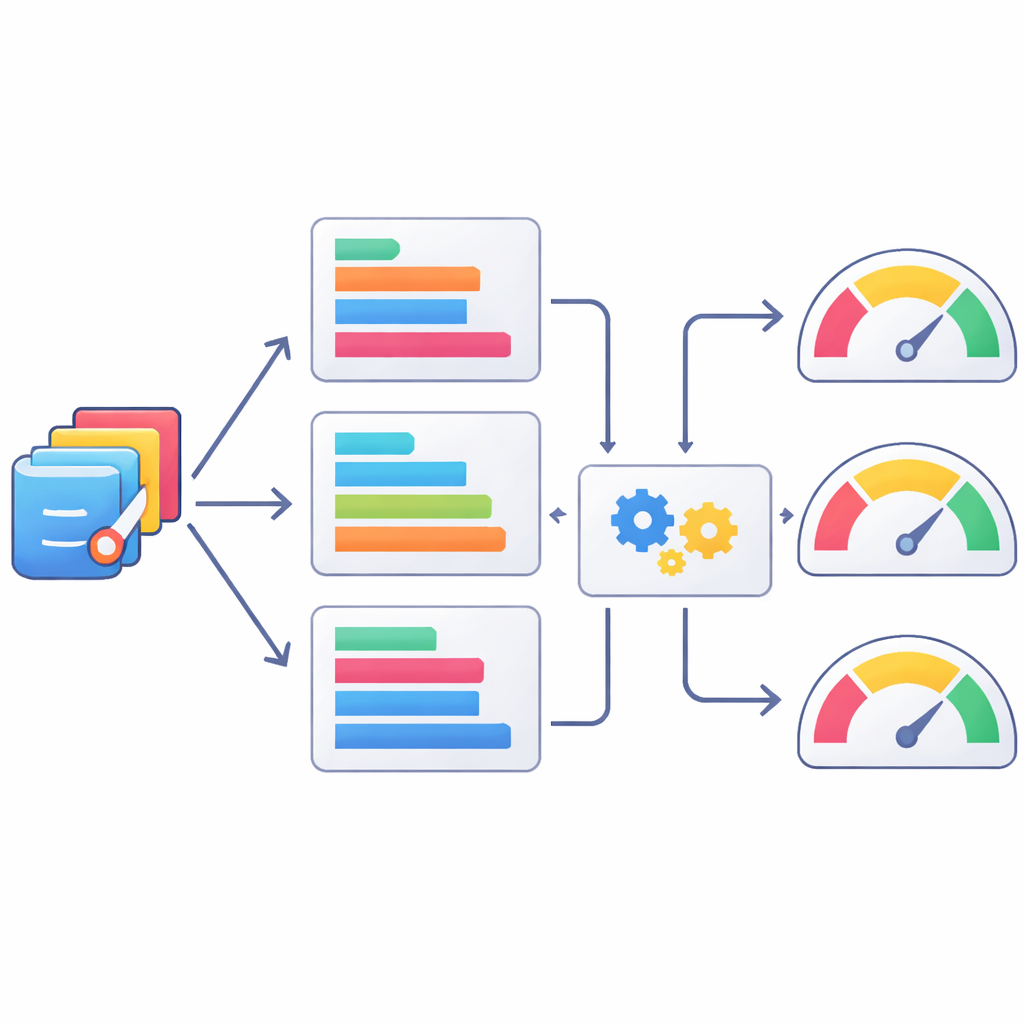

Poiché la revisione umana è lenta e costosa, gli autori hanno anche esplorato quanto bene le metriche automatiche basate sul testo possano sostituirsi come giudici approssimativi della qualità del codice statistico. Hanno confrontato i programmi SAS generati dall'IA con le versioni verificate dagli umani usando una serie di note metriche di elaborazione del linguaggio naturale, quindi hanno verificato quanto queste metriche si allineassero con le valutazioni umane. Alcune metriche, come varianti del punteggio ROUGE che misurano sovrapposizioni in brevi sequenze di token, si sono correlate meglio con i giudizi umani rispetto ad altre, ma tutte hanno mostrato solo un allineamento moderato. Il team ha poi fatto un passo ulteriore, addestrando modelli di machine learning per prevedere i punteggi umani a partire da combinazioni di queste metriche. Metodi come XGBoost hanno migliorato la corrispondenza con le valutazioni umane, ma sono rimasti lontani dal catturare perfettamente il giudizio degli esperti, sottolineando che le metriche automatiche sono, nel migliore dei casi, proxy parziali.

Costruire strumenti statistici guidati dall'IA per il futuro

Oltre al benchmarking, gli autori mostrano come StatLLM possa supportare nuovi strumenti e direzioni di ricerca. Poiché ogni compito è descritto in termini generali, gli stessi problemi possono essere usati per testare la generazione di codice in altri linguaggi come R o Python, o anche per combinare codice da più linguaggi. L'articolo mette in evidenza approcci ensemble che possono mescolare diverse soluzioni generate dall'IA per maggiore affidabilità e dimostra un prototipo di app R Shiny in cui gli utenti caricano un dataset e la descrizione del compito e un sistema IA produce ed esegue automaticamente codice R. StatLLM fornisce inoltre una piattaforma per progettare e testare software statistico di nuova generazione che comprende istruzioni in linguaggio naturale pur essendo sottoposto a standard chiari e misurabili.

Cosa significa per l'uso dell'IA nell'analisi dei dati

Per i non specialisti, la conclusione principale è che l'IA può già scrivere brevi frammenti di codice statistico — ma l'affidabilità è lontana dall'essere garantita, soprattutto per compiti che vanno oltre esempi semplici. StatLLM offre un modo trasparente e riutilizzabile per vedere quanto bene diversi modelli si comportano, migliorare i controlli automatici sul loro lavoro e progettare strumenti di analisi dei dati più sicuri e robusti. Man mano che appaiono modelli linguistici più recenti, possono essere inseriti in questo benchmark in evoluzione, mantenendo il campo onesto su ciò che l'IA può e non può ancora fare nel lavoro statistico serio.

Citazione: Song, X., Lee, L., Xie, K. et al. StatLLM: A Dataset for Evaluating the Performance of Large Language Models in Statistical Analysis. Sci Data 13, 369 (2026). https://doi.org/10.1038/s41597-026-06731-4

Parole chiave: grandi modelli linguistici, analisi statistica, valutazione del codice, dataset di benchmark, programmazione SAS