Clear Sky Science · it

Un dataset per ecografie mammarie con catene di ragionamento che copre tutte le categorie istopatologiche

Perché questa ricerca è importante

Lo screening per il cancro al seno si affida sempre più spesso all’ecografia, in particolare per donne più giovani e in contesti in cui la mammografia è meno disponibile. Tuttavia, anche i migliori strumenti di intelligenza artificiale (IA) per l’interpretazione di queste immagini spesso si comportano come scatole nere, fornendo un verdetto—benigno o maligno—senza mostrare come ci siano giunti. Questo articolo presenta BUS-CoT, un nuovo dataset di ecografie mammarie liberamente disponibile progettato non solo per aiutare l’IA a individuare il cancro, ma per insegnarle a “pensare ad alta voce” in modo che rispecchi il ragionamento che i radiologi esperti seguono nei casi difficili.

Dalle immagini sfocate a indizi strutturati

Le immagini ecografiche sono rumorose e difficili da interpretare, anche per gli specialisti. Gli esperti non si limitano a dare un’occhiata a una scansione e a formulare una diagnosi; cercano invece una catena di indizi visivi—se una massa è ovale o irregolare, se i bordi sono lisci o spigolosi, se proietta ombra e se piccoli punti brillanti suggeriscono calcificazioni. Questi indizi vengono poi ponderati insieme a regole standardizzate, come il sistema BI-RADS, per stimare la probabilità che una lesione sia cancerosa e decidere se sia necessario un prelievo bioptico. I sistemi di IA esistenti spesso saltano questo ragionamento passo dopo passo, passando direttamente dai pixel a una previsione, il che rende le loro decisioni difficili da fidarsi e da applicare in casi insoliti o rari.

Una ricca raccolta di casi del mondo reale

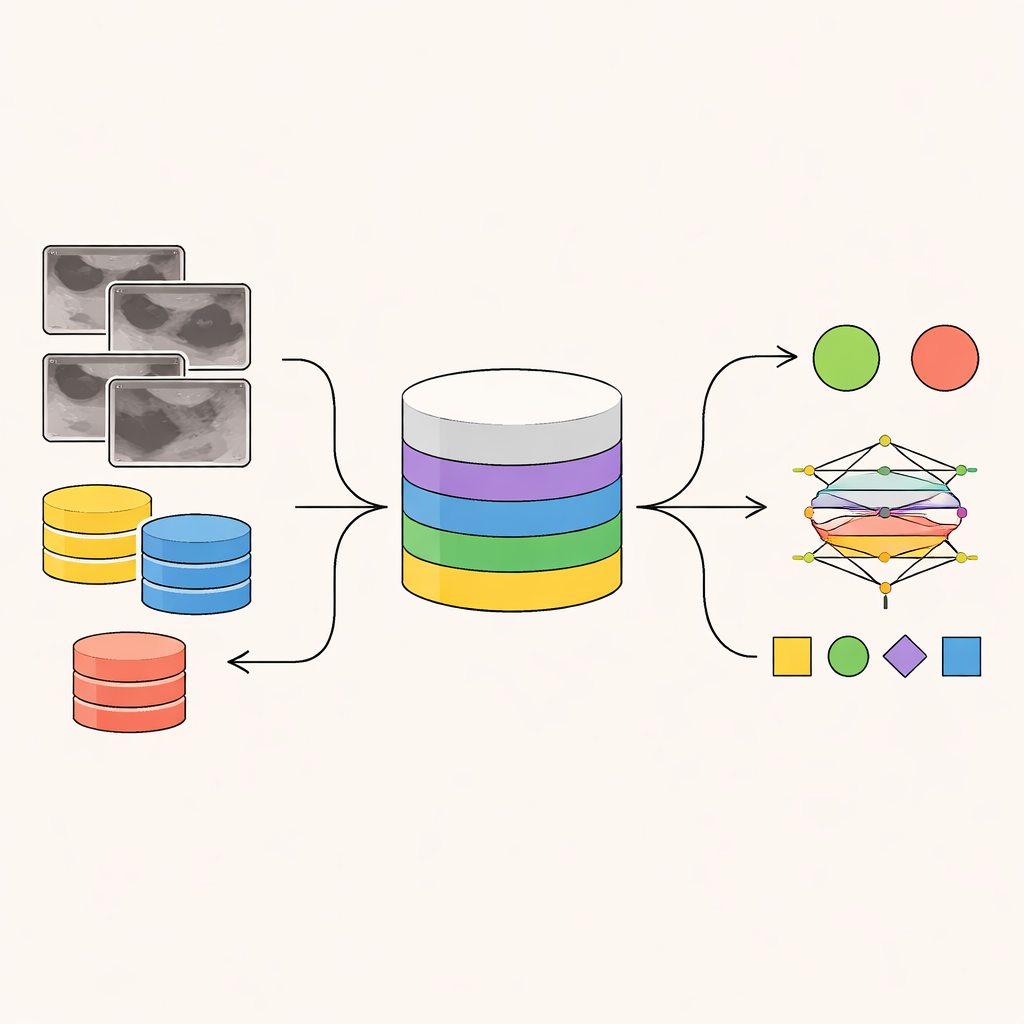

Il dataset BUS-CoT affronta questi problemi assemblando 11.439 immagini ecografiche mammarie relative a 11.850 lesioni in 4.838 pazienti, estratte da pubblicazioni, dataset aperti e repository di casi online distribuiti su più continenti e tipi di apparecchiature ecografiche. Elemento cruciale, la collezione copre tutte le 99 categorie di tessuto mammario definite dall’Organizzazione Mondiale della Sanità, dai comuni noduli benigni come i fibroadenomi fino a tumori rari e aggressivi. Questa ampia copertura risolve una debolezza significativa dei dataset precedenti, che tendono a escludere del tutto le malattie rare, lasciando i sistemi di IA impreparati proprio rispetto ai casi in cui i medici incontrano maggiori difficoltà.

Insegnare alle macchine a seguire una traccia di ragionamento

Oltre alle immagini grezze, BUS-CoT fornisce più livelli di annotazione esperta. I radiologi registrano prima osservazioni di base: se è presente una massa, se ci sono calcificazioni e dove si trova la lesione. Successivamente annotano caratteristiche visive dettagliate—forma, margini, pattern di eco interni e altro—prima di assegnare categorie BI-RADS e collegare questi reperti d’imaging alla patologia confermata da campioni tissutali. Infine, convertono queste informazioni strutturate in una catena di ragionamento narrativa: una breve spiegazione passo dopo passo che collega ciò che si vede nella scansione al motivo per cui una diagnosi particolare è probabile. A differenza di testi generati automaticamente, queste catene di ragionamento sono redatte e verificate da specialisti esperti in imaging mammario, preservando la logica clinica reale da cui i modelli possono apprendere.

Mettere il dataset alla prova

Per dimostrare le potenzialità di questa risorsa, gli autori hanno addestrato una serie di modelli moderni per immagini e modelli visione‑linguaggio su BUS-CoT, concentrandosi su un sottoinsieme curato e di alta qualità di 5.163 immagini centrate sulle lesioni. Reti tradizionali per immagini hanno imparato a classificare le lesioni come benigne o maligne, mentre un avanzato modello visione‑linguaggio è stato addestrato sia a interpretare l’immagine sia a generare una catena di ragionamento prima di fornire la sua risposta. Quando il modello è stato costretto a ragionare in questo modo strutturato, la sua accuratezza è migliorata, soprattutto nei casi ambigui in cui lesioni benigne e maligne si assomigliano. In altre parole, guidare il modello attraverso gli stessi indizi visivi che i radiologi usano lo ha aiutato a prendere decisioni migliori e più sicure.

Come questo lavoro può influenzare la cura futura

Per pazienti e clinici, la promessa di BUS-CoT risiede in strumenti di IA che non solo eguagliano l’accuratezza umana ma si spiegano in modo clinicamente significativo. Accoppiando migliaia di immagini ecografiche con ragionamenti accuratamente documentati e coprendo l’intero spettro delle diagnosi del tessuto mammario—even quelle rare—questo dataset pone le basi per sistemi di IA in grado di gestire i casi difficili e giustificare le proprie raccomandazioni. Sebbene non includa ancora informazioni cliniche più ampie come dati genetici o anamnesi medica, BUS-CoT rappresenta un passo importante verso diagnosi ecografiche più trasparenti e affidabili, dove le macchine possono comportarsi meno come oracoli misteriosi e più come collaboratori junior diligenti il cui processo di pensiero può essere ispezionato e perfezionato.

Citazione: Yu, H., Li, Y., Niu, Z. et al. A Chain-of-thought Reasoning Breast Ultrasound Dataset Covering All Histopathology Categories. Sci Data 13, 370 (2026). https://doi.org/10.1038/s41597-026-06702-9

Parole chiave: ecografia mammaria, IA per imaging medico, IA spiegabile, diagnosi del cancro al seno, dataset clinici